Clear Sky Science · pl

Stabilne podejście oparte na diagonalnych rekurencyjnych kwantowych sieciach neuronowych do identyfikacji układów nieliniowych

Nauczanie maszyn rozumienia złożonych układów

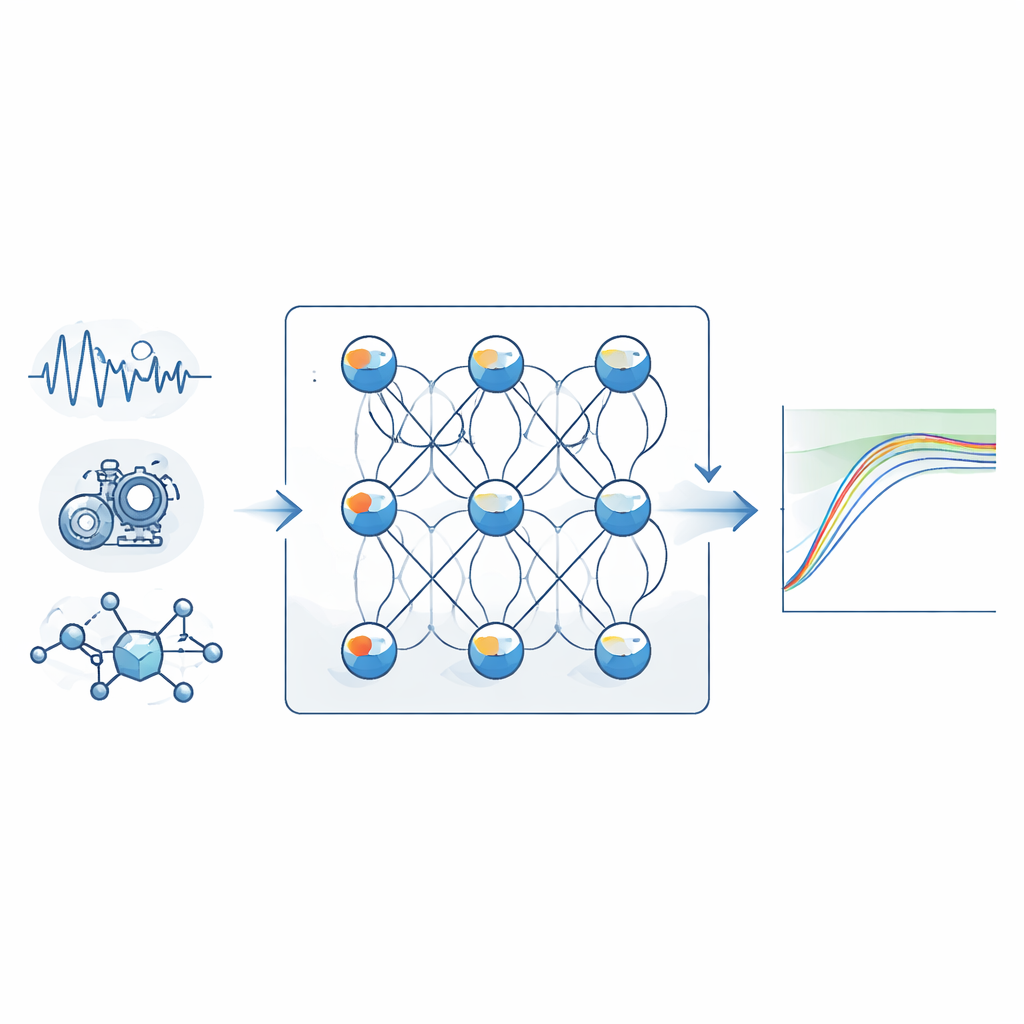

Wiele układów wpływających na nasze życie — od silników elektrycznych w urządzeniach po turbulentny przepływ powietrza, a nawet niektóre procesy medyczne — zachowuje się w sposób złożony i nieliniowy. Oznacza to, że niewielkie zmiany wejść mogą wywołać zaskakująco duże lub chaotyczne reakcje. Predykcja i sterowanie takimi układami jest trudne, a jednocześnie kluczowe dla efektywności, bezpieczeństwa i oszczędności energii. W artykule wprowadzono nowy typ maszyny uczącej, łączącej idee z obliczeń kwantowych, sieci neuronowych i teorii stabilności, by modelować te trudne zachowania dokładniej i solidniej.

Dlaczego zwykłe modele zawodzą

Tradycyjne narzędzia modelowania często zakładają, że przyczyna i skutek są uporządkowane i proporcjonalne, co sprawdza się w prostych lub blisko liniowych układach. Jednak wiele rzeczywistych układów ma pamięć, sprzężenia zwrotne i progi, które czynią ich zachowanie silnie nieliniowym. Klasyczne sieci neuronowe pomogły, lecz niosą też swoje problemy. Sieci jednokierunkowe, gdzie informacja płynie w jedną stronę, radzą sobie z zadaniami statycznymi, ale mają trudności, gdy liczy się przeszłość sygnałów. Sieci rekurencyjne, które zapętlają informacje, by tworzyć pamięć, potrafią uchwycić zachowania zmieniające się w czasie, lecz bywają trudne w trenowaniu, podatne na niestabilność i kosztowne obliczeniowo, gdy każdy neuron łączy się z każdym innym.

Łączenie idei kwantowych z prostymi pętlami

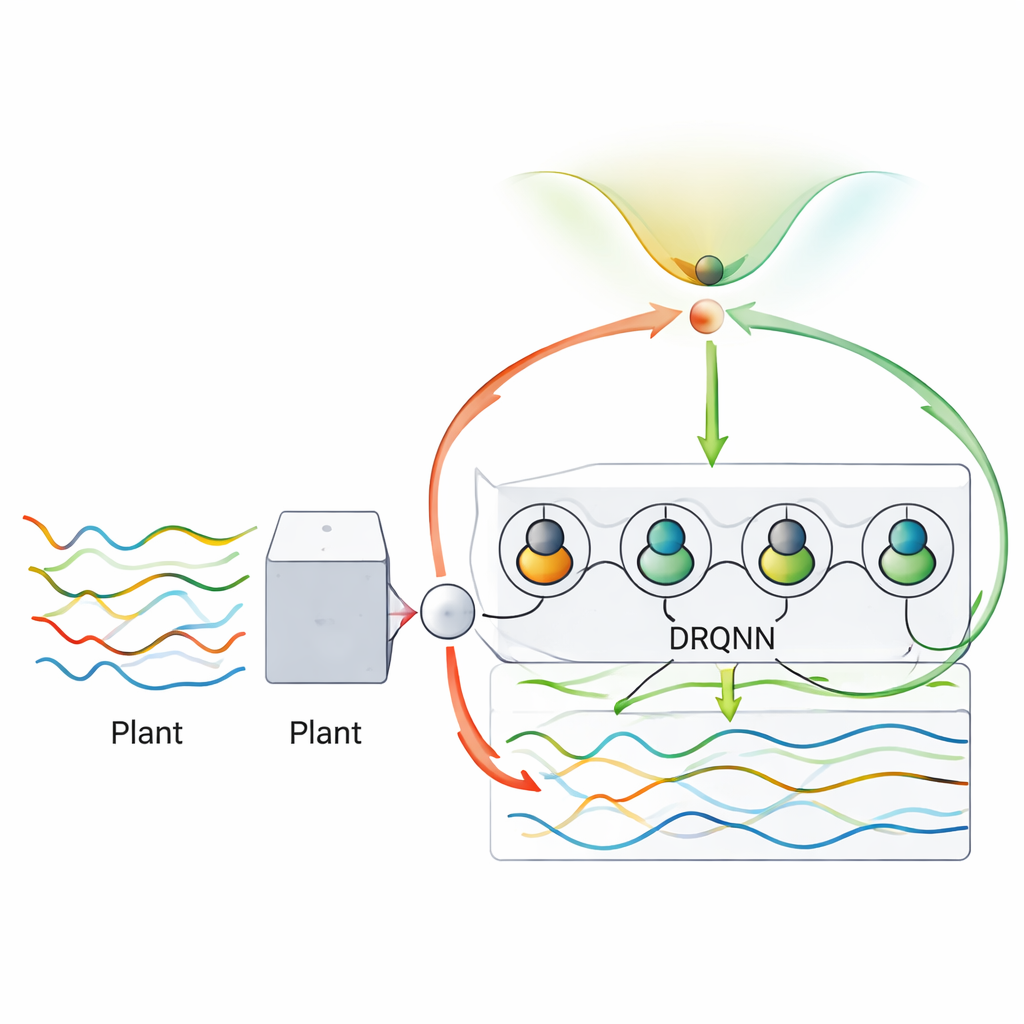

Autorzy proponują diagonalną rekurencyjną kwantową sieć neuronową ze stabilnością Lyapunowa, oznaczaną jako DRQNN-LS. W istocie sieć ma strukturę dobrze znanej trzywarstwowej sieci: wejścia, warstwa ukryta i wyjście. Jednak dwa rozwiązania wyróżniają ją na tle innych. Po pierwsze, jednostki ukryte zachowują się jak uproszczone kubity, których stany wewnętrzne opisane są przy użyciu wielkości przypominających fazę zamiast zwykłych liczb. Ta inspirowana kwantami reprezentacja pozwala każdej jednostce zakodować bogatszą informację w zwartej formie, poprawiając zdolność sieci do aproksymacji złożonych zależności. Po drugie, zamiast gąszczu sprzężeń zwrotnych, każdy neuron ukryty odsyła sygnał tylko do samego siebie. Taka „diagonalna” rekurencja zachowuje pamięć niezbędną do śledzenia wzorców zmieniających się w czasie, jednocześnie drastycznie zmniejszając liczbę połączeń do strojenia.

Utrzymanie stabilnego i kontrolowanego uczenia

Głównym wyzwaniem podczas trenowania każdej sieci rekurencyjnej jest zachowanie stabilności uczenia: jeśli wagi zmieniają się zbyt agresywnie, wyjście modelu może eksplodować lub oscylować; jeśli zbyt wolno, trenowanie trwa wiecznie i może utknąć. Autorzy odwołują się tu do teorii stabilności Lyapunowa, matematycznego ramienia pierwotnie rozwiniętego do analizy bezpieczeństwa układów fizycznych. Konstruują specjalną funkcję podobną do energii, która łączy błąd modelowania z wielkością parametrów sieci. Poprzez staranne wyprowadzenie, jak ta funkcja zmienia się w czasie, uzyskują automatyczne reguły aktualizacji wag i parametrów wewnętrznych tak, by ogólna „energia” mogła jedynie maleć. To daje adaptacyjne tempo uczenia, które przyspiesza lub zwalnia samoczynnie, gwarantując zbieżność bez ręcznego strojenia.

Próba nowej sieci w działaniu

Aby pokazać, że DRQNN-LS to więcej niż ciekawy pomysł na papierze, autorzy testują ją na trzech odmiennych zadaniach. Po pierwsze modelują matematyczny układ nieliniowy o znanym zachowaniu, sprawdzając, jak blisko sieć potrafi śledzić jego wyjście. Po drugie podejmują się mapy Henona — chaotycznego klasyka, w którym drobne zmiany warunków początkowych mogą dać diametralnie różne trajektorie. Po trzecie stosują metodę do rzeczywistych danych z małego silnika prądu stałego — hałaśliwego, praktycznego urządzenia, którego wewnętrzne działanie nie jest w pełni znane. W każdym przypadku porównują nowe podejście z kilkoma istniejącymi modelami neuronowymi, w tym klasycznymi sieciami diagonalnymi oraz wcześniejszymi wersjami inspirowanymi kwantami trenowanymi prostszymi regułami gradientowymi.

Lepsza dokładność, odporność i tolerancja na szum

We wszystkich trzech przykładach DRQNN-LS konsekwentnie osiąga niższe błędy predykcji i lepsze dopasowanie do prawdziwych sygnałów niż metody konkurencyjne, nawet gdy dane celowo są zanieczyszczane znacznym szumem. Nowy model wymaga co prawda nieco większych obliczeń na krok — ponieważ śledzi rekurencyjne stany inspirowane kwantami i ocenia aktualizacje oparte na funkcji Lyapunowa — czasy pracy pozostają jednak na tyle małe, by umożliwiać użycie w czasie rzeczywistym na współczesnych procesorach. Wyniki sugerują, że połączenie odchudzonej struktury rekurencyjnej, stanów neuronów w stylu kwantowym oraz matematycznie gwarantowanego stabilnego uczenia daje potężne i praktyczne narzędzie do rozumienia i przewidywania nieliniowej dynamiki w świecie rzeczywistym.

Co to oznacza na przyszłość

Dla osób niezajmujących się specjalistycznie tematem najważniejszym wnioskiem jest to, że uczymy się budować mądrzejsze i bardziej godne zaufania cyfrowe bliźniaki złożonych układów fizycznych. DRQNN-LS oferuje sposób, by maszyna uczyła się zachowania skomplikowanego procesu bezpośrednio z danych, przy jednoczesnym zapewnieniu, że jej uczenie nie „wybuchnie” ani nie będzie błądzić nieprzewidywalnie. Taka kombinacja elastyczności i stabilności może okazać się cenna w dziedzinach od sterowania przemysłowego i robotyki, przez systemy zasilania, aż po modelowanie biologiczne czy medyczne, gdzie nieliniowość i zaszumione pomiary są normą.

Cytowanie: Khalil, H., Elshazly, O. & Shaheen, O. Stable approach based diagonal recurrent quantum neural networks for identification of nonlinear systems. Sci Rep 16, 8274 (2026). https://doi.org/10.1038/s41598-026-37973-2

Słowa kluczowe: identyfikacja układów nieliniowych, kwantowa sieć neuronowa, rekurencyjna sieć neuronowa, stabilność Lyapunowa, modelowanie dynamiki chaotycznej