Clear Sky Science · pl

Rama uczenia głębokiego do diagnozy raka piersi wykorzystująca Swin Transformer i Sieć Fuzji Wieloskalowej z Podwójną Uwagą

Dlaczego to ma znaczenie dla pacjentek i lekarzy

Rak piersi jest jednym z najczęstszych nowotworów u kobiet, a mammografia to podstawowe narzędzie do jego wczesnego wykrywania. Odczytywanie tych zdjęć rentgenowskich jest jednak trudne, nawet dla ekspertów, i drobne sygnały ostrzegawcze mogą zostać przeoczone. W tym badaniu przedstawiono nowy system sztucznej inteligencji (AI) zaprojektowany, by pomagać radiologom w bardziej niezawodnym wykrywaniu raka piersi przez połączenie dwóch potężnych sposobów „patrzenia” na mammogramy: jednego, który widzi szeroki kontekst, oraz drugiego, który przygląda się drobnym szczegółom.

Wyzwanie: dostrzec i las, i drzewa

Nowoczesne systemy AI już wspomagają interpretację obrazów medycznych, lecz większość opiera się na jednym typie modelu. Splotowe sieci neuronowe dobrze wykrywają lokalne wzorce, jak ostre krawędzie czy małe jasne punkty. Transformery wzrokowe, nowsza rodzina modeli, doskonale rozumieją zależności rozciągające się na całe obrazowanie. Mammogramy wymagają jednak obu tych umiejętności jednocześnie: rak może ujawniać się jako mikroskopijne zwapnienia lub subtelne zniekształcenia, ale znaczenie tych oznak zależy od tego, jak wpisują się w ogólną strukturę piersi. Dodatkowo rzeczywiste zbiory danych mammograficznych są stosunkowo małe i często niezrównoważone, z wielokrotnie większą liczbą badań bez zmian niż z przypadkami raka, co ułatwia przeuczenie się modeli AI lub wprowadzenie uprzedzeń.

Dwutorowe AI: szeroko i głęboko

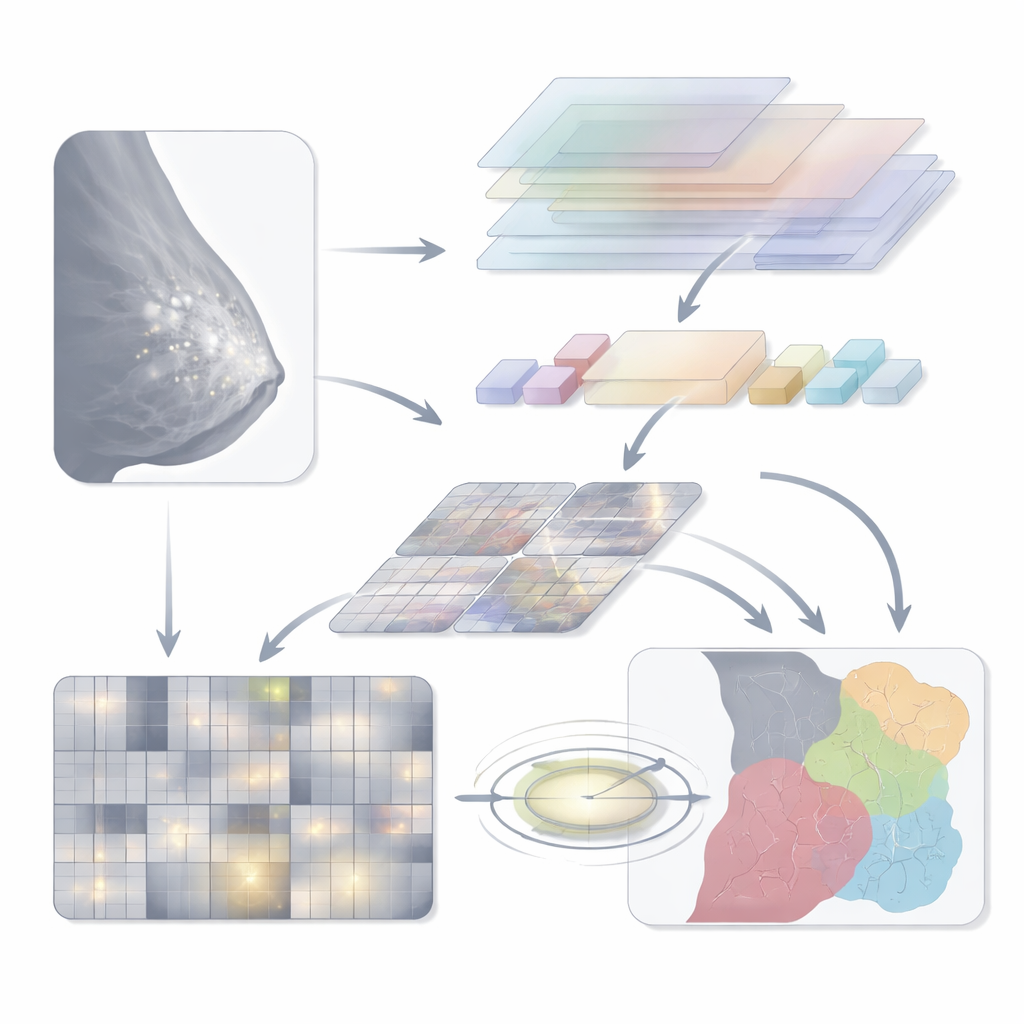

Autorzy proponują hybrydowy model nazwany Swin‑DAMFN, stworzony specjalnie do łączenia wizji globalnej i lokalnej. Jedna gałąź opiera się na Swin Transformerze, który dzieli mammogram na okna i wykorzystuje mechanizm uwagi do uchwycenia kontekstu na dużą skalę — jak różne części piersi względem siebie współdziałają. Druga gałąź to niestandardowa sieć konwolucyjna, Dual‑Attention Multi‑scale Fusion Network (DAMFN). Ta gałąź jest wyczulona na ekstremalnie drobne detale, takie jak mikrozwapnienia i delikatne zniekształcenia tkanek. W jej wnętrzu specjalizowane bloki analizują obraz w wielu skalach i kierunkach, a moduły uwagi podkreślają obszary o największej wartości klinicznej, jednocześnie tłumiąc tło.

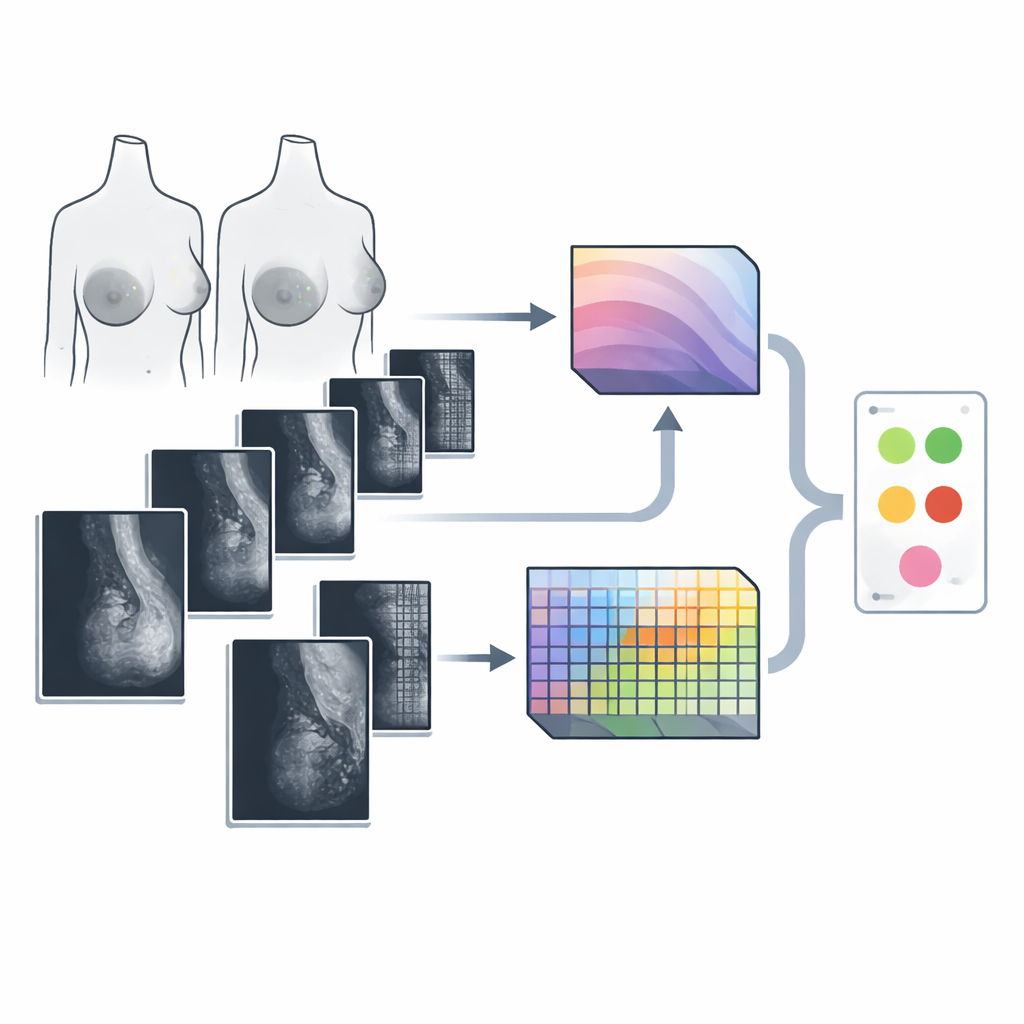

Nauczanie systemu większą i bogatszą pulą obrazów

Ponieważ rzeczywiste zbiory mammograficzne są ograniczone i przesunięte na korzyść przypadków bez raka, badacze wzmocnili dane treningowe na dwa uzupełniające się sposoby. Po pierwsze, użyli typu modelu generatywnego zwanego warunkowym GAN-em do syntezowania realistycznych fragmentów mammogramów, zwłaszcza dla słabiej reprezentowanych kategorii złośliwych. Wygenerowane obrazy pomagają zrównoważyć klasy i zapoznać model z większą liczbą wariantów wyglądu choroby. Po drugie, zastosowali zmiany fotometryczne — niewielkie, losowe korekty jasności, kontrastu i ostrości — zarówno do obrazów rzeczywistych, jak i syntetycznych. Zmusza to AI do skupienia się na prawdziwych wzorcach anatomicznych zamiast powierzchownych różnic w oświetleniu czy szumie, poprawiając zdolność uogólniania na nowe skany.

Jak elementy współdziałają podczas diagnozy

W trakcie analizy wstępnie przetworzony mammogram jest jednocześnie podawany do obu gałęzi. Swin Transformer tworzy skondensowane streszczenie struktury globalnej, podczas gdy DAMFN generuje bogatą mapę cech lokalnych. Następnie dostosowuje się ich rozmiary i łączy w jedną reprezentację. Lekki blok „triplet attention” dodatkowo usprawnia tę fuzję przez wzajemne sprawdzanie kanałów i wymiarów przestrzennych, kierując uwagę modelu na obszary najbardziej prawdopodobne do zawierania zmian chorobowych. Na końcu prosty moduł klasyfikacyjny uśrednia informacje i daje predykcję w kilku klasach, takich jak tkanka prawidłowa, zmiany łagodne czy różne typy zmian złośliwych.

Co oznaczają wyniki w praktyce

Zespół przetestował Swin‑DAMFN na dwóch powszechnie używanych publicznych zbiorach danych, CBIS‑DDSM i MIAS, i porównał go z wieloma popularnymi modelami uczenia głębokiego. Ich system osiągnął około 99% dokładności na CBIS‑DDSM i niemal 99% na MIAS, z podobnie wysoką czułością (zdolnością wykrywania raków) i swoistością (ograniczaniem fałszywych alarmów). Dokładne analizy ablacjne wykazały, że każdy element — dwie gałęzie, fuzja oparta na uwadze i strategia augmentacji danych — przyczynił się do tych rezultatów. Choć autorzy zastrzegają, że potrzebne są szersze testy na różnorodnych danych szpitalnych, wyniki sugerują, że hybrydowe systemy AI takie jak Swin‑DAMFN mogą stać się cennymi asystentami w przesiewaniu raka piersi, pomagając radiologom wykrywać niebezpieczne zmiany wcześniej i w sposób bardziej konsekwentny, jednocześnie zmniejszając obciążenie pracą i niepewność.

Cytowanie: Aldawsari, M.A., Aldosari, S.J., Ismail, A. et al. A deep learning framework for breast cancer diagnosis using Swin Transformer and Dual-Attention Multi-scale Fusion Network. Sci Rep 16, 8941 (2026). https://doi.org/10.1038/s41598-026-37969-y

Słowa kluczowe: rak piersi, mammografia, uczenie głębokie, modele transformerowe, sztuczna inteligencja w obrazowaniu medycznym