Clear Sky Science · pl

Detekcja obiektów w czasie rzeczywistym dla bezzałogowych statków powietrznych oparta na vision transformer i edge computing

Bardziej inteligentne oko na niebie

Bezzałogowe statki powietrzne — drony — szybko stają się powszechnymi narzędziami do zadań takich jak kontrola mostów, monitorowanie ruchu czy poszukiwanie zaginionych osób. Aby jednak dron rzeczywiście pomagał w zadaniach krytycznych czasowo, musi robić więcej niż tylko rejestrować obraz; musi rozpoznawać drobne obiekty w czasie rzeczywistym, latając przy ograniczonej baterii i niewielkim komputerze pokładowym. Niniejszy artykuł przedstawia nowe podejście do wyposażenia dronów w ostrzejsze, szybsze „oczodoły”, łącząc zaawansowaną technikę AI zwaną vision transformer z inteligentnym wykorzystaniem pobliskich serwerów edge, dzięki czemu małe obiekty, takie jak piesi, rowery i samochody, mogą być wykrywane szybko i niezawodnie z powietrza.

Dlaczego drony mają trudności z widzeniem drobnych detali

Z dużej wysokości ludzie i pojazdy mogą zmniejszyć się do zaledwie kilku lub kilkunastu pikseli w klatce wideo. Tradycyjne systemy sieci neuronowych używane na dronach projektowano tak, aby działały szybko na energooszczędnych układach, ale często nie wychwytują one takich maleńkich obiektów lub zawodzą przy zmianie oświetlenia czy kąta widzenia. Nowsze modele vision transformer, zapożyczone ze świata przetwarzania języka, znacznie lepiej rozumieją całą scenę jednocześnie i potrafią wyodrębnić drobne detale z zagraconego tła. Wadą jest to, że zwykle wymagają ogromnej mocy obliczeniowej, daleko przekraczającej możliwości platformy latającej. Autorzy postawili sobie za cel przeskoczyć tę przepaść: zachować precyzję transformera, ale odchudzić go na tyle, aby działał w czasie rzeczywistym na dronie, a dodatkową pracę przekazywać do pobliskiego serwera edge tylko wtedy, gdy warunki na to pozwalają.

Podzielony umysł: dron i edge współpracują

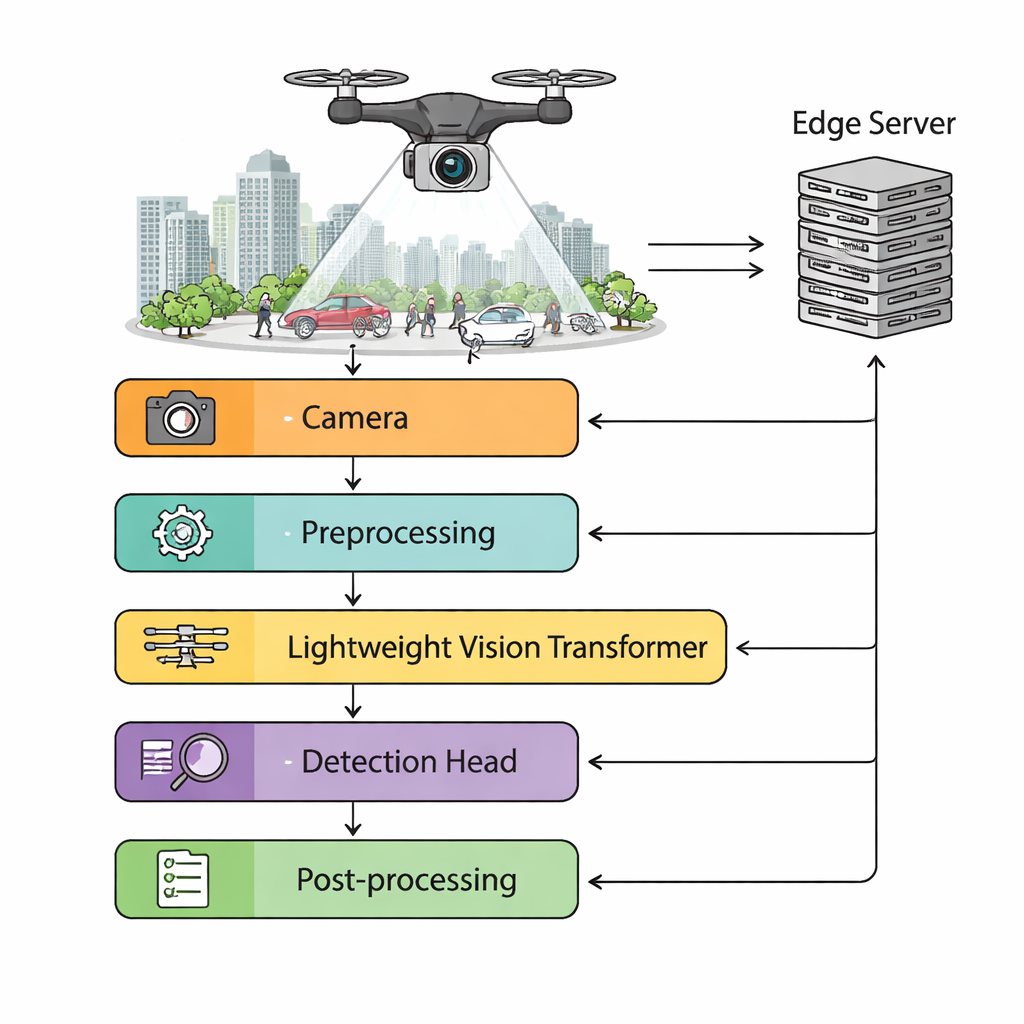

Proponowane rozwiązanie dzieli zadania między dron a komputer edge zlokalizowany na ziemi. Kamera drona przesyła strumień wideo w wysokiej rozdzielczości do modułu wstępnego przetwarzania na pokładzie, który stabilizuje chwiejący się obraz, reguluje jasność i dynamicznie zmienia rozmiar obrazów w zależności od dostępnej mocy obliczeniowej. Lekki vision transformer wyodrębnia następnie bogate cechy z każdej klatki, przekazując je do głowicy detekcyjnej, która przewiduje położenie i klasę obiektów. Harmonogram monitoruje opóźnienia sieci bezprzewodowej, poziom baterii i obciążenie przetwarzania. Gdy łącze z ziemią jest szybkie i stabilne, cięższe zadania — takie jak przetwarzanie partii klatek czy uruchamianie dodatkowych modeli poprawiających dokładność — mogą być przesyłane do serwera edge. Gdy połączenie się pogarsza, system automatycznie przełącza się na w pełni autonomiczne przetwarzanie na pokładzie, dzięki czemu dron nigdy nie musi „latać na ślepo”.

Przycinanie modelu bez utraty wzroku

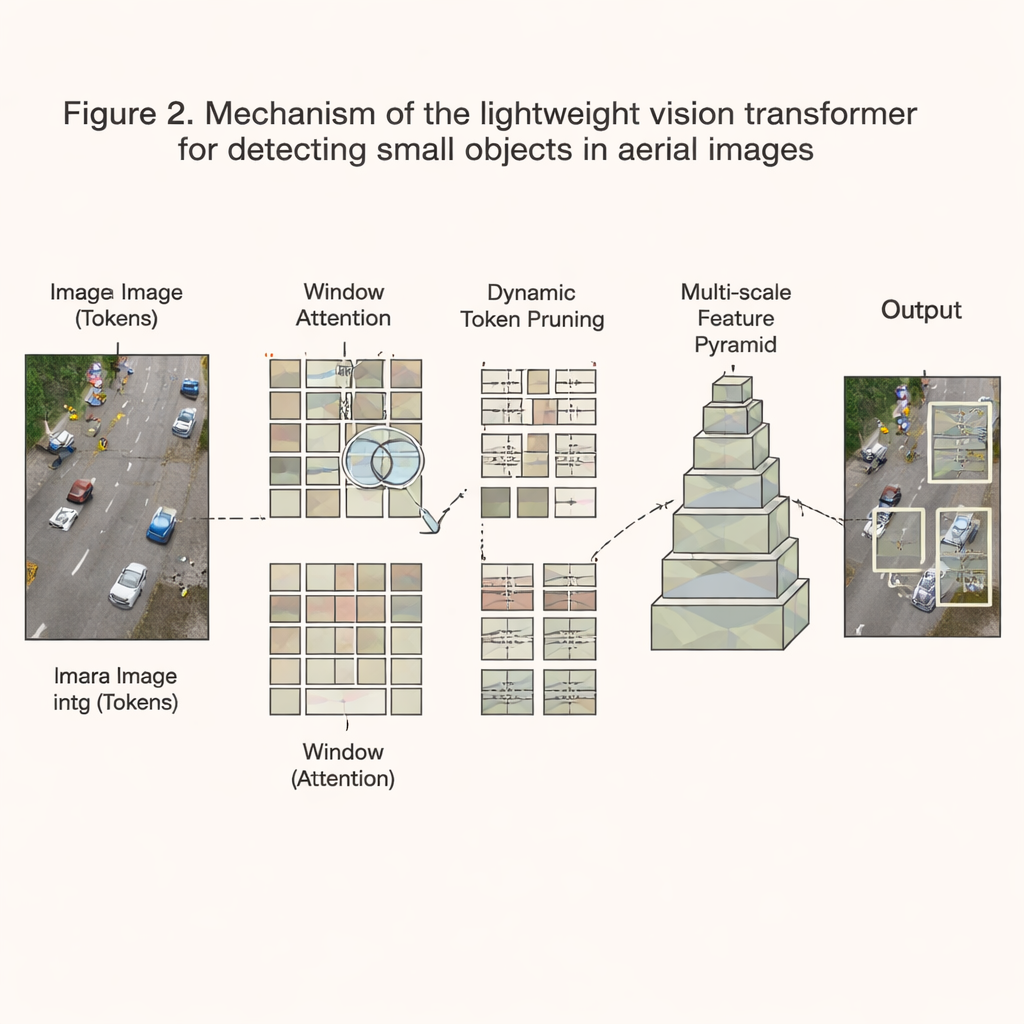

Aby transformer był wystarczająco mały i szybki, autorzy przeprojektowali jego wewnętrzne działanie. Zamiast pozwalać każdej części obrazu porównywać się ze wszystkimi innymi — procesu, który rośnie gwałtownie wraz z rozdzielczością — ograniczają uwagę do lokalnych okien przesuwających się po obrazie, co obniża koszt obliczeniowy do bardziej przystępnych poziomów. Dodatkowo dynamiczny schemat przycinania na bieżąco ocenia, które regiony obrazu zawierają użyteczne informacje, a które są głównie pustym tłem. Tokeny ocenione jako niemające znaczenia są odrzucane wcześnie, oszczędzając czas i pamięć, podczas gdy złożone, zatłoczone sceny zachowują więcej szczegółów. Model buduje też wieloskalową piramidę cech, dzięki czemu zarówno mali piesi, jak i większe pojazdy mogą być wykrywane w tej samej klatce. W połączeniu z ostrożną kwantyzacją (używaniem mniejszej liczby bitów na liczbę), przycinaniem kanałów i optymalizacjami programowymi niskiego poziomu, zmiany te zmniejszają wymagane obliczenia o około dwie trzecie, zachowując ponad 94% pierwotnej dokładności.

Testy systemu

Zespół ocenia swój projekt na dużym zbiorze danych lotniczych złożonym z publicznych benchmarków dronów oraz kilku tysięcy świeżo zebranych zdjęć nad miastami, przedmieściami i terenami wiejskimi w różnych porach roku i warunkach oświetleniowych. Na popularnym komputerze wbudowanym używanym w dronach, NVIDIA Jetson Xavier NX, ich system działa z prędkością około 39 klatek na sekundę — wystarczająco szybko do pracy w czasie rzeczywistym — jednocześnie osiągając wyższą dokładność niż powszechnie stosowane lekkie detektory, takie jak warianty YOLO. W szczególności system jest znacząco lepszy w wykrywaniu małych obiektów, z około siedmiopunktową poprawą średniej precyzji w porównaniu z konwencjonalnymi sieciami konwolucyjnymi. Tygodniowe testy polowe na komercyjnej platformie dronowej pokazują, że system utrzymuje wydajność mimo drgań kamery, zmiennego oświetlenia i fluktuującego połączenia bezprzewodowego oraz że potrafi płynnie przełączać się między trybem wspomaganym przez edge a w pełni pokładowym podczas rzeczywistych lotów.

Co to oznacza dla misji dronów w świecie rzeczywistym

Mówiąc prosto, praca ta pokazuje, że możliwe jest wyposażenie dronów w ostrzejsze i bardziej niezawodne „widzenie” bez przytwierdzania do nich komputera klasy centrum danych. Poprzez przeprojektowanie vision transformera tak, by był szczupły, selektywne skupianie się na najbardziej informatywnych częściach obrazu oraz współpracę drona z pobliskim serwerem edge, autorzy dostarczają detektor, który widzi więcej, mniej przeoczeń i jednocześnie działa w czasie rzeczywistym w ramach ścisłych ograniczeń mocy i pamięci. To sprawia, że zadania takie jak poszukiwania i ratownictwo, ocena szkód po katastrofach czy inspekcja infrastruktury są bezpieczniejsze i skuteczniejsze, ponieważ drony lepiej wychwytują małe, krytyczne szczegóły — na przykład osamotnioną osobę lub uszkodzony kabel — dokładnie wtedy, gdy każda sekunda ma znaczenie.

Cytowanie: Zhu, W., Chen, K. Real-time object detection for unmanned aerial vehicles based on vision transformer and edge computing. Sci Rep 16, 6814 (2026). https://doi.org/10.1038/s41598-026-37938-5

Słowa kluczowe: drony, detekcja obiektów, edge computing, vision transformer, obrazowanie w czasie rzeczywistym