Clear Sky Science · pl

Adaptacyjne ramy uczenia przez wzmacnianie do optymalizacji zrównoważonych mikrosieci w suchych środowiskach miejskich

Utrzymanie zasilania w mieście na pustyni

Wyobraź sobie zarządzanie współczesnym miastem, w którym letnie dni regularnie przekraczają 40°C, klimatyzatory pracują bez przerwy, a linie energetyczne ledwo nadążają. Tak wygląda codzienność w miejscach takich jak Rijad w Arabii Saudyjskiej. W artykule tym badano, jak nowy rodzaj inteligentnego systemu sterowania, inspirowanego sposobem, w jaki komputery uczą się grać w złożone gry wideo, może koordynować panele fotowoltaiczne, turbiny wiatrowe, baterie, generatory diesla i sieć główną, aby zasilać takie miasto taniej i z mniejszym zanieczyszczeniem.

Dlaczego małe sieci energetyczne mają znaczenie

Zamiast opierać się wyłącznie na wielkich elektrowniach daleko stąd, wiele miast zwraca się ku „mikrosieciom” — małym, lokalnym sieciom łączącym różne źródła energii, które mogą nawet wymieniać się mocą z sąsiadami. W gorących, suchych regionach ma to szczególne znaczenie: zapotrzebowanie na chłodzenie gwałtownie wzrasta i spada wraz z pogodą, energia słoneczna pojawia się w impulsywnych porcjach w ciągu dnia, a wiatr bywa słaby lub nieprzewidywalny. Tradycyjne systemy sterowania zwykle działają według stałych reguł lub harmonogramów. Słabo reagują na nagłe zmiany, jak skok użycia klimatyzacji czy zapylenie osłabiające nasłonecznienie. W efekcie marnuje się czysta energia, częściej uruchamiane są generatory diesla i rosną rachunki.

Mózg uczący się dla systemu energetycznego

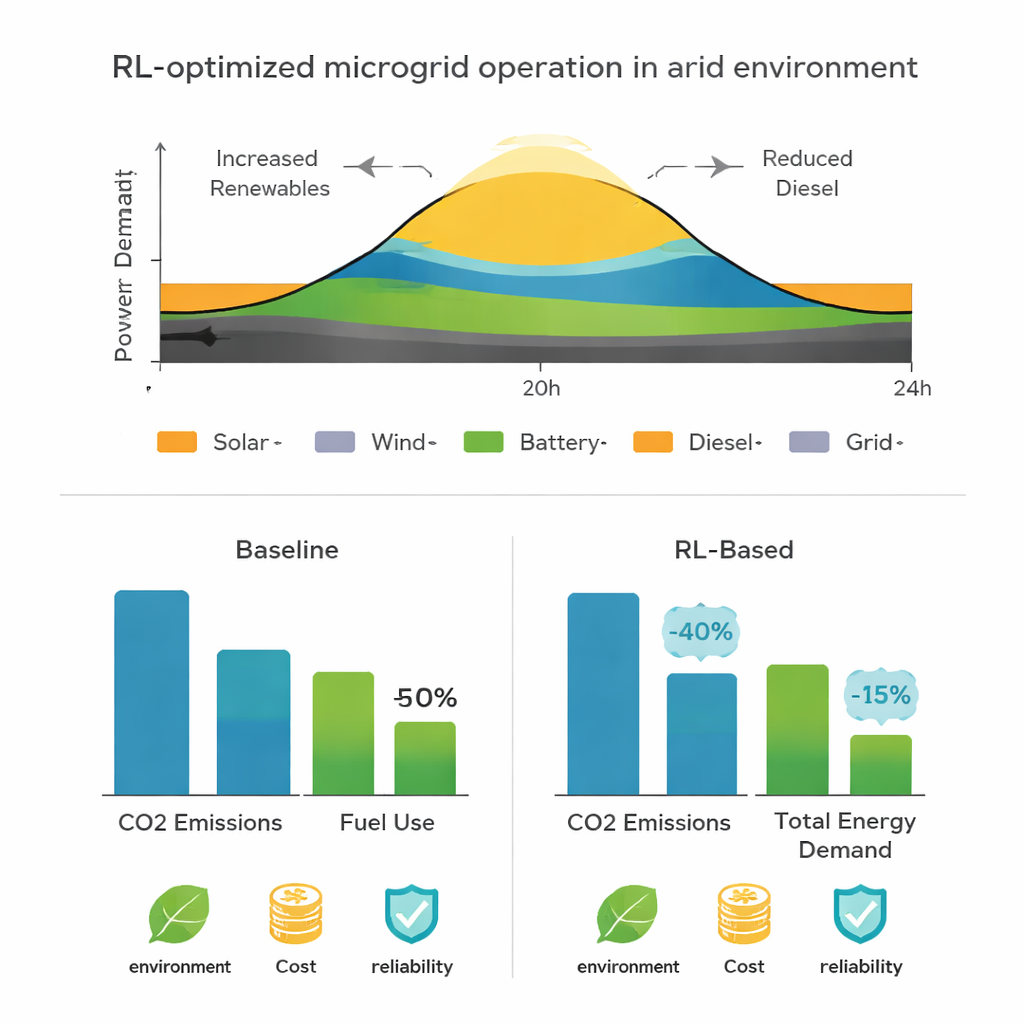

Naukowcy zbudowali szczegółowy model komputerowy pięciu połączonych mikrosieci reprezentujących typowe budynki i dzielnice Rijadu — duże i małe domy, bloki wielofunkcyjne oraz obszary komercyjne. Każda mikrosieć miała własny zestaw paneli słonecznych, małych turbin wiatrowych, rezerwowe jednostki diesla i magazyny baterii, a także łącze z szerszą siecią elektroenergetyczną. Przy użyciu oprogramowania do symulacji energetyki budynków (EnergyPlus) wygenerowano godzinowe dane na cały rok: zużycie energii, temperaturę, nasłonecznienie i prędkość wiatru. Na to nałożono agenta uczenia przez wzmacnianie — program, który obserwuje stan systemu (popyt, poziom naładowania baterii, dostępne słońce i wiatr, status generatorów) i decyduje, co zrobić dalej: ładować lub rozładowywać baterie, włączać lub wyłączać generatory diesla, importować lub eksportować moc oraz dzielić się energią między mikrosieciami.

Jak system uczy się lepszych decyzji

Uczenie przez wzmacnianie działa metodą prób i błędów. W symulacji agent próbuje różnych działań sterujących z godziny na godzinę i otrzymuje nagrodę lub karę w zależności od efektów. Funkcja nagrody łączy trzy proste cele: niskie koszty, utrzymanie zasilania i unikanie marnowania energii odnawialnej. Jeśli jego decyzje prowadzą do kosztownego użycia diesla, braków mocy lub niewykorzystanej energii słonecznej, agent jest karany. Gdy zaspokaja popyt przy większym udziale słońca i wiatru, niższych emisjach i stabilnej pracy, otrzymuje nagrodę. W ciągu wielu tysięcy rund treningowych agent stopniowo odkrywa strategie równoważące te cele. Po wytrenowaniu potrafi podejmować decyzje w czasie rzeczywistym w zaledwie kilka tysięcznych sekundy.

Co się dzieje, gdy pustynia się sprzeciwi

Aby sprawdzić, czy podejście to rzeczywiście pomaga w surowym klimacie, zespół przetestował je w realistycznych i stresujących warunkach. Model odtworzył sezonowe wahania Rijadu, z intensywnym chłodzeniem latem i łagodniejszym obciążeniem zimą. Sterownik oparty na uczeniu dobrze odwzorowywał zarówno godzinowe, jak i roczne zużycie energii (wyjaśniając około 90–94% zmienności), co jest kluczowe do przewidywania szczytów. Zmniejszył straty energii w typowym dniu i przesunął większą część podaży na słońce i wiatr, używając baterii do wygładzania przerw. Gdy badacze zasymulowali zdarzenia, takie jak burza pyłowa nagle ograniczająca moc słoneczną lub fala upałów gwałtownie zwiększająca popyt, system odpowiadał rozładowaniem baterii, koordynacją użycia diesla i wymianą nadmiaru energii między mikrosieciami — wszystko bez odcinania użytkowników.

Czystsze powietrze i niższe rachunki

Ponad utrzymaniem zasilania, badanie oceniło wpływ środowiskowy przy użyciu oceny cyklu życia skoncentrowanej na codziennej eksploatacji. W porównaniu z tradycyjnym systemem opartym na regułach, adaptacyjny system zmniejszył emisje dwutlenku węgla o około 14%, zredukował emisje tworzące kwaśne opady o około 14% i obniżył całkowite zużycie energii o około 10%. Te korzyści wynikają głównie z rzadszego uruchamiania generatorów diesla oraz lepszego wykorzystania lokalnej energii odnawialnej i magazynów. Mówiąc prościej: wyposażenie mikrosieci w „uczący się mózg” pozwoliło wydobyć więcej użytecznej pracy z każdej jednostki czystej energii, polegać mniej na paliwie i zachować niezawodność nawet przy kaprysach pustynnego klimatu.

Cytowanie: Mohamed, M.A.S., Almazam, K., Alzahrani, M. et al. Adaptive reinforcement learning framework for sustainable microgrid optimization in arid urban environments. Sci Rep 16, 7356 (2026). https://doi.org/10.1038/s41598-026-37752-z

Słowa kluczowe: mikrosieci, uczenie przez wzmacnianie, energia odnawialna, zarządzanie energią, miasta na obszarach suchych