Clear Sky Science · pl

Autonomiczne planowanie trajektorii do międzyżebrowego robotycznego obrazowania ultrasonograficznego przy użyciu uczenia ze wzmocnieniem

Roboty pomagające lekarzom zobaczyć przez żebra

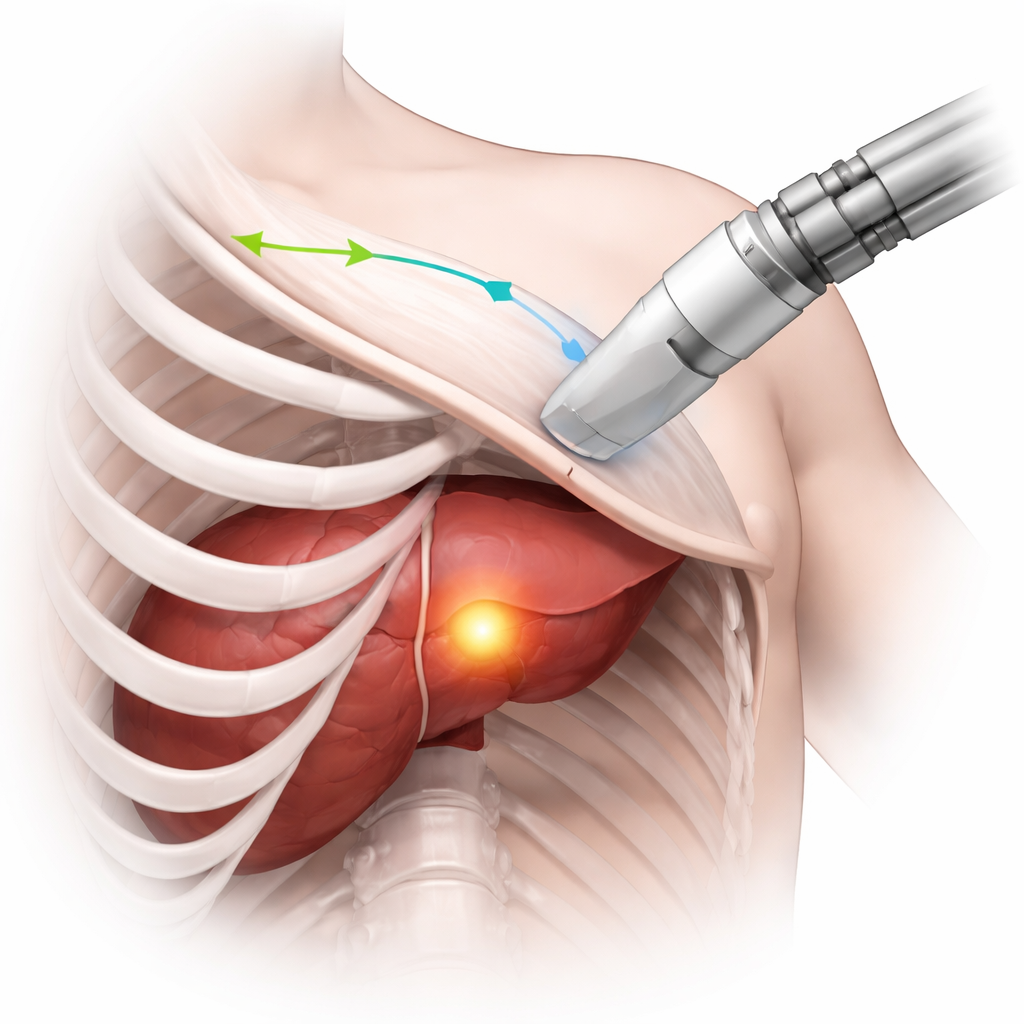

Kiedy lekarze używają ultradźwięków do monitorowania narządów takich jak wątroba czy serce, żebra często przeszkadzają, rzucając ciemne cienie, które zasłaniają istotne szczegóły. Uzyskanie wyraźnego obrazu zależy w dużej mierze od umiejętności i doświadczenia osoby trzymającej głowicę. W tej pracy badacze badają, jak robot sterowany sztuczną inteligencją może automatycznie zaplanować trasę skanowania między żebrami, tak aby guzy i inne cele były widoczne jasno i konsekwentnie, niezależnie od operatora urządzenia.

Dlaczego widzenie między żebrami jest takie trudne

Ultrasonografia jest popularna, ponieważ jest bezpieczna, względnie tania i dostarcza obrazów w czasie rzeczywistym. Jednak aby zobrazować narządy schowane za klatką piersiową, głowicę trzeba precyzyjnie poprowadzić przez wąskie przestrzenie między żebrami. Jeśli fale dźwiękowe trafią w kość, zostają zablokowane, tworząc duże czarne obszary na obrazie, gdzie nic nie widać. Operatorzy ludzie uczą się, poprzez szkolenie i doświadczenie, jak ustawić i poruszać głowicą, aby unikać tych cieni, jednocześnie utrzymując pole zainteresowania w kadrze. Jest to szczególnie istotne w procedurach takich jak ablacja guzów wątroby, gdzie chirurgowie muszą wielokrotnie sprawdzać, czy cały guz został poddany zabiegowi. Wyzwanie polega na przekształceniu tej delikatnej, trójwymiarowej umiejętności w działanie, które robot będzie mógł wykonać samodzielnie.

Nauka robota na wirtualnych pacjentach

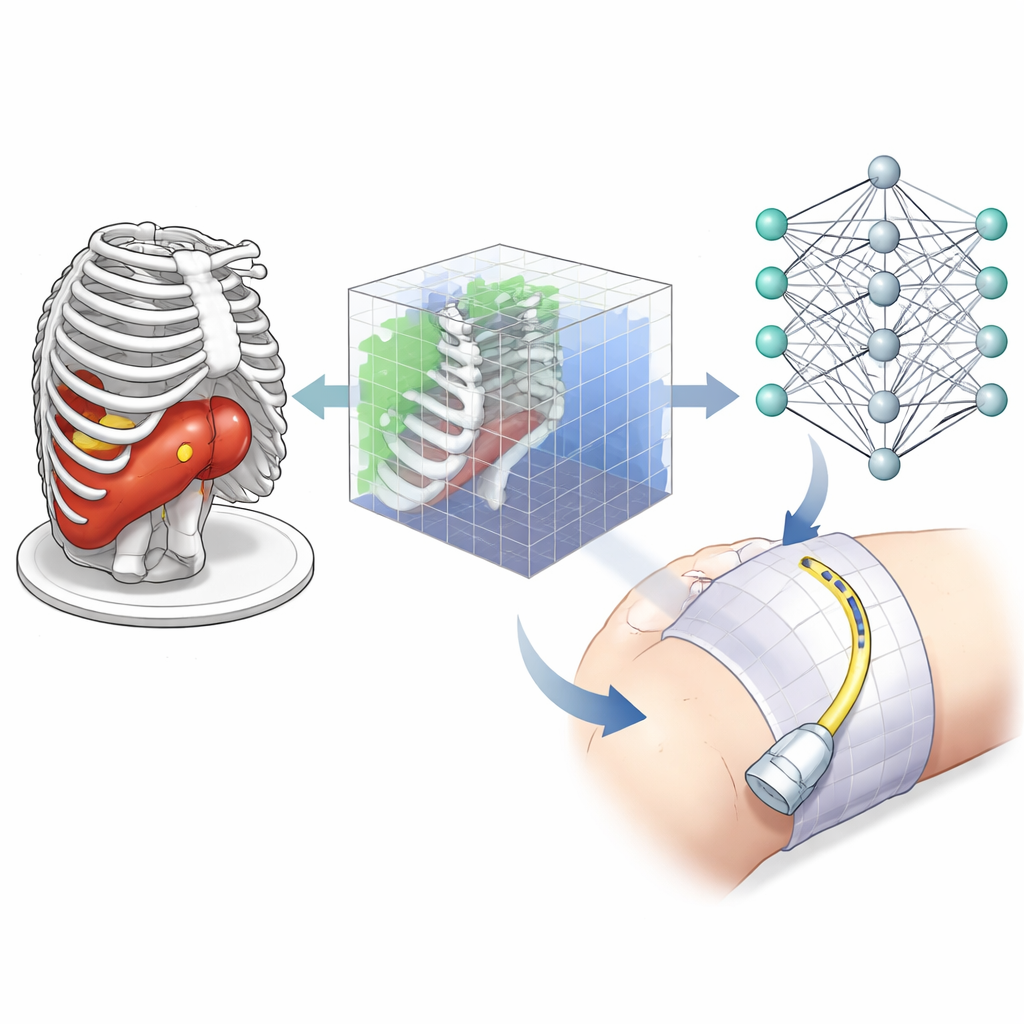

Zamiast uczyć się bezpośrednio na hałaśliwych i zmiennych obrazach ultrasonograficznych, badacze stworzyli wirtualne pole treningowe wykorzystujące badania tomografii komputerowej (TK). TK daje wyraźną trójwymiarową mapę kości, skóry i wątroby, a guzy można dodać w różnych kształtach i pozycjach, tworząc wiele realistycznych scenariuszy. W tym symulatorze wirtualna głowica ultradźwiękowa przesuwa się po powierzchni skóry nad żebrami, a ścieżki wiązek ultradźwiękowych modelowane są jako promienie, które przechodzą przez tkanki miękkie, lecz są blokowane przez kość. Ten prosty, lecz realistyczny model informuje system, które części guza są widoczne, jak bardzo sygnał osłabia się w trakcie przejścia oraz gdzie pojawiają się cienie.

Jak system uczący decyduje, gdzie skanować

Zespół zastosował formę sztucznej inteligencji zwaną uczeniem ze wzmocnieniem, w którym „agent” uczy się metodą prób i błędów wybierać działania prowadzące do wyższych nagród. Na każdym kroku agent widzi skompaktowaną trójwymiarową reprezentację sceny wokół guza: które małe elementy objętości zawierają guz, które zawierają kość oraz które są przecięte przez symulowane promienie ultradźwiękowe. Może on przesunąć lub przechylić wirtualną głowicę o niewielkie przyrosty albo przełączać się między trybem „eksploracji” a trybem „nagrywania” używanym do budowy końcowego widoku 3D. Otrzymywana nagroda łączy trzy cele: pokrycie jak największej części objętości celu, utrzymanie głowicy na tyle blisko, by zmniejszyć utratę sygnału, oraz unikanie obszarów, gdzie promienie są blokowane przez kości, co tworzyłoby bezużyteczne zacienione obrazy.

Testy metody

Aby sprawdzić, czy wyuczona strategia uogólnia się poza przykłady treningowe, badacze przetestowali ją na nowych skanach TK i nowych kształtach guzów, których agent nigdy wcześniej nie widział. W tych próbach plan skanowania uznawano za udany, jeśli co najmniej 95% objętości celu zostało zobrazowane w ograniczonej liczbie kroków. Dla małych, średnich i dużych celów system osiągał wskaźniki sukcesu sięgające 95%, przy jednoczesnym zachowaniu wysokiego odsetka widoków bez cieni i rozsądnych odległości między głowicą a guzem. Metoda sprawdzała się także przy kilku celach do pokrycia, na przykład przy pozostałościach guzów rozsianych w wątrobie, chociaż wydajność naturalnie nieco spadała wraz ze wzrostem złożoności zadania.

Od symulacji do sali operacyjnej

Na razie praca koncentruje się na planowaniu trasy, a nie na fizycznym poruszaniu prawdziwym robotem. Trasy generowane są na podstawie skanów TK specyficznych dla pacjenta lub na uniwersalnych „atlasach” TK, które później można dopasować do anatomii konkretnej osoby przy użyciu istniejących technik rejestracji. W przyszłości moduł planowania ma być połączony ze sterowaniem robotycznym, kompensacją ruchu związanego z oddychaniem oraz bardziej realistyczną symulacją obrazów ultradźwiękowych. Dla laika najważniejszy wniosek jest taki, że podejście to może uczynić monitoring ultrasonograficzny podczas zabiegów, takich jak leczenie guzów wątroby, bardziej wiarygodnym i mniej zależnym od doświadczenia operatora — pozwalając robotowi znaleźć inteligentne, pozbawione cieni trasy między żebrami, które utrzymają cały cel w polu widzenia.

Cytowanie: Bi, Y., Qian, C., Zhang, Z. et al. Autonomous path planning for intercostal robotic ultrasound imaging using reinforcement learning. Sci Rep 16, 6356 (2026). https://doi.org/10.1038/s41598-026-37702-9

Słowa kluczowe: robotyczne USG, uczenie ze wzmocnieniem, obrazowanie guza wątroby, skanowanie międzyżebrowe, robotyka medyczna