Clear Sky Science · pl

Wyjaśnialna struktura głębokiego uczenia do wykrywania chorób roślin przy użyciu kilku przykładów dla ryżu i trzciny cukrowej z ekstrakcją cech opartą na CNN

Dlaczego wykrywanie chorych liści ma znaczenie

Ryż i trzcina cukrowa żywią miliardy ludzi i wspierają wiele społeczności rolniczych. Gdy ich liście padają ofiarą chorób, plony mogą się zmniejszyć, ceny żywności wzrosnąć, a rolnicy stracić środki do życia. Wczesne rozpoznanie jest jednak trudne: problemy często zaczynają się od małych plamek lub zmian zabarwienia, które zapracowani rolnicy mogą przeoczyć, a eksperci nie zawsze są w pobliżu. W tym badaniu przedstawiono system komputerowy, który potrafi nauczyć się na podstawie zaledwie kilku zdjęć liści, automatycznie wskazywać choroby i nawet pokazywać użytkownikom dokładnie, co na obrazie doprowadziło do diagnozy, pomagając rolnikom działać szybciej i z większą pewnością.

Inteligentne oko dla pola

Naukowcy koncentrują się na dwóch podstawowych uprawach: ryżu i trzciny cukrowej. Wykorzystują dwie publiczne kolekcje obrazów liści, z których jedna została zrobiona w rzeczywistych polach trzciny cukrowej przy użyciu różnych smartfonów, a mniejsza, bardziej kontrolowana — to zbiór zdjęć liści ryżu. Każde zdjęcie przedstawia liść zdrowy lub z konkretną chorobą, taką jak brązowe plamy, rdzawo zabarwione pęcherzyki czy żółte smugi. Budując na tych udostępnionych zestawach danych zamiast prywatnych zbiorów, zespół dąży do metod, które inne grupy będą mogły przetestować, ponownie wykorzystać i ostatecznie wdrożyć w narzędziach polowych — od aplikacji mobilnych po połączone czujniki w inteligentnych gospodarstwach.

Nauczanie maszyn przy bardzo niewielu przykładach

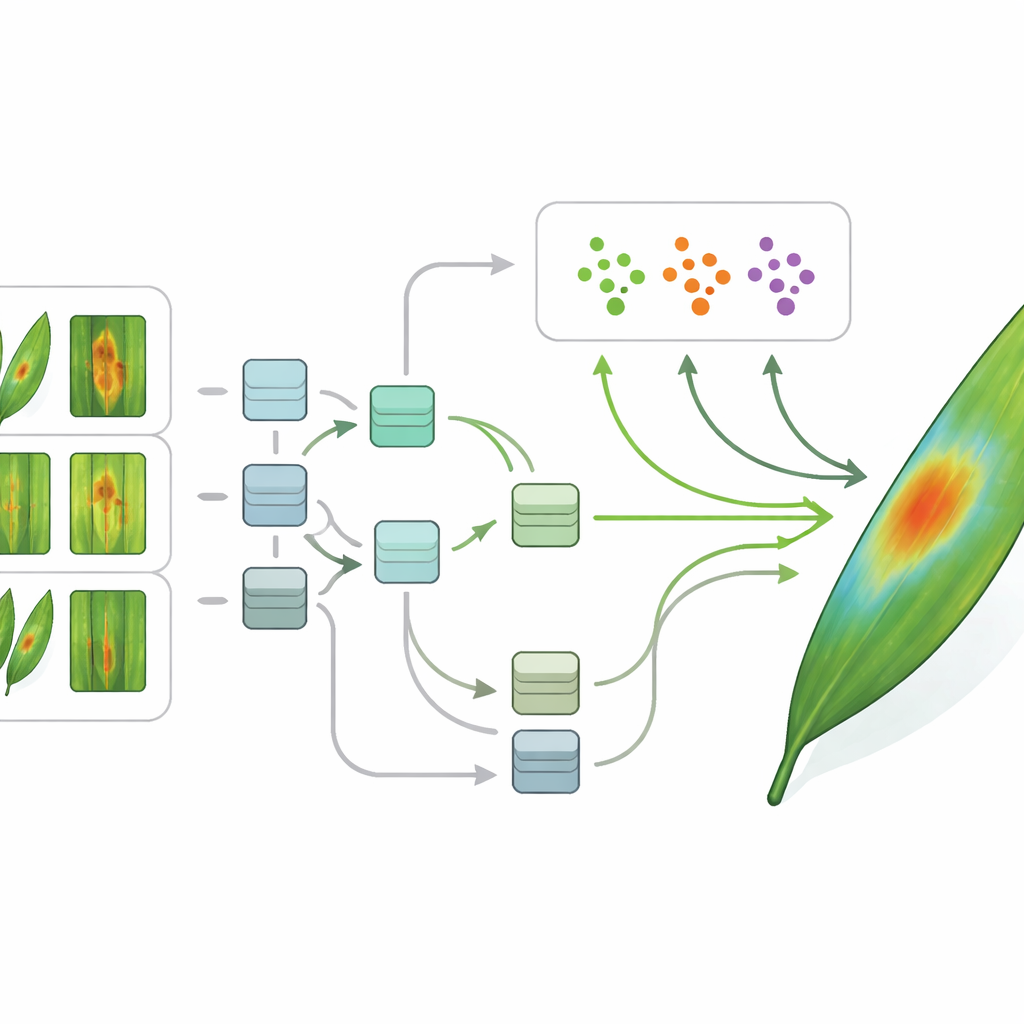

Nowoczesna sztuczna inteligencja może być niezwykle skuteczna w rozpoznawaniu chorób roślin, ale zwykle wymaga tysięcy oznaczonych zdjęć dla każdej klasy — co jest dużym wyzwaniem w rolnictwie, zwłaszcza przy nowych lub rzadkich ogniskach chorób. Aby obejść tę przeszkodę, autorzy sięgają po uczenie „few-shot”, rodzinę technik zaprojektowanych do nauki na zaledwie kilku przykładach. Ich struktura zaczyna się od standardowych kroków przetwarzania obrazu: czyszczenia, zmiany rozmiaru i normalizacji każdego zdjęcia, aby komputer widział spójny obraz. Typ modelu głębokiego uczenia nazywany splotową siecią neuronową (CNN) zamienia następnie każde zdjęcie liścia w zwarty zestaw numerycznych cech, które uchwycają kształty, kolory i tekstury istotne dla choroby.

Uczynienie diagnozy zrozumiałą

Na bazie tych cech zespół trenuje dwie zaawansowane metody few-shot zwane Prototypical Networks i Model-Agnostic Meta-Learning. Jedna z nich uczy się swego rodzaju „centrum” dla każdej choroby w przestrzeni cech i przypisuje nowe liście do najbliższego centrum; druga uczy się szybciej adaptować do nowych zadań przy użyciu zaledwie kilku kroków treningowych. Co istotne, autorzy łączą te metody z narzędziami wyjaśnialnej AI. Korzystając z technik w stylu map ciepła, system potrafi wyróżnić, które części obrazu liścia najbardziej wpłynęły na decyzję — skupisko ciemnych plam, żółta smuga wzdłuż nerwu głównego lub brak widocznych zmian w zdrowej roślinie. To sprawia, że rozumowanie modelu staje się widoczne, co pozwala agronomom sprawdzić, czy komputer skupia się na medycznie istotnych sygnałach, a nie na bałaganie w tle.

Jak dobrze działa system

Aby ocenić, czy ich podejście jest naprawdę użyteczne, badacze porównali je z kilkoma dobrze znanymi modelami głębokiego uczenia stosowanymi do wykrywania chorób roślin. Podzielili każdy zbiór danych na część treningową i testową i mierzyli, jak często każda metoda poprawnie identyfikuje typ choroby. Na liściach trzciny cukrowej zrobionych w polu nowa struktura osiąga około 92 procent poprawnych klasyfikacji, przewyższając standardowe architektury takie jak VGG, ResNet, Xception i EfficientNet. W zbiorze dla ryżu radzi sobie jeszcze lepiej, poprawnie identyfikując około 98 procent obrazów testowych. Narzędzia statystyczne analizujące równowagę między fałszywymi alarmami a przypadkami pominiętymi pokazują, że nowa metoda zachowuje się jak doskonały przesiew lekarski, a nie losowy strzelec.

Co to oznacza dla rolników

Mówiąc wprost, badanie pokazuje, że komputer może nauczyć się dokładnie rozpoznawać wiele chorób ryżu i trzciny cukrowej na podstawie zaledwie niewielkiej liczby przykładowych zdjęć, a także wskazać konkretne plamy i smugi na liściu, które przesądziły o wyroku. To połączenie efektywności danych i przejrzystości jest kluczowe dla zastosowań w praktyce: obniża barierę tworzenia narzędzi dla nowych upraw i powstających chorób oraz dostarcza rolnikom i ekspertom wizualnych dowodów, którym mogą zaufać. Po dodatkowych testach w rzeczywistych polach i przy przyjaźniejszych interfejsach użytkownika, takie wyjaśnialne systemy few-shot mogą stać się codziennymi partnerami w inteligentnym rolnictwie, pomagając chronić plony przy jednoczesnym ograniczaniu niepotrzebnego stosowania pestycydów.

Cytowanie: El-Behery, H., Attia, AF. & Rezk, N.G. An explainable deep learning framework for few shot crop disease detection in rice and sugarcane using CNN based feature extraction. Sci Rep 16, 8272 (2026). https://doi.org/10.1038/s41598-026-37501-2

Słowa kluczowe: wykrywanie chorób upraw, ryż i trzcina cukrowa, głębokie uczenie, wyjaśnialna AI, inteligentne rolnictwo