Clear Sky Science · pl

Nowe podejście oparte na uczeniu ze wzmocnieniem do krótkoterminowego prognozowania obciążenia i cen na rynkach energii

Dlaczego warto przewidywać zapotrzebowanie na energię na jutro

Za każdym razem, gdy włączasz światło, rozległa sieć elektrowni, rynków i komputerów działa w tle, by utrzymać dostępność energii i jej przystępne ceny. Jeśli operatorzy sieci potrafią dokładnie przewidzieć, ile energii ludzie zużyją i jak zmienią się ceny w ciągu najbliższych godzin, mogą uniknąć blackoutów, zmniejszyć marnotrawstwo i oszczędzić pieniądze dla wszystkich. Ten artykuł przedstawia nowe podejście do tworzenia takich krótkoterminowych prognoz, wykorzystujące techniki pierwotnie opracowane do uczenia grania w gry i sterowania robotami.

Inteligentniejsze prognozy dla zmieniającego się świata energetycznego

Popyt na energię elektryczną i ceny mogą wahać się gwałtownie z godziny na godzinę. Fale upałów, ochłodzenia, święta i koszty paliw wypychają system w różnych kierunkach. Tradycyjne narzędzia prognostyczne, takie jak proste linie trendu czy nawet standardowe modele uczenia maszynowego, często traktują problem jako jednorazowe dopasowanie do danych historycznych. Mają trudności, gdy warunki szybko się zmieniają lub gdy wiele czynników wchodzi ze sobą w złożone interakcje. Autorzy argumentują, że nowoczesne sieci energetyczne, szczególnie te z rosnącym udziałem odnawialnych źródeł, potrzebują narzędzi prognostycznych, które potrafią adaptować się w locie i uczyć bezpośrednio na podstawie swoich sukcesów i błędów.

Agent uczący się na rynku energii

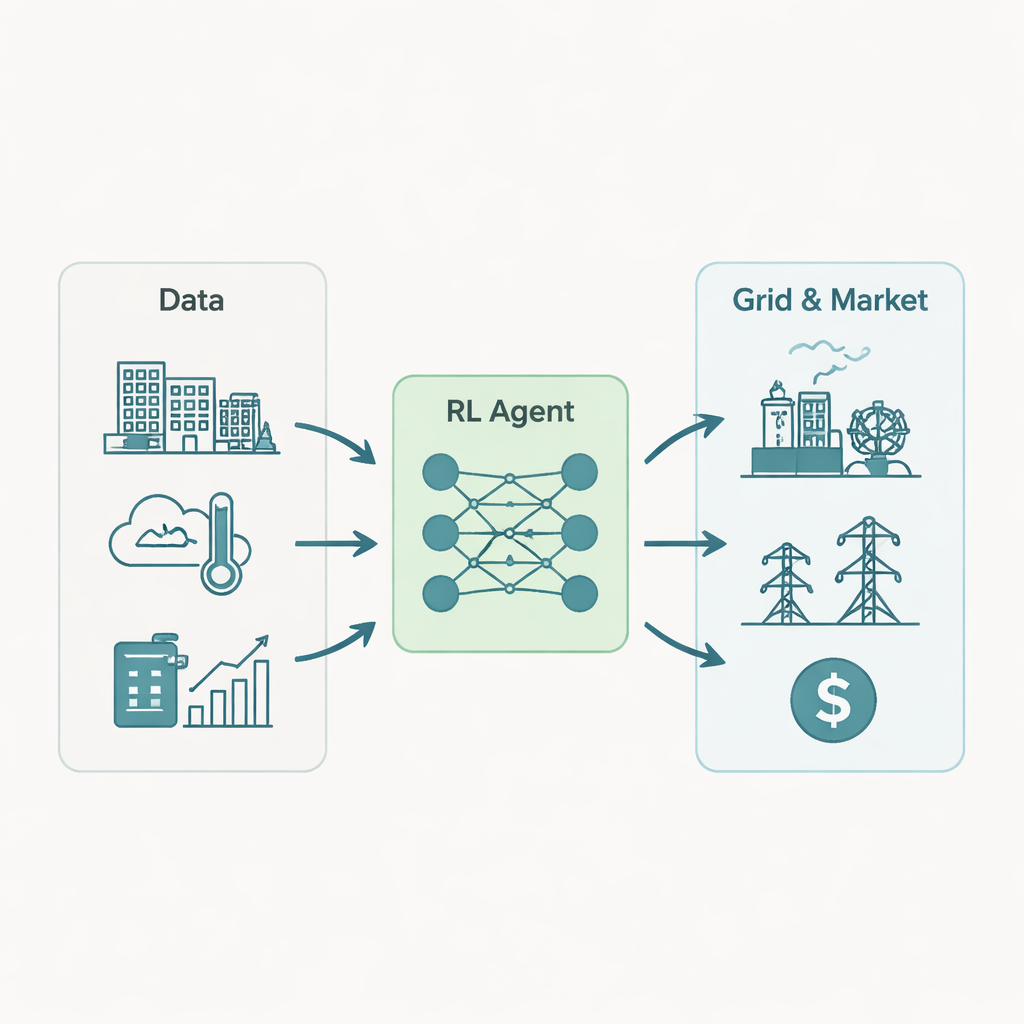

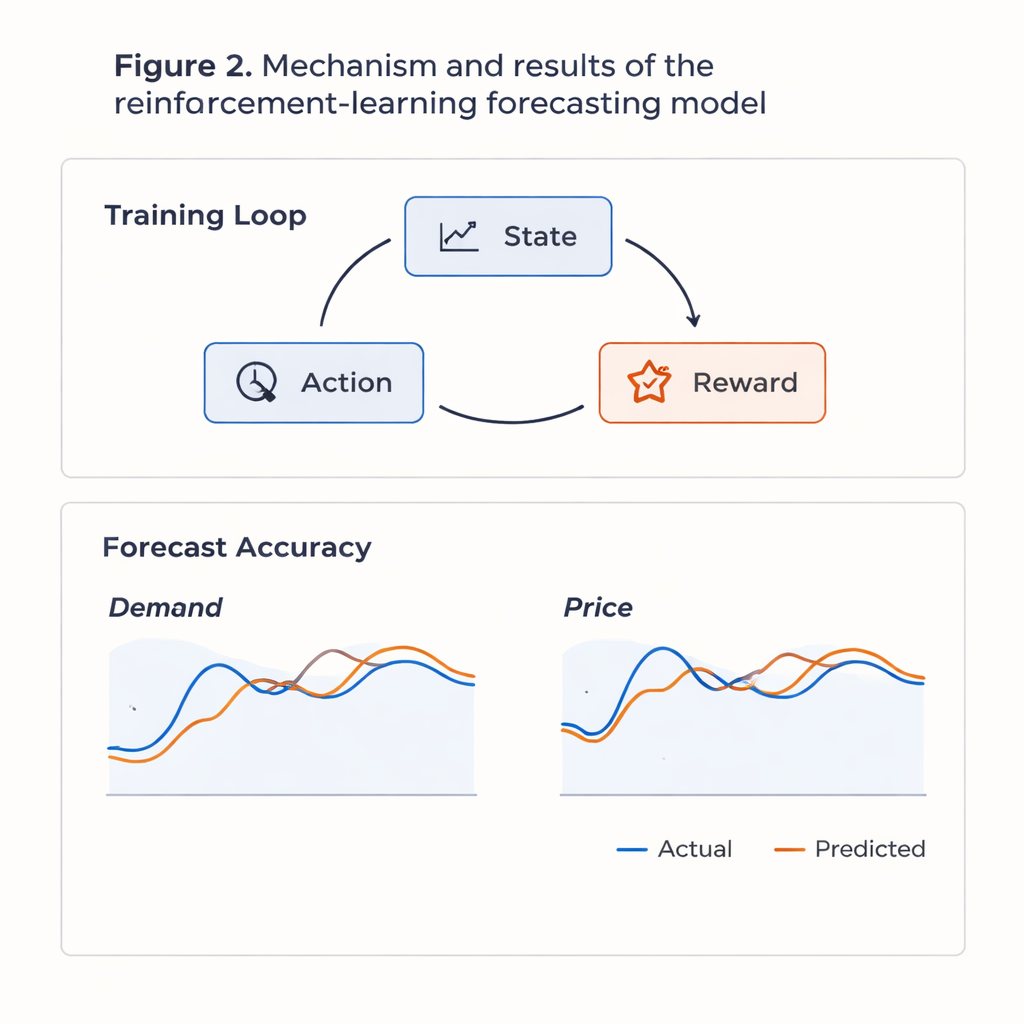

Naukowcy przeformułowali problem prognozowania jako grę decyzyjną. Co godzinę komputerowy „agent” widzi aktualną sytuację: ostatnie zapotrzebowanie na energię, przeszłe ceny, temperaturę, wilgotność, dzień tygodnia, święta i koszty paliw. Następnie wybiera działanie: najlepsze przewidywanie zapotrzebowania i ceny energii na następną godzinę. Gdy pojawią się rzeczywiste wartości, agent otrzymuje ocenę zależną od tego, jak bardzo się pomylił — duże błędy są karane, małe nagradzane. Z czasem system poszukuje strategii maksymalizującej długoterminową ocenę, a nie tylko dokładność pojedynczego kroku. Aby poradzić sobie z wieloma wejściami, autorzy zastosowali głębokie uczenie ze wzmocnieniem oparte na Deep Q-Network, rodzaju sieci neuronowej szacującej, jak dobre są poszczególne działania w danej sytuacji.

Od surowych danych do wiarygodnych prognoz

Aby przetestować swoje podejście, zespół sięgnął po dane z rzeczywistego rynku PJM Interconnection, dużego amerykańskiego rynku energii obejmującego części Środkowego Zachodu i Wschodniego Wybrzeża. Wykorzystali około trzech lat godzinnych rekordów (2021–2023), obejmujących ceny rynkowe, zapotrzebowanie na energię, obserwacje pogodowe i indeksy cen paliw. Przed treningiem oczyszczono dane, uzupełniono rzadkie brakujące wartości, usunięto nietypowe odstające obserwacje i przeskalowano wszystko do porównywalnych zakresów. Zastosowano również techniki statystyczne do kompresji dużego zestawu cech wejściowych przy zachowaniu większości użytecznej zmienności. Agent uczący się był następnie trenowany w wielokrotnych przebiegach po tej historii, stopniowo przechodząc od losowych prób i błędów do wykorzystywania odkrytych wzorców.

Jak poradził sobie agent uczący się

W porównaniu z powszechnie stosowanymi metodami prognostycznymi — w tym ARIMA (tradycyjny model szeregów czasowych), sieciami LSTM i popularnym algorytmem XGBoost — system oparty na uczeniu ze wzmocnieniem wyszedł na prowadzenie. Na wyodrębnionych danych testowych, których model nigdy wcześniej nie widział, zmniejszył średnie błędy procentowe w prognozie zapotrzebowania i cen o około 15–20 procent w porównaniu z tymi bazami. Prognozy wiernie odwzorowywały zarówno zimowe, jak i letnie cykle dobowej zmienności oraz ogólne wahania cen, choć model nadal miał kłopoty z najostrzejszymi, rzadkimi skokami cen i nietypowym zachowaniem w okresach świątecznych. Analiza wyuczonej strategii wykazała, że agent pośrednio odkrył ekonomicznie sensowny wzorzec: po zaobserwowaniu bardzo wysokich cen skłaniał się do oczekiwania nieco mniejszego zapotrzebowania w następnym godzinie, naśladując rzeczywiste reakcje popytu bez jawnego informowania go o tym.

Co to oznacza dla codziennego użycia energii

Dla laików kluczowy przekaz jest taki, że podejście oparte na uczeniu może pomóc operatorom sieci prowadzić systemy energetyczne bardziej płynnie i taniej. Dokładniejsze prognozy krótkoterminowe pozwalają wytwórcom i operatorom rynków lepiej planować uruchamianie elektrowni, integrować źródła odnawialne z mniejszą liczbą niespodzianek oraz zmniejszać ryzyko nagłych skoków cen lub niedoborów. Choć metoda jest wymagająca pod względem danych i obliczeń oraz wciąż musi zostać dopracowana pod kątem ekstremalnych zdarzeń, wskazuje na przyszłość, w której rynkami energii kierują adaptacyjne, samodoskonalące się narzędzia uczące się na bieżąco ze zmiennego zachowania konsumentów, pogody i kosztów paliw.

Cytowanie: Wu, Y., Ma, Y. & Aliev, H. A novel reinforcement learning-based approach for short-term load and price forecasting in energy markets. Sci Rep 16, 5141 (2026). https://doi.org/10.1038/s41598-026-37366-5

Słowa kluczowe: prognozowanie inteligentnej sieci, predykcja cen energii elektrycznej, uczenie ze wzmocnieniem, prognozowanie zapotrzebowania na energię, deep Q-network