Clear Sky Science · pl

RiemannInfer: poprawa wnioskowania transformera poprzez geometrię Riemanna

Dlaczego to ma znaczenie dla codziennych użytkowników AI

Nowoczesne chatboty i asystenci AI potrafią rozwiązywać zadania matematyczne, pisać eseje, a nawet wyjaśniać zagadnienia medyczne, jednak wciąż nie do końca rozumiemy, jak dochodzą do swoich wniosków — ani jak sprawić, by rozumowały bardziej niezawodnie. Ten artykuł przedstawia „RiemannInfer”, nowe spojrzenie na wewnętrzne działanie dużych modeli językowych (LLM), traktujące ich aktywność jako ruch po zakrzywionej powierzchni geometrycznej. Ta perspektywa nie tylko daje bardziej intuicyjny obraz sposobu myślenia tych systemów, lecz także przyspiesza i poprawia ich procesy wnioskowania.

Przekształcanie myślenia AI w geometryczną podróż

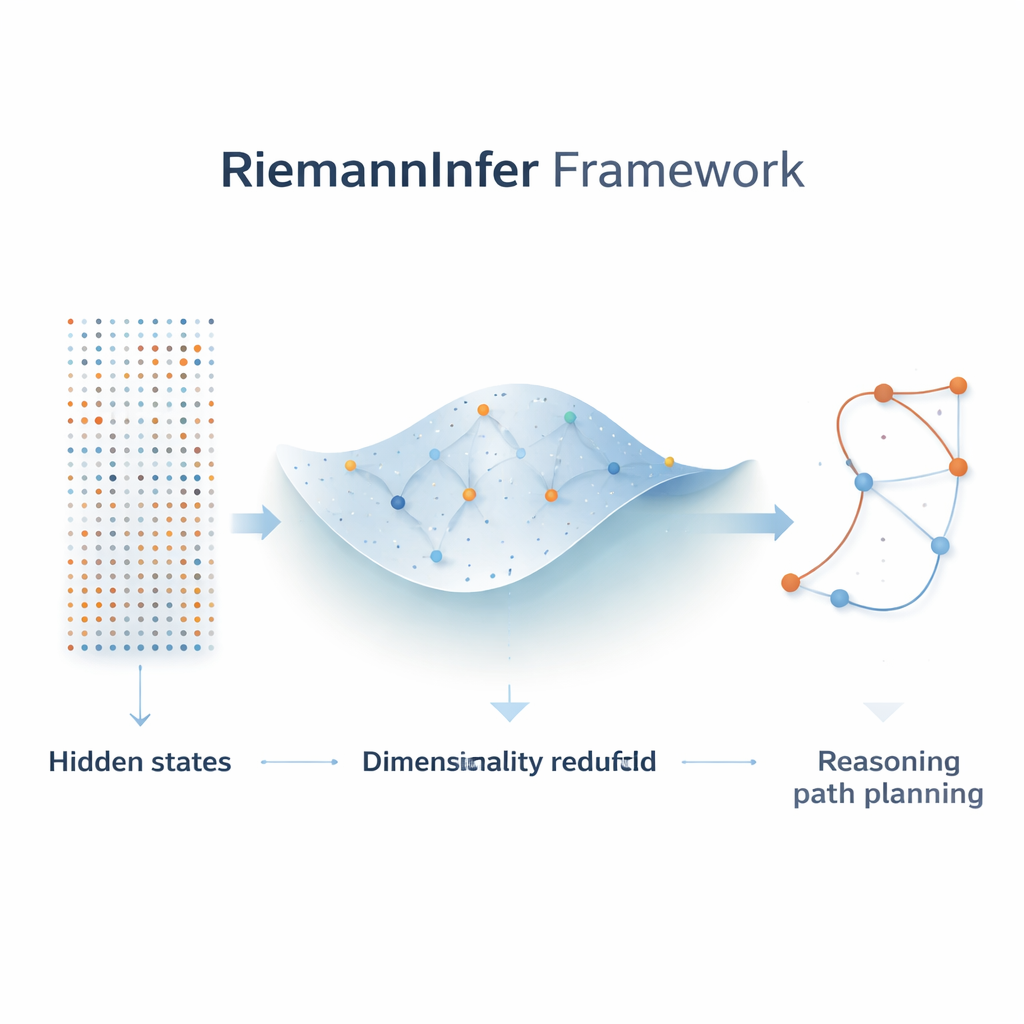

Wewnątrz LLM, takiego jak GPT-4 czy Llama, każde słowo w zdaniu reprezentowane jest przez wektor o wysokiej wymiarowości, a warstwy „uwagi” decydują, jak silnie słowa na siebie wpływają. Autorzy zauważają, że te ukryte stany można traktować jako punkty w rozległej przestrzeni, której ogólny kształt koduje rozumienie języka przez model. Zamiast pojmować rozumowanie jako serię obliczeń prawdopodobieństwa nad tekstem, reinterpretują je jako problem wyznaczania ścieżki: model przemieszcza się od stanu początkowego (pytania) do stanu końcowego (odpowiedzi) wzdłuż trasy w tej przestrzeni. Wykorzystując narzędzia geometrii Riemanna — matematyki zakrzywionych powierzchni — budują zakrzywioną rozmaitość, która uchwyca, jak wzorce uwagi wyginają i rozciągają ten wewnętrzny krajobraz.

Kompresja złożoności bez utraty istoty

Ponieważ surowa przestrzeń wewnętrzna LLM jest ogromna, pierwszym krokiem w RiemannInfer jest jej skurczenie przy jednoczesnym zachowaniu kluczowej struktury. Autorzy łączą techniki z topologii, która bada, jak punkty się łączą, z popularnym algorytmem redukcji wymiarów UMAP. Zanim zmniejszą liczbę wymiarów, analizują „kształt” chmury ukrytych stanów, aby upewnić się, że istotne wzory połączeń przetrwają kompresję. Efektem jest przestrzeń o mniejszej wymiarowości, w której ważne relacje między tokenami — na przykład które słowa silnie się uwzględniają — są w dużej mierze zachowane. Ta kompaktowa mapa geometryczna umożliwia precyzyjne obliczenia odległości, najkrótszych ścieżek i krzywizn.

Budowanie zakrzywionej mapy z uwagi (attention)

Rdzeniem innowacji jest przetłumaczenie wag uwagi na geometryczną miarę odległości. Gdy model mocno zwraca uwagę między dwoma tokenami, RiemannInfer traktuje je jako bliskie na rozmaitości; słaba uwaga umieszcza je dalej. Z tych relacji autorzy definiują metrykę — matematyczną regułę określającą długości i kąty — i wykorzystują ją do obliczania geodezyjnych, zakrzywionego odpowiednika linii prostych, oraz krzywizny, która mierzy, jak silnie przestrzeń się wygina. Wielogłowicowa uwaga naturalnie staje się mieszaniną wielu metryk, z których każda ujmuje inny aspekt struktury językowej, taki jak gramatyka czy znaczenie. Dzięki tej konstrukcji decyzje modelu można interpretować jako wybór konkretnych ścieżek przez krajobraz, którego wzgórza i doliny odzwierciedlają miejsca o większej lub mniejszej gęstości informacji.

Planowanie ścieżek rozumowania o niskim nakładzie

Gdy rozmaitość jest zbudowana, autorzy przekształcają rozumowanie w problem znalezienia „łatwej” ścieżki od pytania do odpowiedzi — takiej, która minimalizuje całkowitą pracę wykonaną po drodze. Posłużyli się analogią ze wspinaczką: wejście stromą, poszarpaną trasą wymaga więcej energii niż pójście po łagodniejszym grzbiecie do tego samego szczytu. W kontekście LLM krzywizna odgrywa rolę stromizny, a praca rozumowania modelu odpowiada temu, o ile zmniejsza się jego wewnętrzna niepewność wzdłuż ścieżki. Korzystając z przybliżonych wzorów na geodezyjne i krzywiznę, w połączeniu z wydajnym algorytmem przeszukiwania grafu (algorytm Dijkstry), RiemannInfer szybko identyfikuje trasy minimalizujące tę pracę, skutecznie kierując model ku bardziej efektywnym łańcuchom myślowym.

Co pokazują eksperymenty na rzeczywistych modelach

Autorzy testują RiemannInfer na kilku nowoczesnych LLM-ach, w tym GPT-4o, Llama-3-405B i DeepSeek-V2-400B, na wymagających benchmarkach matematycznych i rozumowania, takich jak GSM8K, MATH500, StrategyQA i AGIEval. W każdym przypadku otoczenie tych modeli ramą RiemannInfer zwiększa ich dokładność o kilka punktów procentowych — niewielkie wartości, które jednak mają znaczenie na granicy wydajności — przy utrzymaniu lub niewielkiej poprawie prędkości. Porównanie z prostszą, czysto liniową metodą pokazuje, że zignorowanie zakrzywionej geometrii ukrytych stanów drastycznie pogarsza wyniki, podkreślając znaczenie widoku rozmaitości.

Szeroki obraz: nadanie rozumowaniu AI charakteru fizycznego

Dla czytelnika niebędącego specjalistą kluczowy wniosek jest taki, że autorzy przekształcili nieprzejrzyste wewnętrzne działanie dużych modeli językowych w coś bardziej namacalnego: podróż przez zakrzywiony krajobraz, w którym dobre rozumowanie odpowiada podążaniu gładkimi, niskonakładowymi ścieżkami. Ugruntowując wzorce uwagi i kroki rozumowania w pojęciach geometrycznych i fizycznych — odległość, krzywizna i praca — RiemannInfer oferuje zarówno praktyczny sposób poprawy wyników, jak i koncepcyjny most między AI a fizyką przestrzeni ciągłych. Choć obecne metody są przybliżone i wiele szczegółów wymaga dopracowania, ramy te wskazują kierunek ku przyszłym systemom AI, których procesy myślowe będzie można analizować, optymalizować, a być może nawet projektować przy użyciu języka geometrii i fizyki.

Cytowanie: Mao, R., Zhang, Z., Yang, M. et al. RiemannInfer: improving transformer inference through Riemannian geometry. Sci Rep 16, 6636 (2026). https://doi.org/10.1038/s41598-026-37328-x

Słowa kluczowe: duże modele językowe, geometryczne uczenie głębokie, rozmaitość Riemanna, mechanizmy uwagi, efektywność rozumowania