Clear Sky Science · pl

Ramowy system zespołowy głębokiego uczenia do klasyfikacji wielopodtypowych guzów nerkowych z użyciem tomografii komputerowej z kontrastem

Dlaczego wczesne wykrycie guzów nerkowych ma znaczenie

Rak nerki może przez lata przebiegać bezobjawowo, dając niewiele sygnałów, dopóki nie zajmie innych narządów. Dzięki nowoczesnemu obrazowaniu wiele zmian w nerkach wykrywa się przypadkowo podczas badań z powodu bólu pleców lub innych dolegliwości. Kluczowe pytanie brzmi więc: czy guz stanowi groźnego raka wymagającego operacji, czy też to łagodna zmiana, którą można jedynie obserwować? W badaniu tym autorzy badają, jak sztuczna inteligencja może pomóc lekarzom dokładniej interpretować skany CT, ograniczając zbędne zabiegi operacyjne, a jednocześnie wykrywając agresywne nowotwory na czas.

Pięć rodzajów zmian nerkowych, jedna trudna decyzja

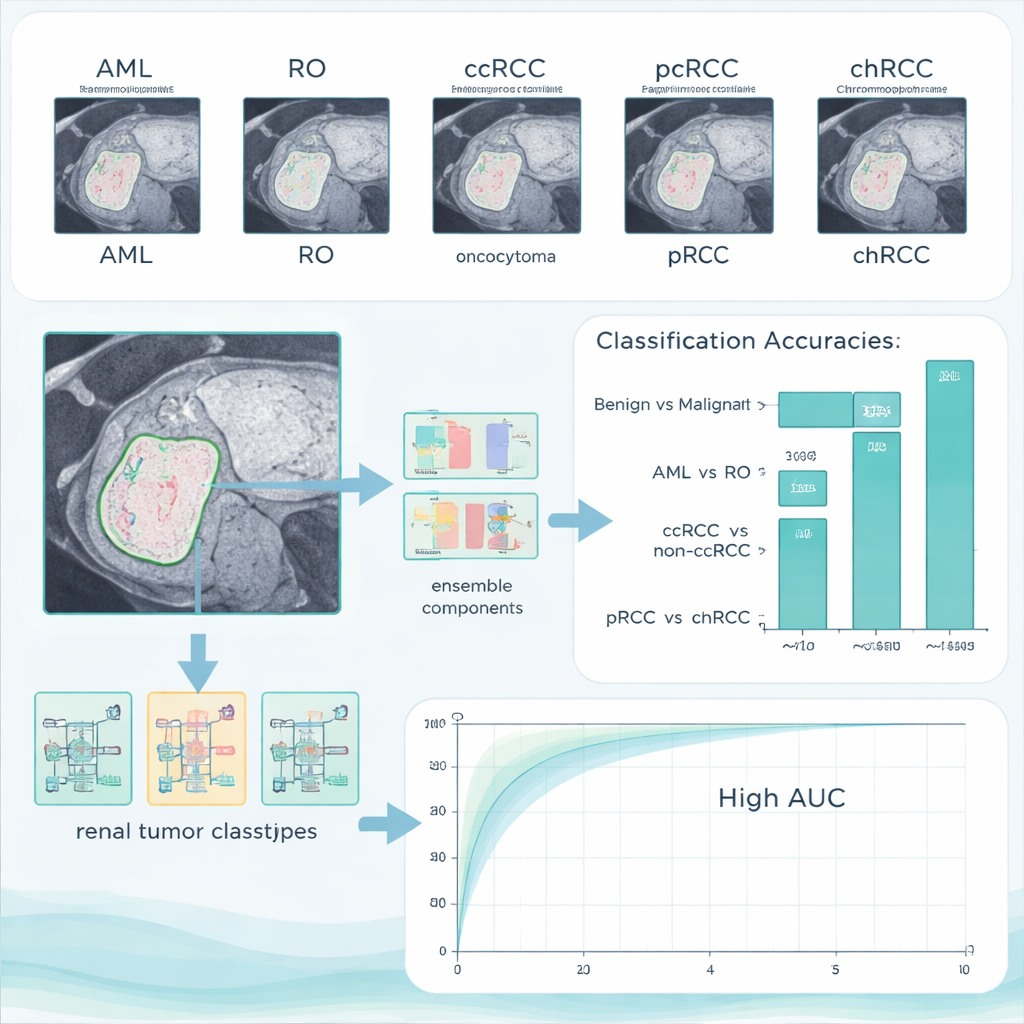

Guzki nerkowe nie są jednakowe. Niektóre, takie jak angiomiolipoma (AML) i onkocytoma nerkowa (RO), są łagodne i mogą nigdy nie zagrozić życiu pacjenta. Inne, zaliczane do raka nerkowokomórkowego (RCC), są złośliwe i mogą dawać przerzuty. Wśród złośliwych nowotworów nerek najczęstszy i najskłonniejszy do przerzutów jest rak jasnokomórkowy (ccRCC); rak brodawkowaty (pRCC) i chromochłonny (chRCC) są zazwyczaj mniej agresywne, ale wciąż poważne. Na standardowych obrazach różne podtypy mogą wyglądać zaskakująco podobnie, dlatego lekarze często opierają się na biopsji lub zabiegu w celu postawienia pewnej diagnozy. Autorzy postawili sobie za cel sprawdzenie, czy zaawansowany system komputerowy potrafi wiarygodnie rozróżnić te pięć typów guzów, używając jedynie obrazów CT z kontrastem.

Przekształcanie skanów CT w dane do nauki

Zespół zebrał tomografie komputerowe z kontrastem od 280 pacjentów, u których podtyp guza potwierdzono badaniem histopatologicznym. Doświadczeni radiolodzy ręcznie wyznaczyli zarysy każdego guza na kolejnych warstwach, tworząc precyzyjne obszary „prawdy klinicznej”, na których mógł uczyć się komputer. Użyto tylko jednej fazy CT — fazy portowo-żylnej, powszechnie stosowanej w rutynowej diagnostyce — podkreślając, że metoda ma działać na standardowych obrazach szpitalnych. Zbiór danych obejmował ostatecznie pięć jasno opisanych grup: 84 ccRCC, 36 pRCC, 48 chRCC, 72 AML i 40 RO, obejmując szeroki zakres wieku i obu płci. Autorzy podzielili przypadki na zbiory treningowy, walidacyjny i testowy według pacjenta, zapewniając, że obrazy tej samej osoby nie występowały w więcej niż jednej grupie.

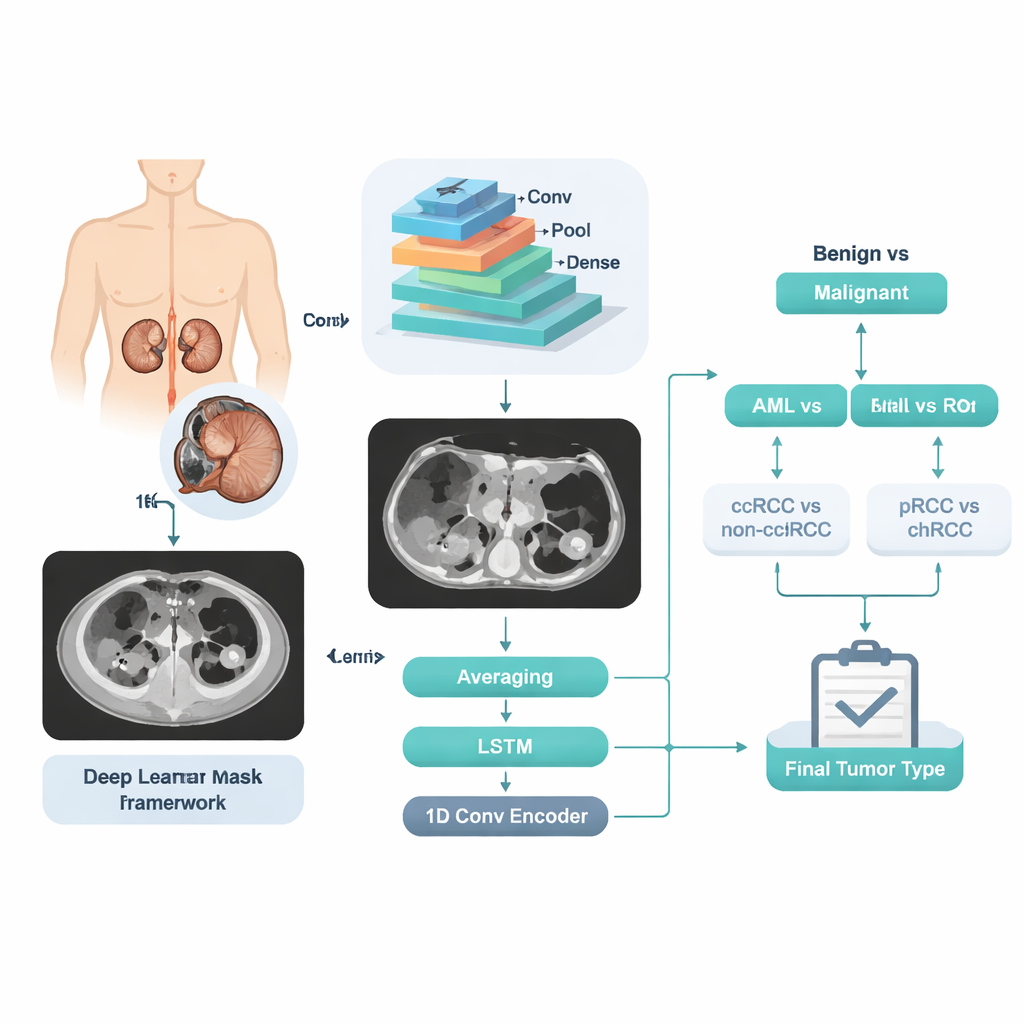

Krok po kroku — cyfrowa druga opinia

Zamiast wymagać od komputera bezpośredniego przypisania jednego z pięciu etykiet do obrazu, badacze zaprojektowali etapowy pipeline decyzyjny, odzwierciedlający tok rozumowania lekarza. Najpierw system decyduje, czy guz jest łagodny, czy złośliwy. Jeśli łagodny, kolejny krok rozdziela AML od RO. Jeśli złośliwy, następna decyzja oddziela ccRCC od pozostałych typów RCC, a ostateczny etap rozróżnia pRCC od chRCC. Na każdym etapie potężny silnik analizy obrazów zwany konwolucyjną siecią neuronową przetwarza wiele przekrojów tego samego pacjenta. Wewnętrzne cechy numeryczne sieci są następnie analizowane na trzy różne sposoby: przez proste uśrednianie prognoz na poziomie przekrojów, przez model uwzględniający sekwencję, który bada, jak guz zmienia się między przekrojami, oraz przez kompaktową sieć kodującą, która streszcza cały zestaw obrazów do pojedynczego sygnaturowego wektora. Trzy „opinii” łączone są w jedną końcową prawdopodobność dla danego etapu.

Jak dobrze system AI się sprawdził

Na głównym zbiorze testowym połączony system osiągnął 96,4% dokładności w rozróżnianiu zmian łagodnych od złośliwych, nie klasyfikując żadnego łagodnego przypadku błędnie jako raka i tylko w niewielu przypadkach nie wykrywając raka. Przy rozróżnianiu dwóch typów łagodnych system uzyskał perfekcyjne 100% dokładności. Trudniejsze zadania — odróżnienie ccRCC od pozostałych typów RCC oraz rozróżnienie raka brodawkowatego od chromochłonnego — były bardziej wymagające, ale system wciąż osiągał ponad 90% dokładności. Co ważne, autorzy przetestowali także wytrenowany model na całkowicie innym publicznym zbiorze danych zebranym w innym ośrodku. Wyniki pozostały wysokie, co sugeruje, że metoda nie polega jedynie na zapamiętywaniu obrazów z jednego szpitala, lecz potrafi uogólniać na nowych pacjentach i skanerach.

Co to może znaczyć dla pacjentów

Mówiąc prosto, badanie pokazuje, że „asystent” AI może analizować tomografie nerek w sposób zbliżony, a w pewnych aspektach przewyższający, obecne ręczne metody rozróżniania zmian niegroźnych od zagrażających życiu oraz identyfikowania istotnych podtypów raka. Jeśli system zostanie dalszymi badaniami potwierdzony, mógłby pomóc radiologom unikać niepotrzebnych biopsji i operacji w przypadku guzów łagodnych, a jednocześnie zwiększać pewność w podejmowaniu wczesnych decyzji terapeutycznych wobec agresywnych nowotworów. Dla pacjentów może to oznaczać mniej inwazyjnych procedur, szybsze odpowiedzi i bardziej spersonalizowaną opiekę opartą na dokładnej charakterystyce ich guza nerkowego.

Cytowanie: Abdeltawab, H., Alksas, A., Ghazal, M. et al. A deep learning ensemble framework for multi-subtype renal tumor classification using contrast-enhanced CT. Sci Rep 16, 6657 (2026). https://doi.org/10.1038/s41598-026-37283-7

Słowa kluczowe: rak nerki, obrazowanie guzów nerkowych, głębokie uczenie, tomografia komputerowa, wspomaganie diagnostyki komputerowej