Clear Sky Science · pl

Kiedy LLM-y mówią ZigBee: badanie modeli o niskiej latencji i wnioskowania do generowania ruchu sieciowego

Inteligentne domy potrzebują wiarygodnych prób

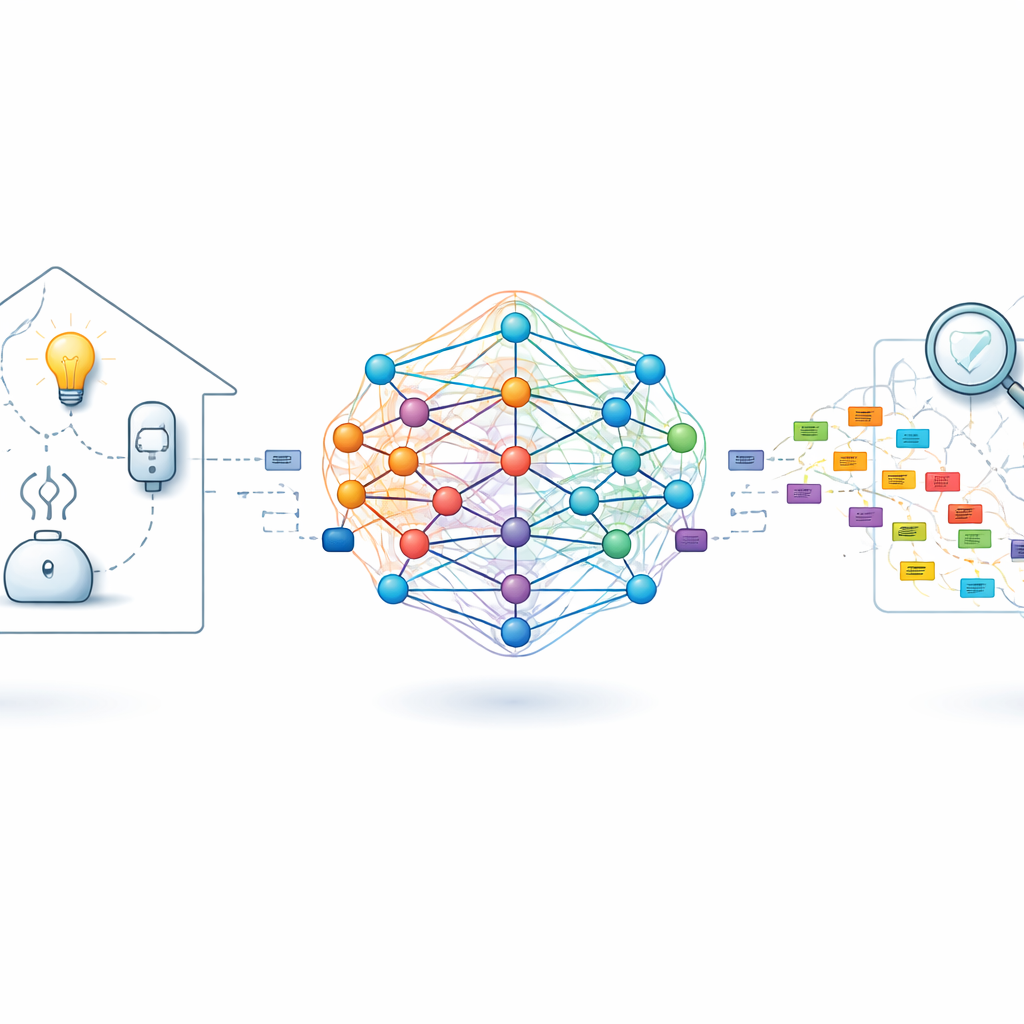

W miarę jak nasze domy zapełniają się inteligentnymi żarówkami, gniazdkami i czujnikami, niewidoczna wymiana komunikatów między nimi staje się zarówno udogodnieniem, jak i potencjalnym słabym punktem. Inżynierowie projektujący i zabezpieczający te systemy potrzebują bezpiecznych sposobów „próbowania”, jak sieci zachowują się w warunkach zbliżonych do rzeczywistych, łącznie z rzadkimi usterkami i atakami cybernetycznymi. Artykuł bada, czy nowoczesne modele językowe — te same, które stoją za chatbotami — można wykorzystać do generowania realistycznego ruchu w inteligentnym domu, dając badaczom potężne środowisko testowe bez konieczności nagrywania każdej możliwej sceny z prawdziwych domów.

Od języka ludzkiego do rozmów urządzeń

Badanie koncentruje się na ZigBee, popularnym standardzie bezprzewodowym używanym w inteligentnych żarówkach, gniazdkach i czujnikach ruchu. Zamiast generować zwykły tekst, autorzy podają próbki pakietów ZigBee — zapisane z znacznikiem czasu informacje o tym, kto z kim się komunikował i jakie pola protokołu były użyte — do dużych modeli językowych (LLM) od OpenAI, w szczególności GPT‑4.1 i GPT‑5. Modele te traktują każdy pakiet jak uporządkowane „zdanie” i uczą się wzorców w tym, jak urządzenia i centralny koncentrator komunikują się w czasie. Celem nie jest tylko naśladowanie podstawowych statystyk, takich jak średni rozmiar pakietu, lecz wygenerowanie nowego ruchu, który będzie przestrzegać surowych reguł ZigBee, używać prawidłowych adresów urządzeń oraz zachowywać realistyczne wzorce czasowe i żądań–odpowiedzi.

Dwa eksperymenty: jednostronna transmisja i pełny dialog

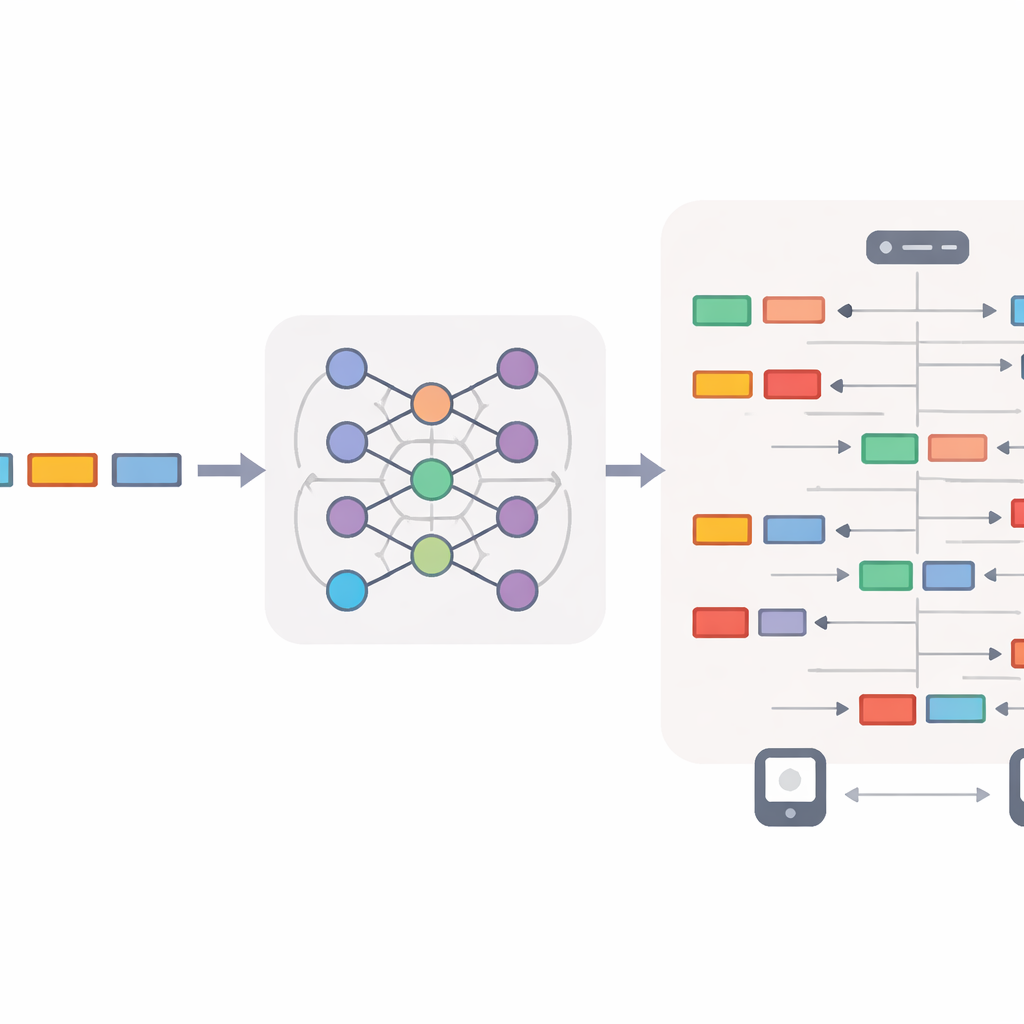

Aby sprawdzić ten pomysł, badacze zaprojektowali dwa główne eksperymenty wykorzystujące duży, rzeczywisty zbiór danych inteligentnego domu o nazwie ZigBeeNet, zawierający około 25 milionów pakietów zebranych od 15 urządzeń w ciągu 20 dni. W pierwszym eksperymencie analizują komunikację jednostronną z pojedynczej inteligentnej żarówki do koncentratora, ucząc LLM tylko na podstawie pierwszych dziesięciu minut rzeczywistego ruchu jako przykładów. W drugim przechodzą do bardziej realistycznego ustawienia, w którym żarówka i koncentrator wymieniają się wiadomościami w obu kierunkach, włączając nadawania rozgłoszeniowe od koncentratora. W obu przypadkach mały zestaw przykładowych pakietów jest pokazany modelowi w promptcie (uczenie few‑shot), a model proszony jest o wygenerowanie dłuższych fragmentów całkowicie nowego ruchu, które można następnie przekształcić z powrotem do standardowych plików przechwytywania pakietów i analizować za pomocą powszechnych narzędzi sieciowych.

Prowadzenie modelu za pomocą reguł i kontroli ludzkiej

Ponieważ źle umieszczone pole lub nieuporządkowany znacznik czasu mogą zrujnować iluzję realizmu, zespół buduje staranne ustawienie promptów i informacji zwrotnej. Najpierw filtrują i eksportują rzeczywiste pakiety, a następnie formułują prompty, które określają dozwolone adresy urządzeń, typy wiadomości i formaty czasu. W początkowej fazie ekspert ludzki przegląda wyjście modelu, wyszukując problemy takie jak nieprawidłowe adresy, niemożliwe numery sekwencji czy luki czasowe. Zamiast ręcznie poprawiać pakiety, tłumaczą te ustalenia na ostrożniejsze reguły w promptach — na przykład zakazując wysyłania przez urządzenie do samego siebie lub wymagając, by liczba pakietów mieściła się w realistycznym zakresie. Gdy reguły są stabilne, prompty są „zamrażane” i używane bez zmian, tak aby późniejsze eksperymenty były w pełni automatyczne i powtarzalne.

Porównanie LLM z klasycznymi generatorami

Aby sprawdzić, czy LLM rzeczywiście wnosi wartość, autorzy porównują GPT‑4.1 i GPT‑5 z dwoma klasycznymi podejściami z uczenia głębokiego: rekurencyjnymi sieciami neuronowymi (RNN) i sieciami generatywnymi przeciwstawnymi (GAN), oboma zaadaptowanymi do generowania sekwencji przypominających ZigBee. Oceniają wszystkie modele w wielu wymiarach: jak bliskie rzeczywistemu ruchowi są rozkłady czasów między pakietami, czy pakiety poprawnie dekodują się w standardowych narzędziach, czy przestrzegane są reguły protokołu i role urządzeń, jak często pakiety się powtarzają oraz jak często dokładnie kopiują przykłady z treningu. Wyniki pokazują, że oba modele GPT generują niemal w pełni dekodowalny i zgodny z protokołem ruch o niewielkim odchyleniu od rzeczywistych wzorców czasowych, podczas gdy RNN mają trudności z długoterminowym porządkiem, a GAN-y często tworzą nierealistycznie gęsty lub semantycznie niepoprawny ruch, szczególnie w przypadku komunikacji dwukierunkowej i dłuższych symulacji.

Kiedy „więcej myślenia” nie pomaga

Badanie bada też zaskakujące pytanie: czy zwiększenie wewnętrznego „czasu myślenia” modelu zorientowanego na wnioskowanie, GPT‑5, poprawia realizm wygenerowanego ruchu sieciowego? Regulując ukrytą intensywność wnioskowania GPT‑5 od niskiej do wysokiej, autorzy stwierdzają, że większy wysiłek czyni model wolniejszym i bardziej rozmownym, ale nie poprawia — a czasem pogarsza — zgodności jego ruchu z rzeczywistością. GPT‑4.1, szybszy model bez dodatkowego wnioskowania, konsekwentnie dorównuje lub przewyższa GPT‑5 w kluczowych metrykach jakości, używając przy tym mniejszych zasobów obliczeniowych. W dłuższych, 30‑minutowych symulacjach obydwa modele LLM utrzymują poprawne zachowanie ZigBee, podczas gdy klasyczne baselines RNN i GAN znacznie zbaczają w kwestii timingów i poprawności protokołu.

Co to oznacza dla bezpieczniejszych inteligentnych domów

Dla osób niebędących specjalistami główne przesłanie jest takie, że nowoczesne modele językowe potrafią nauczyć się nie tylko ludzkich rozmów, lecz także „języka” urządzeń inteligentnego domu, generując na żądanie wiarygodny, zgodny z regułami ruch. Praca pokazuje, że relatywnie szybki, o niskiej latencji model taki jak GPT‑4.1 może już służyć jako wysokiej wierności generator ruchu do testów i oceny bezpieczeństwa, potencjalnie zmniejszając potrzebę przechwytywania wrażliwych danych z rzeczywistych środowisk. Wskazuje też, że bardziej złożone, cięższe mechanizmy wnioskowania nie zawsze są lepsze: do ściśle ustrukturyzowanych zadań technicznych prostsze, wydajne modele mogą być mądrzejszym wyborem. Wraz z udostępnieniem kodu i danych przez autorów, podejście to może pomóc badaczom na całym świecie testować systemy inteligentnego domu, ulepszać wykrywanie włamań i badać nowe projekty sieci w bezpiecznym, syntetycznym środowisku testowym.

Cytowanie: Keleşoğlu, N., Sobczak, Ł. & Domańska, J. When LLMs speak ZigBee: exploring low-latency and reasoning models for network traffic generation. Sci Rep 16, 8036 (2026). https://doi.org/10.1038/s41598-026-37246-y

Słowa kluczowe: inteligentny dom IoT, generowanie ruchu ZigBee, duże modele językowe, testowanie bezpieczeństwa sieci, syntetyczne dane sieciowe