Clear Sky Science · pl

Innowacyjne streszczanie czasowe dla złożonej klasyfikacji wideo

Dlaczego inteligentniejsze streszczenia wideo mają znaczenie

Od kamer bezpieczeństwa po platformy streamingowe — świat rejestruje więcej wideo, niż ludzie lub komputery są w stanie wygodnie przetwarzać. Każda sekunda nagrania zawiera dziesiątki klatek, z których wiele jest niemal identycznych. Artykuł bada sposób, aby skrócić długie filmy do tych najbardziej wymownych momentów, tak by komputery wciąż rozpoznawały akcje, takie jak gotowanie, uprawianie sportu czy spacer z psem — przy znacznie mniejszym nakładzie czasu, pamięci i energii. Takie udoskonalenia mogłyby przyczynić się do udostępnienia zaawansowanej analizy wideo na urządzeniach codziennego użytku, od robotów domowych po kamery noszone na ciele.

Od nieskończonych klatek do kluczowych momentów

Tradycyjne systemy klasyfikacji wideo próbują rozpoznać, co dzieje się w klipie — na przykład krojenie warzyw lub rzut koszykówką — poprzez podawanie długich sekwencji klatek do ciężkich modeli uczenia głębokiego. Modele te muszą uwzględniać zarówno wygląd (jak coś wygląda), jak i czas (jak porusza się w czasie). Przetwarzanie wszystkich klatek prowadzi do dużych zbiorów danych, wysokich wymagań magazynowych i powolnych, energochłonnych obliczeń. Autorzy argumentują, że wiele z tych klatek jest redundantnych: jeśli między kolejnymi klatkami nic istotnego się nie zmienia, system niewiele zyskuje, analizując obie. Centralna idea artykułu polega na wybraniu znacznie mniejszego zestawu „kluczowych klatek”, które nadal uchwycą ważne zmiany w scenie.

Mierzenie zmian między klatkami

Aby znaleźć te kluczowe momenty, badacze projektują i porównują kilka sposobów mierzenia, o ile jedna klatka różni się od drugiej. Zamiast polegać wyłącznie na klasycznej odległości euklidesowej, która porównuje wszystkie piksele równomiernie, testują alternatywy bardziej czułe na zmiany strukturalne. Ich główna propozycja, nazwana odległością „Norma wierszy” (Norm of Rows), skupia się na największej różnicy w każdym wierszu pikseli, a następnie przyjmuje najbardziej wyraźny wiersz jako miarę zmiany między dwiema klatkami. Eksplorują też odległości oparte na kolumnach oraz metody wykorzystujące wartości własne macierzy podsumowujących rozkład różnic pikseli. Wszystkie te podejścia mają lepiej wykrywać istotny ruch lub zmiany sceny, takie jak sięgnięcie ręki po przyrząd kuchenny czy skok zawodnika.

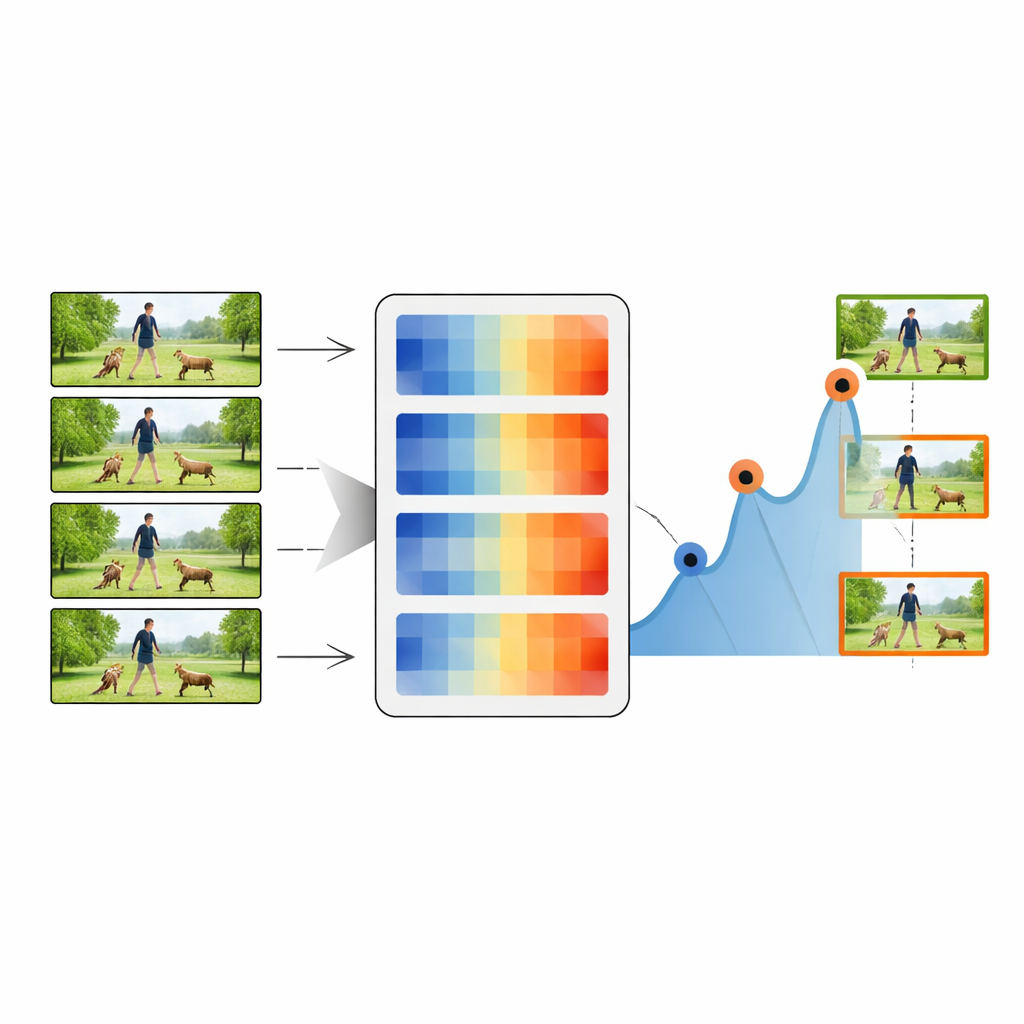

Jak działa proces streszczania

Proces streszczania zaczyna się od pierwszej klatki wideo, która traktowana jest jako początkowa kluczowa klatka. System porównuje następnie tę klatkę z każdą kolejną, używając jednej z miar odległości. Kiedy odległość przekracza ustalony próg, odpowiadająca jej klatka zostaje oznaczona jako nowa kluczowa klatka, co wskazuje, że nastąpiła wizualnie istotna zmiana. Procedura powtarza się, używając tej nowej kluczowej klatki jako odniesienia, przechodząc przez wideo i zbierając łańcuch reprezentatywnych ujęć. Poprzez regulację progu metoda może zachować zaledwie 20 procent lub aż 80 procent oryginalnych klatek, balansując między zwięzłością a szczegółowością. Takie streszczenia są następnie przekazywane do standardowego klasyfikatora głębokiego uczenia, który łączy wydajną sieć obrazową (ResNet-50) z modułem wrażliwym na czas (LSTM).

Sprawdzanie metody w praktyce

Autorzy rygorystycznie oceniają swoje podejście na czterech dobrze znanych zbiorach wideo: codzienne czynności w kuchni (MMAC), sporty i ogólne akcje (UCF101 i UCF11) oraz bardziej zróżnicowane, trudne klipy (HMDB51). We wszystkich tych benchmarkach odległość Norma wierszy konsekwentnie zapewnia najlepszy kompromis między szybkością a dokładnością. Przy zachowaniu zaledwie około połowy klatek ich system osiąga dokładności klasyfikacji powyżej 90 procent na kilku zbiorach danych — często dorównując lub przewyższając bardziej złożone metody, które używają pełnych, nieskróconych wideo. Autorzy mierzą także, jak dobrze streszczenia pokrywają oryginalną treść, jak redundantne są wybrane klatki i jak zróżnicowane stają się uchwycone momenty. Proponowana miara osiąga wysokie pokrycie przy niskiej redundancji, co oznacza, że zachowuje narrację wideo bez powtarzania podobnych klatek.

Szybsze decyzje dla wideo w zastosowaniach rzeczywistych

Poprzez skrócenie liczby klatek mniej więcej o połowę, metoda niemal dzieli czas przetwarzania na pół na standardowym sprzęcie komputerowym i nadal daje zauważalne przyspieszenia nawet na nowoczesnych kartach graficznych. Dla systemów rzeczywistych, które muszą reagować w czasie rzeczywistym — takich jak nadzór, roboty autonomiczne czy aplikacje mobilne — to obniżenie obciążenia jest kluczowe. Badanie pokazuje, że starannie zaprojektowana miara odległości może działać jak inteligentny selekcjoner, wybierając, które klatki zasługują na uwagę, a które można bezpiecznie pominąć.

Wnioski dla codziennego użytku

Mówiąc prosto, praca pokazuje, że komputery nie muszą oglądać każdej pojedynczej klatki, żeby zrozumieć, co dzieje się na wideo. Koncentrując się na momentach, gdy obraz rzeczywiście się zmienia, i ignorując niemal duplikaty, proponowana technika zachowuje istotę akcji przy znacznym ograniczeniu ilości danych. Dzięki temu wysokiej jakości rozumienie wideo staje się bardziej praktyczne na sprzęcie o ograniczonych zasobach i otwiera drogę do szybszych, bardziej efektywnych narzędzi do analizy rosnącego strumienia informacji wizualnej w naszym codziennym życiu.

Cytowanie: Khan, A., Rahnama, A., Islam, A. et al. Innovative temporal summarization for complex video classification. Sci Rep 16, 7970 (2026). https://doi.org/10.1038/s41598-026-37111-y

Słowa kluczowe: klasyfikacja wideo, streszczanie wideo, wybór kluczowych klatek, rozpoznawanie akcji, efektywność widzenia komputerowego