Clear Sky Science · pl

Ocena podatności systemów rozpoznawania chodu za pomocą PPO i ataków adwersarialnych generowanych przez GAN

Dlaczego oszukiwanie wzoru chodzenia ma znaczenie

Większość z nas rozpoznaje znajomych i rodzinę po sposobie chodzenia, nawet z daleka. Komputery potrafią dziś robić coś podobnego: systemy „rozpoznawania chodu” analizują styl poruszania się osoby, aby ją zidentyfikować bez odcisków palców czy skanu twarzy. Narzędzia te są coraz częściej wykorzystywane w bezpieczeństwie i nadzorze. W tym badaniu pada niepokojące pytanie: jak łatwo można oszukać takie systemy, stosując drobne, starannie zaprojektowane zmiany, których ludzie nie zauważą — ale które zakłócają działanie maszyn? Odpowiedź ma duże konsekwencje dla prywatności, bezpieczeństwa i zaufania do sztucznej inteligencji w sytuacjach o wysokiej stawce.

Jak komputery czytają nasz sposób chodzenia

Nowoczesne rozpoznawanie chodu opiera się na uczeniu głębokim, tej samej rodzinie technik co rozpoznawanie twarzy czy auta autonomiczne. Zamiast analizować pojedyncze ujęcie, systemy te łączą wiele klatek osoby w ruchu w jeden „gait energy image” — pewnego rodzaju rozmytą sylwetkę, która uchwyca, jak części ciała poruszają się w cyklu kroku. Specjalnie zaprojektowana sieć neuronowa uczy się rozróżniać chód jednej osoby od innej, nawet gdy zmienia się ubranie lub osoby niosą przedmioty. W testach na dwóch dużych zbiorach wideo z chodzącymi osobami (zestawy CASIA-B i OU-ISIR) model bazowy autorów poprawnie identyfikował osoby w ponad 97% przypadków — wysoki wynik sugerujący, że technologia mogłaby być gotowa do zastosowań w praktyce.

Niewidoczne naklejki, które oszukują inteligentne kamery

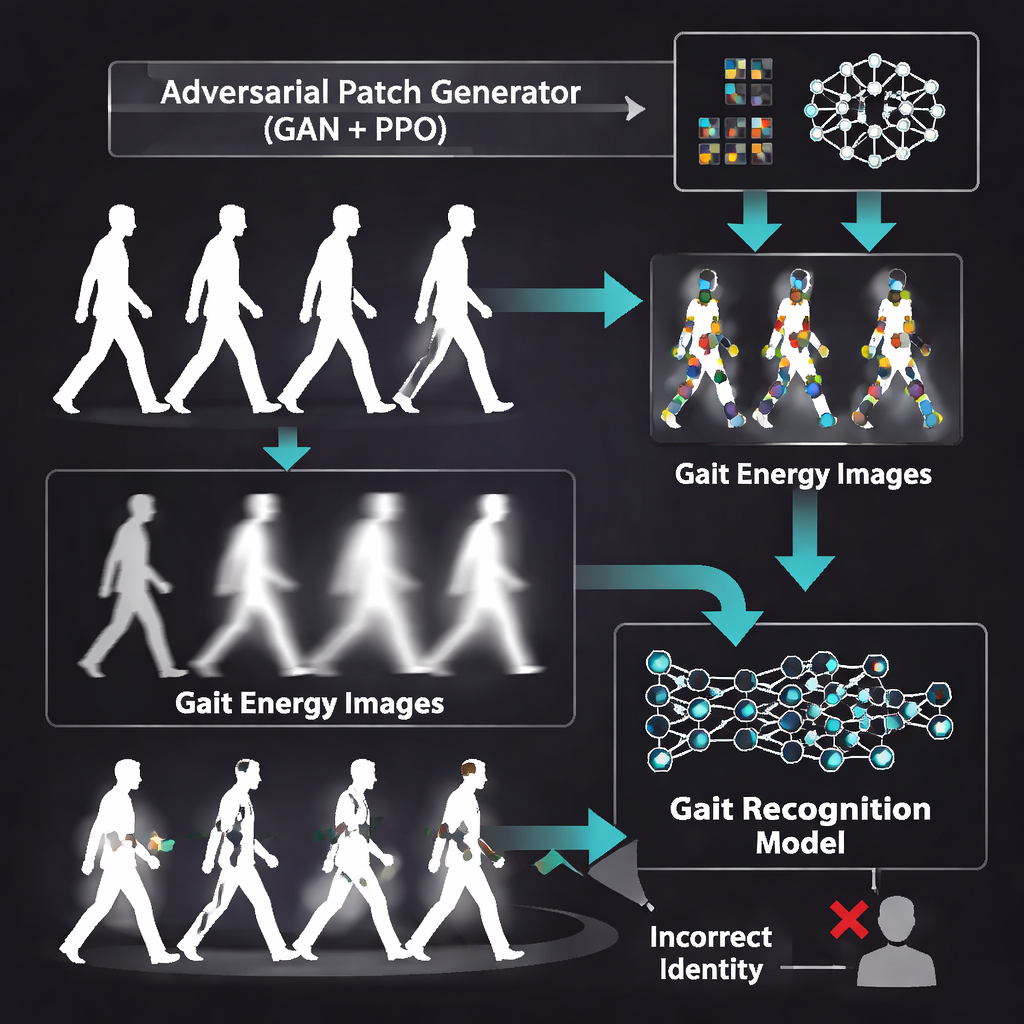

Rdzeniem artykułu nie jest budowa lepszego systemu identyfikacji, lecz celowe jego łamanie, aby ujawnić słabości. Badacze generują małe „łatki adwersarialne” — kwadratowe obszary zmienionych pikseli, które wyglądają nieszkodliwie, a jednak są matematycznie dobrane, by zmylić sieć neuronową. Do tworzenia tych łatek używają Generative Adversarial Network (GAN) — rodzaju SI, która uczy się produkować realistycznie wyglądające obrazy, rywalizując z wbudowanym krytykiem. GAN jest trenowany bezpośrednio na obrazach energii chodu, tak aby jego output naturalnie wtapiał się w eteryczne sylwetki. Łatki te są zaprojektowane na tyle subtelnie, że człowiek, rzucający okiem na wzór chodzenia, prawdopodobnie nie zauważy niczego niepokojącego.

Pozwalając agentowi uczącemu się znaleźć słabe punkty

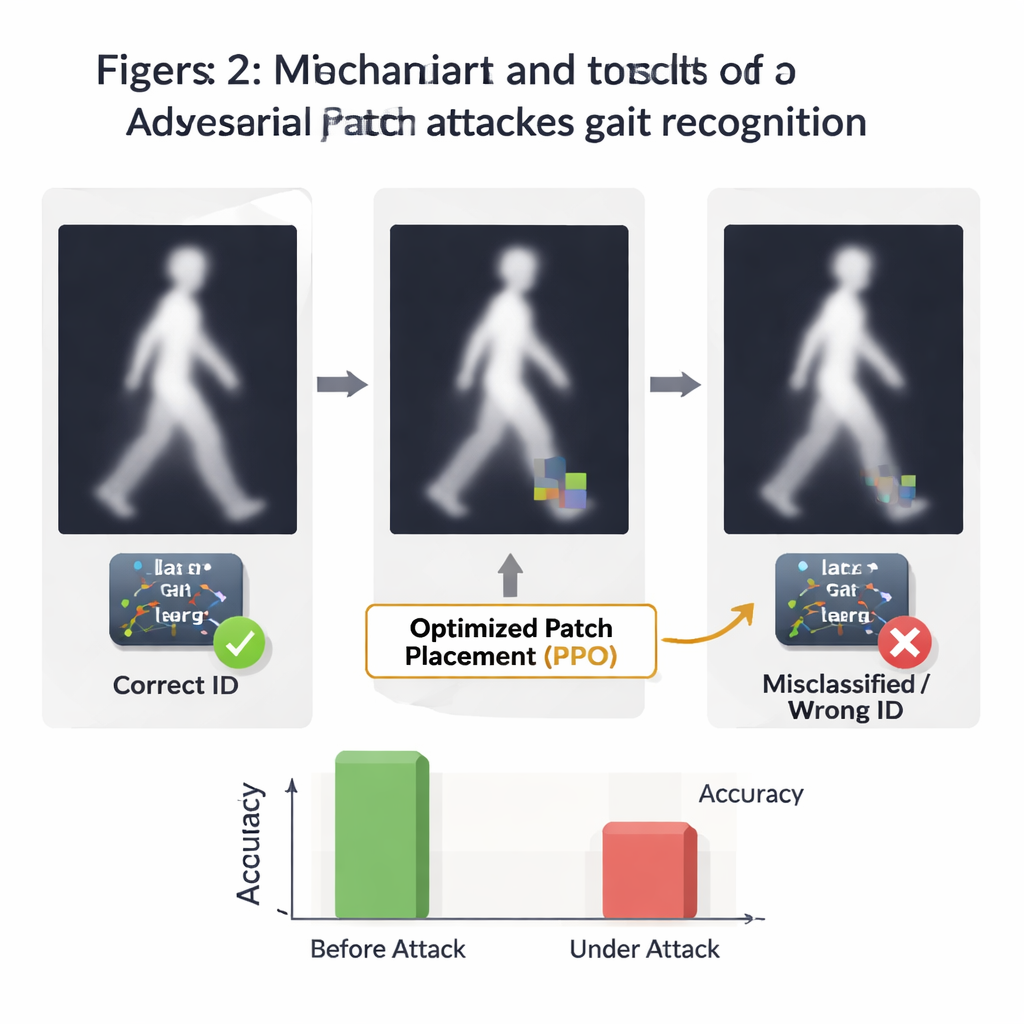

Miejsce umieszczenia łatki może być tak samo ważne jak jej wygląd. Aby odkryć najbardziej szkodliwe lokalizacje, autorzy sięgają po metodę uczenia ze wzmocnieniem o nazwie Proximal Policy Optimization (PPO). Traktują każdy obraz chodu jak środowisko w formie siatki i pozwalają programowemu „agentowi” przesuwać łatkę — w górę, w dół, w lewo lub w prawo — obserwując, o ile spada pewność rozpoznania systemu. Gdy dana pozycja powoduje błędną identyfikację osoby, agent otrzymuje nagrodę; gdy zawodzi, jest karany. W wielu epizodach agent uczy się polityki umieszczania łatki w szczególnie podatnych regionach obrazu chodu, często w pobliżu poruszających się części ciała, na których model najbardziej polega.

Co się dzieje, gdy atak zostaje uwolniony

Po wytrenowaniu zarówno generatora łatek, jak i strategii ich umieszczania, zespół atakuje własny wysoko wydajny system rozpoznawania chodu. W normalnych warunkach system wykazuje doskonałą dokładność, niską liczbę fałszywych alarmów i wyraźne rozdzielenie między poprawnymi a błędnymi dopasowaniami. Po dodaniu łatek adwersarialnych wydajność jednak gwałtownie spada. W zależności od tego, jak swobodnie łatka może się przesuwać po obrazie, wskaźniki sukcesu ataku rosną powyżej 60%, a odsetek poprawnie zidentyfikowanych osób może spaść do niemal jednej trzeciej pierwotnego poziomu. Krzywe, które kiedyś pokazywały niemal perfekcyjną separację między prawdziwymi użytkownikami a podszywającymi się osobami, opadają w kierunku linii losowego zgadywania, ujawniając, jak łatwo model można wypchnąć z kursu bez widocznych zniekształceń.

Co to znaczy dla codziennego bezpieczeństwa

Dla osób niebędących specjalistami wnioski są jasne: system rozpoznawania chodu, który w laboratorium wydaje się bardzo dokładny, może być zaskakująco kruchy wobec sprytnego, maszynowo zaprojektowanego sabotażu. Badanie pokazuje, że połączenie narzędzi generatywnych z uczeniem przez próbę i błąd może dać drobne, niemal niewidoczne zmiany powodujące poważne błędy identyfikacji. Praca ta nie jest planem do nadużyć w świecie rzeczywistym, lecz ostrzeżeniem i ramą testową. Daje projektantom systemów sposób na sprawdzenie i zmierzenie podatności ich modeli oraz podkreśla potrzebę budowania zabezpieczeń przeciw takim atakom, zanim rozpoznawanie chodu zostanie powszechnie zaufane do nadzoru, kontroli dostępu czy innych krytycznych zastosowań.

Cytowanie: Saoudi, E.M., Jaafari, J. & Jai Andaloussi, S. Evaluating gait system vulnerabilities through PPO and GAN-generated adversarial attacks. Sci Rep 16, 6039 (2026). https://doi.org/10.1038/s41598-026-37011-1

Słowa kluczowe: rozpoznawanie chodu, bezpieczeństwo biometryczne, ataki adwersarialne, uczenie głębokie, uczenie ze wzmocnieniem