Clear Sky Science · pl

Porównanie modeli rozpoznawania czynności w wykrywaniu samookaleczeń na zestawach studyjnych i rzeczywistych

Obserwacja pacjentów cyfrowymi oczami

W szpitalach psychiatrycznych pielęgniarki i pielęgniarze nieustannie dbają o bezpieczeństwo pacjentów, zwłaszcza tych narażonych na wyrządzanie sobie krzywdy. Nawet najbardziej zaangażowany personel nie jest jednak w stanie obserwować każdego pokoju przez całą dobę. W tym badaniu sprawdzono, czy sztuczna inteligencja (SI) może pomóc, automatycznie analizując nagrania z kamer na oddziale w celu wykrycia wczesnych oznak samookaleczeń — oferując dodatkową warstwę ochrony bez zastępowania opieki ludzkiej.

Dlaczego trudno wychwycić samookaleczenia

Samookaleczenie — każde zamierzone zranienie, które osoba zadaje sobie sama — często ma miejsce w krótkich, ukrytych chwilach: szybkie zadrapanie pod kołdrą czy użycie małego narzędzia poza zasięgiem wzroku. Oddziały psychiatryczne polegają na regularnych kontrolach i monitoringu wideo, ale martwe pola, zmęczenie personelu oraz ograniczone obsadzenie nocą lub w święta uniemożliwiają ciągłą czujność. Równocześnie nagrywanie i udostępnianie prawdziwych materiałów pacjentów rodzi poważne obawy prywatności i kwestie etyczne. W efekcie badacze mieli bardzo mało realistycznych nagrań do trenowania systemów SI, które mogłyby wykrywać niebezpieczne zachowania w czasie rzeczywistym.

Tworzenie bezpieczniejszych środowisk testowych dla SI

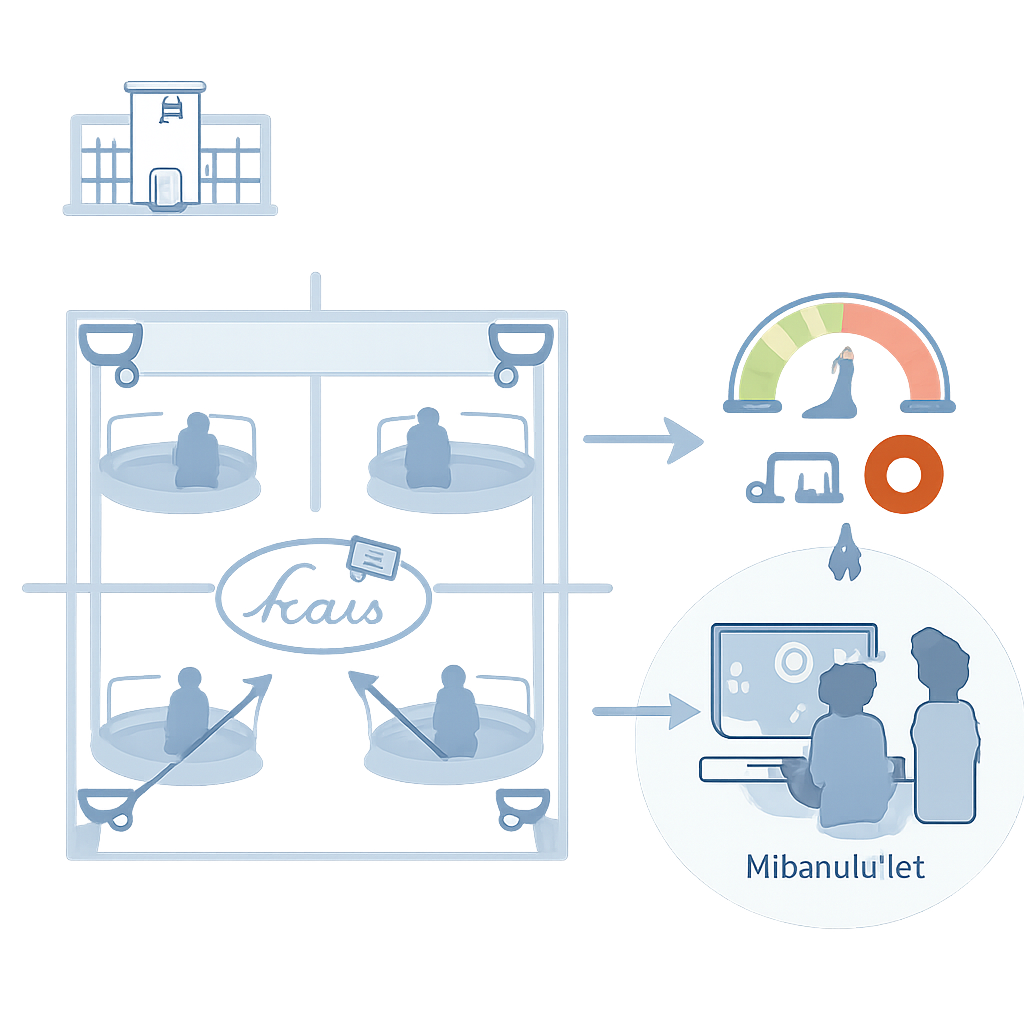

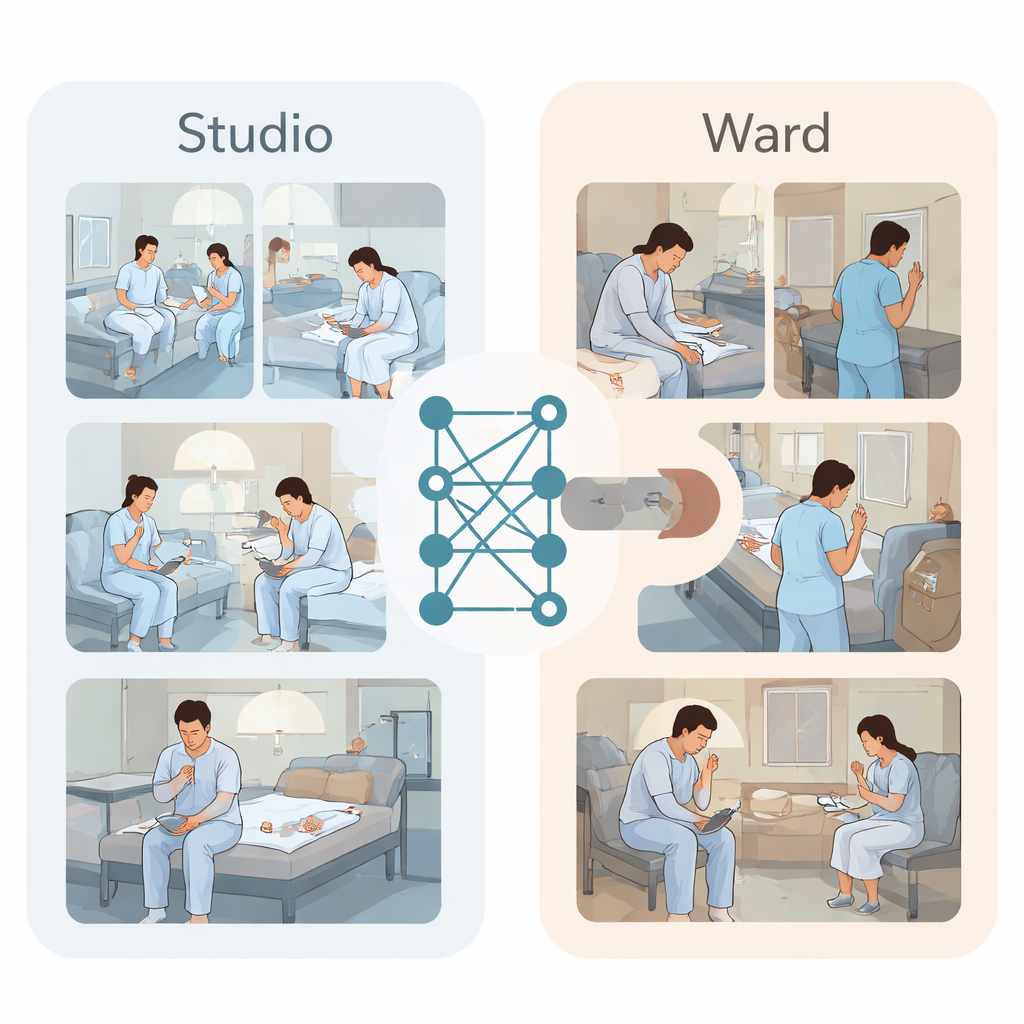

Aby przełamać impas, zespół badawczy stworzył dwa rodzaje zestawów wideo. Po pierwsze, w studiu stylizowanym na czteroosobowy pokój psychiatryczny siedmiu młodych aktorów w szpitalnych koszulach wykonało starannie zaplanowane sceny. Szukali codziennych przedmiotów, takich jak plastikowe nakrętki, rurki do balsamu czy małe gwoździe, a następnie odegrali krótkie sekwencje ruchów samookaleczających nadgarstek, przedramię lub udo, rejestrowane przez kamerę z sufitu z wielu kątów. Eksperci oznaczyli każdy segment wideo jako zachowanie normalne lub samookaleczenie, tworząc czysty, zbalansowany zbiór 1120 klipów. Po drugie, zespół zgromadził rzeczywiste nagrania z monitoringu z zabezpieczonych oddziałów psychiatrycznych przez dziesięć miesięcy. Klinicyści przeszukali dokumentację medyczną pod kątem notatek o zachowaniach takich jak drapanie, dłubanie czy cięcie, a następnie odnaleźli odpowiadające nagrania. Po zaciemnieniu twarzy i usunięciu danych umożliwiających identyfikację złożono 59 klipów pokazujących rzeczywiste samookaleczenia oraz 59 klipów normalnych do porównania.

Testowanie najlepszych dziś systemów wideo SI

Mając te zbiory, zespół porównał wiodące systemy rozpoznawania czynności — programy komputerowe zaprojektowane do rozumienia, co ludzie robią na wideo. Niektóre opierały się na starszych sieciach konwolucyjnych analizujących krótkie sekwencje klatek, podczas gdy nowsze modele oparte na transformatorach używają mechanizmów uwagi, aby łączyć wzorce w przestrzeni i czasie. Wszystkie modele trenowano wyłącznie na nagraniach studyjnych, aby klasyfikować klipy jako samookaleczenie lub zachowanie normalne. Co ważne, badacze zastosowali rygorystyczny schemat testowy: w każdym cyklu wszystkie klipy jednego aktora były wyłączone jako zupełnie nowe dane testowe, co zapewniało, że algorytmy nie mogły jedynie zapamiętać poszczególnych osób.

Kiedy czyste nagrania studyjne spotykają bałagan rzeczywistości

Na uporządkowanych nagraniach studyjnych wyróżnił się najnowocześniejszy model oparty na transformatorze, zwany VideoMAEv2. Najlepiej równoważył przeoczenia i fałszywe alarmy, osiągając współczynnik F1 (miara łączona precyzji i czułości) około 0,65, podczas gdy prostsze metody oscylowały blisko losowego zgadywania. Wizualne wyjaśnienia pokazały, że model skupiał się precyzyjnie na miejscu zetknięcia narzędzia ze skórą, zamiast rozpraszać się ruchem tła. Jednak gdy te same wytrenowane systemy zastosowano do rzeczywistych nagrań z oddziałów — bez żadnego dodatkowego treningu — ich wydajność spadła. VideoMAEv2 wciąż radził sobie lepiej niż przypadek, z F1 około 0,61, lecz miał trudności szczególnie z subtelnymi zachowaniami, takimi jak dłubanie i drapanie, które nie występowały w symulowanych danych, oraz z pacjentami małymi, daleko od kamery lub częściowo zasłoniętymi.

Co to oznacza dla bezpieczeństwa pacjentów

Wyniki razem ujawniają wyraźną lukę „symulacja–rzeczywistość”. Systemy SI, które wyglądają obiecująco na starannie reżyserowanych nagraniach, mogą zawodzić w zetknięciu z bałaganem, dziwnymi kątami i różnorodnymi zachowaniami w realnym życiu szpitalnym. Głównym wkładem badania nie jest gotowy produkt bezpieczeństwa, lecz punkt wyjścia: publiczny, dobrze oznaczony zbiór studyjny, starannie zebrany zestaw testowy z rzeczywistości oraz przejrzysty benchmark pokazujący, gdzie obecne metody zawodzą. Dla osób spoza dziedziny przesłanie jest jasne: SI może już pomagać wskazywać podejrzane momenty na strumieniach wideo z oddziałów, ale nie można jej jeszcze ufać jako samodzielnemu strażnikowi. Zamknięcie tej luki będzie wymagać bogatszych, bardziej zróżnicowanych danych treningowych i mądrzejszych modeli, rozwijanych z poszanowaniem prywatności, sprawiedliwości i oceny klinicznej.

Cytowanie: Lee, K., Lee, D., Ham, HS. et al. Benchmarking action recognition models for self-harm detection in studio and real-world datasets. Sci Rep 16, 6850 (2026). https://doi.org/10.1038/s41598-026-36999-w

Słowa kluczowe: wykrywanie samookaleczeń, oddziały psychiatryczne, rozpoznawanie czynności w wideo, sztuczna inteligencja w opiece zdrowotnej, bezpieczeństwo pacjentów