Clear Sky Science · pl

Badanie rozpoznawania emocji uczniów i informacji zwrotnej nauczycieli w akademickiej klasie języka obcego na podstawie modelu AFCNN

Dlaczego twój nauczyciel wkrótce może czytać nastrój klasy za pomocą AI

Każdy, kto siedział na nudnym wykładzie, wie, że znudzenie cicho zabija proces uczenia się. Nauczyciele często mają jednak tylko intuicję, by odgadnąć, co uczniowie czują w danym momencie. W tym badaniu zbadano nowe podejście, które daje nauczycielom akademickich kursów języków obcych rodzaj „pulpitu emocji” napędzanego sztuczną inteligencją (AI). Poprzez odczytywanie mimiki twarzy uczniów w czasie rzeczywistym system pomaga nauczycielom dostosowywać nauczanie na bieżąco, a w dłuższej perspektywie wspiera ich rozwój zawodowy.

Uczucia mają takie samo znaczenie jak gramatyka

Zajęcia z języka obcego to nie tylko listy słówek i reguły gramatyczne. To przestrzenie społeczne, w których pewność siebie, lęk, ciekawość i znudzenie kształtują efektywność uczenia się. Poprzednie badania pokazały, że szkolenia nauczycieli zwykle koncentrują się na metodach i wiedzy przedmiotowej, poświęcając mniej uwagi emocjom uczniów w trakcie zajęć. Tradycyjne narzędzia, takie jak ankiety na koniec semestru czy rozmowy po lekcji, pojawiają się za późno, by uratować nieudane zajęcia. Autorzy twierdzą, że gdyby nauczyciele mogli obserwować, jak emocje zmieniają się minuta po minucie, mogliby reagować szybciej — przyspieszać, zwalniać tempo lub zmieniać aktywności zanim uczniowie mentalnie się odłączą.

Przekształcanie twarzy w użyteczne sygnały

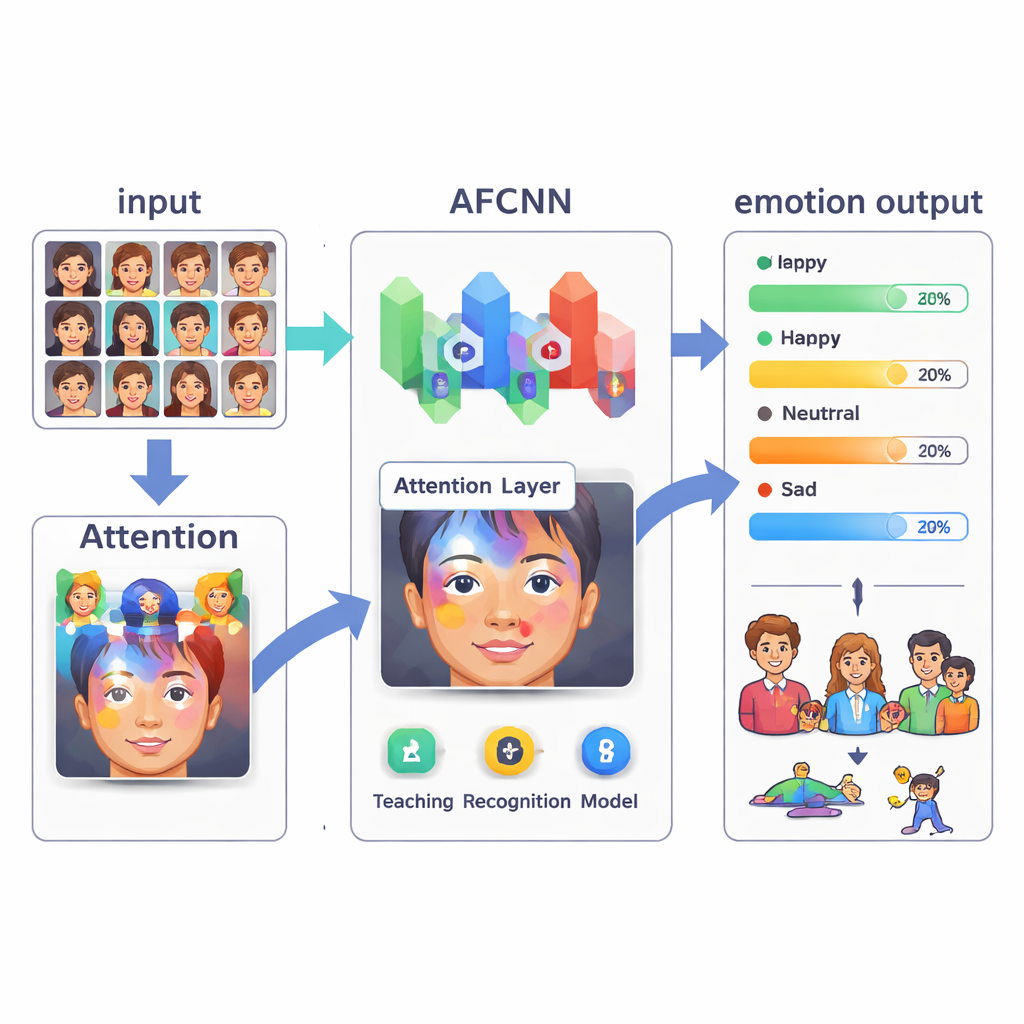

Rdzeniem badania jest model uczenia głębokiego nazwany Attention Feature Convolutional Neural Network, w skrócie AFCNN. Mówiąc prosto, kamera w sali rejestruje twarze uczniów podczas nauki. Model wykonuje następnie trzy kroki: wykrywa każdą twarz, wydobywa cechy powiązane z wyrazami emocjonalnymi i klasyfikuje je do jednej z siedmiu podstawowych emocji, takich jak radość, smutek, strach czy stan neutralny. Specjalny mechanizm „uwagi” pomaga AI skupić się na najbardziej informatywnych częściach twarzy — na przykład oczach czy ustach — przy jednoczesnym ignorowaniu rozproszeń. W przeciwieństwie do starszych podejść działających najlepiej na czystych, frontalnych zdjęciach, system ten został zaprojektowany do radzenia sobie z bardziej realistycznymi warunkami, takimi jak częściowe widoki, dłonie na twarzy czy uczniowie patrzący bokiem.

Jak dobrze system rzeczywiście działa

Aby przetestować AFCNN, badacze wytrenowali go na dobrze znanym zbiorze zdjęć twarzy oznaczonych kategoriami emocji i rozszerzyli dane za pomocą prostych modyfikacji, takich jak obrót i zmiany jasności. Następnie porównali jego wydajność z dwoma uznanymi modelami rozpoznawania obrazów, VGG16 i ResNet18. W warunkach przejrzystych, bez przeszkód, nowy model poprawnie identyfikował emocje w około 81% przypadków i był szczególnie dobry w rozpoznawaniu wyrażeń radości i neutralnych, osiągając dokładność na poziomie około połowy osiemdziesiątek. Gdy twarze były częściowo zasłonięte — włosami, dłońmi lub nakryciami głowy — dokładność spadała we wszystkich systemach, ale AFCNN nadal przewyższał pozostałe i wykazywał bardziej zrównoważone wyniki między różnymi emocjami, co sugeruje większą odporność w realistycznych warunkach klasowych.

Od odczytów emocji do lepszych lekcji

Badanie wychodzi poza surową dokładność i pyta, czy ta technologia rzeczywiście poprawia nauczanie. W miesięcznym badaniu z udziałem 200 nauczycieli akademickich języków obcych, połowa korzystała z systemu rozpoznawania emocji, a połowa prowadziła zajęcia zwyczajowo. Nauczyciele mający dostęp do informacji zwrotnej w czasie rzeczywistym zmieniali swoje plany nauczania ponad dwa razy częściej podczas lekcji, raportowali wyższą satysfakcję z nauczania i obserwowali większe zaangażowanie oraz interakcje ze strony uczniów. Badacze opracowali też prostą mapę łączącą wzorce emocji z sugerowanymi reakcjami — na przykład przejście do dyskusji lub powtórki przy pojawieniu się oznak zamieszania lub frustracji — przesuwając system od biernego obserwowania emocji ku aktywnemu kierowaniu zachowaniem.

Co to oznacza dla przyszłych klas

Mówiąc prosto, badanie sugeruje, że przyszłe sale mogą mieć cichego asystenta obserwującego twarze uczniów i podpowiadającego nauczycielowi, gdy energia w sali spada lub gdy wielu uczniów wydaje się zmieszanych. System AFCNN nie jest doskonały — wciąż ma trudności z subtelnymi emocjami, jak wstręt czy strach, oraz zależy od wysokiej jakości oznaczonych obrazów — ale pokazuje, że AI może wiarygodnie wychwytywać trendy emocjonalne, a nauczyciele mogą wykorzystać te informacje, by uczyć bardziej responsywnie. Dla uczniów może to oznaczać zajęcia bardziej angażujące i wspierające; dla nauczycieli to nowe narzędzie rozwoju zawodowego łączące psychologię, edukację i AI w inteligentniejsze, bardziej świadome ludzkich potrzeb środowisko nauczania.

Cytowanie: Shi, L. Exploring students’ emotion recognition and teachers’ teaching feedback in college foreign language classroom based on AFCNN model. Sci Rep 16, 5657 (2026). https://doi.org/10.1038/s41598-026-36747-0

Słowa kluczowe: rozpoznawanie emocji w klasie, Sztuczna inteligencja w edukacji, nauczanie języków obcych, rozwój zawodowy nauczycieli, modele uczenia głębokiego