Clear Sky Science · pl

Adaptacyjne przenoszenie usług w obliczu opóźnień i zużycia energii w mobilnym edge computingu

Dlaczego przenoszenie aplikacji bliżej użytkownika ma znaczenie

Za każdym razem, gdy grasz w grę online w samochodzie, korzystasz z nakładek AR z nawigacją na telefonie albo czujnik w inteligentnym mieście przesyła dane, te cyfrowe zadania muszą być gdzieś przetworzone. Mobilny Edge Computing (MEC) przenosi tę pracę z odległych centrów danych na małe serwery umieszczone blisko stacji bazowych, skracając opóźnienia i sprawiając, że aplikacje działają płynniej. Jednak utrzymanie usług blisko poruszających się użytkowników wymaga częstego „przenoszenia” (migracji) działających aplikacji między pobliskimi serwerami brzegowymi. Zbyt częste migracje marnują energię i pieniądze; zbyt rzadkie powodują opóźnienia i frustrację. W tej pracy badacze analizują, jak osiągnąć rozsądny kompromis przy użyciu zaawansowanego uczenia maszynowego.

Równoważenie szybkości i zużycia energii

Większość wcześniejszych badań nad migracją usług w MEC koncentrowała się głównie na jednym celu: utrzymaniu jak najniższego postrzeganego przez użytkownika opóźnienia. Zwykle oznacza to śledzenie użytkownika w miarę ruchu i wielokrotne przenoszenie jego aplikacji do najbliższego serwera. Jednak każda migracja zużywa dodatkową energię komunikacyjną i sama wprowadza opóźnienie. Wiele wcześniejszych metod zakładało też dużą dostępność zasobów serwerowych i stabilne warunki, pomijając rzeczywistość, w której serwery brzegowe mają ograniczone zasoby, konkurują o wielu użytkowników i doświadczają szybko zmieniających się obciążeń oraz jakości łączy. Autorzy argumentują, że energia migracji powinna być traktowana jako podstawowy cel na równi z opóźnieniem, a polityki migracji muszą adaptować się online do ruchu użytkowników, obciążenia serwerów i fluktuacji sieciowych.

Z problemu matematycznego do agenta uczącego się

Badacze najpierw budują szczegółowy model matematyczny systemu MEC z wieloma stacjami bazowymi, współlokowanymi serwerami brzegowymi i mobilnymi użytkownikami. Każdy użytkownik zleca zadania obliczeniowe pobliskim serwerom przez łącza bezprzewodowe. Całkowite opóźnienie usługi rozkłada się na trzy części: czas wysłania zadania do stacji bazowej, czas obliczeń na serwerze oraz czas związany z przeniesieniem usługi między serwerami przez przewodowy backhaul. Energię migracji modeluje się głównie w oparciu o ilość danych, które trzeba przesłać podczas przenoszenia usługi. Ogólnym celem jest minimalizacja zarówno opóźnienia, jak i energii migracji z zachowaniem ograniczeń mocy obliczeniowej każdego serwera i terminów jakości usług. Dokładne rozwiązanie tego mieszanego problemu całkowitoliczbowego i nieliniowego jest obliczeniowo nieosiągalne w czasie rzeczywistym, dlatego zespół sięga po głębokie uczenie przez wzmocnienie, gdzie agent uczy się dobrych decyzji poprzez interakcję z symulowanym środowiskiem.

Jak działa adaptacyjny mechanizm migracji

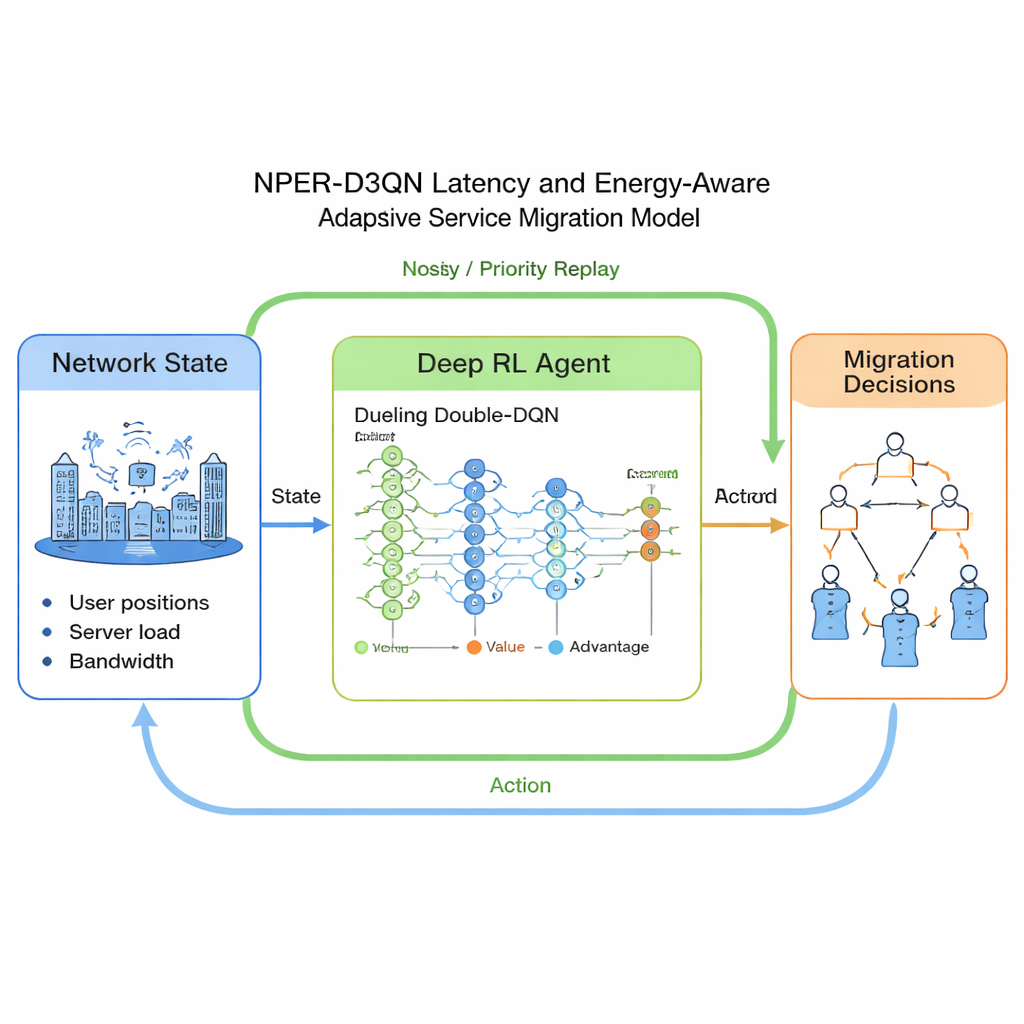

Proponowana metoda nazwana NPER‑D3QN to zaawansowana wariacja Deep Q‑Networks (DQN). Stan wejściowy agenta podsumowuje położenie użytkowników, odległość od obsługującej ich stacji bazowej, stopień obciążenia każdego serwera brzegowego, dostępną moc obliczeniową, bezprzewodowe stawki przesyłu danych oraz rozmiar i zapotrzebowanie obliczeniowe każdej usługi. „Akcje” to wybory, który serwer brzegowy powinien hostować usługę danego użytkownika w następnym przedziale czasowym. Funkcja nagrody promuje niskie opóźnienia względem terminów usług przy jednoczesnym karaniu za zużytą energię migracji, co skłania agenta do kompromisu między szybkością a zużyciem energii. Technicznie model łączy trzy koncepcje: sieć dueling, która rozdziela ocenę wartości stanu i korzyści z akcji, strukturę double Q‑learning zmniejszającą nadmiernie optymistyczne oszacowania oraz dwa mechanizmy eksploracji—szumowe sieci i priorytetowy replay doświadczeń—które przyspieszają i stabilizują naukę w złożonych, zmiennych warunkach.

Testy i wyniki

Aby ocenić metodę NPER‑D3QN, autorzy symulują układ przypominający miejską siatkę z kilkudziesięcioma stacjami bazowymi i nawet setkami mobilnych użytkowników poruszających się losowo i wysyłających zadania o zróżnicowanych rozmiarach. Serwery brzegowe mają ograniczoną moc obliczeniową i mogą hostować jedynie określoną liczbę maszyn wirtualnych, co tworzy realistyczne kolejki i konkurencję o zasoby. Porównują swoją metodę z sześcioma nowoczesnymi bazami odniesienia, w tym klasycznym DQN, ulepszonymi wariantami double‑dueling oraz schematami, które albo zawsze podążają za najbliższym serwerem, albo skupiają się wyłącznie na minimalizacji opóźnienia. W różnych scenariuszach NPER‑D3QN szybciej zbiega do dobrych strategii i konsekwentnie osiąga niższe średnie opóźnienia usług, mniejsze zużycie energii związane z migracją oraz mniej odrzuconych migracji, gdy serwery są pełne. W teście na dużą skalę z 720 użytkownikami i 96 serwerami skraca opóźnienia nawet do około dwóch trzecich i zmniejsza energię migracji o ponad 90% w porównaniu z niektórymi alternatywami, przy zachowaniu czasu obliczeń na decyzję w praktycznych granicach.

Znaczenie dla przyszłych usług sieciowych

Dla osób niezajmujących się specjalistycznie tematem główny wniosek jest taki, że samo przybliżenie aplikacji do użytkowników nie wystarczy: potrzebna jest też inteligentna kontrola, kiedy i gdzie przenosić działające usługi. Praca pokazuje, że sterownik oparty na uczeniu może „żonglować” sprzecznymi celami: szybkością reakcji, oszczędnością energii i ograniczoną pojemnością edge bez ręcznie tworzonego zestawu reguł. Jeśli podobne systemy zostaną wdrożone w rzeczywistych sieciach, mogą pomóc operatorom zapewnić płynniejsze doświadczenia dla aplikacji takich jak autonomiczne prowadzenie, immersyjne AR czy przemysłowy IoT, przy jednoczesnym ograniczeniu rachunków za prąd i obciążenia infrastruktury. Autorzy zaznaczają, że ich badanie bazuje na symulacjach i pomija niektóre szczegóły świata rzeczywistego, takie jak pełne zużycie mocy serwerów czy niedoskonałe monitorowanie, lecz stanowi obiecujący krok w stronę bardziej energooszczędnego i adaptowalnego edge computingu.

Cytowanie: Li, L., Lv, J., Wang, S. et al. Latency and energy-aware adaptive service migration in mobile edge computing. Sci Rep 16, 6178 (2026). https://doi.org/10.1038/s41598-026-36711-y

Słowa kluczowe: mobilny edge computing, migracja usług, głębokie uczenie przez wzmocnienie, optymalizacja opóźnień, efektywność energetyczna