Clear Sky Science · pl

Algorytm optymalizacji sekantowej dla efektywnej optymalizacji globalnej

Inteligentniejsze przeszukiwanie trudnych problemów

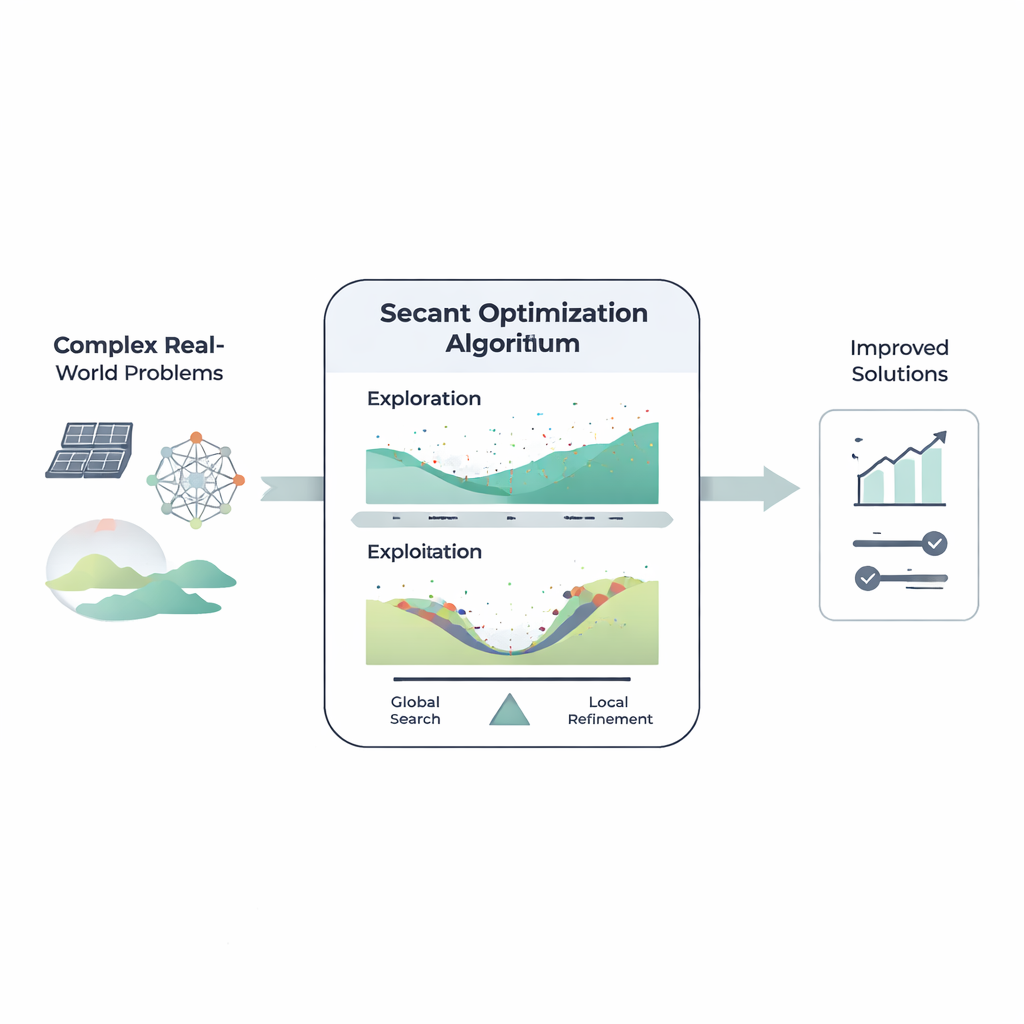

Od projektowania bardziej wydajnych paneli słonecznych po trenowanie precyzyjnych systemów rozpoznawania obrazów — wiele współczesnych wyzwań sprowadza się do jednego zadania: przeszukania ogromnej przestrzeni możliwości w celu znalezienia dobrego rozwiązania. W artykule przedstawiono Algorytm Optymalizacji Sekantowej (SOA), nowy sposób prowadzenia takiego przeszukiwania bardziej wydajnie. Zainspirowany klasyczną ideą z rachunku różniczkowego, lecz zaprojektowany z myślą o złożonych, rzeczywistych danych, SOA ma być zarówno szybki, jak i niezawodny tam, gdzie tradycyjne metody zawodzą.

Dlaczego optymalizacja potrzebuje nowych pomysłów

Współczesne problemy inżynieryjne i z zakresu nauki o danych często obejmują dziesiątki lub setki regulowanych ustawień, wiele celów oraz powiązania trudne do opisania prostymi wzorami. Klasyczne techniki wykorzystujące dokładne gradienty, takie jak najszybsze spadki, mogą zawodzić, gdy krajobraz jest chropowaty, pełen lokalnych pułapek lub gdy pochodne są trudne lub niemożliwe do obliczenia. W odpowiedzi badacze opracowali algorytmy „metaheurystyczne”, które naśladują naturę, fizykę lub matematyczne strategie, aby eksplorować takie skomplikowane przestrzenie. Metody te, jak algorytmy genetyczne czy optymalizatory rojowe, okazały się niezwykle uniwersalne, lecz wciąż muszą godzić kompromisy między szerokim przeszukiwaniem a precyzyjnym zawężaniem.

Zmiana podręcznikowego triku w silnik wyszukiwania

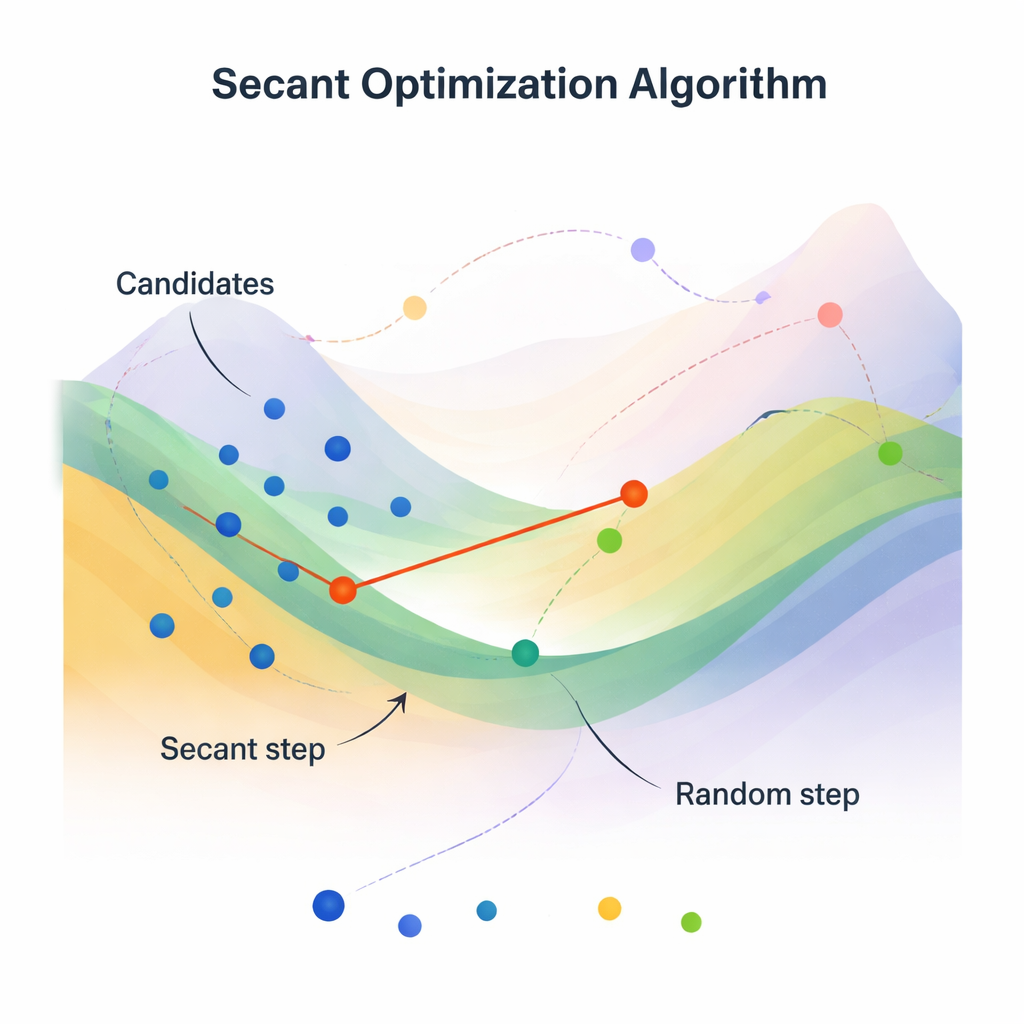

Rdzeń SOA stanowi metoda sekantowa, stary numeryczny trik służący do znajdowania miejsc zerowych funkcji bez potrzeby używania dokładnych pochodnych. Zamiast polegać na nachyleniu obliczonym z rachunku, metoda sekantowa rysuje prostą między dwoma pobliskimi punktami na wykresie i używa jej jako przybliżonego nachylenia. SOA uogólnia tę ideę na wiele wymiarów i dużą liczbę kandydatów jednocześnie. Utrzymuje populację wektorów (możliwych rozwiązań) i wielokrotnie aktualizuje je, stosując kroki podobne do sekantowych, które przybliżają trend funkcji celu wyłącznie na podstawie wartości funkcji. Dzięki temu metoda jest atrakcyjna w sytuacjach, gdzie gradienty są zaszumione, drogie w obliczeniu lub nieokreślone, na przykład przy strojenie hiperparametrów sieci neuronowych na podstawie błędu walidacji.

Równoważenie szerokiej eksploracji z precyzyjnym zawężaniem

Projekt SOA wyraźnie rozdziela sposoby eksploracji i zawężania. W fazie eksploracji każdy kandydat jest modyfikowany za pomocą reguły opartej na sekantach, która łączy informacje z obecnie najlepszym rozwiązaniem, z danym wektorem oraz z losowo wybranym „równorzędnym” osobnikiem. To pomaga kierować poszukiwaniem w obiecujące kierunki, bez polegania wyłącznie na losowości. W fazie eksploatacji SOA wprowadza „czynnik ekspansji” i kontrolowaną losowość. Popycha rozwiązania w stronę najlepszego, średniego, najbliższego, a nawet najbardziej odległego punktu w populacji, mieszając to z losowymi spacerami. Prosta reguła mutacji okazjonalnie zachowuje starą pozycję zamiast nowej, co utrzymuje różnorodność. Te mechaniki razem pomagają SOA wydostać się z lokalnych pułapek, jednocześnie doprowadzając do wysokiej jakości rozwiązań.

Testy na benchmarkach i rzeczywistych urządzeniach

Aby sprawdzić, czy SOA to coś więcej niż sprytny pomysł na papierze, autorzy testują go na powszechnie używanych rodzinach benchmarków znanych jako CEC2021 i CEC2020. Funkcje te zostały zaprojektowane tak, by być wymagającymi: niektóre mają niską liczbę wymiarów, lecz są pełne fałszywych minimów; inne sięgają 50 lub 100 wymiarów. W tych testach SOA porównuje się z dwiema grupami konkurencyjnych algorytmów, obejmującymi 11 metod inspirowanych matematyką oraz 9 nowszych lub zmodyfikowanych optymalizatorów. Korzystając ze statystyk takich jak średni błąd, zmienność, krzywe zbieżności i testy rangowe, SOA konsekwentnie dorównuje lub przewyższa większość rywali, szczególnie w szybkim i niezawodnym osiąganiu dobrych rozwiązań. Autorzy wychodzą poza syntetyczne testy do dwóch wymagających zadań rzeczywistych: estymacji kluczowych parametrów w modelach fotowoltaicznych (PV) oraz automatycznego strojenia hiperparametrów konwolucyjnych sieci neuronowych dla kilku zbiorów obrazów.

Od paneli słonecznych po sieci neuronowe

W energetyce słonecznej dokładne modele ogniw i modułów PV są niezbędne do przewidywania mocy i optymalizacji działania. Zespół zastosował SOA do kilku standardowych modeli PV, w tym modelu z pojedynczą diodą, podwójną diodą oraz pełnych opisów modułów. Korzystając z mierzonych danych prąd–napięcie, SOA dopasowuje parametry modelu, aby zminimalizować błąd i wykazano, że osiąga mniejsze lub porównywalne błędy średniokwadratowe w porównaniu z szeregiem ugruntowanych optymalizatorów. W eksperymentach z uczeniem maszynowym SOA wykorzystano do strojenia architektury i ustawień treningowych konwolucyjnej sieci neuronowej na zbiorach MNIST i powiązanych zestawach obrazów. Tam również algorytm znajduje kombinacje hiperparametrów, które dają konkurencyjne lub lepsze dokładności klasyfikacji w porównaniu z innymi automatami wyszukiwania.

Co to oznacza w praktyce

Dla osób niebędących specjalistami główny przekaz jest taki, że SOA oferuje praktyczny nowy „silnik wyszukiwania” dla trudnych problemów optymalizacyjnych, gdzie krajobraz jest chropowaty, a gradienty nie są dostępne. Dzięki zapożyczeniu geometrii metody sekantowej i osadzeniu jej w przeszukiwaniu opartym na populacji z dobrze zrównoważoną losowością, algorytm często zbiega szybciej i dokładniej niż wiele obecnych alternatyw. Ponieważ jest stosunkowo prosty, wolny od pochodnych i nie wymaga dużej liczby parametrów do strojenia, SOA można zastosować w różnych dziedzinach — od projektowania wydajniejszych systemów fotowoltaicznych po konfigurację modeli uczenia głębokiego — co czyni go obiecującym narzędziem dla inżynierów i naukowców danych.

Cytowanie: Ibrahim, M.Q., Qaraad, M., Hussein, N.K. et al. Secant Optimization Algorithm for efficient global optimization. Sci Rep 16, 6659 (2026). https://doi.org/10.1038/s41598-026-36691-z

Słowa kluczowe: optymalizacja globalna, algorytmy metaheurystyczne, algorytm optymalizacji sekantowej, modelowanie fotowoltaiczne, strojenie hiperparametrów