Clear Sky Science · pl

Lekki model oparty na YOLO do dokładnego wykrywania gron czerwonego pieprzu w robotycznych zbiorach

Inteligentniejsze roboty do pikantnych zbiorów

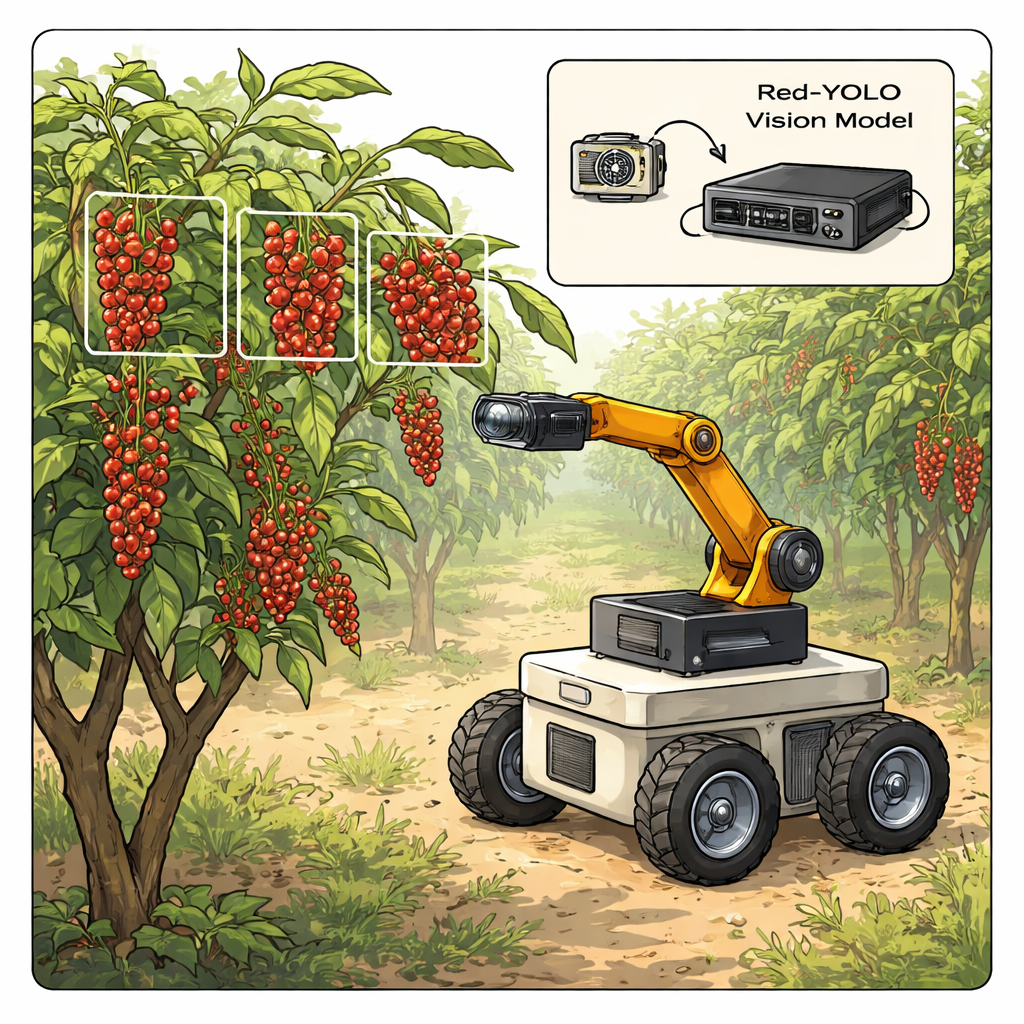

Pestki pieprzu syczuańskiego, drobne czerwone łupinki, które nadają kuchni syczuańskiej charakterystyczne mrowienie, są zaskakująco trudne do zrywania. Owoce rosną w gęstych, kolczastych gronach, które łatwo uszkodzić, a zbiór ręczny jest powolny i sezonowy. W tym badaniu przedstawiono nowy system widzenia komputerowego nazwany Red-YOLO, zaprojektowany, by pomóc małym, mobilnym robotom szybko i precyzyjnie wykrywać te delikatne grona w rzeczywistych sadach, nawet gdy owoce zachodzą na siebie lub są ukryte za liśćmi.

Dlaczego zbieranie papryki jest takie trudne

W przeciwieństwie do dużych, gładkich owoców, takich jak jabłka, czerwone pestki pieprzu rosną jako wiele drobnych jagód ściśniętych razem na kolczastych gałęziach. Grona mogą się znacznie różnić między drzewami: niektóre są zwarte i kompaktowe, inne luźne i rozproszone, a wszystkie otoczone są mylącym tłem gałęzi, liści i zmiennego oświetlenia. Dla robota ważne jest, by odróżnić, gdzie jedno grono się kończy, a inne zaczyna — oraz jak ciasno owoce są upakowane. Siła chwytu, a nawet rozmiar narzędzia zbierającego, muszą się zmieniać w zależności od stopnia zagęszczenia, inaczej delikatne pęcherzyki oleju w owocach mogą pęknąć, pogarszając jakość i wartość plonu.

Budowa biblioteki obrazów dla świata rzeczywistego

Ponieważ nie istniały publiczne zbiory zdjęć dla tej uprawy, badacze musieli najpierw stworzyć własny zestaw danych. Przez dwa sezony wegetacyjne w powiecie Hanyuan w Syczuanie fotografowali drzewa pieprzowe w rzeczywistych sadach za pomocą smartfona konsumenckiego, uzyskując 960 wysokorozdzielczych, kwadratowych zdjęć wykonanych pod różnymi kątami słońca i o różnych porach dnia. Każde zdjęcie zostało starannie oznaczone ręcznie, rozróżniając grona zwarte i rozproszone. Aby nauczyć system radzenia sobie z różnorodnością, wiele obrazów zmodyfikowano cyfrowo — dostosowując jasność i kontrast, odbijając poziomo, deformując niektóre siatki i obracając ujęcia. To powiększyło zestaw treningowy do ponad 4 300 obrazów, a niewielką pulę niezmienionych zdjęć odłożono na bok, by uczciwie przetestować, jak dobrze system sprawdzi się w praktyce.

Bardziej szczupły i ostrzejszy model widzenia komputerowego

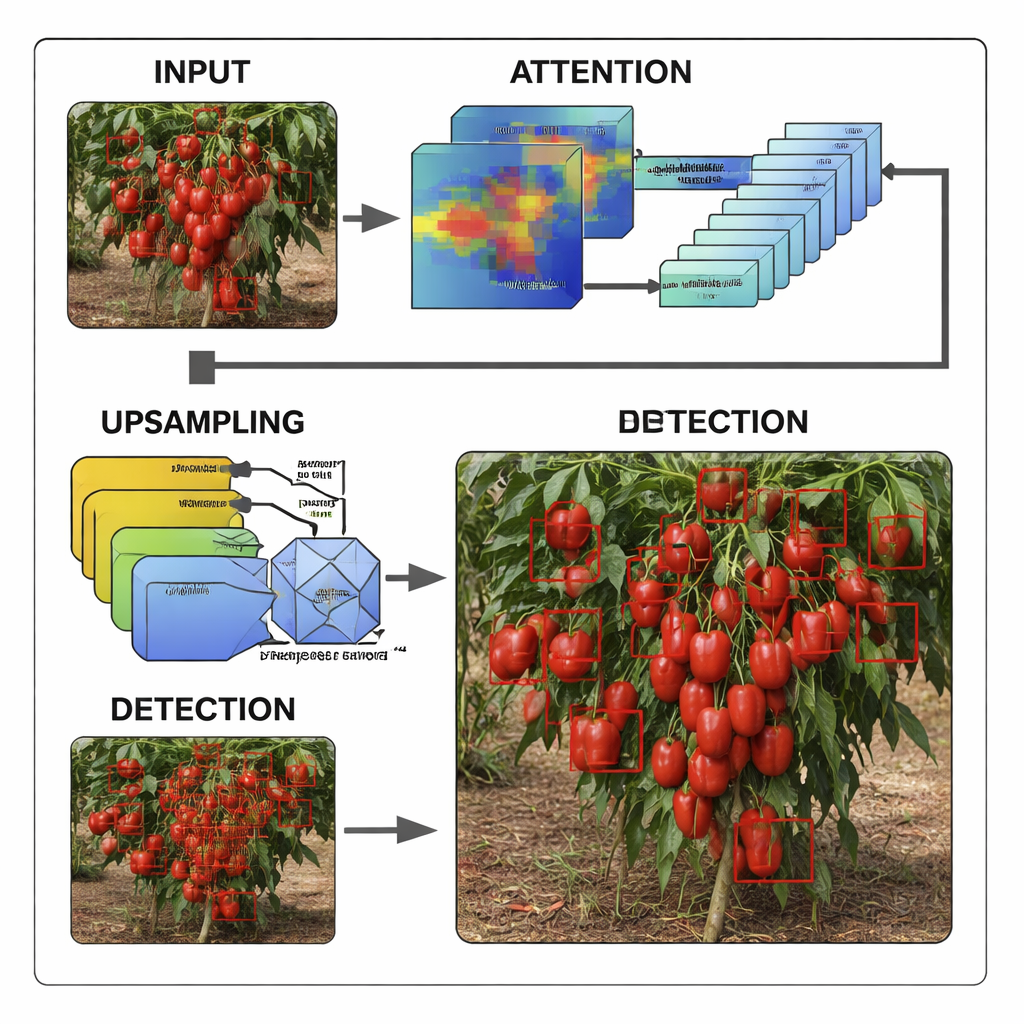

W sercu systemu leży YOLOv8, szeroko stosowany model detekcji obiektów „you only look once”, który znajduje obiekty w jednym, szybkim przejściu zamiast w kilku wolniejszych etapach. Zespół dostosował bardzo małą wersję tego modelu, a następnie przekształcił ją specjalnie pod kątem gron czerwonego pieprzu. Dodano moduł uwagi, który uczy sieć koncentrowania się na kanałach i obszarach najprawdopodobniej zawierających owoce, ignorując rozpraszające elementy takie jak niebo, gałęzie czy odległe drzewa. Przeprojektowano fragmenty sieci tak, aby mogła efektywniej ponownie wykorzystywać informacje i ograniczyć niepotrzebne obliczenia. Zastąpiono także prosty etap zmiany rozmiaru sprytniejszym blokiem upsamplingu, który odtwarza drobne detale i krawędzie wokół zachodzących na siebie papryk, pomagając modelowi rozróżnić, gdzie zaczynają się i kończą zatłoczone grona.

Szybkie, dokładne widzenie dla małych robotów

Aby sprawdzić, czy te zmiany miały sens, badacze porównali Red-YOLO zarówno ze starszymi, cięższymi systemami detekcji, jak i z szeregiem nowoczesnych, lekkich wariantów YOLO. Tradycyjne modele wieloetapowe, choć potężne, były po prostu zbyt wolne i zasobożerne dla kompaktowych robotów sadowniczych. Kilka nowszych wersji YOLO wypadło lepiej, ale miało problemy z małymi, częściowo ukrytymi gronami lub z zajętym tłem, często pomijając owoce lub biorąc liście za papryki. Red-YOLO osiągnął lepszy kompromis: wykrywał grona papryki z wyższą ogólną dokładnością i przywołaniem niż wszystkie porównywane modele, przy jednoczesnym utrzymaniu rozmiaru modelu poniżej trzech milionów parametrów i obciążeniu obliczeniowym wystarczająco niskim dla procesorów wbudowanych. Testy w zróżnicowanych scenach sadów wykazały, że Red-YOLO konsekwentnie odnajduje grona nawet gdy owoce są bardzo małe, zacienione lub silnie nachodzą na siebie.

Z modelu laboratoryjnego do pomocnika w sadzie

Dla osób spoza specjalizacji kluczowy wynik jest praktyczny: praca ta pokazuje, że kompaktowy, starannie dopracowany system widzenia może dać małym robotom zbierającym niezawodne „oko” w polu. Dzięki Red-YOLO robot może automatycznie rozpoznać, czy ma do czynienia z gronem zwartym, czy rozproszonym, i dostosować rozmiar chwytaka oraz siłę chwytu przed zbieraniem, zmniejszając uszkodzenia i oszczędzając pracę. Choć obecne badanie koncentruje się na jednej odmianie papryki w jednym regionie, ta sama metoda — budowanie ukierunkowanych zbiorów danych i udoskonalanie szczupłych modeli detekcji — mogłaby zostać rozszerzona na inne specjalistyczne uprawy. W miarę jak te systemy widzenia staną się bardziej odporne i szerzej stosowane, mogą przyczynić się do szybszych, bezpieczniejszych i bardziej spójnych zbiorów, zapewniając stałe dostawy papryk, które napędzają jedne z ulubionych smaków na świecie.

Cytowanie: Zhao, H., He, J., Li, Y. et al. A lightweight YOLO-based model for accurate detection of red pepper clusters in robotic harvesting. Sci Rep 16, 5879 (2026). https://doi.org/10.1038/s41598-026-36671-3

Słowa kluczowe: robotyczne zbiory, wykrywanie papryki, widzenie komputerowe, lekki YOLO, inteligentne rolnictwo