Clear Sky Science · pl

Wydajny, beztrenigowy proces do solidnej charakteryzacji losowych sygnałów telegraficznych przez adaptacyjne odszumianie falowe i bayesowskie metody cyfryzacji

Dlaczego drobne migotania sygnału mają znaczenie

W nowoczesnej elektronice, a nawet w żywych komórkach, istotne zdarzenia mogą wyglądać jak drobne kliknięcia w czasie: sygnał nagle przeskakuje w górę, utrzymuje się tam przez chwilę, a potem wraca. Te skoki, znane jako losowe sygnały telegraficzne, mogą ujawniać, kiedy pojedynczy defekt w układzie łapie elektron, albo kiedy w maszynie molekularnej zachodzi przełączenie stanu. W rzeczywistych pomiarach skoki te są jednak pogrzebane w szumie oraz zakłóceniach z wielu źródeł. Artykuł przedstawia szybki, beztrenigowy proces analizy, który automatycznie oczyszcza takie dane, odzyskuje ukryte wzorce skoków i robi to wystarczająco niezawodnie dla przyszłych technologii, takich jak urządzenia kwantowe czy sensory nowej generacji.

Dostrzeganie skoków w morzu szumu

Losowy sygnał telegraficzny przypomina światło, które losowo przełącza się między dwoma lub większą liczbą poziomów jasności. Z tych wzorców przełączeń badacze mogą wywnioskować, jak długo defekt lub miejsce molekularne zwykle pozostaje „włączone” lub „wyłączone” oraz jak silny jest jego wpływ. Ta informacja bezpośrednio odnosi się do niezawodności tranzystorów na poziomie nano, matryc obrazujących i kubitów kwantowych. Problem polega na tym, że rzeczywiste sygnały rzadko bywają czyste: są zmieszane z szumem „białym”, rozkładającym się równomiernie po wszystkich częstotliwościach, oraz z szumem „różowym” lub 1/f, który dryfuje powoli i może całkowicie ukryć podstawowe skoki. W miarę jak urządzenia kurczą się, a my monitorujemy je z coraz większą rozdzielczością czasową, te źródła szumu zyskują na znaczeniu, co utrudnia odróżnienie prawdziwych zdarzeń fizycznych od tła.

Sprytniejszy proces oczyszczania i zliczania

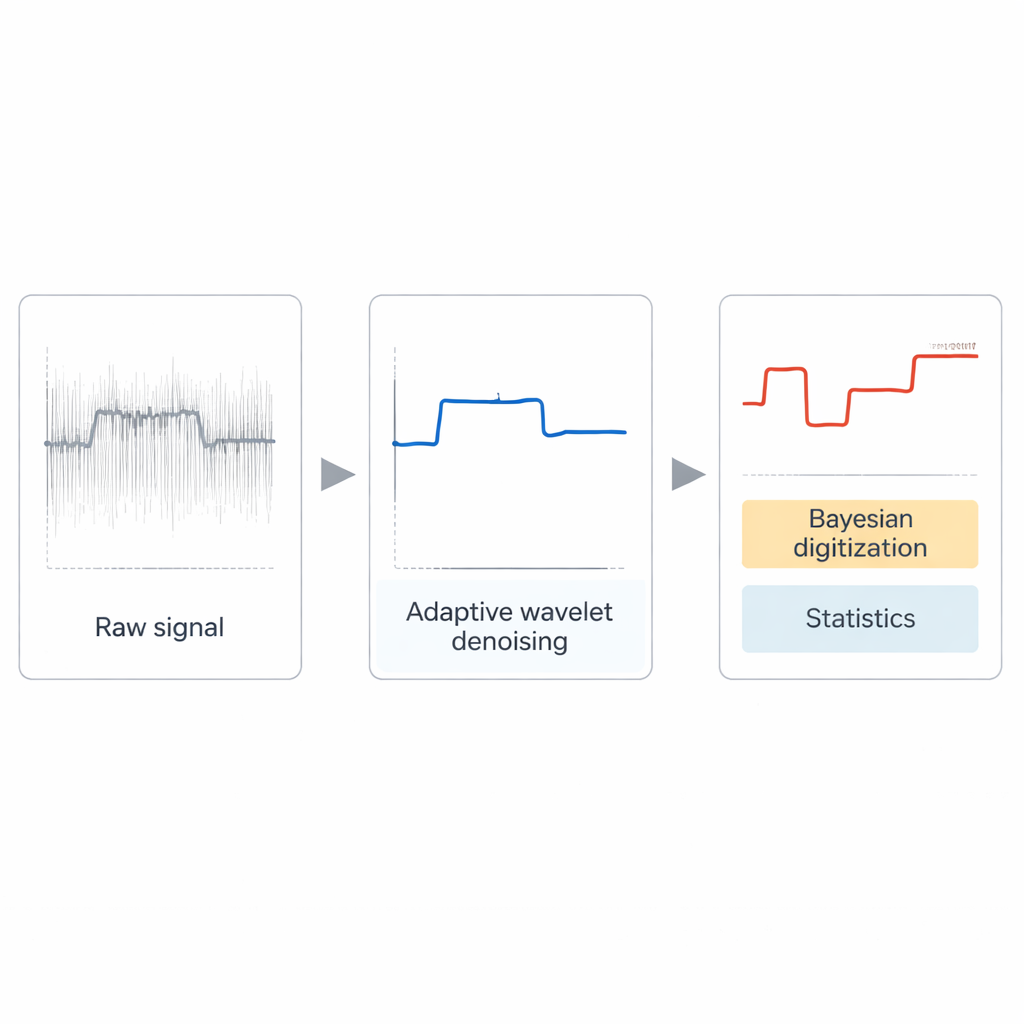

Autorzy proponują trzystopniowy, modułowy proces działający bez żadnego trenowania maszynowego. Najpierw zaawansowane narzędzie oparte na falkach — dual-tree complex wavelet transform — adaptacyjnie odszumia surowy sygnał. Ustawienia są wybierane automatycznie na podstawie prostych właściwości danych, więc użytkownicy nie muszą ręcznie stroić parametrów. Ten etap jest szczególnie dobry w usuwaniu szybkiego, białego szumu przy zachowaniu ostrych krawędzi rzeczywistych skoków. Następnie oczyszczony sygnał jest analizowany statystycznie, aby odnaleźć najczęściej występujące poziomy amplitudy, jakby identyfikować najczęściej odwiedzane szczeble drabiny. Na koniec lekki krok bayesowski przekształca wygładzony sygnał w cyfrowy zapis, który poziom jest aktywny w danym momencie, i oblicza, jak długo zwykle trwa każdy stan.

Weryfikacja metody

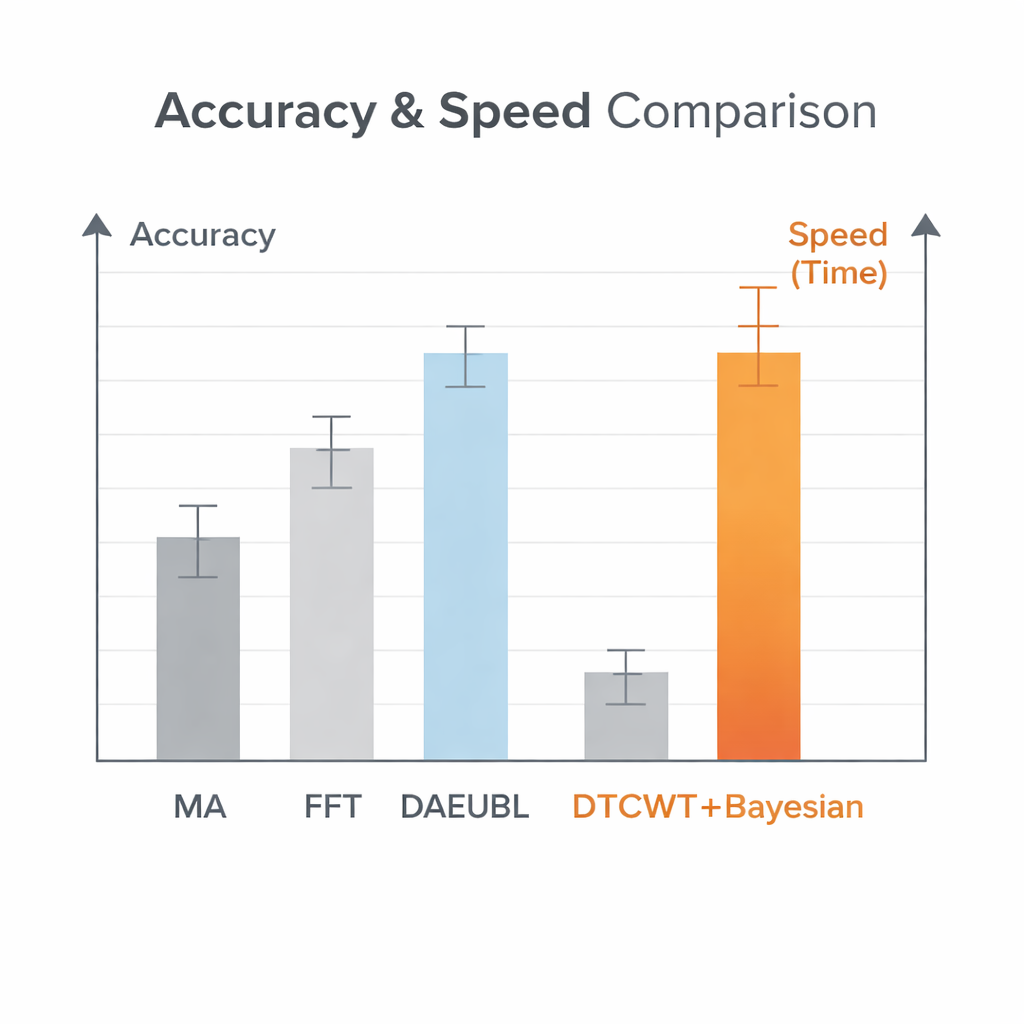

Aby ocenić skuteczność procesu, zespół zbudował duże zbiory danych syntetycznych, w których prawdziwe wzorce skoków były znane z góry. Wygenerowali tysiące losowych sygnałów telegraficznych z jednym, dwoma lub trzema niezależnymi „pułapkami”, a następnie dodali kontrolowane ilości białego lub różowego szumu. Pozwoliło to sprawdzić, jak dokładnie różne metody odtwarzają kluczowe wielkości: liczbę aktywnych pułapek, wielkość każdego skoku, ułamek czasu, gdy dany stan jest aktywny, oraz jak długo sygnał utrzymuje się w każdym stanie przed przełączeniem. Porównali cztery kompletne workflow: proste filtrowanie średnią kroczącą, filtrowanie w dziedzinie częstotliwości, wydajny odszumiacz oparty na sieci neuronowej oraz ich nowy proces falkowo‑bayesowski. Choć sieć neuronowa osiągnęła najwyższy wynik w podstawowym wskaźniku stosunku sygnału do szumu, nowa metoda bardziej konsekwentnie identyfikowała poprawną liczbę pułapek, dokładniej szacowała wielkości skoków i pozostawała odporna nawet przy bardzo wysokich poziomach szumu lub przy dominującym szumie różowym.

Szybka wystarczająco dla urządzeń w czasie rzeczywistym

Poza dokładnością, krytyczne są szybkość i wymagania pamięciowe przy bardzo długich nagraniach. Jedno stu‑sekundowe pomiar przy rozdzielczości nanosekundowej może zawierać miliardy punktów danych, co jest zbyt dużo dla wielu modeli sieci neuronowych, by przetworzyć w rozsądnym czasie. Proponowany proces przetwarza długie sygnały do około 83 razy szybciej niż bazowa metoda neuronowa, kosztem użycia do trzech razy więcej pamięci — wciąż praktyczny kompromis na współczesnym sprzęcie. Autorzy zastosowali też swoją metodę do rzeczywistych danych z urządzeń z nanorurek węglowych pracujących w niskich temperaturach. Pomimo braku „prawdy obiektywnej” w tych eksperymentach, pipeline generuje czytelne, interpretowalne wzorce skoków i rozsądne statystyki stanów bez żadnego retreningu czy strojenia pod konkretne urządzenie, oferując jednocześnie pokrętła dla ekspertów chcących badać alternatywne interpretacje.

Co to oznacza na przyszłość

Mówiąc prosto, praca dostarcza niezawodnego „detektora kliknięć” dla bardzo zaszumionych, szybkich pomiarów. Pokazuje, że przy starannie zaprojektowanych, beztrenigowych narzędziach badacze mogą automatycznie oczyszczać złożone losowe sygnały telegraficzne, poprawnie zliczać, ile niezależnych miejsc przełączeń jest obecnych, oraz mierzyć, jak silnie i jak często działają. Ponieważ metoda jest szybka, przejrzysta i łatwa do dostosowania, może stać się podstawą przyszłych zautomatyzowanych stanowisk testowych dla produkcji półprzewodników, kwantowych generatorów liczb losowych oraz badań zmiennych sygnałów w chemii i biologii. Zamiast być jednorazowym trikiem, pipeline służy jako fundament, na którym można budować bardziej wyspecjalizowane lub inteligentniejsze moduły dla coraz bardziej złożonych urządzeń.

Cytowanie: Bai, T., Kapoor, A. & Kim, N.Y. A high-performance training-free pipeline for robust random telegraph signal characterization via adaptive wavelet-based denoising and Bayesian digitization methods. Sci Rep 16, 7455 (2026). https://doi.org/10.1038/s41598-026-36656-2

Słowa kluczowe: losowy sygnał telegraficzny, odszumianie sygnału, analiza bayesowska, szum półprzewodnikowy, szereg czasowy