Clear Sky Science · pl

Zautomatyzowane rozwiązanie do nauczania Koranu osób niesłyszących oparte na klasyfikacji pozy ciała i integracji arabskiego języka migowego

Otwierając święty tekst dla milczących głosów

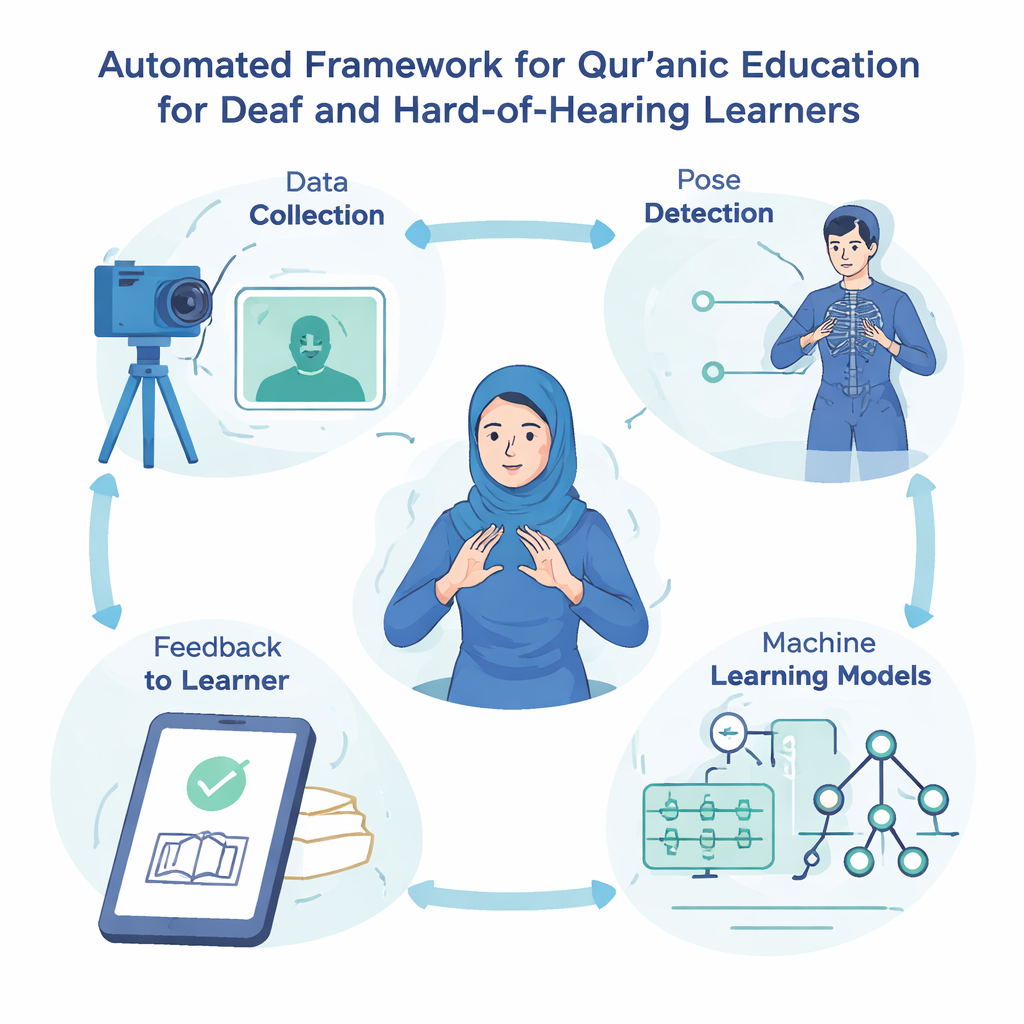

Dla wielu muzułmanów głuchych i niedosłyszących nauka recytacji Koranu może być niezwykle trudna, ponieważ tradycyjne nauczanie opiera się na słuchaniu i powtarzaniu. Badanie przedstawia narzędzie oparte na technologii, które „widzi” gesty arabskiego języka migowego i łączy je z wersetami z krótkiego rozdziału Koranu. Przekształcając ruchy ciała w pomost między znakiem a tekstem religijnym, ma na celu uczynienie nauki religii bardziej inkluzywną dla milionów osób, które komunikują się przede wszystkim za pomocą migowego języka.

Dlaczego uczniowie z ubytkiem słuchu bywają wykluczeni

Głusi muzułmanie często polegają na gestach i migowym języku w komunikacji, tymczasem większość nauczania Koranu opiera się na dźwięku — nauczyciele recytują na głos, uczniowie naśladują melodię i wymowę. Rodziny mogą nie znać języka migowego dobrze, a wykwalifikowanych tłumaczy migowych brakuje, zwłaszcza w zakresie materiałów religijnych. W efekcie wielu wiernych z ubytkiem słuchu ma utrudniony dostęp do tego samego poziomu edukacji duchowej co ich słyszący rówieśnicy. Ostatnie postępy w wizji komputerowej i sztucznej inteligencji, potrafiące rozpoznawać ruchy rąk i ciała na obrazach z kamery, oferują sposób, by to zmienić, przekształcając język migowy w coś, co komputer może rozumieć i na co może reagować w czasie rzeczywistym.

Przekształcanie gestów w jednostki dydaktyczne

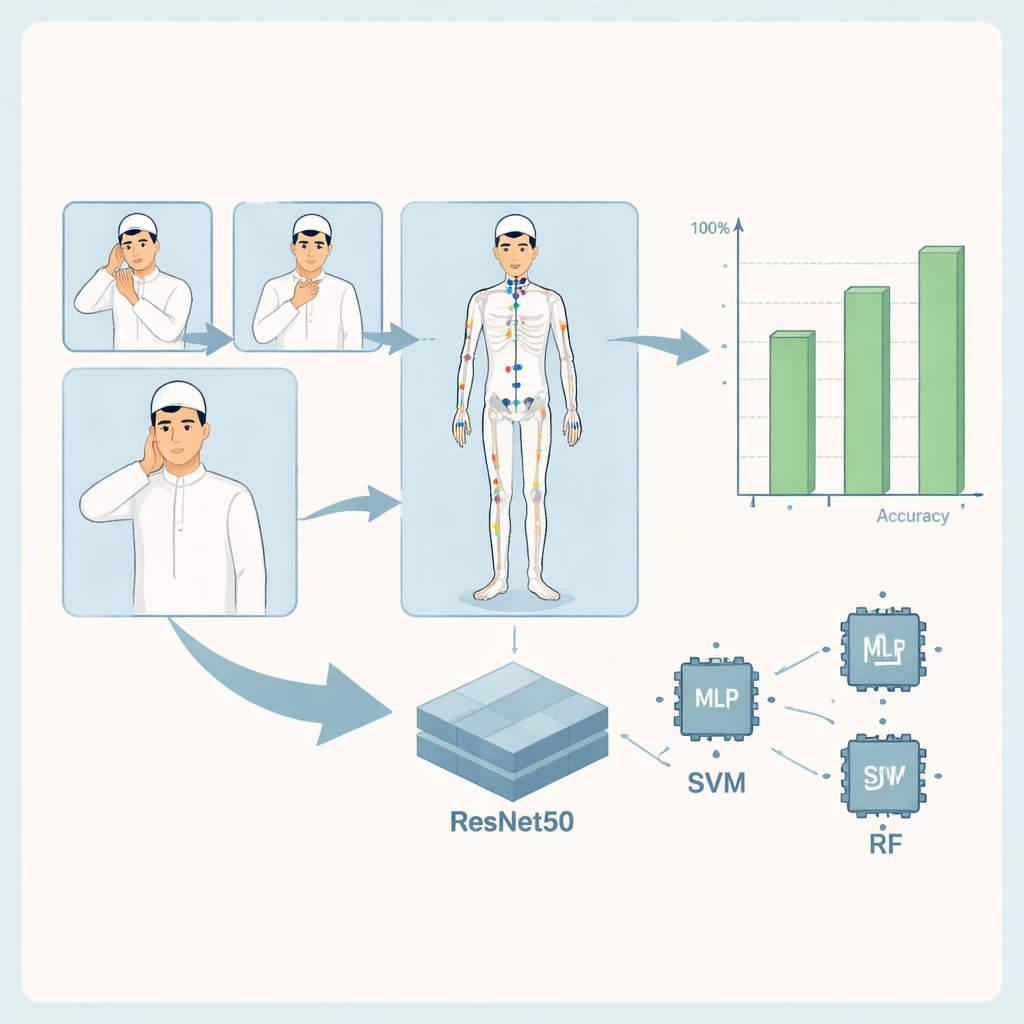

Badacze skupili się na Sūrat al-Ikhlāṣ, krótkim, lecz teologicznie bogatym rozdziale, który wielu muzułmanów zapamiętuje we wczesnym wieku. Współpracując z instytucjami obsługującymi użytkowników głuchych w Egipcie, zarejestrowali 2 054 obrazy gestów arabskiego języka migowego odpowiadających poszczególnym słowom Koranu z tego rozdziału. Aby uniknąć nieporozumień dotyczących znaczenia i wymowy, każdy gest opisano zarówno pismem arabskim, jak i ustandaryzowanym systemem transliteracji szeroko stosowanym w akademickich studiach islamskich. Takie staranne oznakowanie gwarantuje, że system łączy każdy znak z właściwym terminem koranicznym, przy zachowaniu elastyczności umożliwiającej rozszerzenie na kolejne sury w przyszłości.

Jak komputer uczy się rozpoznawać pobożne pozy

Rdzeniem systemu jest wizualny łańcuch przetwarzania, który najpierw wykrywa pozę migającej osoby, a następnie klasyfikuje, które słowo koraniczne jest podpisywane. Wszystkie obrazy są zmieniane do jednego rozmiaru i oczyszczane do standardowego formatu. Zestaw narzędzi programowych o nazwie MediaPipe identyfikuje 33 kluczowe punkty na ciele — takie jak ramiona, łokcie i nadgarstki — i śledzi ich położenie. Te współrzędne tworzą zwarte opisanie każdej pozy, które jest następnie przekazywane do trzech typów modeli uczenia maszynowego: niestandardowego wielowarstwowego perceptronu (prostej sieci neuronowej), maszyny wektorów nośnych oraz lasu losowego złożonego z wielu małych drzew decyzyjnych. Równolegle potężniejszy model głębokiego uczenia, ResNet50, analizuje pełny obraz, ucząc się szczegółowych wzorców wizualnych związanych z każdym słowem.

Zadziwiająco dokładne rozpoznawanie znaków koranicznych

Aby przetestować system, autorzy podzielili swój zbiór danych na zestawy treningowy, walidacyjny i testowy i ocenili, jak dokładnie każdy model rozpoznaje gesty. Wszystkie podejścia osiągnęły dobre wyniki, przy czym modele oparte na pozach poprawnie identyfikowały większość znaków w 14–16 klasach słów koranicznych. Model lasu losowego, na przykład, uzyskał niemal doskonałe wyniki dla wielu słów, z jedynie kilkoma pomyłkami między wizualnie podobnymi gestami. Skomponowany model oparty na ResNet50, który analizuje obrazy bezpośrednio, jednocześnie korzystając z informacji o pozach, osiągnął niemal bezbłędną wydajność na danych testowych: każdy gest został sklasyfikowany poprawnie, a standardowe miary — dokładność, precyzja, recall oraz miara dyskryminacyjna ROC–AUC — osiągnęły wartości maksymalne. Wyniki te sugerują, że nawet stosunkowo niewielkie zbiory obrazów, jeśli są starannie przygotowane, mogą wspierać bardzo dokładne rozpoznawanie religijnego języka migowego.

Obietnica, ograniczenia i dalsza droga

Chociaż wyniki są imponujące, autorzy podkreślają, że dotyczą jedynie kontrolowanych warunków ich badania: pojedynczego rozdziału, ograniczonej liczby migających osób oraz statycznych obrazów zamiast ciągłego migania w ruchu. Zastosowanie w rzeczywistych warunkach wymagałoby większych, bardziej zróżnicowanych zbiorów danych, lepszego pokrycia ruchów dolnej części ciała oraz starannych testów z migającymi z różnych regionów. Niemniej praca pokazuje, że nowoczesne narzędzia wizji i uczenia mogą wiarygodnie rozpoznawać znaki koraniczne i zapewniać natychmiastową informację zwrotną — na przykład przez pokazanie znaku „check” lub animacji korygującej, gdy uczeń wykona gest. W praktycznym wymiarze oznacza to, że osoba głucha mogłaby ćwiczyć wersety koraniczne na znak przed prostą kamerą i otrzymywać wskazówki bez potrzeby obecności tłumacza — ważny krok w kierunku udostępnienia wiedzy świętej dla wszystkich.

Cytowanie: AbdElghfar, H., Youness, H.A., Wahba, M. et al. An automated framework for qur’anic education of the hearing-impaired using body pose classification and Arabic sign language integration. Sci Rep 16, 5939 (2026). https://doi.org/10.1038/s41598-026-36578-z

Słowa kluczowe: Nauczanie Koranu, Arabski język migowy, uczniowie z ubytkiem słuchu, rozpoznawanie poz, technologie wspomagające