Clear Sky Science · pl

Konfiguracyjne efekty innowacyjności osobistej, poczucia własnej skuteczności i postrzeganego ryzyka na przyjmowanie AI przez studentów mediów

Dlaczego to ma znaczenie dla mediów jutra

Sztuczna inteligencja przestała być jedynie futurystycznym nagłówkiem dla redakcji i studiów filmowych — staje się podstawowym narzędziem, które dzisiejsi studenci mediów muszą zdecydować, czy i jak wykorzystywać. W tym badaniu autorzy przyglądają się z bliska, co napędza lub blokuje te decyzje. Na podstawie analizy setek studentów kierunków medialnych w Chinach ujawniają, jak ciekawość, pewność siebie i obawy wzajemnie się przeplatają i wpływają na to, czy młodzi dziennikarze, producenci i twórcy treści rzeczywiście wdrażają AI w swojej codziennej pracy.

Ciekawe umysły w sali wykładowej napędzanej AI

Przemysł medialny szybko przesuwa się w kierunku współpracy człowieka z maszyną: algorytmy rekomendują materiały, generują obrazy, a nawet szkicują teksty informacyjne. Tymczasem szkoły medialne mają trudności z nadążeniem, często wprowadzając zagadnienia związane z AI fragmentarycznie i skupiając się bardziej na narzędziach niż na motywacjach studentów. Badanie to argumentuje, że aby przygotować przyszłych profesjonalistów mediów, edukatorzy muszą rozumieć nie tylko to, co AI potrafi, ale też jak studenci czują się wobec jej używania. Badacze rozszerzają klasyczny model z badań nad technologią, Model Akceptacji Technologii, o trzy czynniki ludzkie szczególnie istotne w kontekście AI: innowacyjność osobistą (jak chętni są studenci do wypróbowywania nowości), samoefektywność w zakresie AI (jak kompetentnie czują się w korzystaniu z AI) oraz postrzegane ryzyko (jak niebezpieczną lub niepokojącą uważają AI).

Co kształtuje pierwsze wrażenia studentów o AI

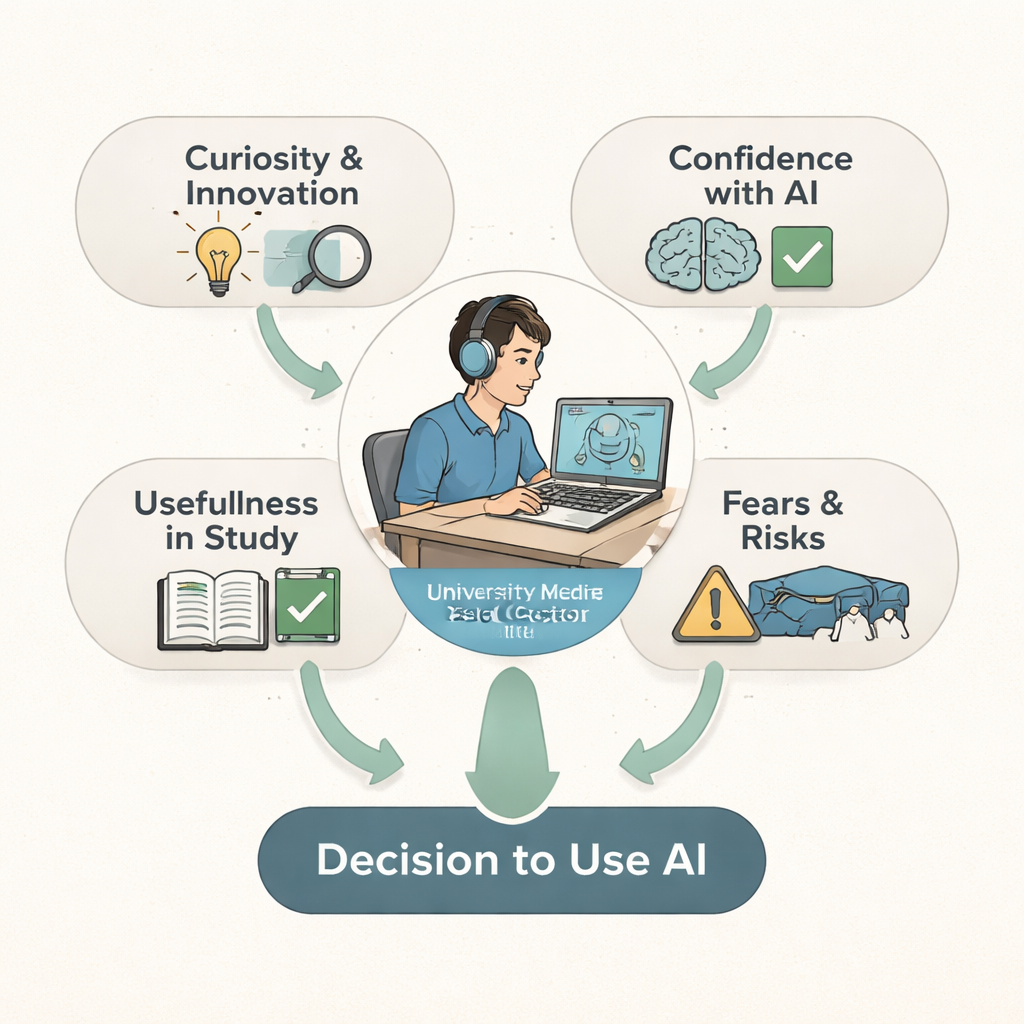

W ankiecie przeprowadzonej wśród 588 studentów mediów autorzy odkrywają, że zarówno ciekawość, jak i pewność siebie silnie wpływają na to, jak użyteczna i jak łatwa w obsłudze wydaje się AI. Studenci postrzegający siebie jako innowacyjnych częściej uważają, że narzędzia AI im pomogą i że można się z nimi uporać bez większych trudności. Podobnie osoby czujące się kompetentne w obszarze AI deklarują wyższe oczekiwania, że te narzędzia poprawią ich pracę i będą praktycznie przystępne. Te przekonania — dotyczące użyteczności i łatwości użycia — okazują się głównymi kanałami, dzięki którym wewnętrzne cechy, takie jak innowacyjność i wiara we własne możliwości, przekładają się na rzeczywistą gotowość do korzystania z AI w nauce i projektach twórczych.

Gdy korzyści spotykają się ze strachem i wątpliwościami

Postrzegana użyteczność i łatwość użycia to nie wszystko. Badanie pokazuje, że postrzegane ryzyko — obawy o prywatność, stronniczość, błędy czy utratę kontroli — może osłabić ich siłę przyciągania. Nawet gdy studenci uważają AI za pomocną i prostą, silne obawy mogą stłumić ich zamiar polegania na niej. Wykorzystując zaawansowane modelowanie statystyczne oraz metodę porównawczą, która bada kombinacje warunków zamiast pojedynczych przyczyn, autorzy pokazują, że żaden pojedynczy czynnik nie jest wystarczający sam w sobie. Zamiast tego decyzje studentów wynikają ze przecinających się konfiguracji motywacji, umiejętności i postrzegania ryzyka, co odzwierciedla złożoną rzeczywistość ważenia przez ludzi nowych technologii wpływających na ich przyszłe kariery.

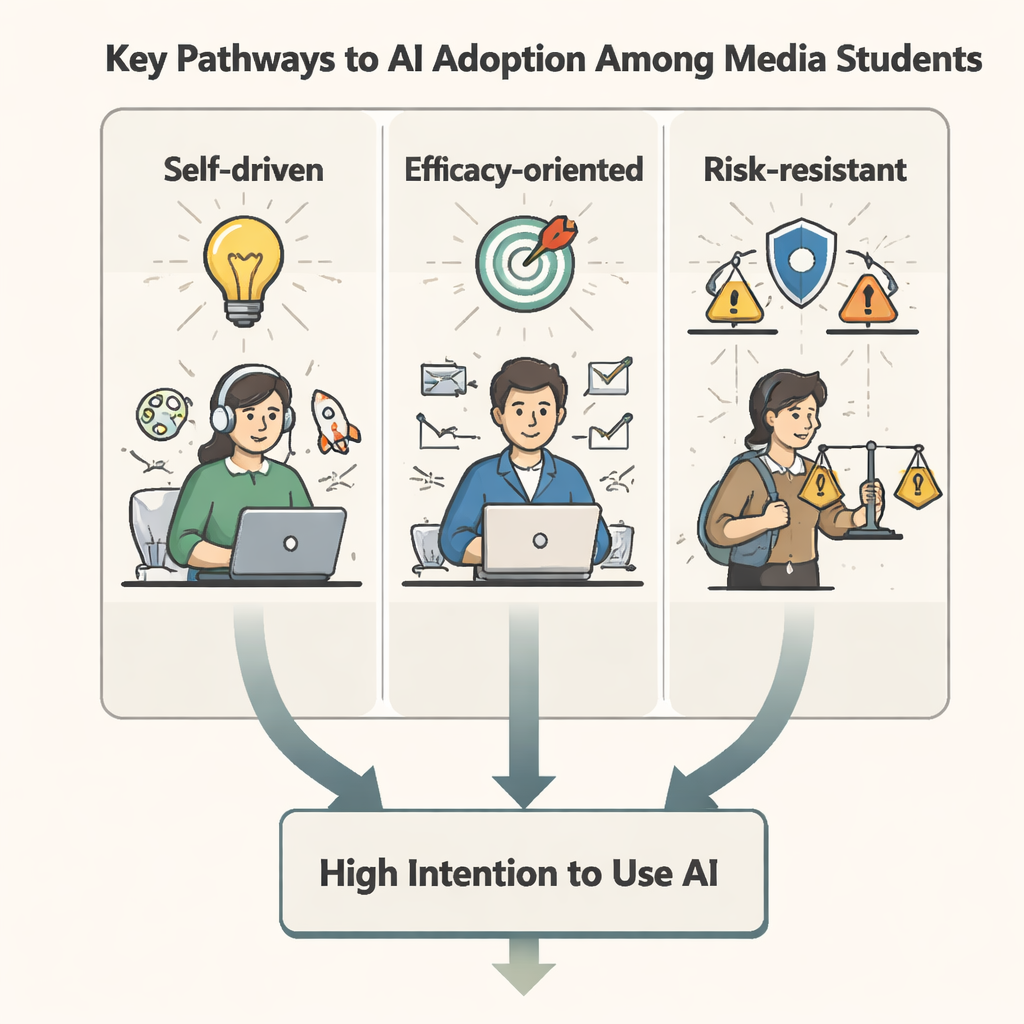

Trzy różne drogi do powiedzenia „tak” AI

Badanie identyfikuje trzy główne wzorce prowadzące do wysokiej intencji korzystania z narzędzi AI. W ścieżce „napędzanej przez samych siebie” studenci o silnej innowacyjności osobistej i wysokiej samoefektywności w zakresie AI są chętnymi adopters nawet wtedy, gdy narzędzia nie są szczególnie proste lub wolne od ryzyka; ich wewnętrzny napęd popycha ich do przodu. W ścieżce „zorientowanej na efektywność” przekonanie studentów o własnej zdolności radzenia sobie z AI rekompensuje obawy i zwiększa adopcję, nawet gdy postrzegana użyteczność jest mieszana. Wreszcie w ścieżce „odpornej na ryzyko” studenci o bardzo wysokiej samoefektywności w zakresie AI potrafią znieść znaczące obawy dotyczące zagrożeń związanych z AI: nadal wybierają korzystanie z AI, ponieważ ufają, że poradzą sobie z problemami. We wszystkich trzech wzorcach cechy wewnętrzne i postrzegania współdziałają, zamiast funkcjonować izolowanie, kształtując zachowanie.

Co to oznacza dla edukacji medialnej

Dla czytelnika ogólnego kluczowy wniosek jest taki, że skłonienie studentów mediów do mądrego korzystania z AI to nie tylko instalowanie najnowszego oprogramowania czy wprowadzanie obowiązkowych kursów. Chodzi o pielęgnowanie ciekawości, budowanie praktycznej pewności siebie i otwarte adresowanie obaw. Autorzy konkludują, że trwałe przyjęcie AI w edukacji medialnej wymaga projektowania skoncentrowanego na człowieku: programów nauczania, które wzmacniają poczucie sprawczości studentów, pokazują jasne korzyści w realnych zadaniach medialnych i uczą rozumienia oraz zarządzania ryzykiem. Jeśli edukatorzy zrobią to dobrze, dziennikarze i opowiadacze jutra nie będą jedynie popychani do używania AI — wybiorą jej użycie z entuzjazmem i krytycznym osądem.

Cytowanie: Lan, Y., Liu, S., Chen, H. et al. Configurational effects of personal innovativeness, self-efficacy, and perceived risk on AI adoption in media students. Sci Rep 16, 5681 (2026). https://doi.org/10.1038/s41598-026-36538-7

Słowa kluczowe: przyjmowanie AI, studenci mediów, akceptacja technologii, edukacja w dziennikarstwie cyfrowym, postrzegane ryzyko