Clear Sky Science · pl

Naukowe raporty: wielorelatywny dwuwarstwowy grafowy transformer uwagi do analizy sentymentu o wysokiej rozdzielczości

Dlaczego drobne wskazówki w recenzjach mają znaczenie

Opinie online pełne są mieszanych uczuć: restauracja może mieć „świetne jedzenie, ale wolną obsługę”, a telefon — „piękny ekran, lecz okropną żywotność baterii”. Firmy i badacze chcą, aby komputery rozumiały takie szczegółowe opinie, nie tylko to, czy cała recenzja jest pozytywna czy negatywna. Artykuł przedstawia nowy model sztucznej inteligencji, który skupia się na konkretnych fragmentach zdania — jak „obsługa” czy „żywotność baterii” — i ustala, co dokładnie ludzie myślą o każdym z nich, nawet jeśli wskazówki są rozproszone i subtelne.

Wyjście poza uniwersalny sentyment

Tradycyjna analiza sentymentu traktuje zdanie lub recenzję jako jedną całość i ocenia, czy ogólnie jest pozytywna czy negatywna. To działa przy prostych komentarzach, ale zawodzi, gdy ktoś chwali jeden aspekt, a krytykuje inny w tym samym zdaniu. Domena analizy sentymentu względem aspektów odpowiada na pytanie: jaka jest opinia wobec konkretnego celu, takiego jak „obsługa”, „otoczenie” czy „personel” w recenzji restauracji. Wcześniejsze metody opierały się na regułach tworzonych przez człowieka lub prostym uczeniu maszynowym liczącym słowa, a potem przeszły do sieci neuronowych czytających tekst sekwencyjnie, jak od lewej do prawej. Te modele sekwencyjne poprawiły dokładność, ale nadal pomijały długodystansowe powiązania i subtelne sygnały, zwłaszcza gdy istotne słowa są od siebie daleko lub połączone słowami kontrastu takimi jak „ale” czy „chociaż”.

Przekształcanie zdań w połączone mapy

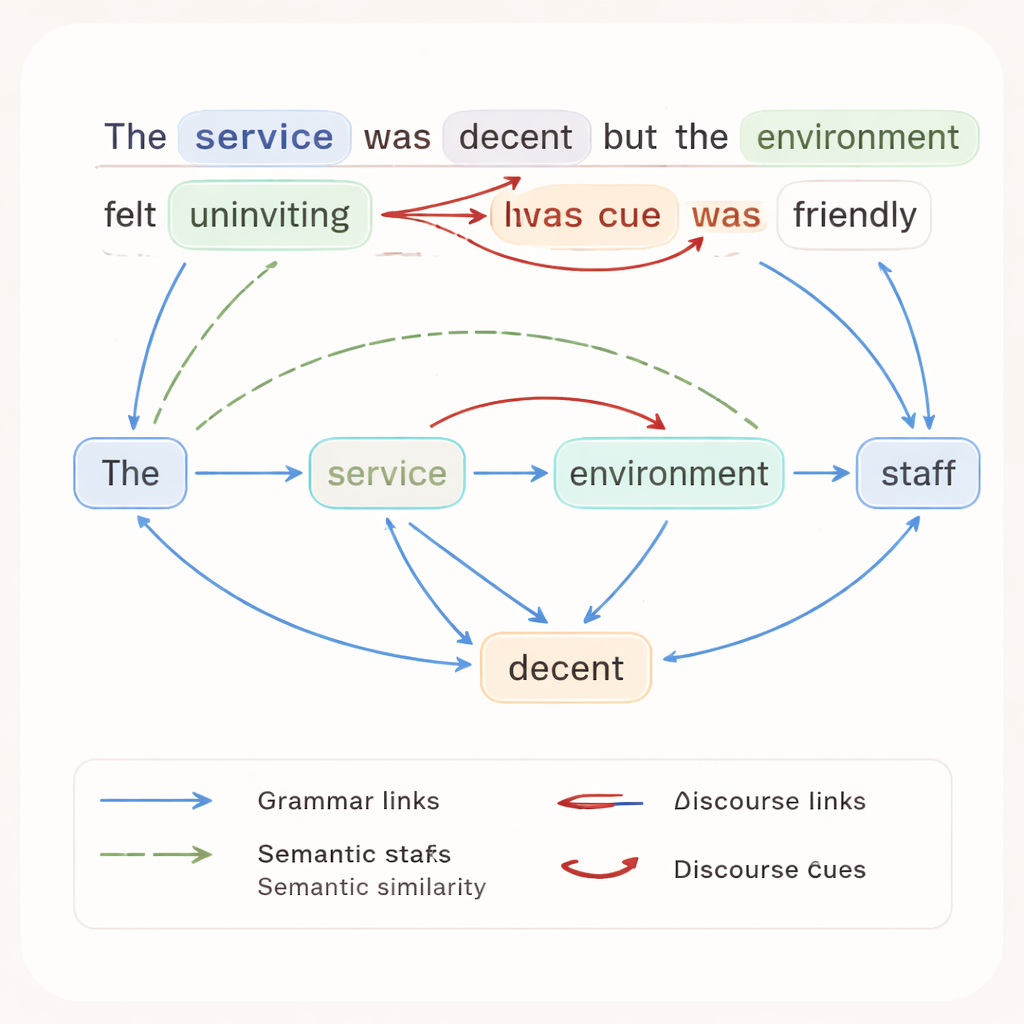

Autorzy twierdzą, że aby naprawdę zrozumieć opinie o wysokiej rozdzielczości, komputer powinien widzieć zdanie jako sieć, a nie linię. W ich podejściu każde słowo staje się węzłem w grafie, a różne typy relacji — krawędziami. Jeden zestaw krawędzi odzwierciedla składnię, na przykład które słowo jest podmiotem lub dopełnieniem. Inny łączy słowa podobne znaczeniowo, nawet jeśli nie stoją obok siebie. Trzeci zaznacza wskazówki dyskursywne — słowa takie jak „ale”, „jednak” czy „chociaż”, które często sygnalizują zmianę sentymentu. W zdaniu takim jak „Obsługa była w porządku, ale otoczenie wydawało się nieprzyjazne, chociaż personel był uprzejmy” ten graf pokazuje, jak pochwały i krytyka splatają się wokół różnych aspektów.

Podwójne światło na kontekst i cele

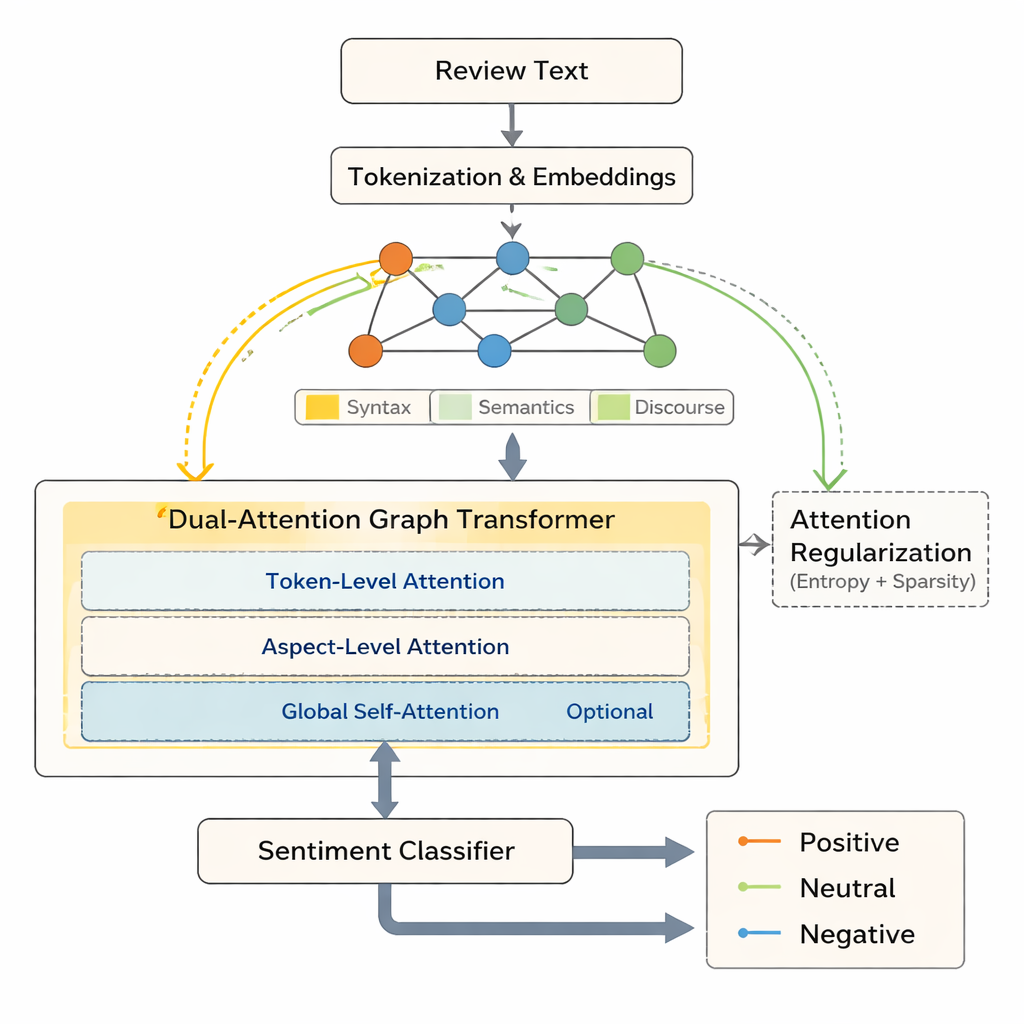

Opierając się na tej reprezentacji grafowej, artykuł przedstawia Multi-Relational Dual-Attention Graph Transformer (MRDAGT). Model wykorzystuje mechanizm uwagi w stylu Transformera dostosowany do grafów. Jedna głowa uwagi patrzy szeroko na to, jak wszystkie słowa w zdaniu odnoszą się do siebie, zbierając przydatny kontekst lokalny. Druga głowa uwagi skupia się konkretnie na rozpatrywanym aspekcie — na przykład „obsłudze” lub „otoczeniu” — i zwiększa wpływ słów kształtujących opinie o tym celu, takich jak „w porządku” czy „nieprzyjazne”. Gdy w jednym zdaniu występuje kilka aspektów, opcjonalna warstwa globalnej uwagi pomaga modelowi ocenić ich wzajemne interakcje. W praktyce system rzuca dwa skoordynowane reflektory: jeden na ogólną strukturę zdania, drugi bezpośrednio na aspekt, którego sentyment próbuje oszacować.

Uczynienie uwagi maszynowej bardziej selektywnej i wyjaśnialnej

Kluczowym problemem współczesnej sztucznej inteligencji jest to, że wagi uwagi — liczby wskazujące, na które słowa model zwrócił uwagę — mogą być zbyt rozproszone, co utrudnia interpretację decyzji. MRDAGT rozwiązuje to dwoma siłami regularyzującymi. Kara entropii zniechęca do zbyt płaskiego rozkładu uwagi, skłaniając model do ostrzejszego skupienia się na kilku istotnych słowach. Równocześnie termin L1 promujący rzadkość popycha wiele połączeń uwagi w kierunku zera, przycinając słabe, szumowe powiązania. Razem te mechanizmy tworzą „skupioną rzadkość”: model ma tendencję do przypisywania wyraźnie wysokich wag naprawdę istotnym parom słowo–aspekt, ignorując rozproszenia. Eksperymenty na trzech zbiorach referencyjnych — formalnych recenzjach laptopów, złożonych recenzjach wielozdaniowych i nieformalnych wpisach na Twitterze — pokazują, że MRDAGT konsekwentnie przewyższa silne istniejące systemy o około jeden do dwóch punktów procentowych w dokładności, a jednocześnie generuje czyściej wyglądające, bardziej interpretable mapy uwagi.

Co to oznacza dla wydobywania opinii w praktyce

Dla niespecjalistów wniosek jest taki, że model oferuje precyzyjniejszy i bardziej godny zaufania sposób wydobywania opinii z nieuporządkowanych, rzeczywistych tekstów. Zamiast jedynie stwierdzić, że recenzja jest „przeważnie pozytywna”, MRDAGT może oddzielnie wskazać, że klienci chwalą szybkość urządzenia, ale krytykują baterię, lub że goście doceniają personel kawiarni, ale narzekają na hałas. Ponieważ wzorce uwagi modelu zgadzają się z ludzką intuicją — skupiając się na słowach kontrastowych, przymiotnikach nacechowanych emocjonalnie i termach aspektowych — analitycy łatwiej zobaczą, dlaczego model podjął określoną decyzję. Autorzy sugerują, że podejście to może wspierać lepsze decyzje dotyczące projektowania produktów, dokładniejszy monitoring mediów społecznościowych oraz przyszłe rozszerzenia na wiele języków i nawet dane multimodalne, takie jak audio i obrazy, przy jednoczesnym zachowaniu stosunkowo przejrzystego procesu rozumowania.

Cytowanie: Anilkumar, A.P., Kim, SK. & Yoon, YC. Scientific reports multi relational dual attention graph transformer for fine grained sentiment analysis. Sci Rep 16, 7236 (2026). https://doi.org/10.1038/s41598-026-36490-6

Słowa kluczowe: analiza sentymentu względem aspektów, grafowe sieci neuronowe, uwaga transformera, wydobywanie opinii, przetwarzanie języka naturalnego