Clear Sky Science · pl

Głęboki model sentymentu łączący kontekst napędzany przez ALBERT i architekturę optymalizowaną przez EHO

Dlaczego mądrzejsze czytanie sentymentu ma znaczenie

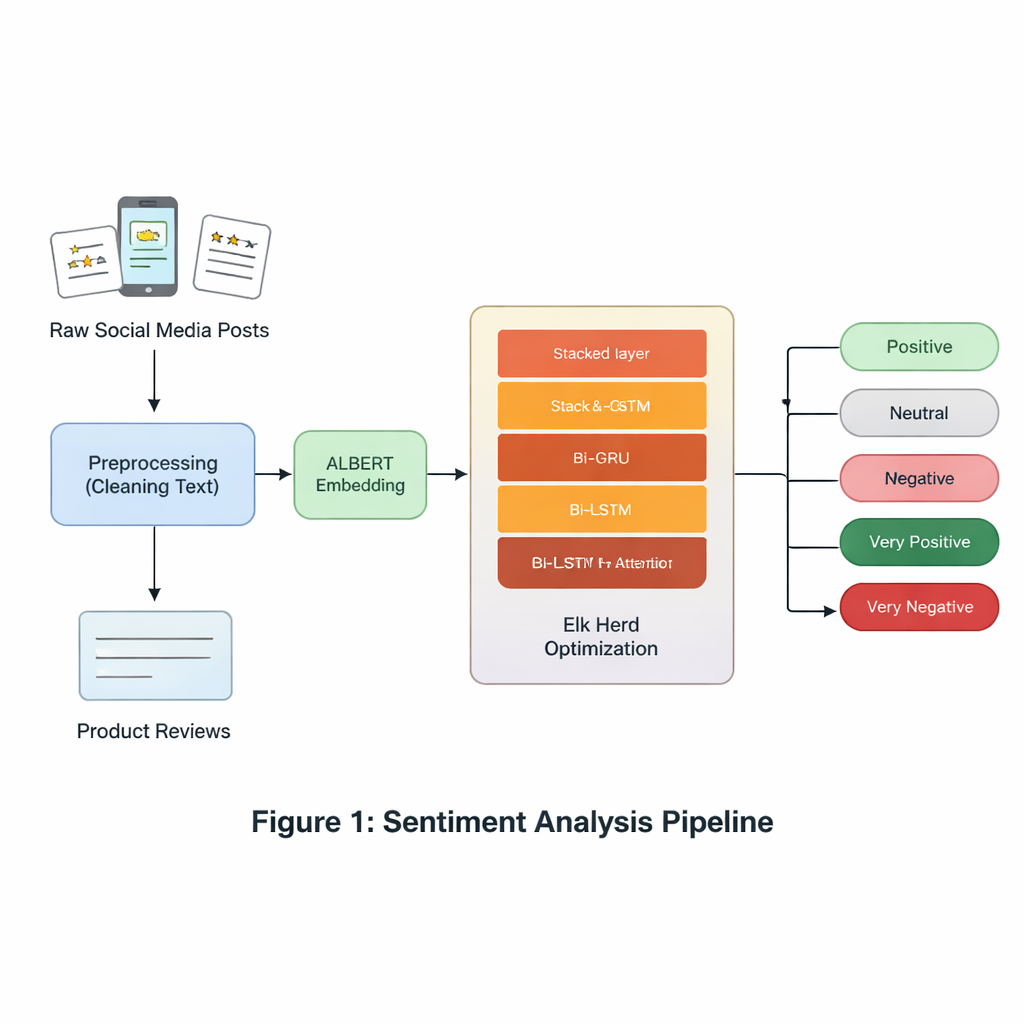

Codziennie miliony ludzi dzielą się opiniami o produktach, usługach, polityce i wydarzeniach w internecie. Przekształcenie tej fali tekstu w wiarygodne wnioski jest kluczowe dla firm, rządów i badaczy. Nasz język online jest jednak nieuporządkowany: sarkastyczne żarty, slang, literówki i rzadkie emocje łatwo mylą komputery. Artykuł przedstawia nowy system analizy sentymentu, który ma na celu dokładniejsze odczytywanie tych emocji, przy jednoczesnym zużyciu mniejszych zasobów obliczeniowych niż wiele współczesnych modeli sztucznej inteligencji.

Od prostego liczenia słów do czytania uwzględniającego kontekst

Wczesne narzędzia do analizy sentymentu traktowały tekst jak worek niezależnych słów, licząc, jak często pojawiają się terminy takie jak „dobry” czy „okropny”. Podejście to pomijało kolejność słów i subtelny kontekst, na przykład gdy „nie złe” oznacza coś bliższego „całkiem dobre”. Metody uczenia głębokiego poprawiły to, przetwarzając tekst jako sekwencje, ale często wymagały ogromnych oznaczonych zbiorów danych i dużych mocy obliczeniowych. Modele transformerowe, takie jak BERT, podniosły dokładność jeszcze dalej, lecz ich rozmiar sprawia, że są kosztowne w uruchamianiu w praktycznych zastosowaniach, takich jak platformy obsługi klienta czy monitoring mediów społecznościowych. Autorzy tego artykułu odpowiadają na to wyzwanie, łącząc kilka lżejszych, lecz wydajnych komponentów w jeden usprawniony system.

Szczuplejszy „mózg” do rozumienia tekstu

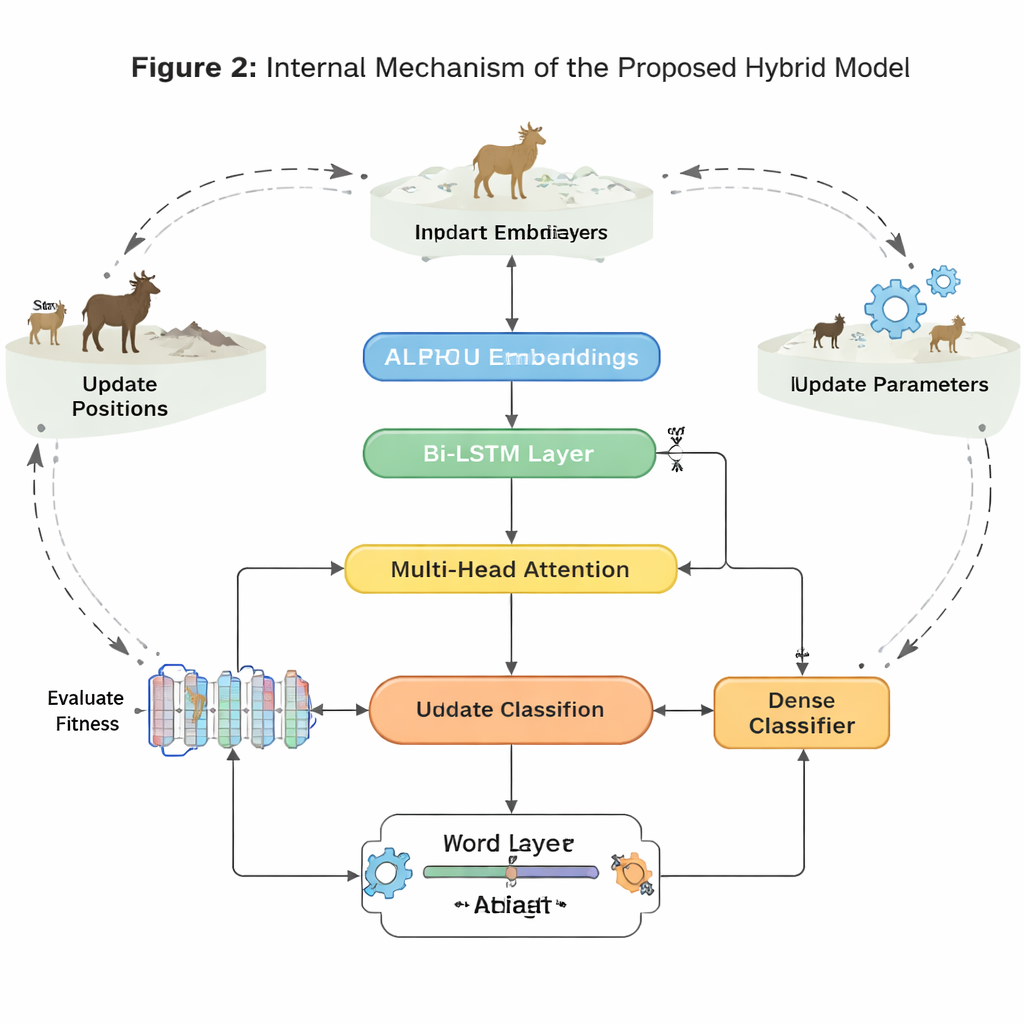

W centrum modelu znajduje się ALBERT, kompaktowy kuzyn językowego modelu BERT. ALBERT przekształca każde słowo w zdaniu w numeryczną reprezentację uwzględniającą kontekst, wychwytując, jak znaczenia zmieniają się w zależności od sąsiednich słów. W odróżnieniu od większych modeli ALBERT zmniejsza zużycie pamięci przez współdzielenie parametrów między warstwami i kompresję słownictwa. Dzięki temu łatwiej go uruchomić na standardowym sprzęcie bez dużej utraty rozumienia. Te reprezentacje słów oparte na ALBERT stają się wejściem do sekwencji wyspecjalizowanych warstw, które skupiają się na tym, jak sentyment rozwija się w zdaniu.

Pozwolenie dwóm systemom pamięci współpracować

Aby śledzić, jak znaczenie zmienia się od słowa do słowa, system wykorzystuje dwa rodzaje sieci rekurencyjnych: GRU (Gated Recurrent Units) i LSTM (Long Short-Term Memory), każdą uruchamianą w kierunku przód i wstecz. GRU są wydajne w śledzeniu krótkich fraz przy mniejszej liczbie parametrów, podczas gdy LSTM lepiej zapamiętują informacje na dłuższych odcinkach tekstu. Poprzez nałożenie dwukierunkowej warstwy GRU na dwukierunkową warstwę LSTM i dodanie mechanizmu uwagi, model może wyróżnić najbardziej nacechowane sentymentem fragmenty zdania — na przykład frazę „oprócz żywotności baterii” w przeważnie pozytywnej recenzji. Ten hybrydowy układ ma na celu uchwycenie zarówno szybkich zmian tonu, jak i długozasięgowego kontekstu, który może zmienić ogólny sentyment.

Strojenie zainspirowane naturą dla trudnych przypadków

Ponad samą architekturą autorzy zajmują się kluczową przeszkodą z praktyki: zbiory danych sentymentu są często niezrównoważone i zaszumione. Emocje takie jak obrzydzenie czy zaskoczenie oraz wypowiedzi neutralne pojawiają się rzadziej niż wyraźnie pozytywne lub negatywne, co sprawia, że wiele modeli je ignoruje. Aby temu przeciwdziałać, artykuł wykorzystuje Elk Herd Optimization — strategię przeszukiwania inspirowaną naturą, wzorowaną na sposobie poruszania się, rywalizacji i tworzenia grup przez łosie. Po tym, jak sieć neuronowa generuje wewnętrzne wektory sentymentu, krok optymalizacji dopracowuje sposób, w jaki te wektory reprezentują każdą klasę, zwłaszcza rzadkie, iteracyjnie poprawiając „fitness” (funkcję dopasowania). Proces ten pomaga modelowi uniknąć powierzchownych rozwiązań i poprawia zdolność rozróżniania subtelnych lub niedostatecznie reprezentowanych emocji.

Postawienie modelu na próbę

Autorzy oceniają swój system na sześciu szeroko stosowanych zbiorach danych, w tym wpisach z Twittera, recenzjach restauracji i laptopów oraz pięciostopniowym benchmarku recenzji filmowych, który rozróżnia opinie bardzo pozytywne i bardzo negatywne od bardziej umiarkowanych. W tych zróżnicowanych źródłach nowe podejście konsekwentnie przewyższa kilka zaawansowanych konkurentów opartych na grafach i transformerach zarówno pod względem dokładności, jak i miary F1, która równoważy trafne trafienia i przeoczenia. Zyski są szczególnie silne w zadaniu pięcioklasowym dla recenzji filmowych oraz dla słabo reprezentowanych klas sentymentu, co pokazuje, że metoda radzi sobie zarówno z drobnoziarnistymi emocjami, jak i z niezrównoważonymi danymi. Badanie ablacyjne, w którym komponenty są usuwane pojedynczo, potwierdza, że ALBERT, połączony projekt GRU–LSTM, mechanizm uwagi oraz optymalizacja inspirowana łosiami każdy wnoszą wkład do końcowej wydajności.

Co to oznacza dla codziennych zastosowań

Dla osób niebędących specjalistami kluczowy wniosek jest taki, że badania te oferują bardziej efektywny i wiarygodny sposób interpretowania dużych ilości opinii online. Poprzez połączenie kompaktowego modelu językowego z komplementarnymi warstwami pamięci i biologicznie zainspirowanym etapem strojenia, system lepiej czyta między wierszami, zwłaszcza gdy sentymenty są subtelne lub dane są zniekształcone. To czyni go obiecującym do zastosowań w świecie rzeczywistym, takich jak śledzenie satysfakcji klientów, monitorowanie postaw związanych ze zdrowiem publicznym czy mierzenie reakcji na polityki i wydarzenia, gdzie zarówno precyzja, jak i koszty obliczeniowe mają znaczenie.

Cytowanie: Oqaibi, H., Sharma, S. A deep sentiment model combining ALBERT-driven context and EHO-optimized architecture. Sci Rep 16, 5784 (2026). https://doi.org/10.1038/s41598-026-36389-2

Słowa kluczowe: analiza sentymentu, ALBERT, uczenie głębokie, klasyfikacja tekstu, optymalizacja metaheurystyczna