Clear Sky Science · pl

ADAT: nowa architektura adaptacyjnego transformera uwzględniająca szereg czasowy dla tłumaczenia języka migowego

Przełamywanie bariery komunikacyjnej

Dla milionów osób Głuchych i niedosłyszących codzienne czynności, takie jak wizyta u lekarza czy oglądanie prognozy pogody, bywają trudniejsze, niż powinny — po prostu dlatego, że wykwalifikowani tłumacze języka migowego są rzadkością. W artykule przedstawiono nowy system sztucznej inteligencji o nazwie ADAT, który zamienia filmy z miganiem na zdania pisane dokładniej i wydajniej niż wiele istniejących rozwiązań, przybliżając nas do tłumaczeń języka migowego w czasie rzeczywistym, dostępnych na telefonach, tabletach i komputerach w szpitalach.

Dlaczego język migowy jest trudny dla komputerów

Języki migowe są bogate i złożone, mają własną gramatykę i opierają się na znacznie większej liczbie sygnałów niż tylko ruchy rąk. Wyraz twarzy, postawa ciała i subtelne timingi zmieniają znaczenie zdania migowego. Nowoczesne systemy tłumaczeniowe często wykorzystują potężną architekturę znaną jako transformer, świetną w rozumieniu długich sekwencji mówionego czy pisanego języka. Jednak przy szybkich nagraniach wideo — 30–60 klatek na sekundę — te systemy stają się powolne i mają trudności z wychwyceniem szybkich, drobnych ruchów, które rozróżniają znaki. Wymagają też dużo mocy obliczeniowej i czasu treningu, co utrudnia ich aktualizowanie wraz z ewolucją języków migowych.

Sprytniejszy sposób odczytywania migania

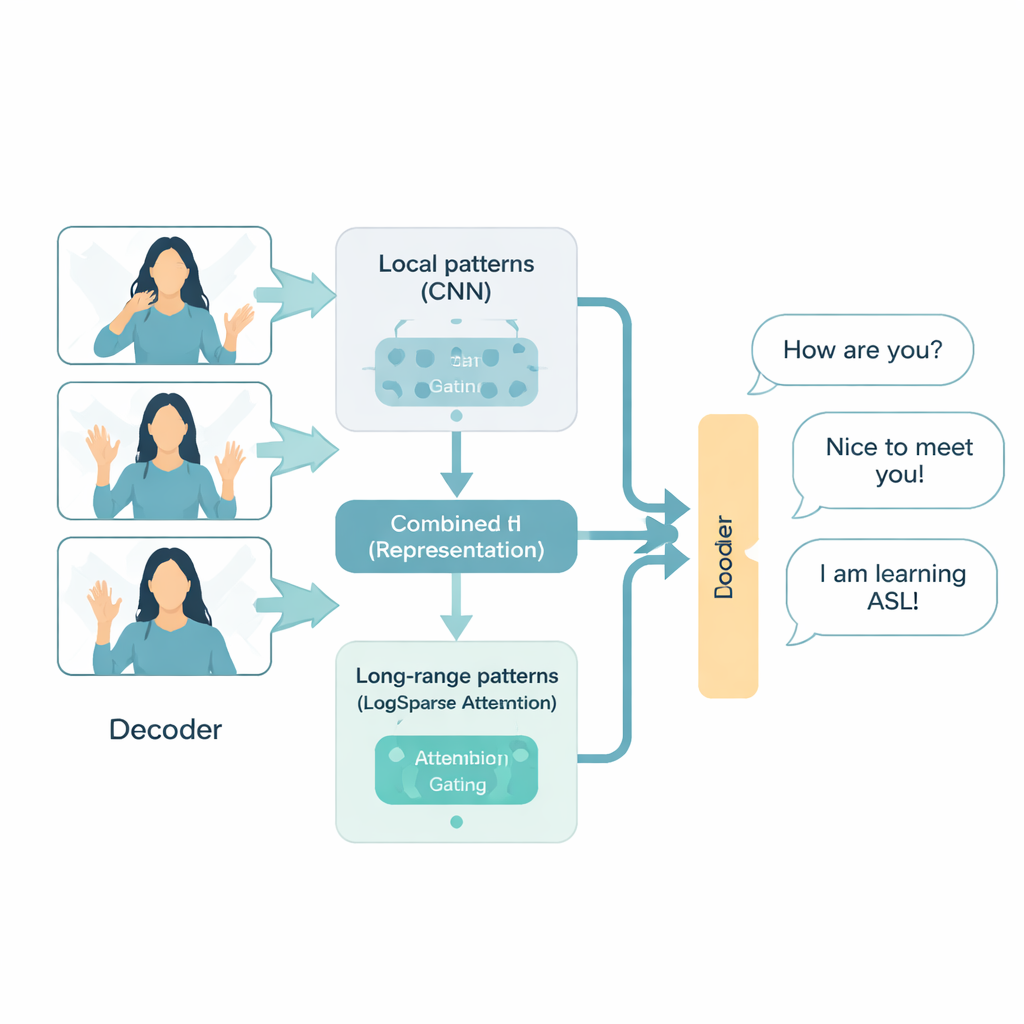

Architektura ADAT została zaprojektowana specjalnie dla wideo z językiem migowym, traktując je jako szereg czasowy — szybki strumień zdarzeń wizualnych rozgrywających się w czasie. Łączy trzy idee. Po pierwsze, wykorzystuje konwolucyjne sieci neuronowe, sprawdzoną technikę obrazu, aby skupić się na lokalnych wzorcach, takich jak kształty dłoni i sygnały mimiczne. Po drugie, stosuje bardziej wydajny wariant mechanizmu uwagi, który selektywnie sięga do kluczowych momentów w wideo zamiast porównywać każdą klatkę ze wszystkimi innymi. Po trzecie, adaptacyjna „bramka” uczy się łączyć szczegółowe informacje krótkoterminowe z szerszym kontekstem długoterminowym, decydując na bieżąco, co jest ważniejsze dla danej części zdania. Razem te elementy pozwalają ADAT uchwycić zarówno szybkie drgnięcie palca, jak i ogólną strukturę rozmowy bez marnowania obliczeń.

Od znaków do słów na dwa sposoby

Tłumaczenie języka migowego można zorganizować na dwa główne sposoby: najpierw rozpoznając podstawowe jednostki migania, zwane glosami, a następnie zamieniając te glosy na mowę lub tekst — to tzw. sign-to-gloss-to-text. Alternatywnie system może próbować przejść bezpośrednio z wideo do tekstu w jednym kroku, czyli sign-to-text. Autorzy testują ADAT w obu podejściach. Porównują go z kilkoma silnymi bazowymi modelami opartymi na transformerach, w tym z dobrze znanym systemem SLTUNET, na trzech zbiorach danych: dużym niemieckim korpusie prognoz pogody, zbiorze Indyjskiego Języka Migowego oraz nowym medycznym zbiorem danych American Sign Language, który autorzy stworzyli, aby odzwierciedlić realistyczne rozmowy lekarz–pacjent.

Szybsze szkolenie i ostrzejsze tłumaczenia

W tych testach ADAT dorównuje lub przewyższa najlepsze konkurencyjne modele pod względem jakości tłumaczenia mierzonej standardowymi punktacjami BLEU, przy jednoczesnym wyraźnie szybszym treningu. W dwustopniowym ustawieniu sign-to-gloss-to-text osiąga podobne lub nieco lepsze wyniki niż klasyczny transformer, skracając czas treningu średnio o około jedną piątą. W trudniejszym bezpośrednim podejściu sign-to-text ADAT wyraźnie przewyższa bazowe modele tylko z enkoderem, tylko z dekoderem oraz modele zunifikowane, często poprawiając dokładność o około punkt procentowy lub więcej, również przy ~20% szybszym treningu. Szczegółowa analiza matematyczna pokazuje, że bardziej selektywna uwaga i dwuścieżkowa konstrukcja ADAT znacząco zmniejszają liczbę wymaganych operacji, szczególnie przy długich lub wysokoklatkowych nagraniach.

Nowe dane dla rozmów o krytycznym znaczeniu

Aby upewnić się, że metody te działają poza warunkami laboratoryjnymi, autorzy przedstawiają MedASL, pierwszy zbiór danych American Sign Language skoncentrowany na komunikacji medycznej. Składa się on z 500 unikalnych, starannie zaprojektowanych zdań symulujących rzeczywiste interakcje między pacjentami a pracownikami służby zdrowia i zawiera adnotacje zarówno glosów, jak i tekstu. To medyczne ukierunkowanie ma znaczenie, ponieważ nieporozumienia w szpitalu lub przychodni mogą mieć poważne konsekwencje, a istniejące zbiory danych rzadko obejmują tę domenę. ADAT radzi sobie dobrze na MedASL, chociaż wyniki pokazują też, jak trudne jest dla dowolnego systemu idealne uogólnienie na nowe, rzeczywiste zdania.

Co to oznacza w codziennym życiu

Mówiąc prościej, badanie pokazuje, że możemy zbudować systemy tłumaczenia języka migowego, które są jednocześnie mądrzejsze i bardziej oszczędne: potrzebują mniej czasu i mocy obliczeniowej do treningu, a jednocześnie lepiej uchwytują subtelności migania. ADAT nie jest jeszcze gotowym, uniwersalnym tłumaczem dla każdego języka migowego w każdej sytuacji i wciąż ustępuje systemom opartym na ogromnych, wstępnie wytrenowanych modelach. Jednak dzięki skupieniu na wzorcach czasowych w wideo i efektywności wskazuje kierunek ku praktycznym narzędziom, które pewnego dnia mogłyby działać na codziennych urządzeniach, obsługiwać wiele języków migowych i pomagać użytkownikom Głuchym w kluczowych sytuacjach, takich jak opieka zdrowotna, reakcje ratunkowe i usługi publiczne.

Cytowanie: Shahin, N., Ismail, L. ADAT novel time-series-aware adaptive transformer architecture for sign language translation. Sci Rep 16, 6551 (2026). https://doi.org/10.1038/s41598-026-36293-9

Słowa kluczowe: tłumaczenie języka migowego, adaptacyjny transformer, uwaga w szeregach czasowych, medyczny ASL, dostępna sztuczna inteligencja