Clear Sky Science · pl

Hierarchiczne podejmowanie decyzji NBV oparte na informacji wzajemnej dla aktywnego semantycznego SLAM w środowiskach dynamicznych

Roboty, które potrafią myśleć naprzód

Gdy roboty wychodzą z fabryk i trafiają do domów, szpitali i biur, muszą poruszać się po przestrzeniach pełnych ludzi i innych poruszających się obiektów. Artykuł przedstawia nowy sposób, w jaki robot może „myśleć naprzód” o tym, gdzie patrzeć i jak się poruszać, aby zbudować niezawodną mapę otoczenia — nawet gdy to otoczenie nie chce stać w miejscu. Praca jest istotna dla każdego, kto interesuje się bezpieczniejszymi robotami usługowymi, sprytniejszymi robotami dostawczymi czy przyszłymi asystentami domowymi, które muszą dzielić przestrzeń z ludźmi, a nie poruszać się po pustych korytarzach.

Dlaczego poruszający się ludzie mylą roboty

Aby poruszać się samodzielnie, wiele robotów używa techniki zwanej wizualnym SLAM, w której kamera pomaga jednocześnie budować mapę i szacować pozycję. To działa dobrze w nieruchomych środowiskach, ale szybko się psuje, gdy ludzie przechodzą obok, zasłaniają widok lub niosą przedmioty. Powszechnym rozwiązaniem jest użycie widzenia „semantycznego”, dzięki któremu robot rozpoznaje ludzi, samochody czy krzesła i po prostu je ignoruje przy tworzeniu mapy. Jednak to rodzi nowy problem dla aktywnych robotów wybierających własne trasy: jeśli odrzucą zbyt wiele wskazówek wizualnych, mogą w ogóle stracić orientację. Ograniczone pole widzenia kamery utrudnia sprawę jeszcze bardziej, ponieważ jedna osoba przechodząca blisko może zasłonić większość użytecznego krajobrazu przed oczami robota.

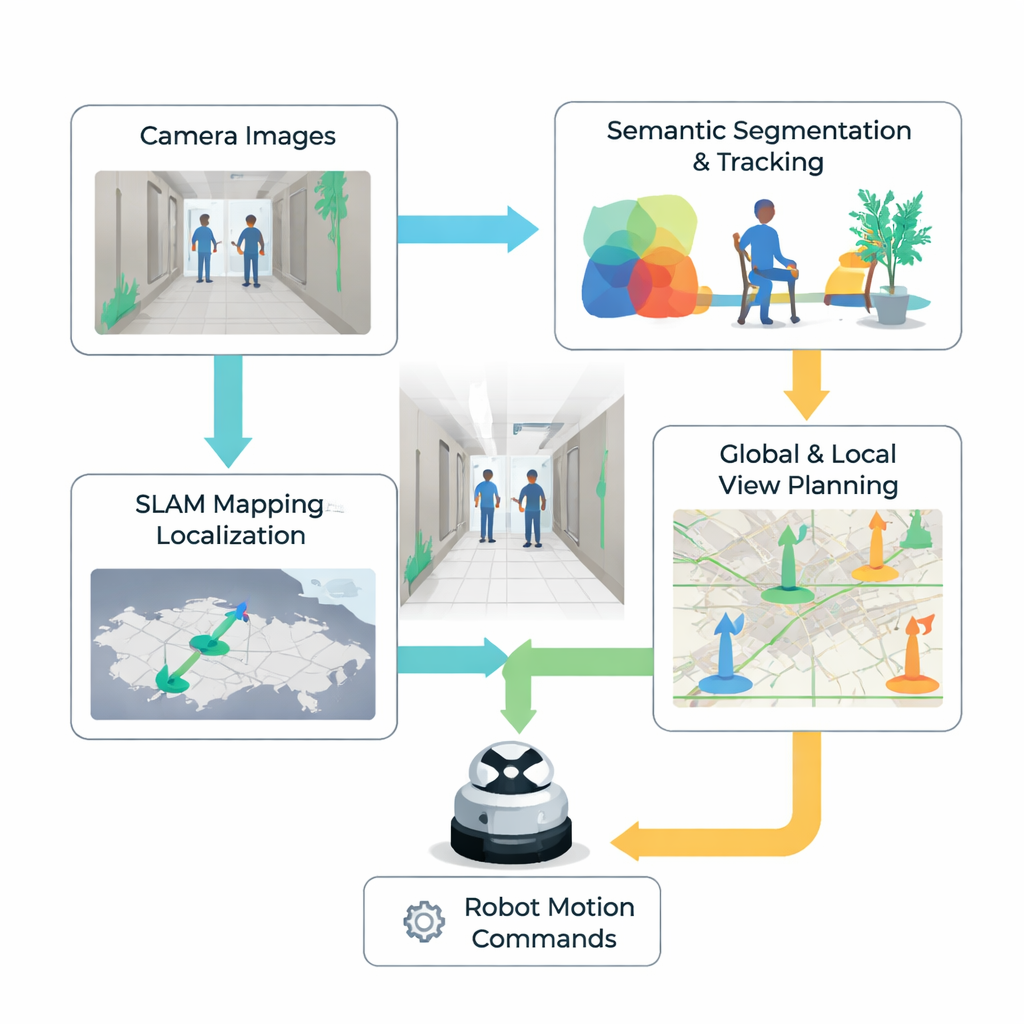

Dwupoziomowa strategia wyboru, gdzie patrzeć dalej

Autorzy proponują hierarchiczny system decyzyjny, który pomaga robotowi w bardziej świadomym wyborze kolejnych punktów widokowych. Na wyższym poziomie robot utrzymuje mapę z widoku z góry podzieloną na komórki: wolne, zajęte i nieznane. Ocienia potencjalne odległe punkty widokowe, szacując, jak bardzo każdy z nich zmniejszy niepewność w tej mapie — koncepcję zapożyczoną z teorii informacji. Robot preferuje miejsca, które odkrywają duże, niezbadane obszary, jednocześnie uwzględniając, jak daleko musi podróżować i ile musi obrócić kamerę. Gdy obiecujący obszar zostanie wybrany, niższy poziom sterowania przejmuje kontrolę, dopracowując dokładnie, jak robot powinien się poruszyć i skierować w obrębie tej okolicy, tak by wąskie pole widzenia kamery rzeczywiście uchwyciło wystarczającą ilość użytecznych szczegółów.

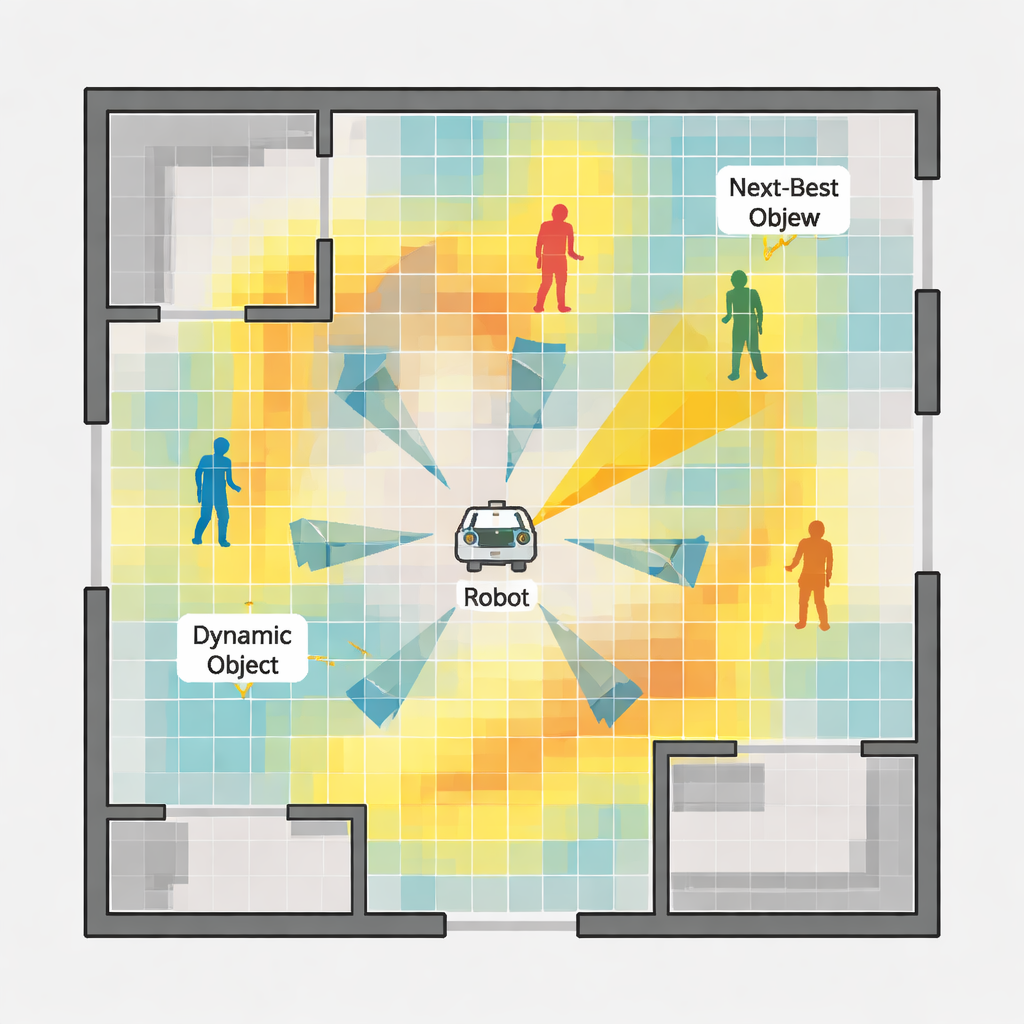

Widzieć to, co stabilne, i omijać to, co nie

W centrum lokalnego procesu decyzyjnego znajduje się „mapa prawdopodobieństwa cech” budowana na podstawie każdego obrazu z kamery. Najpierw system wykrywa punkty charakterystyczne — rogi i wzory w scenie — które prawdopodobnie pozostaną stabilne w czasie i są pomocne przy śledzeniu ruchu. Następnie stosuje nowoczesny detektor obiektów, by znaleźć potencjalnie ruchome obiekty, takie jak ludzie, i śledzi je między klatkami. Analizując, jak te obiekty się poruszają, system szacuje nie tylko, gdzie są teraz, ale także gdzie prawdopodobnie będą w najbliższej przyszłości. Te dwa źródła informacji są łączone w mapę cieplną obrazu: jasne rejony wskazują wysokie prawdopodobieństwo zobaczenia wiarygodnych punktów orientacyjnych, podczas gdy ciemniejsze obszary oznaczają miejsca ubogie w cechy lub prawdopodobnie zasłonięte przez poruszające się obiekty. Robot używa tej mapy, by ocenić, który drobny ruch — obrót w lewo, w prawo lub ruch do przodu — zapewni mu najczystszy i najbardziej stabilny widok w następnej chwili.

Testy w wirtualnych światach i w rzeczywistości

Naukowcy przetestowali swoje podejście w dwóch symulowanych przestrzeniach wewnętrznych o różnej wielkości i złożoności, każda zaludniona wędrującymi wirtualnymi pieszymi, a następnie na fizycznym robocie poruszającym się po rzeczywnym wnętrzu. Porównali swoją metodę z kilkoma ustalonymi strategiami eksploracji, które skupiają się głównie na pokrywaniu przestrzeni lub skracaniu dystansu podróży. W symulacjach nowy system wygenerował mapy z mniejszymi zniekształceniami i osiągnął lepszą dokładność pozycjonowania, eksplorując w przybliżeniu w tym samym czasie lub krócej. Mniej też tracił śledzenie swojej pozycji i rzadziej zbliżał się zbyt blisko do poruszających się ludzi. W eksperymencie w świecie rzeczywistym metoda działała w czasie rzeczywistym na komputerze dostępnego w handlu robota, potwierdzając, że jest praktyczna do wdrożenia poza laboratorium.

Co to oznacza dla codziennych robotów

Mówiąc prosto, ta praca uczy robota, by był wybredny w kwestii tego, gdzie patrzy i dokąd idzie, gdy wokół są ludzie. Łącząc rozumienie sceny, przewidywanie ruchu i miarę przyrostu informacji, robot może kierować się ku widokom, które są jednocześnie informacyjne i bezpieczne, zamiast po prostu zmierzać do najbliższego niezbadanej wnęki. Dzięki temu jego wewnętrzna mapa jest bardziej niezawodna, a ruchy bardziej przewidywalne — to kluczowe cechy robotów, które muszą dzielić zatłoczone przestrzenie z ludźmi. Pozostają pewne wyzwania — na przykład nagłe duże tłumy zasłaniające kamerę — lecz podejście to stanowi krok w stronę robotów domowych i usługowych, które potrafią łagodnie radzić sobie z chaotyczną, dynamiczną naturą prawdziwego życia.

Cytowanie: Yang, Z., Sang, A.W.Y., Muthugala, M.A.V.J. et al. Mutual information-based hierarchical NBV decision for active semantic visual SLAM under dynamic environments. Sci Rep 16, 5847 (2026). https://doi.org/10.1038/s41598-026-36259-x

Słowa kluczowe: aktywny SLAM, nawigacja robotów, środowiska dynamiczne, mapowanie semantyczne, następny najlepszy widok