Clear Sky Science · pl

Monitorowanie otoczenia w rolnictwie i identyfikacja obiektów oparte na zoptymalizowanych konfiguracjach You Only Look Once i Single Shot Multibox Detector wykorzystujących połączone obrazy widzialne i termalne

Inteligentniejsze „oczy” dla bezpieczniejszych maszyn rolniczych

Nowoczesne traktory i kombajny są coraz większe, szybsze i bardziej zautomatyzowane, co rodzi proste, lecz poważne pytanie: jak zapewnić, by nie uderzyły w ludzi, zwierzęta lub inne maszyny ukryte w kurzu, mgle czy ciemności? W artykule opisano praktyczny system bezpieczeństwa, który daje maszynom rolniczym rodzaj „superwzroku” poprzez łączenie zwykowych kamer wideo i kamer termowizyjnych, a następnie porównuje różne konfiguracje sztucznej inteligencji, aby sprawdzić, która najdokładniej i najszybciej wykrywa zagrożenia.

Dlaczego praca na farmie potrzebuje lepszej wizji

Rolnictwo coraz bardziej opiera się na dużych, wydajnych maszynach pracujących wiele godzin, często w nocy lub w trudnych warunkach pogodowych. Podstawowa kamera wideo pomaga operatorowi widzieć wokół traktora, ale zwykły obraz zawodzi przy mgle, deszczu, silnym oślepiającym świetle czy w mroku. Kamery termalne, rejestrujące ciepło zamiast światła, działają dobrze w takich trudnych warunkach i uwypuklają ciepłe ciała — ludzi i zwierzęta — na tle otoczenia. Autorzy twierdzą, że połączenie obu typów obrazów jest najlepszym sposobem na zbudowanie przystępnego systemu ostrzegawczego, który można dokupić do istniejących maszyn i zintegrować ze standardowymi panelami sterowania traktora.

Jak działają systemy dwu- i jednolite

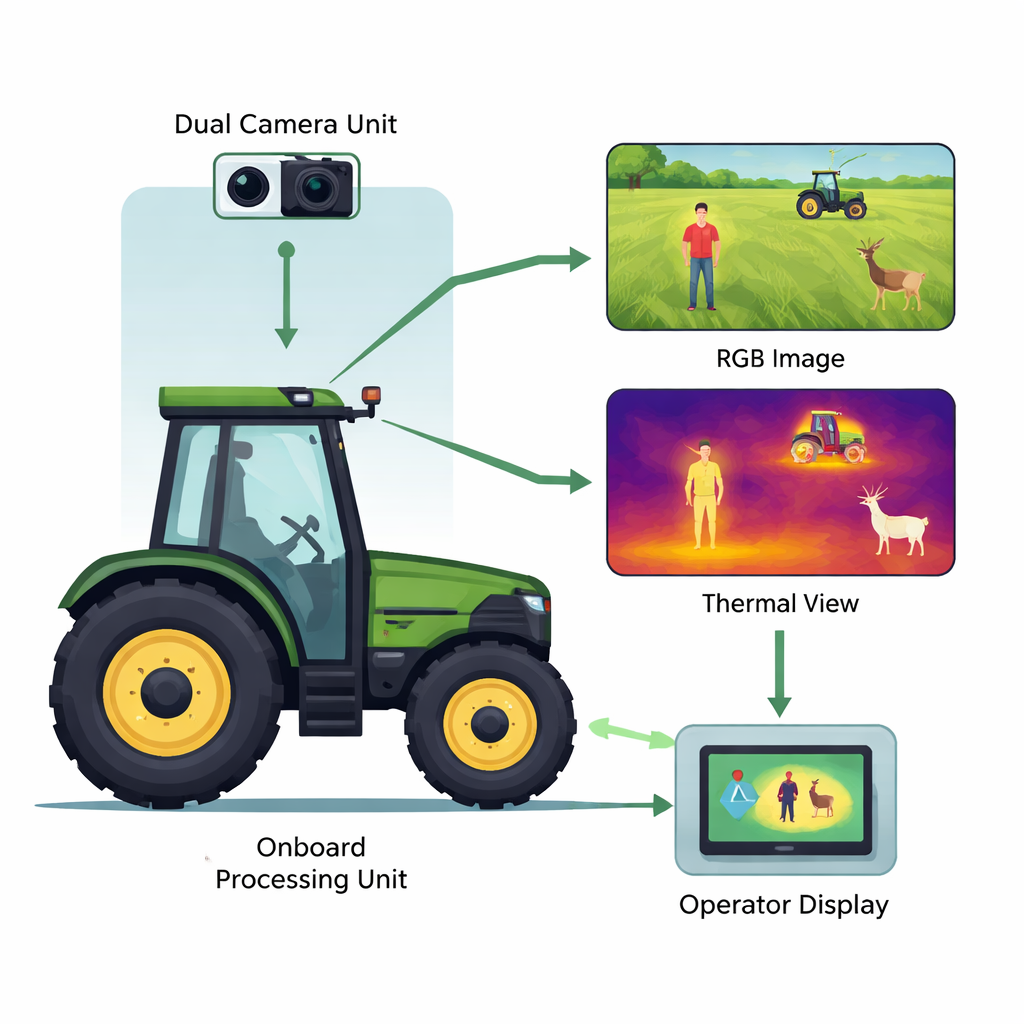

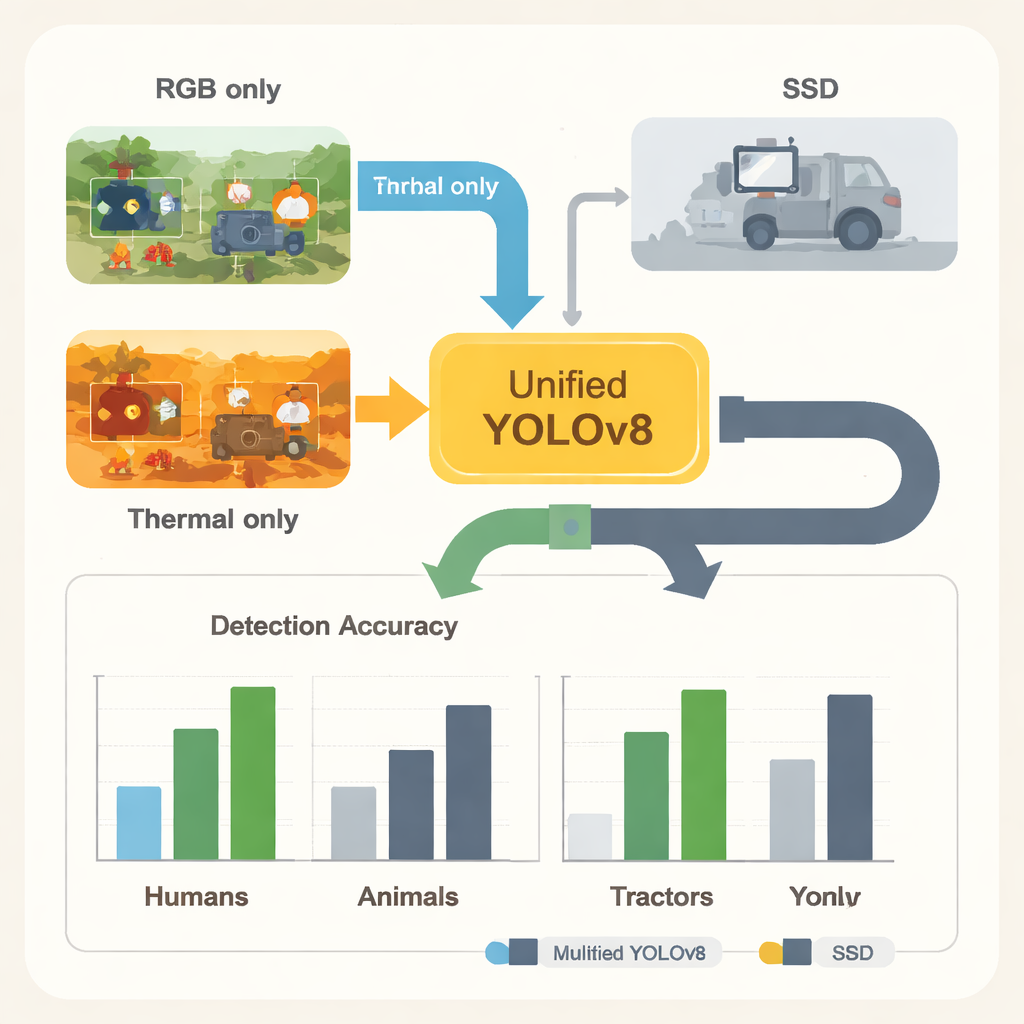

Zespół zamontował na dachu ciągnika zespół kamer łączących obraz RGB (zwykły kolor) i termalny i przesyłał oba strumienie obrazu do niskokosztowego procesora w kabinie. Badali dwa główne podejścia do wykorzystania sztucznej inteligencji do wykrywania obiektów. W pierwszym, „dwusieciowym” podejściu, jedna sieć neuronowa była trenowana tylko na obrazach widzialnych, a druga tylko na termalnych; ich wyniki były następnie łączone. W drugim, „jednolitym” podejściu, dwa obrazy były precyzyjnie wyrównane, zestackowane i wprowadzone do jednej sieci, która uczyła się na obu jednocześnie. Oba rozwiązania zaimplementowano przy użyciu rodziny szybkich modeli detekcji obiektów znanych jako YOLOv8 oraz alternatywnej konstrukcji zwanej SSD, dostosowanej do małych, wbudowanych komputerów.

Tworzenie i trenowanie „widzenia” maszyny dla pola

Aby nauczyć sieci, czego szukać, badacze zgromadzili duży zbiór danych z publicznych bibliotek obrazów oraz własnych nagrań kamerowych. Obrazy obejmowały ludzi, dzikie i domowe zwierzęta, traktory, kombajny, ciężarówki, autobusy i inne maszyny rolnicze, zarówno w widoku widzialnym, jak i termalnym. Każdy obiekt został otoczony ręcznie narysowanym polem ograniczającym i opisany etykietą, a następnie obrazy zostały zaugmentowane — odwracane, obracane lub nieznacznie rozmywane — aby naśladować różnorodność spotykaną na polach. Dane podzielono na zbiory treningowe, walidacyjne i testowe, tak aby sieci uczyły się na jednej części, a były oceniane uczciwie na obrazach, których wcześniej nie widziały. Położono szczególny nacisk nie tylko na surową dokładność, ale też na liczbę operacji obliczeniowych i liczbę klatek na sekundę, jakich wymagał każdy model, ponieważ każdy praktyczny system traktorowy musi działać szybko i niezawodnie w terenie.

Które cyfrowe „oczy” wypadły najlepiej?

Na tysiącach obrazów testowych wszystkie konfiguracje YOLOv8 wykrywały większość celów bardzo dobrze, zwłaszcza duże maszyny rolnicze i ciepłokrwiste zwierzęta. Model jednolity, który przyjmował jednocześnie dane RGB i termalne, osiągnął ogólny wynik (mean average precision) około 0,90, nieco wyżej niż układ dwusieciowy z wynikiem 0,88. Innymi słowy, fuzja obu rodzajów obrazów wewnątrz jednej sieci dała niewielki, ale zauważalny wzrost wydajności bez zwiększania złożoności obsługi systemu. Największe korzyści z obrazowania termalnego zaobserwowano dla ludzi i zwierząt w słabym oświetleniu, podczas gdy obrazy widzialne pozostawały lepsze dla szczegółowych kształtów, takich jak traktory. Gdy zespół zastąpił YOLOv8 uproszczonym modelem SSD, wydajność zauważalnie spadła dla większości klas, choć SSD trenował znacznie szybciej. YOLOv8, szczególnie jego najmniejsza wersja „Nano”, dostarczała wyższej dokładności przy zachowaniu rzeczywistych prędkości rzędu około 27 klatek na sekundę na skromnym sprzęcie.

Przekształcanie wykryć AI w proste ostrzeżenia

Zamiast zalewać kierowcę strumieniami wideo, system konwertuje wykrycia na prosty widok pulpitu zgodny ze wspólnym standardem komunikacji traktorowej (ISOBUS). Na prostym zielonym panelu ikony pokazują, czy przed maszyną znajduje się człowiek, zwierzę czy pojazd, wraz z informacją o odległości, kierunku i pewności systemu. Ten uproszczony interfejs może działać na istniejących terminalach operatora i jest zaprojektowany do trudnych warunków polowych, z zabezpieczonymi kamerami, stabilizowanymi mocowaniami oraz planami kontroli kurzu i temperatury w przyszłych wersjach.

Co to oznacza dla codziennego rolnictwa

Dla osoby niebędącej specjalistą wniosek jest taki, że wyposażenie traktorów w „dwa rodzaje oczu” i dobrze dobrany mózg AI może znacznie poprawić bezpieczeństwo bez potrzeby używania egzotycznego sprzętu. Jedna, starannie dostrojona sieć YOLOv8 łącząca widoki widzialne i termalne oferuje najlepszy kompromis między dokładnością, szybkością i prostotą spośród testowanych opcji, wyraźnie przewyższając konstrukcję SSD. Chociaż system nadal ma pewne trudności z rozpoznawaniem ludzi w każdej sytuacji — częściowo dlatego, że w danych treningowych było ich mniej — badanie pokazuje, że praktyczne systemy ostrzegawcze oparte na kamerach dla maszyn rolniczych są zarówno wykonalne, jak i bliskie gotowości do użytku w terenie. Z bardziej zbalansowanymi danymi i udoskonalonymi metodami fuzji przyszłe wersje mogłyby pomóc zapobiegać wypadkom, chronić przyrodę i uczynić rolnictwo na dużą skalę bezpieczniejszym dla wszystkich na polu i w jego otoczeniu.

Cytowanie: Tarasiuk, K., Mystkowski, A., Ostaszewski, M. et al. Agriculture surrounding monitoring and object identification based on optimized you only look once and single shot multibox detector setups using combined vision and thermal images. Sci Rep 16, 5129 (2026). https://doi.org/10.1038/s41598-026-36181-2

Słowa kluczowe: bezpieczeństwo w rolnictwie, obrazowanie termowizyjne, wizja komputerowa, detekcja obiektów, YOLOv8