Clear Sky Science · pl

M6: wieloproduktorowe, wielodziedzinowe, wielojęzyczne i wielokulturowe, wielogatunkowe, wieloinstrumentowe bazy danych do wykrywania muzyki generowanej przez maszyny

Dlaczego wzrost muzyki tworzonej przez AI ma znaczenie

Platformy strumieniujące muzykę cicho wypełniają się utworami napisanymi nie przez ludzi, lecz przez algorytmy. Te generowane przez maszyny ścieżki mogą być użytecznym narzędziem w terapii, muzyce filmowej czy codziennych playlistach, jednocześnie zacierając granicę między ludzką kreatywnością a zautomatyzowaną produkcją. W artykule przedstawiono M6 — dużą nową kolekcję muzyczną stworzoną, by pomóc badaczom rozróżniać muzykę wykonaną przez ludzi i przez AI oraz zrozumieć, co je odróżnia. Jej celem jest wspieranie uczciwego uznania twórców przy jednoczesnym umożliwieniu konstruktywnej roli AI w tworzeniu muzyki.

Budowanie obszernego poligonu testowego

Autorzy twierdzą, że postęp w wykrywaniu muzyki generowanej przez AI hamowany był przez brak odpowiednich danych. Istniejące zbiory albo koncentrują się na innych zadaniach, takich jak dopasowywanie muzyki do opisów tekstowych, albo obejmują tylko wąski wycinek stylów muzycznych. M6 ma wypełnić tę lukę. Łączy tysiące utworów tworzonych przez ludzi z tysiącami utworów wygenerowanych przez kilka różnych systemów AI, zapakowanych w standardowym formacie audio. Zbiór jest celowo szeroki: obejmuje wiele instrumentów, języków, kultur, gatunków, długości piosenek oraz zarówno utwory wokalne, jak i instrumentalne tło. Ta bogata różnorodność pozwala naukowcom sprawdzać, czy metody wykrywania działają w realistycznych, nieustannie zmieniających się warunkach muzycznych.

Zbieranie piosenek od ludzi i maszyn

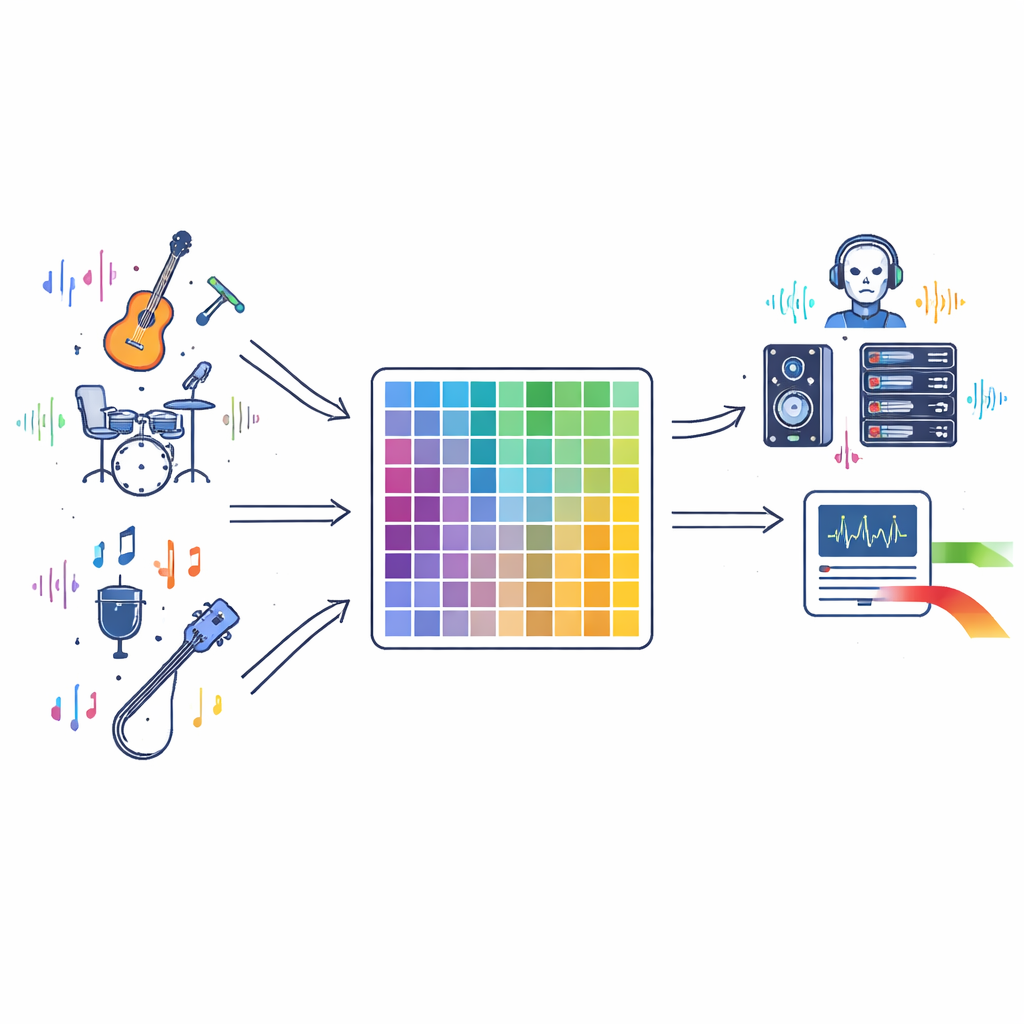

Aby skompletować część ludzką M6, zespół sięgnął po znane, otwarte kolekcje takie jak GTZAN (dla gatunków muzycznych), Free Music Archive, COSIAN (japońska muzyka wokalna) oraz zbiór dźwięków pojedynczych instrumentów. Dodatkowo próbkowali utwory ze platform streamingowych, gdy pozwalały na to licencje, wybierając fragmenty, które wyraźnie ukazują główny pomysł muzyczny, a nie tylko krótkie przejścia. Po stronie maszynowej wygenerowali nowe utwory przy użyciu kilku nowoczesnych systemów, w tym modeli badawczych open source i narzędzi komercyjnych. Starannie zaprojektowane polecenia, niektóre stworzone przez model językowy, prosiły te systemy o tworzenie muzyki w określonych stylach, tempach lub z konkretnymi instrumentami, tak aby utwory AI odzwierciedlały różnorodność muzyki ludzkiej.

Sprawdzanie jakości i dostrzeganie subtelnych różnic

Ponieważ oceny jakości muzyki są subiektywne, autorzy połączyli opinie słuchaczy z pomiarami obiektywnymi. Obliczyli proste numeryczne deskryptory dla każdego utworu, uwzględniające aspekty takie jak złożoność rytmów, szerokość zakresu melodycznego, jasność widma dźwięku oraz ilość energii w sygnale. Średnio utwory tworzone przez AI różniły się od ludzkich w tych miarach — na przykład często miały nieco węższy zakres wysokości dźwięku lub niższą ogólną energię — ale różnice były na tyle małe, że większość słuchaczy nie zauważyłaby ich bez dokładnego porównania. W testach odsłuchowych z 50 wolontariuszami ludzie poprawnie identyfikowali, czy fragment był stworzony przez człowieka czy AI, tylko w około połowie przypadków, co praktycznie nie różni się od losowego zgadywania. To sugeruje, że muzyka AI osiągnęła poziom dopracowania, który łatwo może zmylić przypadkowych słuchaczy.

Wystawienie metod wykrywania na próbę

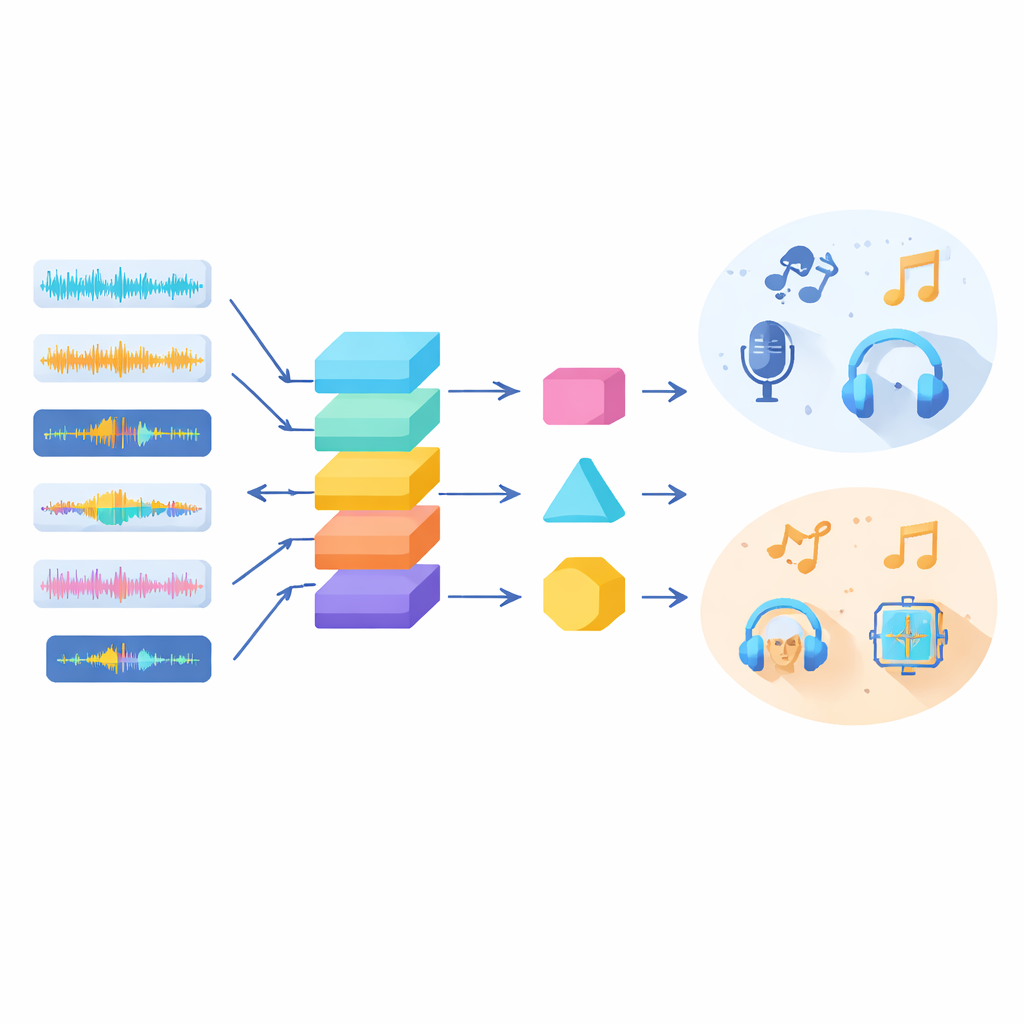

Dysponując M6, badacze ocenili różne modele komputerowe, by sprawdzić, jak dobrze potrafią wykrywać muzykę generowaną przez AI. Testowali klasyczne metody uczenia maszynowego, sieci neuronowe w stylu obrazowym przetwarzające spektrogramy, modele transformer oraz nowoczesne systemy audio pierwotnie stworzone do wykrywania fałszywego mowy. Gdy modele były trenowane i testowane na podobnych typach muzyki, kilka osiągało wysoką dokładność, szczególnie konwolucyjne sieci skupione na wzorcach w obrazie czas–częstotliwość dźwięku. Jednak wydajność gwałtownie spadała, gdy modele napotykały muzykę „poza domeną” — style, języki lub generatory, których wcześniej nie widziały. Badanie ujawniło również, że różne systemy generujące muzykę przez AI pozostawiają charakterystyczne akustyczne „odciski palców”, co sprawia, że niektóre generatory są łatwiejsze do wykrycia niż inne i rodzi obawy, że detektory mogą dopasowywać się do konkretnych narzędzi zamiast do głębszych cech muzyki maszynowej.

Co to oznacza dla muzyki i AI

Projekt M6 pokazuje, że choć komputery często potrafią poprawnie oznaczać muzykę generowaną przez AI w znanych warunkach, solidne wykrywanie w praktyce pozostaje poważnym wyzwaniem. Ludzie już mają trudności z odróżnieniem źródeł, a obecne algorytmy zawodzą, gdy muzyka zmienia się pod względem gatunku, języka, długości czy metody generowania. Publikując duży, różnorodny i otwarcie dostępny zbiór danych, autorzy mają nadzieję pobudzić rozwój bardziej niezawodnych i przejrzystych narzędzi wykrywających. Takie narzędzia mogłyby z kolei pomóc utrzymać zaufanie do platform muzycznych, wspierać sprawiedliwe uznawanie twórców ludzkich oraz kierować przyszłe systemy AI ku współpracy z muzykami zamiast ich cichego zastępowania.

Cytowanie: Li, Y., Li, H., Specia, L. et al. M6: multi-generator, multi-domain, multi-lingual and cultural, multi-genres, multi-instrument machine-generated music detection databases. Sci Rep 16, 9237 (2026). https://doi.org/10.1038/s41598-026-36044-w

Słowa kluczowe: muzyka wygenerowana przez AI, głosowe deepfake'i, wykrywanie muzyki, uczenie maszynowe, kreatywność cyfrowa