Clear Sky Science · pl

Autonomiczna nawigacja w niestrukturalnych środowiskach zewnętrznych z wykorzystaniem wzmacnianego uczenia kierowanego segmentacją semantyczną

Roboty uczące się wędrówek po lesie

Wyobraź sobie małego robota, który potrafi samodzielnie przejść leśną ścieżkę, omijając drzewa i kamienie bez GPS ani operatora z joystickiem. W artykule opisano system, który uczy takie roboty „widzieć” ścieżki w gęstym lesie i decydować, moment po momencie, jak bezpiecznie poruszać się naprzód. Praca ma znaczenie dla przyszłych robotów, które mogłyby wspierać monitorowanie lasów, zapobieganie pożarom, akcje poszukiwawczo-ratownicze, a nawet dostawy na zewnątrz w miejscach, gdzie sygnał satelitarny jest słaby lub nieosiągalny.

Dlaczego lasy są tak trudne dla robotów

Lasy należą do najtrudniejszych środowisk dla maszyn autonomicznych. Ścieżki bywają wąskie i kręte, podłoże nierówne, gałęzie i krzewy często zasłaniają widok, a wysokie drzewa czynią sygnały GPS zawodnymi. Tradycyjne metody nawigacji opierają się na precyzyjnych mapach, silnym GPS lub drogich czujnikach laserowych i zwykle zakładają klarowne, ustrukturyzowane przestrzenie, takie jak ulice czy hale fabryczne. W lesie te założenia zawodzą: cienie, zmienne pory roku i gęsta roślinność dezorientują proste systemy wizyjne, a sterowniki oparte na regułach mają trudności z radzeniem sobie ze wszystkimi chaotycznymi, nieoczekiwanymi sytuacjami, które pojawiają się na prawdziwej ścieżce.

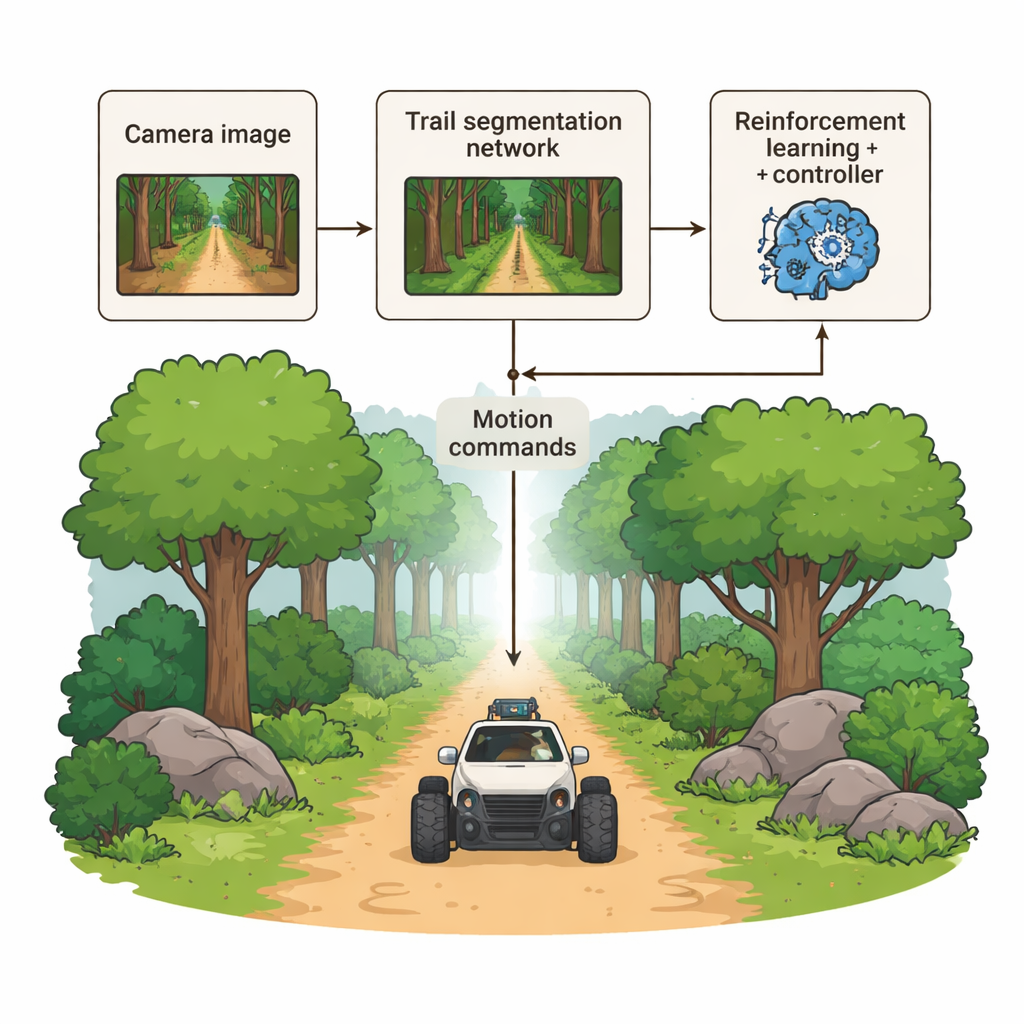

Trzy „mózgi” pracujące razem

Autorzy proponują hybrydowy system nawigacji, który daje robotom trzy uzupełniające się „mózgi”. Po pierwsze, moduł głębokiej wizji analizuje każde zdjęcie z kamery i niemal piksel po pikselu oznacza, które fragmenty należą do przejezdnej ścieżki. Po drugie, moduł decyzyjny oparty na uczeniu wykorzystuje wzmacniane uczenie do wybierania płynnych poleceń skrętu i prędkości, nagradzając zachowania, które utrzymują pojazd na ścieżce, unikają kolizji i efektywnie osiągają cel. Po trzecie, klasyczny regulator przekształca przewidywany kształt ścieżki w stabilne ruchy kół, wygładzając nagłe zmiany i zachowując trajektorię robota bardziej łagodną niż szarpaną. Zamiast jednego, nieprzejrzystego sieciowego rozwiązania end-to-end, moduły te są odrębne, ale ściśle powiązane, co pozwala inżynierom rozumieć i debugować każdy etap.

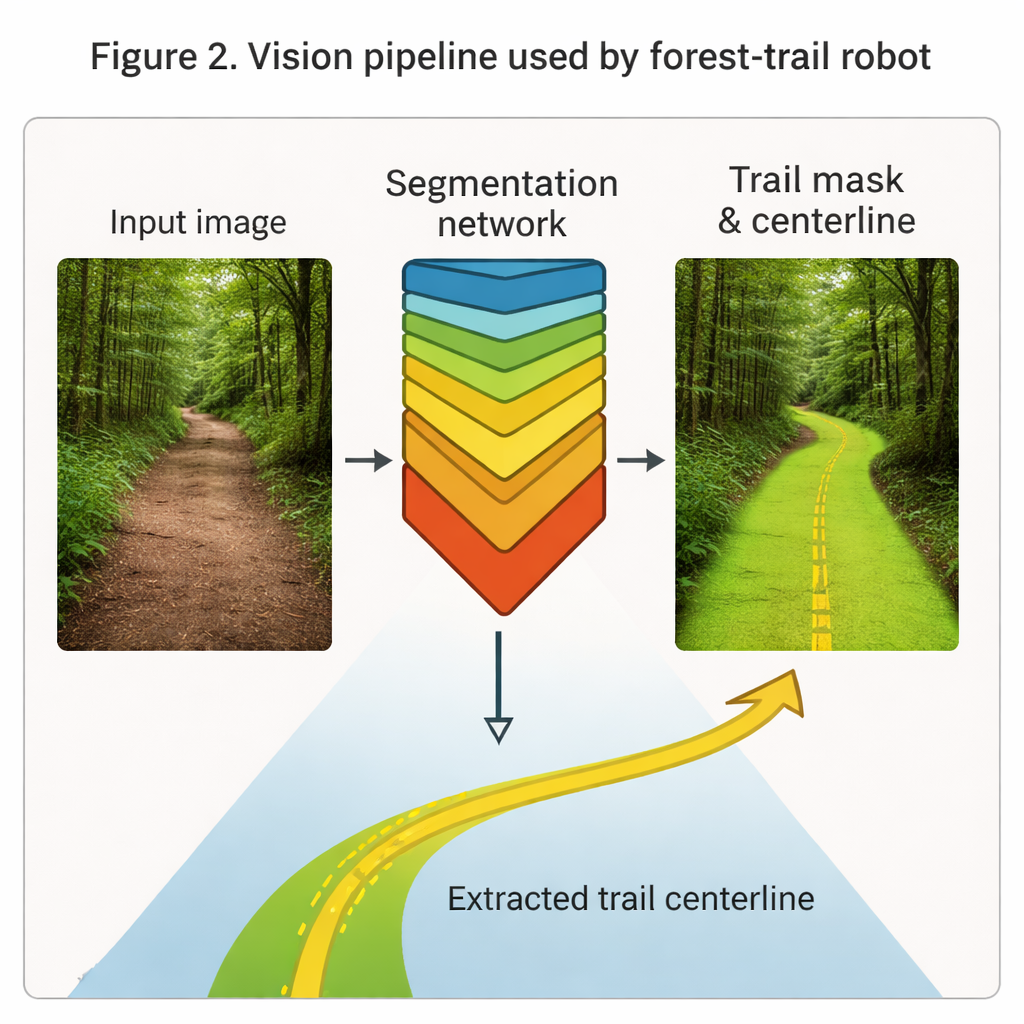

Uczenie widzenia rozpoznawania ścieżek

W centrum „oczu” robota znajduje się głęboka sieć znana jako Mask R-CNN, tu dostrojona do wyróżniania leśnych ścieżek na zwykłych obrazach kolorowych. Trenowana na blisko 24 000 oznaczonych klatek z rzeczywistych nagrań wykonywanych z wysokości ludzkiego wzroku przy zróżnicowanym świetle, pogodzie i typach szlaków, sieć uczy się malować region ścieżki w każdej klatce jako czystą maskę. Z tej maski wyodrębnia cienką krzywą środkową, która odwzorowuje kierunek i krzywiznę drogi przed robotem. W testach moduł wizyjny osiąga wysokie pokrycie z etykietami narysowanymi przez ludzi i ponad 90% dokładności pikselowej, pewnie wyznaczając ścieżki nawet wtedy, gdy gałęzie lub cienie częściowo zasłaniają drogę. Te geometryczne wskazówki trafiają bezpośrednio do modułów uczącego i sterującego jako zwarty opis „gdzie jest ścieżka”.

Szkolenie robota do podejmowania dobrych decyzji

Drugim kluczowym elementem jest moduł decyzyjny, który korzysta z techniki zwanej wzmacnianym uczeniem. Zamiast otrzymywać dokładne instrukcje, robot próbuje działań w realistycznej symulacji leśnej i otrzymuje nagrody za dobre wyniki oraz kary za złe. Poruszanie się wzdłuż ścieżki jest korzystne; zbaczanie, kolizje z przeszkodami czy utknięcie są negatywne. W ciągu około 150 000 kroków treningowych system stopniowo odkrywa strategie, które utrzymują go na środku ścieżki, płynnie radzą sobie z zakrętami i sensownie reagują na pojawiające się gałęzie lub kamienie. Aby utrzymać ruchy gładkie i bezpieczne, wyuczone działania mogą być łączone z poleceniami klasycznego regulatora, co okazuje się szczególnie pomocne na ostrych zakrętach lub w warunkach szumu sensorycznego.

Testowanie systemu

Aby ocenić skuteczność tej kombinacji, badacze zbudowali trzy szczegółowe wirtualne lasy: jeden z wąskimi, zagraconymi ścieżkami, drugi z stromym, nierównym terenem i dużymi przeszkodami, a trzeci wypełniony rozwidleniami, ślepymi końcami i mylącymi fałszywymi ścieżkami. W 90 próbach w tych mapach robot dotarł do celu bez kolizji w około 87% epizodów, ze średnio tylko 0,2 zderzenia na bieg i zwykle pozostawał w odległości około 30 centymetrów od środka ścieżki. Również kończył trasy szybko i konsekwentnie. Gdy autorzy usuwali lub upraszczali poszczególne moduły, wydajność gwałtownie spadała — co pokazuje, że wszystkie trzy komponenty są niezbędne. W porównaniu z innymi nowszymi systemami, w tym tymi używającymi skanerów laserowych, to podejście hybrydowe oparte wyłącznie na wizyj dostarczyło najlepszą ogólną mieszankę wskaźnika sukcesu, precyzji i bezpieczeństwa.

Co to znaczy dla robotów w realnym świecie

Dla osoby niebędącej specjalistą istotą jest to, że roboty coraz lepiej radzą sobie z wędrówkami jak ostrożni, kompetentni użytkownicy szlaków. Łącząc silne wyczucie kontekstu wizualnego („to jest ścieżka”), decyzje oparte na doświadczeniu („te ruchy sprawdzały się wcześniej”) oraz stabilny mechanizm sterowania, proponowany system pozwala małemu robotowi kołowemu poruszać się po złożonych lasach bez map i GPS. Choć praca była testowana w symulacji i nadal stoi przed wyzwaniami, takimi jak ekstremalne oświetlenie czy rzadkie typy ścieżek, oferuje praktyczny plan działania dla przyszłych robotów terenowych, które mogą bezpiecznie współdzielić dzikie środowiska z ludźmi, pomagając w inspekcji lasów, wspieraniu zespołów ratunkowych i skuteczniejszym gospodarowaniu zasobami naturalnymi.

Cytowanie: Tibermacine, A., Tibermacine, I.E., Akrour, D. et al. Autonomous navigation in unstructured outdoor environments using semantic segmentation guided reinforcement learning. Sci Rep 16, 2633 (2026). https://doi.org/10.1038/s41598-026-36022-2

Słowa kluczowe: autonomiczna nawigacja, robotyka leśna, wizja komputerowa, wzmacniane uczenie, segmentacja semantyczna