Clear Sky Science · pl

Zrozumienie dyskursu o zdrowiu psychicznym na Reddicie przy użyciu transformerów i metod wyjaśniających

Dlaczego rozmowy o uczuciach w internecie mają znaczenie

Wiele osób zmagających się z lękiem, depresją, zaburzeniem afektywnym dwubiegunowym lub zaburzeniem osobowości typu borderline zwraca się najpierw do internetu, zanim porozmawia z profesjonalistą. Reddit, ze swoimi anonimowymi społecznościami, stał się dużym miejscem spotkań do dzielenia się lękami, proszenia o pomoc i wspierania innych. W tym badaniu przeanalizowano, jak wyglądają tysiące takich rozmów i jak sztuczna inteligencja może je sortować oraz wskazywać słowa, które ludzie najczęściej używają, mówiąc o różnych problemach ze zdrowiem psychicznym.

Zaglądanie do społeczności wsparcia

Naukowcy skupili się na czterech dużych społecznościach na Reddicie poświęconych lękowi, depresji, zaburzeniu afektywnemu dwubiegunowemu oraz zaburzeniu osobowości typu borderline (często skracanym do BPD). Każdy post w ich zbiorze danych był oznaczony jedynie nazwą społeczności, z której pochodził, a nie diagnozą medyczną. Zespół traktował te społeczności jako „przestrzenie troski”, gdzie osoby z podobnymi trudnościami gromadzą się, by się wygadać, szukać porad i oferować wsparcie. Studiując różnice językowe między tymi przestrzeniami, autorzy chcieli zrozumieć, jak ludzie opisują swoje doświadczenia własnymi słowami, poza kliniką.

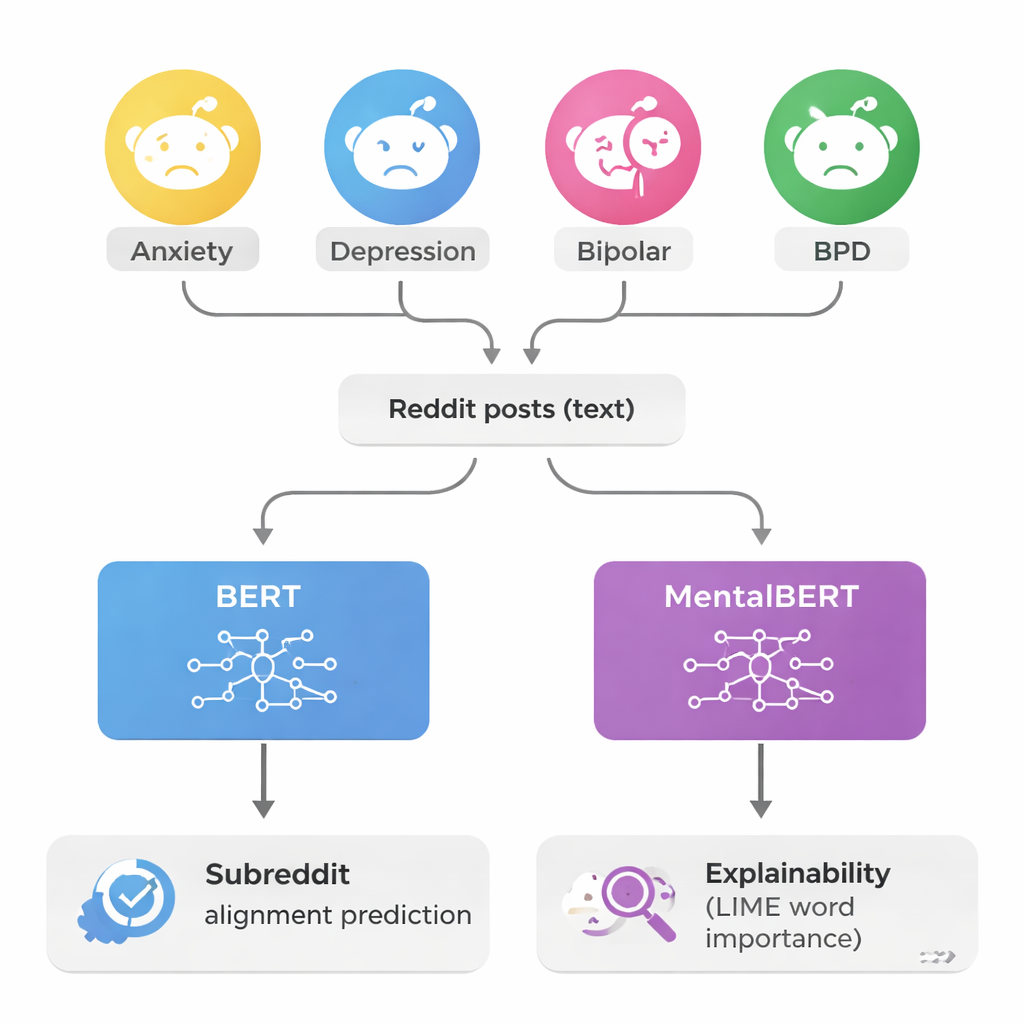

Nauczanie komputerów sortowania rozmów

Aby przeanalizować ponad 150 000 postów, autorzy użyli potężnych modeli językowych zwanych transformerami, w szczególności BERT oraz wersji skoncentrowanej na zdrowiu psychicznym o nazwie MentalBERT. Modele te czytały każdy post i próbowały odgadnąć, do której z czterech społeczności należy. Ponieważ niektóre społeczności miały znacznie więcej postów niż inne, zespół ostrożnie wyrównał zbiór danych, tak aby każda grupa była reprezentowana równomiernie. To uczyniło zadanie trudniejszym, ale uczciwszym — zmuszając modele do rzeczywistego rozróżniania stylów językowych, zamiast faworyzowania najczęściej występujących społeczności. W testach modele prawidłowo oznaczały posty około 82 procent czasu — znaczący skok ponad losowym zgadywaniem, które miałoby trafność jedynie jedną czwartą.

Otwarcie „czarnej skrzynki” AI

Jednym z głównych zastrzeżeń w technologii zdrowia psychicznego jest to, że systemy komputerowe mogą wyglądać jak tajemnicze „czarne skrzynki”, dając przewidywania bez jasnych powodów. Aby temu przeciwdziałać, badacze zastosowali podejście zwane LIME, które ujawnia, które słowa skłaniały model do konkretnej decyzji. W prostych słowach: LIME ukrywa lub modyfikuje fragmenty posta i obserwuje, jak zmienia się odpowiedź modelu. Jeśli usunięcie słowa takiego jak „panika” nagle zmienia przewidywaną społeczność, to słowo uznaje się za ważne. Powtarzając ten proces tysiące razy na wielu postach, zespół stworzył listy najbardziej wpływowych słów dla każdej społeczności i sprawdził, czy te słowa zgadzają się z wiedzą kliniczną na temat poszczególnych zaburzeń.

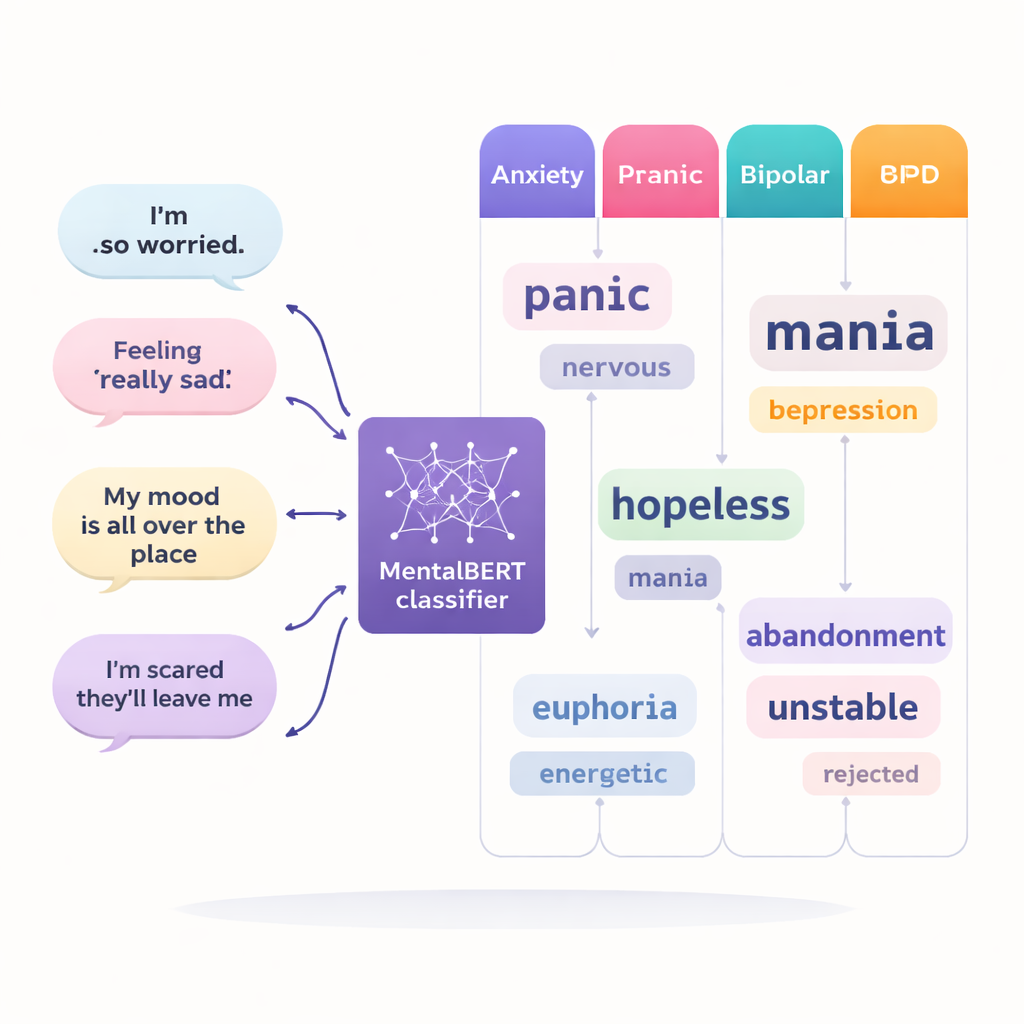

Wyraźne głosy dla różnych trudności

Wyjaśnienia ujawniły wyraźne wzorce językowe. W społecznościach związanych z lękiem wyróżniały się słowa takie jak „panika”, „atak” i „martwienie się”, często powiązane z objawami fizycznymi i nagłymi napadami strachu. W postach o depresji często pojawiały się terminy takie jak „beznadziejny”, „bezwartościowy”, „życie” i „już”, odzwierciedlając głęboki smutek i poczucie braku nadziei na poprawę. W dyskusjach o BPD kluczowe słowa przesuwały się ku relacjom i emocjom, w tym „porzucenie”, „związek”, „przywiązanie” oraz „fp” (skrót od „favorite person”, czyli „ulubiona osoba”, termin powszechny w tych grupach). Posty o zaburzeniu afektywnym dwubiegunowym podkreślały zmiany nastroju i słownictwo związane z leczeniem, z takimi słowami jak „mania”, „maniakalny”, „hipomania”, „nastrój” oraz nazwami leków, np. „lit” i „lamictal”. Modele ujawniły też obszary, gdzie zaburzenia się zacierają: posty o lęku i depresji mogą na przykład koncentrować się na cierpieniu i negatywnych uczuciach, co ułatwia ich wzajemne mylenie — podobnie jak bywa w rzeczywistej diagnostyce.

Od postów online do realnego wpływu

Dla osoby niebędącej specjalistą kluczowe przesłanie jest takie, że komputery potrafią wiarygodnie sortować rozmowy o zdrowiu psychicznym według tematu i wyjaśniać, jakie słowa wpływają na ich wybory, ale nadal nie mogą i nie powinny nikogo diagnozować. Modele użyte w tym badaniu działają raczej jak bibliotekarze przestrzeni wsparcia online: pomagają sprawdzić, czy dyskusje w danej społeczności rzeczywiście odpowiadają jej deklarowanemu profilowi. Może to wspierać moderatorów w utrzymaniu trafności konwersacji oraz pomóc badaczom i klinicystom lepiej rozumieć, jak ludzie opisują swoje trudności poza formalnymi wizytami. Przy ostrożnym nadzorze ludzkim oraz dbałości o prywatność i stygmatyzację, takie narzędzia mogą pewnego dnia wspierać tworzenie bardziej przyjaznych i lepiej zorganizowanych przestrzeni do rozmów o zdrowiu psychicznym.

Cytowanie: Sánchez Rodríguez, I., Bianchi, J., Pinelli, F. et al. Understanding mental health discourse on Reddit with transformers and explainability. Sci Rep 16, 6796 (2026). https://doi.org/10.1038/s41598-026-35918-3

Słowa kluczowe: zdrowie psychiczne, media społecznościowe, Reddit, wyjaśnialna sztuczna inteligencja, klasyfikacja tekstu