Clear Sky Science · pl

Niepokój związany ze sztuczną inteligencją i intencje adopcyjne w szkolnictwie wyższym na podstawie rozszerzonego modelu TAM-UTAUT i analizy PLS-SEM

Dlaczego obawy przed AI mają znaczenie na uczelni

Uniwersytety na całym świecie ścigają się, by włączyć generatywną sztuczną inteligencję (SI) do nauczania i badań. Od narzędzi tworzących szkice esejów po systemy wspomagające projektowanie planów zajęć — technologie te obiecują oszczędność czasu i wzrost kreatywności. Jednak wielu studentów i wykładowców odczuwa niepokój, kiedy myśli o ich użyciu. W tym badaniu analizujemy ten niepokój — „lęk przed AI” — aby zrozumieć, jak różne rodzaje obaw mogą albo blokować, albo wręcz zachęcać osoby w szkolnictwie wyższym do wprowadzania narzędzi AI.

Trzy rodzaje obaw związanych z AI

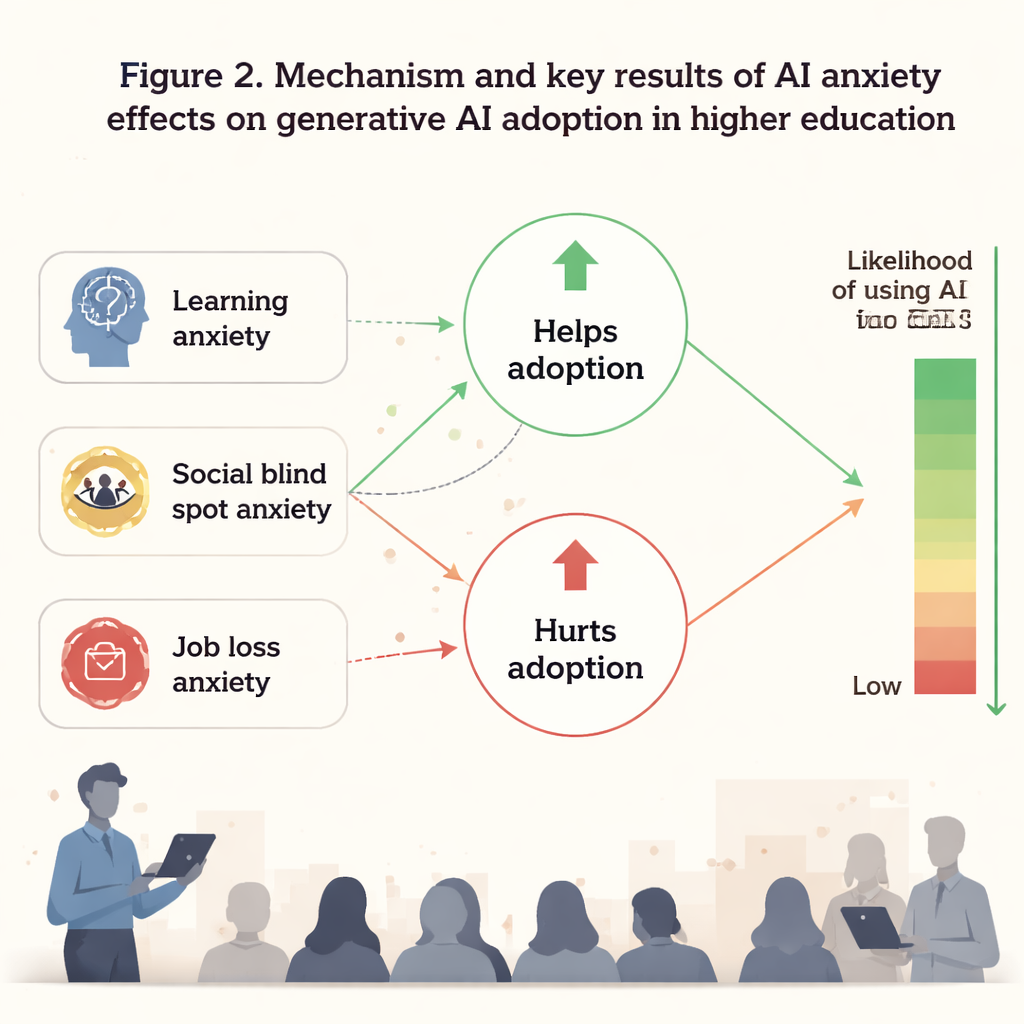

Naukowcy koncentrują się na trzech odrębnych formach lęku związanego z AI. Pierwszy to lęk przed nauką: obawa, że nie uda się opanować złożonych narzędzi AI lub że „nie jest się wystarczająco technicznym”. Drugi to to, co określają jako lęk przed socjotechniczną niewidocznością: obawa przed zostaniem w wydziale osobą wykluczoną, niebiorącą udziału w nowych praktykach cyfrowych i dyskusjach. Trzeci to lęk przed utratą pracy: głębszy strach, że AI może zastąpić kluczowe elementy czyjejś roli — pisanie, ocenianie, a nawet projektowanie kursów — i w efekcie uczynić niektóre stanowiska akademickie zbędnymi. Zamiast traktować lęk jako jedno, proste uczucie, autorzy twierdzą, że każdy z tych rodzajów ma własne źródła i konsekwencje.

Od uczuć do decyzji

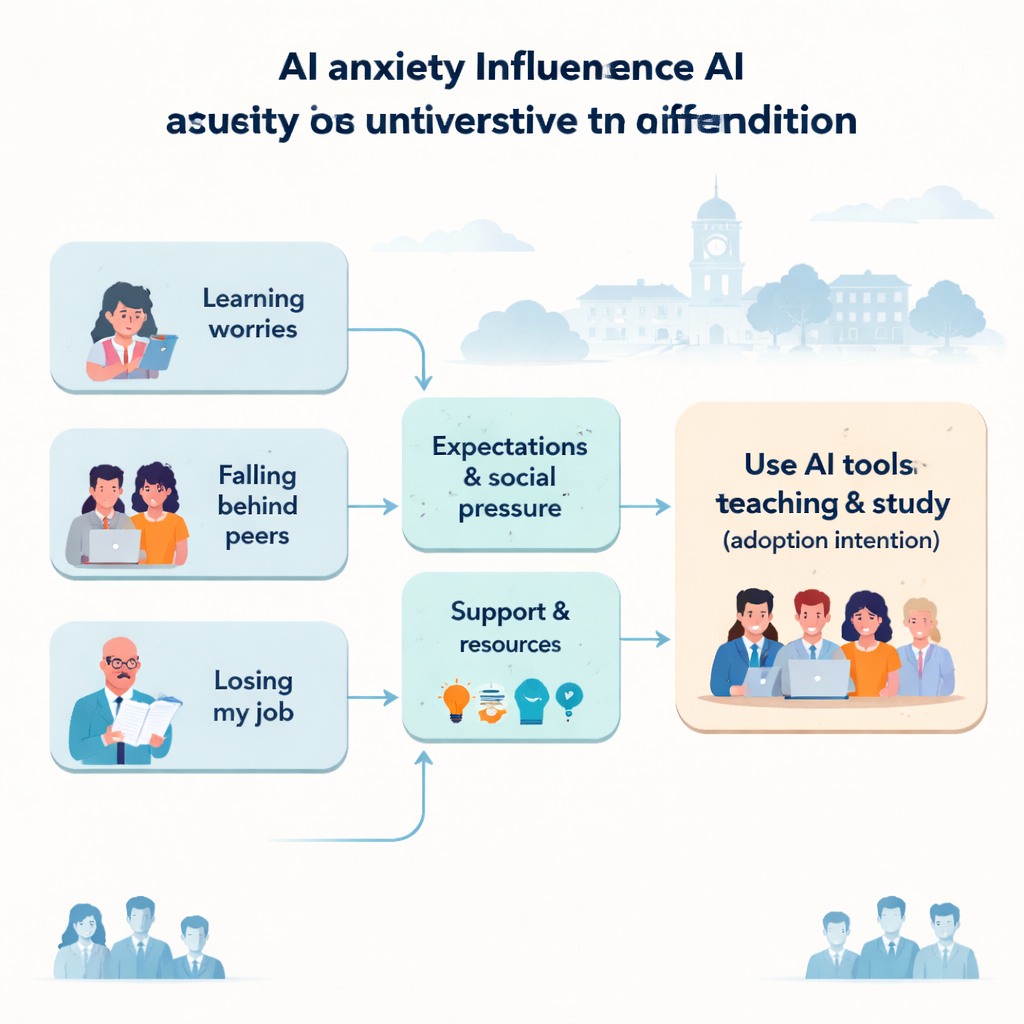

Aby zobaczyć, jak te lęki kształtują rzeczywiste wybory, zespół połączył dwie dobrze znane teorie używania technologii, które zwykle skupiają się na przekonaniach racjonalnych: na tym, jak przydatne wydaje się narzędzie, jak łatwe jest jego użycie, jak presja społeczna wpływa na decyzję oraz jaka jest dostępność wsparcia. Przeprowadzili ankietę wśród 407 studentów i wykładowców na trzech uniwersytetach w prowincji Syczuan w Chinach, pytając o ich obawy związane z AI, oczekiwania wobec generatywnej AI oraz czy zamierzają używać takich narzędzi w nauce lub nauczaniu. Zastosowawszy technikę statystyczną zwaną modelowaniem równań strukturalnych, zmapowali, jak reakcje emocjonalne przekładają się na oczekiwania dotyczące wydajności, wysiłku, wpływu społecznego i wsparcia — i w końcu na decyzję o przyjęciu AI.

Kiedy strach powstrzymuje ludzi

Lęk przed utratą pracy okazał się najsilniej szkodzącą siłą. Osoby obawiające się, że AI może obniżyć ich wartość zawodową, miały tendencję do oceniania AI jako mniej pomocnej, trudniejszej do opanowania, mniej wspieranej społecznie i słabiej wspieranej zasobami instytucjonalnymi. Ten zestaw negatywnych przekonań mocno zmniejszał ich intencję korzystania z narzędzi AI. Lęk przed nauką także nadgryzał pewność siebie, sprawiając, że AI wydawała się trudniejsza i mniej osiągalna, choć jego skutki były słabsze i bardziej zależne od kontekstu. W takich przypadkach strach prowadzi do postawy obronnej: zamiast postrzegać AI jako asystenta, zaniepokojeni użytkownicy widzą w niej zagrożenie i wycofują się z możliwości eksperymentowania.

Kiedy strach pobudza do działania

Lęk przed socjotechniczną niewidocznością opowiada bardziej zaskakującą historię. Osoby bojące się zostania „analfabetami AI” w swojej społeczności akademickiej czasami reagowały poprzez aktywne zaangażowanie, zamiast rezygnacji. Ten rodzaj społecznego lęku wiązał się z silniejszym przekonaniem, że mogą i powinni włożyć wysiłek w naukę AI, większą wrażliwością na to, jak rówieśnicy postrzegają użycie AI, a w wielu przypadkach — z większą intencją przyjęcia generatywnych narzędzi. Jednocześnie nieco osłabiał ich przekonanie, że AI rzeczywiście poprawi wydajność. Innymi słowy, ten sam społeczny lęk, który może uderzać w poczucie kompetencji, może też popychać do nadrobienia zaległości, tworząc „miecz obosieczny”, który zarówno podważa pewność siebie, jak i napędza naukę.

Kto lepiej radzi sobie z lękiem przed AI

Badanie pokazuje także, że kontekst ma znaczenie. Studenci i wykładowcy z dziedzin nauk ścisłych i inżynieryjnych częściej przekształcali lęk przed nauką w motywację do eksperymentowania z AI, co odzwierciedla kulturę już przyzwyczajoną do szybkich zmian technologicznych. Dla odmiany osoby z humanistyki i nauk społecznych, które częściej rozważają kwestie etyczne i sensu, częściej postrzegały AI jako zagrożenie dla podstawowych wartości akademickich. Poczucie własnej skuteczności w obszarze AI — czyli pewność, że w końcu opanuje się te narzędzia — również odgrywało istotną rolę. Osoby o wysokiej samoefektywności potrafiły przekształcić część lęku w sygnał do poprawy, a nie powód do rezygnacji, i lepiej zamieniały niepokój w konstruktywne działanie.

Co to oznacza dla uniwersytetów

Dla szkolnictwa wyższego przesłanie jest jasne: lęk przed AI nie jest po prostu hamulcem innowacji, ani czymś, co można zignorować. Niektóre obawy, szczególnie te dotyczące utraty pracy, mogą poważnie osłabić chęć przyjęcia generatywnej AI i wymagają bezpośrednich odpowiedzi, takich jak jasne definiowanie ról, wsparcie w rozwoju kariery i przejrzyste polityki. Inne obawy, zwłaszcza strach przed pozostaniem w tyle za rówieśnikami, można przekształcić w motywację, jeśli uczelnie zapewnią dostępne szkolenia, społeczności uczenia się rówieśniczego i narzędzia, które wydają się wykonalne, a nie przytłaczające. Uznając i pracując z tymi różnymi odcieniami lęku — zamiast zakładać, że cały strach jest zły — instytucje mogą promować przemyślane, odpowiedzialne i bardziej sprawiedliwe wykorzystanie AI na kampusie.

Cytowanie: Kai, C., Ping, W. & Xiaomin, J. AI anxiety and adoption intention in higher education based on an extended TAM-UTAUT and PLS-SEM analysis. Sci Rep 16, 3672 (2026). https://doi.org/10.1038/s41598-026-35823-9

Słowa kluczowe: niepokój związany z AI, generatywna AI w edukacji, adopcja technologii, nauczanie na uniwersytecie, postawy studentów