Clear Sky Science · pl

Udoskonalony uogólniony optymalizator rozkładu normalnego z metodą naprawczą rozkładu Gaussa i odwrotnym uczeniem Cauchy’ego do selekcji cech

Dlaczego wybór właściwych danych ma znaczenie

Współczesne życie opiera się na danych — od badań medycznych i zapisów bankowych po feedy mediów społecznościowych. Jednak więcej danych nie zawsze oznacza lepiej. Gdy systemy uczą się na tysiącach surowych pomiarów jednocześnie, mogą działać wolniej, być droższe w eksploatacji i — co zaskakujące — mniej dokładne. W artykule przedstawiono mądrzejszy sposób przesiewania tych pomiarów i zachowywania tylko tych, które rzeczywiście mają znaczenie, wykorzystując nowy algorytm o nazwie Binary Adaptive Generalized Normal Distribution Optimizer, w skrócie BAGNDO.

Problem nadmiaru wskazówek

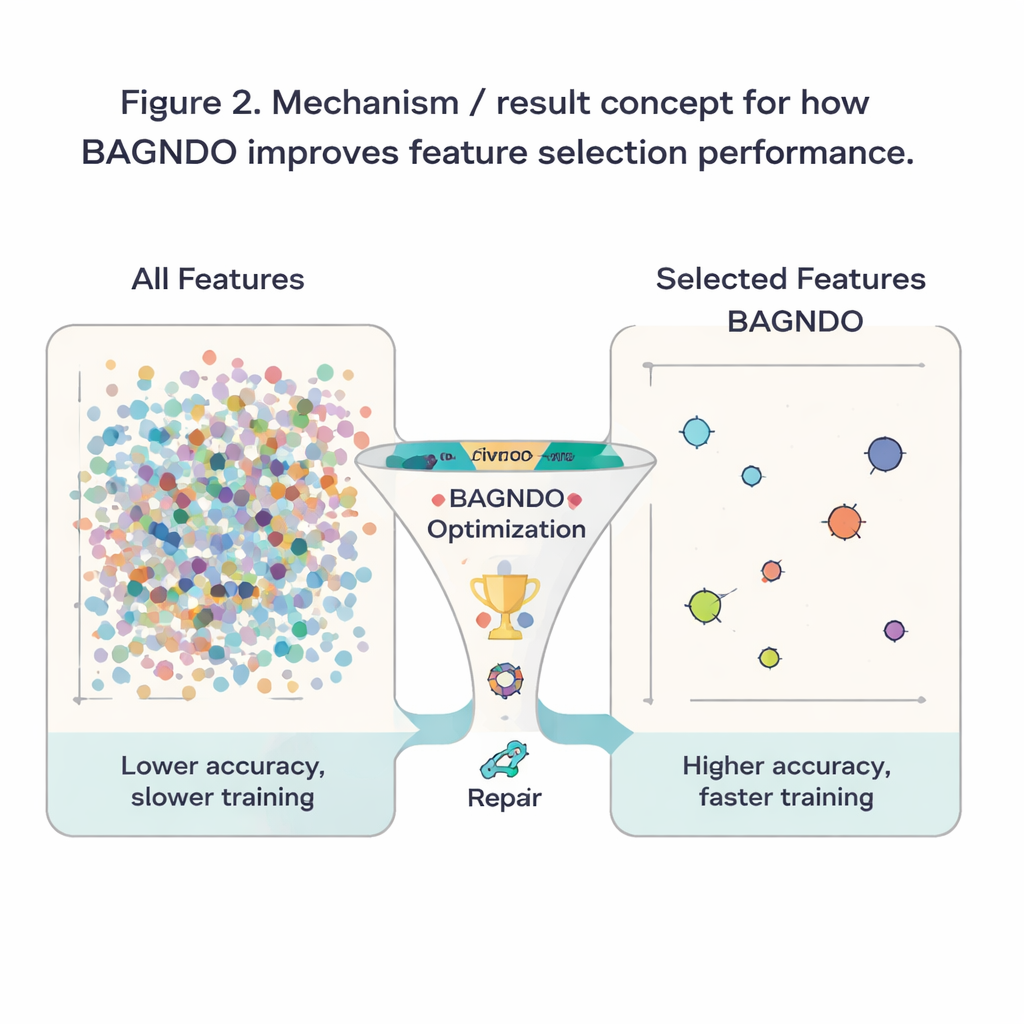

Wyobraźmy sobie diagnozowanie choroby przy użyciu setek testów laboratoryjnych, skanów i odpowiedzi na ankiety. Wiele z tych „cech” może być zaszumionych, redundantnych lub po prostu nieistotnych, a podanie ich wszystkich klasyfikatorowi może bardziej go mylić niż pomagać. Selekcja cech ma na celu wybór mniejszego, bardziej informacyjnego podzbioru wejść, aby modele uczenia maszynowego były szybsze, tańsze i bardziej niezawodne. Proste filtry statystyczne usuwają oczywiście bezużyteczne cechy, ale nie są dostosowane do konkretnego modelu i często pomijają subtelne kombinacje zmiennych. Bardziej zaawansowane metody „wrapper” oceniają zestawy cech, testując bezpośrednio wydajność klasyfikatora, lecz tworzy to ogromny problem przeszukiwania: liczba możliwych podzbiorów eksploduje wraz ze wzrostem liczby cech.

Sprytne przeszukiwanie zamiast na ślepo

Aby poradzić sobie z tą eksplozją, badacze polegają na algorytmach metaheurystycznych — strategiach przeszukiwania inspirowanych procesami naturalnymi lub fizycznymi, które równoważą szeroką eksplorację z ukierunkowanym dopracowywaniem. Jedną z takich metod jest Generalized Normal Distribution Optimizer (GNDO), który traktuje kandydatów rozwiązań tak, jakby były próbami z elastycznej krzywej dzwonowej i stopniowo przesuwa tę krzywą w kierunku lepszych odpowiedzi. GNDO sprawdził się w inżynierii i zastosowaniach energetycznych, ale ma skłonność do zbyt wczesnego zadowalania się przeciętnymi rozwiązaniami i ma trudności z pogodzeniem globalnego eksplorowania z lokalnym dopracowywaniem w zadaniach selekcji cech. Autorzy wskazują to jako krytyczną lukę: elegancka matematyka GNDO nie przekłada się automatycznie na silne wyniki przy wysokowymiarowych, binarnych decyzjach o tym, które cechy zachować.

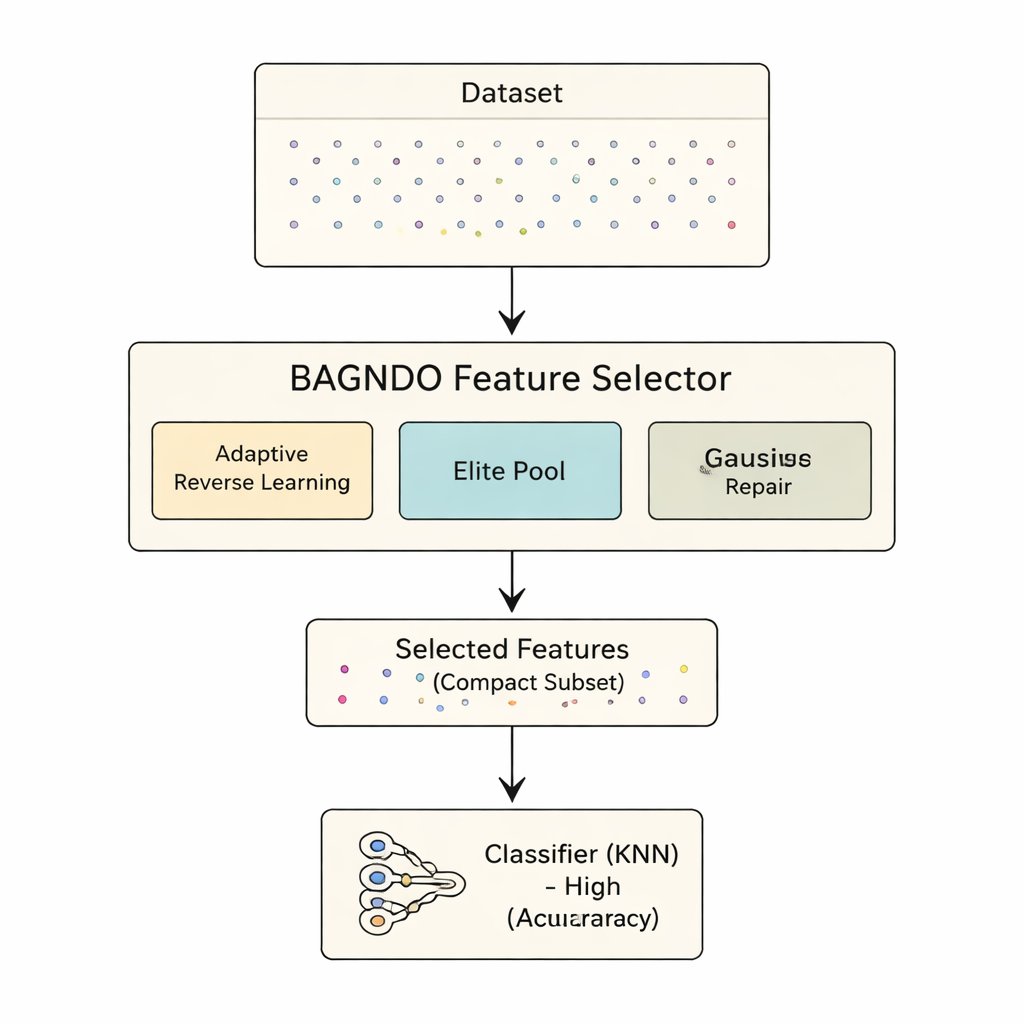

Trójelementowy upgrade klasycznego silnika

Proponowany framework BAGNDO rozwija GNDO za pomocą trzech skoordynowanych pomysłów. Po pierwsze, strategia Adaptive Cauchy Reverse Learning regularnie generuje „lustrzane” wersje bieżących rozwiązań, korzystając z rozkładu o ciężkich ogonach. To zachęca do odważnych skoków w nieodkryte rejony przestrzeni przeszukiwania, zapobiegając utknięciu algorytmu w lokalnych minima. Po drugie, Strategia Puli Elitarnych utrzymuje nie tylko pojedyncze najlepsze rozwiązanie, lecz małą grupę najlepszych wykonawców oraz uśrednionego kandydata „przewodnika”. Ta bogatsza grupa przywódcza pomaga zachować różnorodność, jednocześnie kierując poszukiwania w obiecujące rejony. Po trzecie, metoda naprawy najsłabszych rozwiązań oparta na rozkładzie Gaussa analizuje najsłabszych kandydatów i delikatnie przesuwa ich w kierunku wzorców wyciągniętych z grupy elit, efektywnie przekształcając złe rozwiązania w lepsze zamiast od razu je odrzucać.

Testy metody

Aby sprawdzić skuteczność tych pomysłów w praktyce, autorzy zastosowali BAGNDO do 18 dobrze znanych zbiorów testowych z repozytorium UCI, obejmujących diagnozowanie medyczne, gry, sygnały i inne dziedziny. W każdym przypadku algorytm wyszukiwał podzbiór cech, który umożliwiał standardowemu klasyfikatorowi k-NN dokładne przewidywania. BAGNDO zmierzyło się z dziewięcioma silnymi konkurentami, w tym optymalizacją rojem cząstek, metodami opartymi na genetyce oraz kilkoma nowoczesnymi algorytmami inspirowanymi rojami. W testach BAGNDO konsekwentnie znajdowało mniejsze zbiory cech przy zachowaniu, a często poprawie, dokładności predykcji. Uzyskało najlepszą dokładność przy najbardziej zwartej liczbie cech w 14 z 18 zbiorów, a testy statystyczne potwierdziły, że te zyski nie były rezultatem przypadku.

Co to oznacza dla codziennego uczenia maszynowego

Dla czytelnika nietechnicznego rezultat można podsumować krótko: autorzy zbudowali bardziej zdyscyplinowany „wybieracz cech”, który pomaga algorytmom uczenia skupić się na tym, co naprawdę ważne w zbiorze danych. Poprzez lepsze łączenie szerokiej eksploracji, elitarnych wskazówek i naprawy słabych kandydatów, BAGNDO odcina niepotrzebne wejścia przy jednoczesnym utrzymaniu lub zwiększeniu dokładności. To przekłada się na szybsze modele, mniejsze koszty przechowywania i obliczeń oraz często jaśniejsze wnioski, które pomiary lub pytania są najbardziej informatywne. Chociaż metoda jest bardziej wymagająca obliczeniowo niż niektóre prostsze alternatywy, oferuje potężne narzędzie tam, gdzie najważniejsze są dokładność i interpretowalność — od wsparcia decyzji medycznych po monitoring przemysłowy i dalsze zastosowania.

Cytowanie: Ghetas, M., Elaziz, M.A. & Issa, M. Enhanced generalized normal distribution optimizer with Gaussian distribution repair method and cauchy reverse learning for features selection. Sci Rep 16, 4794 (2026). https://doi.org/10.1038/s41598-026-35804-y

Słowa kluczowe: selekcja cech, optymalizacja metaheurystyczna, uczenie maszynowe, redukcja wymiarowości, dokładność klasyfikacji