Clear Sky Science · pl

Hierarchiczna agregacja informacji kontekstowych do segmentacji polipów

Dlaczego drobne zmiany w jelicie mają znaczenie

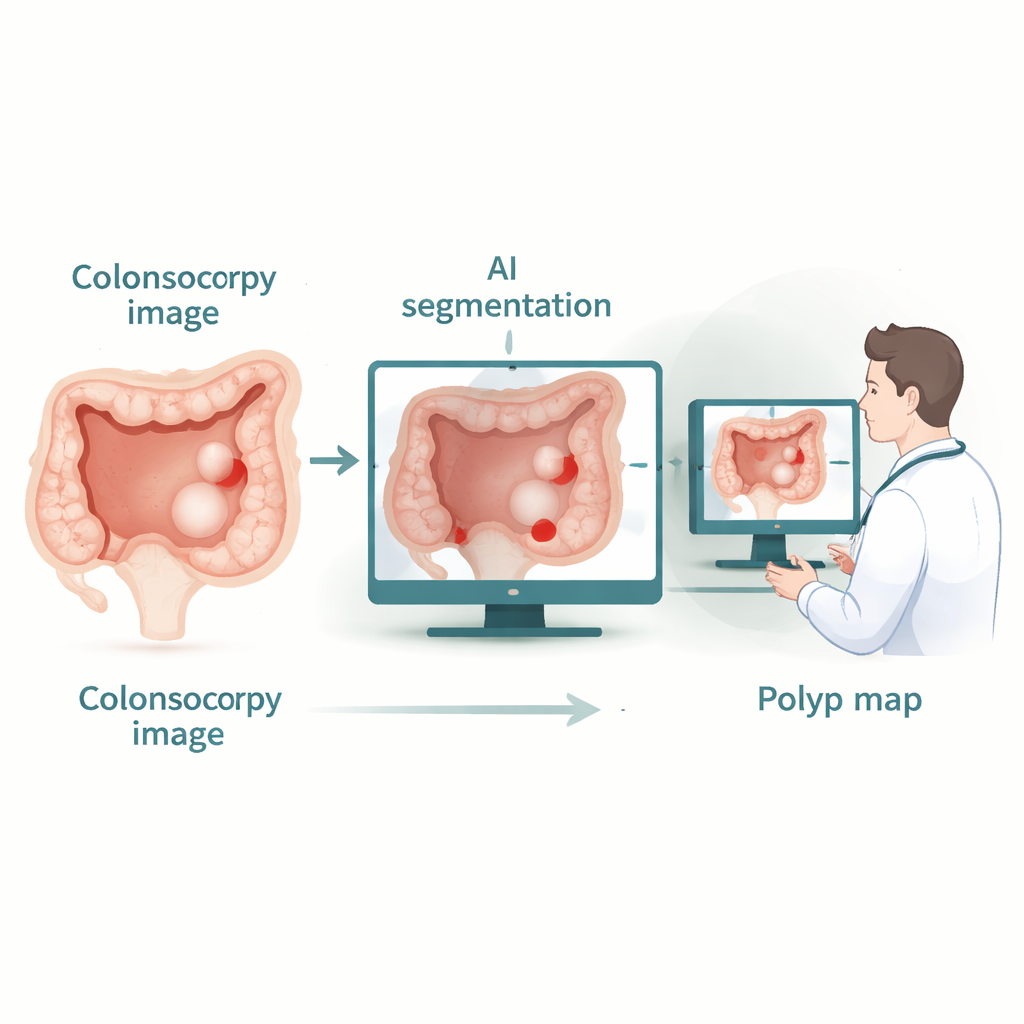

Rak jelita grubego często zaczyna się jako małe, pozornie niegroźne guzki zwane polipami na błonie śluzowej jelita grubego. Podczas kolonoskopii lekarze starają się je wykryć i usunąć, zanim staną się niebezpieczne. Jednak ludzie się męczą, obraz bywa niepełny, a badania pokazują, że nawet do jednej czwartej polipów może zostać przeoczona. W artykule przedstawiono nowy system sztucznej inteligencji (AI) zaprojektowany do automatycznego wytyczania obrysów polipów na obrazach z kolonoskopii z dużą precyzją, mający stać się wiarygodnym asystentem pomagającym lekarzom dostrzegać więcej i przegapiać mniej.

Widzieć i las, i drzewa

Nowoczesne narzędzia AI do obrazów medycznych zwykle dzielą się na dwa obozy. Jeden, oparty na klasycznych sieciach konwolucyjnych, bardzo dobrze rozpoznaje drobne, lokalne szczegóły, takie jak subtelne krawędzie czy zmiany tekstury, lecz ma trudności ze zrozumieniem relacji między odległymi obszarami obrazu. Drugi, oparty na modelach transformatorowych, świetnie wychwytuje zależności na dużą skalę — widzi „cały obraz” — ale może tracić ostrość przy małych strukturach, np. cienkich granicach polipów, i bywa kosztowny obliczeniowo. Ostatnie hybrydowe systemy próbują łączyć oba podejścia, jednak często faworyzują część konwolucyjną i nie wykorzystują w pełni mechanizmów uwagi, co prowadzi do rozmytych krawędzi i utraty kontekstu.

Nowy sposób łączenia wskazówek na różnych skalach

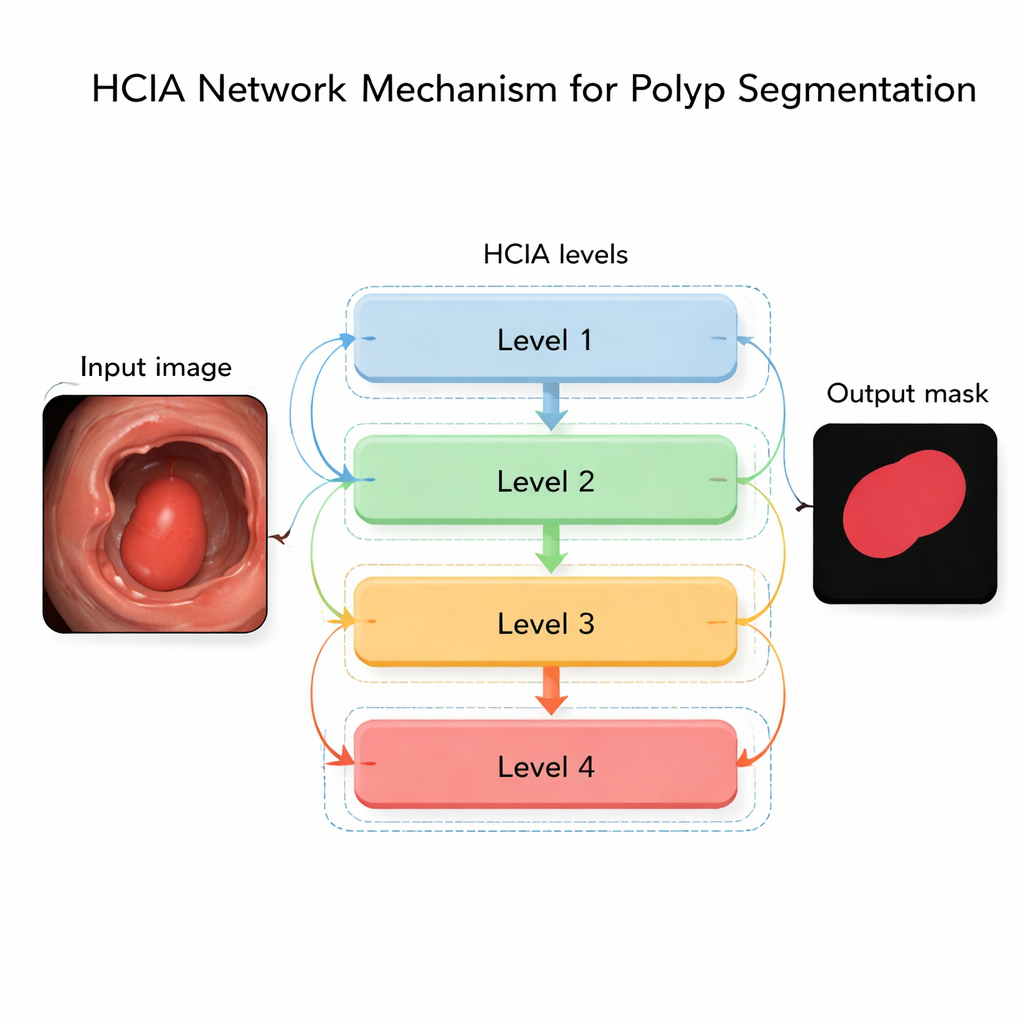

Autorzy proponują sieć nazwaną Hierarchical Contextual Information Aggregation (HCIA), aby przezwyciężyć te ograniczenia. HCIA została zaprojektowana tak, by jednocześnie analizować obraz z kolonoskopii na kilku poziomach szczegółu — od widoków ogólnych po zbliżenia — i umożliwiać tym poziomom wymianę informacji w uporządkowany sposób. Kluczowym elementem jest Hierarchical Aggregation Module (HAM), który łączy informacje z sąsiednich poziomów. Poprzez mieszanie kontekstów ogólnych z drobnymi detalami, HAM pomaga systemowi odróżniać polipy od tła o zróżnicowanych kolorach, kształtach i rozmiarach oraz wyostrza granice między polipem a zdrową tkanką.

Sprytna uwaga bez dużych nakładów obliczeniowych

Drugim istotnym modułem jest Interconnected Attention Module (IAM), który rozwiązuje problem globalnego kontekstu. Zamiast liczyć uwagę w tradycyjny sposób — porównując każdy piksel z każdym innym pikselem, co szybko staje się kosztowne — IAM używa współdzielonej „pamięci”, która podsumowuje to, czego sieć nauczyła się na wszystkich poziomach. Każdy poziom odwołuje się do tej pamięci, aby zdecydować, które części jego cech zasługują na większe skupienie. Takie rozwiązanie pozwala IAM budować połączenia na duże odległości w całym obrazie, przy jednoczesnym kontrolowaniu kosztu obliczeń. Co ważne, ta sama pamięć jest współdzielona między gałęziami sieci, co daje formę spójnego, globalnego nadzoru, pomagającego modelowi koncentrować się na polipach niezależnie od ich rozmiaru czy położenia.

Testy systemu

Aby sprawdzić, czy projekt HCIA ma praktyczne znaczenie, autorzy przetestowali go na trzech szeroko używanych zbiorach obrazów polipów, z których każdy zawiera setki do tysiąca klatek z kolonoskopii z odręcznie naniesionymi obrysami polipów przez ekspertów. Porównali HCIA z ponad dwudziestoma czołowymi modelami AI, obejmującymi zarówno tradycyjne sieci konwolucyjne, jak i nowsze hybrydy oparte na transformatorach. We niemal wszystkich miarach — jak dobrze przewidywane obszary polipów pokrywają się z oznaczeniami ekspertów, jak wiernie odwzorowywane są kształty oraz jak dobrze dopasowane są struktury — HCIA wypadło najlepiej lub dorównywało najlepszym konkurentom. Model był szczególnie silny przy testach międzyzbiorowych, wymagającym scenariuszu, który odzwierciedla, jak narzędzie musi działać w różnych szpitalach używających różnych urządzeń i warunków obrazowania. Szczegółowe porównania wizualne pokazały, że HCIA bardziej niezawodnie uchwyciło nieregularne kształty polipów i słabe granice niż konkurencyjne metody.

Co to oznacza dla pacjentów i klinicystów

Dla osób niebędących specjalistami kluczową informacją jest to, że HCIA to system AI, który dokładniej wyznacza obrysy potencjalnie nowotworowych zmian na obrazach z kolonoskopii, pracując jednocześnie wystarczająco szybko, by nadawać się do użycia w czasie rzeczywistym. Łącząc ostre lokalne detale z silnym wyczuciem kontekstu ogólnego przy efektywnym wykorzystaniu zasobów, zmniejsza ryzyko, że subtelne lub nietypowo ukształtowane polipy pozostaną niezauważone. Chociaż model wymaga jeszcze optymalizacji pod kątem bardzo lekkich urządzeń i nie korzysta jeszcze z informacji wynikających z sekwencji wideo w czasie, stanowi znaczący krok w kierunku inteligentniejszej, bardziej niezawodnej komputerowej pomocy w przesiewaniu raka jelita grubego — wspierając lekarzy w wykrywaniu groźniejszych zmian, zanim staną się zagrażające życiu.

Cytowanie: Li, L., Yang, H., Zhang, J. et al. Hierarchical contextual information aggregation for polyp segmentation. Sci Rep 16, 5959 (2026). https://doi.org/10.1038/s41598-026-35703-2

Słowa kluczowe: polipy jelita grubego, Sztuczna inteligencja w kolonoskopii, segmentacja obrazów medycznych, głębokie uczenie, wczesne wykrywanie raka