Clear Sky Science · pl

CRFusion: nowa sieć fuzji LiDAR-kamera do budowy map BEV

Mądrzejsze mapy cyfrowe dla samochodów autonomicznych

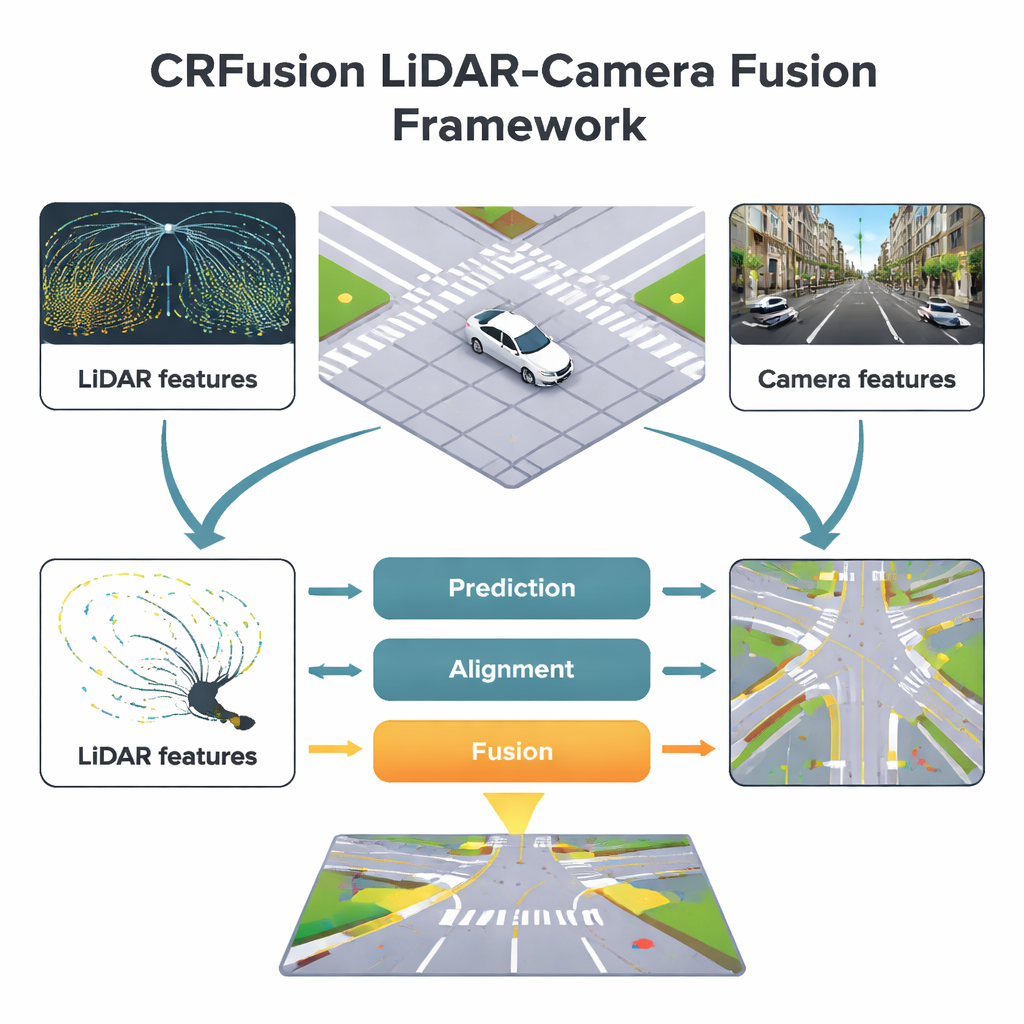

Dla samochodu autonomicznego zrozumienie drogi przed nim przypomina czytanie mapy, która ciągle się zmienia. Pojazd musi dokładnie wiedzieć, gdzie są pasy, przejścia dla pieszych i krawędzie jezdni, nawet gdy jest ciemno, pada deszcz lub coś zasłania widok. W artykule przedstawiono CRFusion — nowy system łączący skanery laserowe i kamery, aby tworzyć czyściejsze, bardziej niezawodne mapy z widoku z góry ulic miejskich, pomagając autonomicznym samochodom pewniej trzymać pasy i unikać pieszych.

Dlaczego dwa „elektroniczne oczy” są lepsze niż jedno

Nowoczesne samochody autonomiczne polegają przede wszystkim na dwóch głównych czujnikach. Kamery rejestrują bogate obrazy kolorowe, dzięki czemu łatwo wykryć oznakowanie pasów, znaki drogowe i przejścia z daleka. Skanery laserowe, czyli LiDAR, wysyłają impulsy świetlne i mierzą ich odbicia, tworząc dokładny obraz 3D odległości i kształtów wokół pojazdu. Każdy z nich ma słabości: obrazy z kamer mogą być zafałszowane przez słabe oświetlenie lub niepogodę, natomiast pomiary LiDAR stają się rzadkie i niepełne wraz ze wzrostem odległości. CRFusion jest zaprojektowany tak, by połączyć te mocne i słabe strony w jedną mapę z widoku z lotu ptaka, mapę z góry, gdzie każdy piksel reprezentuje niewielki fragment powierzchni oznaczony jako pas, separator lub przejście dla pieszych.

Wypełnianie luk w długodystansowym widzeniu

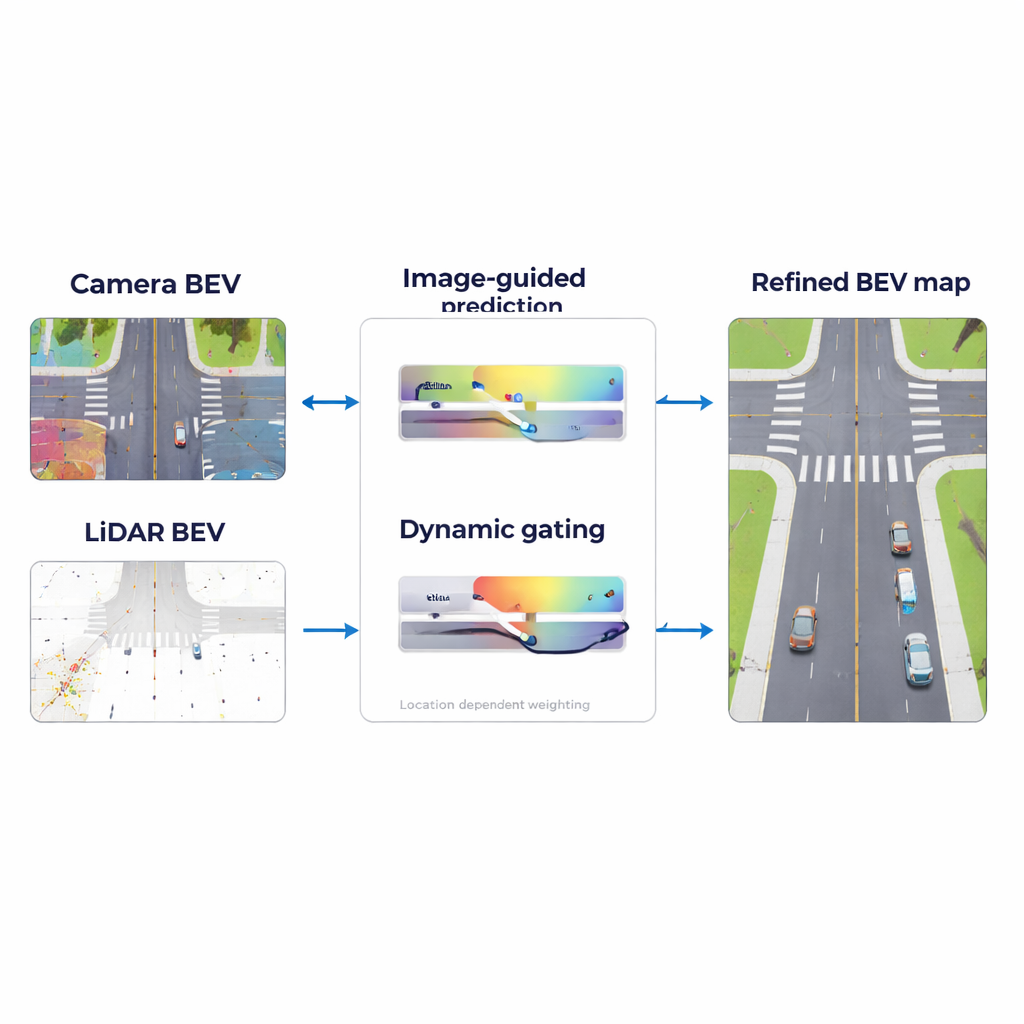

Kluczowym wyzwaniem w mapowaniu dróg jest to, że LiDAR często pomija szczegóły daleko od samochodu, dokładnie tam, gdzie planowanie z wyprzedzeniem jest najważniejsze. CRFusion rozwiązuje to za pomocą „Predyktora Zasięgu LiDAR”. Mówiąc prościej, system patrzy na to, co kamera widzi daleko na drodze, i wykorzystuje te informacje, by odgadnąć, co LiDAR zmierzyłby, gdyby był gęsty i kompletny. Mechanizm zwany uwagą (attention) pomaga modelowi zdecydować, które części widoku kamery najlepiej wyjaśniają puste lub niepewne obszary w mapie opartej na LiDAR. Następnie udoskonala tę predykcję, porównując sąsiednie regiony w mapie, wzmacniając spójne wzory, takie jak ciągłe linie pasów, i redukując losowy szum.

Uzgadnianie obrazu między czujnikami

Nawet gdy kamera i LiDAR działają poprawnie, ich widoki nie zawsze idealnie się pokrywają. Niewielkie błędy w szacowaniu odległości lub pozycjonowaniu czujników mogą sprawić, że oznakowanie pasów widoczne na obrazie z kamery wydaje się nieco przesunięte względem odczytów LiDAR. CRFusion wprowadza krok wyrównania, który delikatnie „odkształca” cechy z mapy top-down kamery, tak aby lepiej odpowiadały widokowi LiDAR. Odbywa się to przy użyciu lekkiej sieci korekcyjnej, która przewiduje, jak każdy punkt na mapie kamery powinien zostać przesunięty. W rezultacie oba widoki czujników opisują te same fizyczne pozycje na drodze, co sprawia, że późniejsze łączenie danych jest dużo bardziej wiarygodne.

Dopasowanie do dnia, nocy i złej pogody

Gdy już widoki obu czujników są wyrównane, system dalej musi zdecydować, na ile ufać któremu z nich w każdym miejscu. Słoneczna autostrada z wyraźnym oznakowaniem bardzo różni się od deszczowej nocy w zatłoczonym mieście. CRFusion rozwiązuje to za pomocą modułu „Dynamicznej Fuzji z Bramką” (Dynamic Gated Fusion), który przypisuje elastyczne wagi cechom z kamery i LiDAR w całej mapie. Tam, gdzie powroty LiDAR są silne, na przykład przy krawędziach jezdni lub solidnych obiektach w pobliżu, system bardziej polega na LiDAR. Tam, gdzie wskazówki wizualne są wyraźniejsze, na przykład jasne pasy przejść w oddali, opiera się bardziej na kamerze. Wagi te są uczone automatycznie z danych, co pozwala strategii fuzji płynnie się zmieniać wraz z warunkami.

Potwierdzenie korzyści na danych z rzeczywistości

Badacze przetestowali CRFusion na szeroko stosowanym zestawie danych dla jazdy autonomicznej o nazwie NuScenes, który zawiera wiele scen jazdy w różnych miastach, warunkach pogodowych i porach dnia. W porównaniu z wiodącymi wcześniejszymi metodami, CRFusion wygenerował dokładniejsze granice pasów, separatory i przejścia dla pieszych, zwłaszcza na średnich i długich dystansach do 90 metrów. Poprawił standardowe miary jakości zarówno pod względem nakładania się z mapami referencyjnymi, jak i zdolności wykrywania poszczególnych odcinków pasów, a badanie „ablacyjne” wykazało, że każdy główny komponent — predykcja dalekiego zasięgu, sieć wyrównująca i dynamiczna fuzja — wniósł istotne korzyści. Przykłady wizualne ukazały gładszą ciągłość pasów i wyraźniejsze przejścia, potwierdzając, że mapy systemu bardziej przypominają starannie narysowane plany drogowe.

Co to oznacza dla codziennej jazdy

Dla osób nietechnicznych główny wniosek jest taki, że CRFusion pomaga samochodom autonomicznym budować czyściejsze, bardziej niezawodne mapy ulic, pozwalając kamerom i LiDAR „rozmawiać ze sobą” w inteligentniejszy sposób. Poprzez przewidywanie brakujących informacji LiDAR na podstawie widoków z kamery, dopasowywanie obu perspektyw czujników i dostosowywanie, ile ufać każdemu z nich w zależności od sytuacji, system zmniejsza martwe strefy i domysły. To przybliża pojazdy autonomiczne o krok do radzenia sobie ze skomplikowanymi, zagraconymi ulicami miejskimi z taką samą pewnością jak rozważny kierowca ludzki, podążający za dobrze oznakowanymi pasami i przejściami.

Cytowanie: Guan, Y., Wang, T., Cheng, Q. et al. CRFusion: a novel LiDAR-camera fusion network for BEV map construction. Sci Rep 16, 5169 (2026). https://doi.org/10.1038/s41598-026-35551-0

Słowa kluczowe: autonomiczna jazda, fuzja LiDAR-kamera, HD mapy semantyczne, percepcja z widoku z lotu ptaka, mapowanie dróg miejskich