Clear Sky Science · pl

Projekt i wdrożenie sterowania ramieniem robota 6-DoF z wykrywaniem obiektów opartym na uczeniu maszynowym przy użyciu mini mikrokontrolera

Inteligentniejsze ramiona robotów przy niższym budżecie

Wyobraź sobie przemysłowe ramię robota, które potrafi wykryć obiekt, zdecydować, jak go uchwycić, i płynnie przemieścić się na właściwe miejsce — wszystko to bez wsparcia dużego komputera lub połączenia z chmurą. Artykuł opisuje dokładnie takie rozwiązanie: sześciostawowe (6-DoF) ramię robotyczne, które widzi i podejmuje decyzje korzystając z małego, niedrogiego mikrokontrolera. Dla czytelników zainteresowanych tym, jak sztuczna inteligencja wychodzi z centrów danych i trafia do codziennych maszyn, praca ta pokazuje, jak zaawansowana wizja i sterowanie mogą działać na sprzęcie niewiele większym niż pendrive.

Dlaczego zmniejszanie „mózgów” robotów ma znaczenie

Tradycyjne roboty przemysłowe często polegają na wydajnych zewnętrznych komputerach do rozpoznawania obiektów i planowania ruchu. To zwiększa koszty, okablowanie i złożoność techniczną, co bywa barierą dla małych i średnich firm. Autorzy postawili sobie za cel udowodnić, że pojedynczy, tani mikrokontroler może wykonać prawie wszystko: widzieć obiekty, określać ich położenie w przestrzeni 3D, planować ruchy ramienia i napędzać silniki realizujące zadanie. Utrzymując przetwarzanie lokalnie, system staje się bardziej przenośny, energooszczędny i łatwiejszy do wdrożenia w ciasnych lub zmiennych warunkach — od małych zakładów po pracownie dydaktyczne.

Elastyczne ramię, które można zbudować samodzielnie

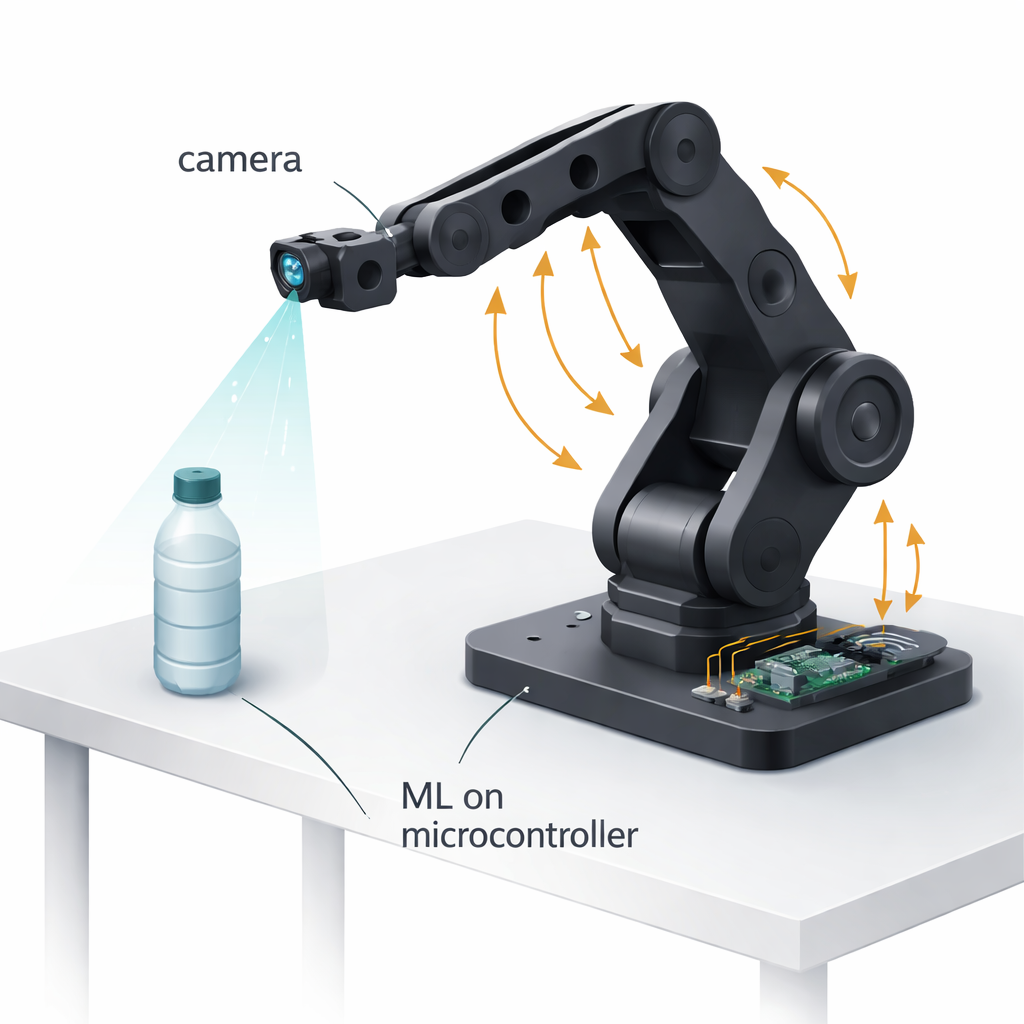

Zespół zaprojektował sześciostawowe ramię robotyczne od podstaw, wykorzystując głównie części z drukarki 3D, aby utrzymać niską wagę i przystępną cenę. Każdym stawem poruszają serwonapędy hobbystyczne o dużym momencie, które badacze zmodyfikowali tak, by odczytywały dokładne kąty w czasie rzeczywistym, co umożliwia precyzyjną regulację zamkniętej pętli. Na końcu ramienia zamontowano niestandardowy chwytak z dwoma palcami wyposażony w prosty czujnik prądu: obserwując pobór prądu silnika chwytaka, system potrafi wnioskować o sile chwytu i automatycznie ją regulować, aby pewnie trzymać przedmioty bez zgniatania lub upuszczania. Na „nadgarstku” ramienia znajduje się niewielka kamera full-HD poruszająca się wraz z ramieniem, dając systemowi perspektywę pierwszoosobową sceny przed chwytakiem.

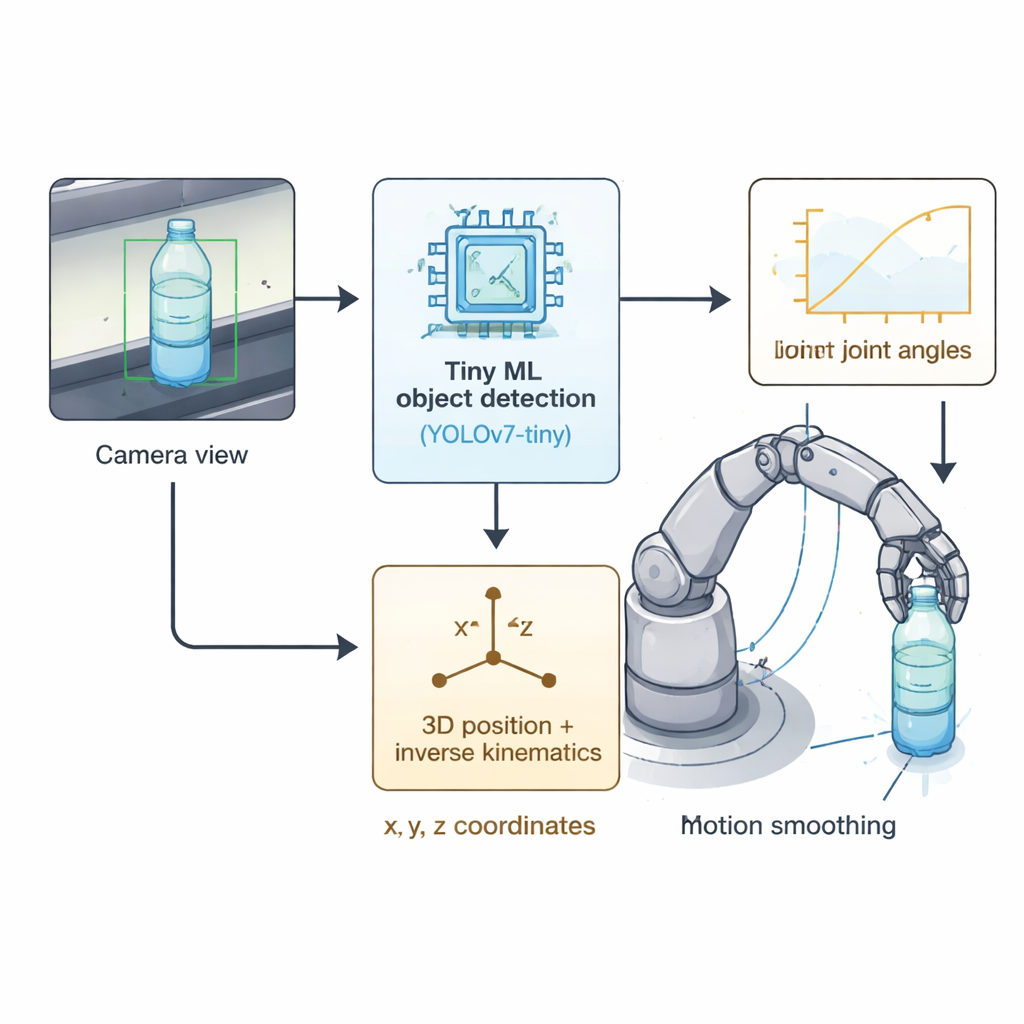

Nauka widzenia butelek przez mały układ

W centrum systemu wizualnego znajduje się kompaktowa wersja popularnej sieci do wykrywania obiektów o nazwie YOLOv7-tiny. Badacze wytrenowali ten model na ponad 2 500 zdjęciach plastikowych butelek wody, wykonanych przy różnym oświetleniu, kątach, odległościach i częściowych zasłonięciach. Po treningu na wydajnej karcie graficznej skompresowali model do 8-bitowej formy „tiny ML”, aby zmieścił się w ograniczonej pamięci i mocy obliczeniowej mikrokontrolera AMB82-Mini. Nawet w tej odchudzonej postaci model osiągnął około 88% skuteczności w wykrywaniu butelek i działał wystarczająco szybko — około 7–8 klatek na sekundę — do pracy w czasie rzeczywistym przy zadaniach pick-and-place bez wsparcia komputera PC czy chmury.

Od pikseli do precyzyjnego ruchu

Gdy kamera wykryje butelkę, system oblicza środek ramki wykrycia w obrazie i szacuje odległość obiektu na podstawie wielkości, jaką zajmuje w pikselach. To dostarcza współrzędnych x, y i z w przestrzeni. Niestandardowy solver matematyczny przekształca następnie te współrzędne na sześć kątów stawów, które ramię musi przyjąć, używając standardowej geometrii robotycznej, ale zoptymalizowanej pod kątem szybkiego działania na małym procesorze. Oprogramowanie sterujące, zorganizowane jako prosta maszyna stanów, przechodzi przez etapy: znalezienie obiektu, podejście do niego, zamknięcie chwytaka z użyciem czujnika prądu jako „czucia” oraz przetransportowanie obiektu do ustalonego punktu zrzutu. Aby ruchy były płynne i aby uniknąć drgań, zespół stosuje starannie zaprojektowane krzywe wygładzania ruchu oraz specjalną metodę modulacji napięcia, która ogranicza drgania silników i przeregulowanie.

Testy w rzeczywistych warunkach i ich wyniki

W powtarzanych eksperymentach zintegrowany system wykazał, że potrafi niezawodnie podnosić i umieszczać plastikowe butelki o masie do 300 gramów z 100% skutecznością, a także dobrze radzić sobie przy większych obciążeniach do 500 gramów. Symulacje i pomiary wykazały, że błędy pozycjonowania zwykle wynosiły około jednego milimetra — wystarczająco dokładnie do wielu zadań sortowania i pakowania. W porównaniu z prostszymi schematami sterowania, strategia autorów zmniejszyła wibracje, skróciła czas osiadania ramienia i wyeliminowała gwałtowne przeskoki. Chociaż testy skoncentrowano na jednym typie obiektu i stałych odległościach w kontrolowanych warunkach wewnętrznych, dostarczają przekonujących dowodów, że zaawansowane postrzeganie i sterowanie robotem można zmieścić na jednej, bardzo skromnej płytce wbudowanej.

Co to oznacza dla codziennej automatyzacji

Dla osób niebędących specjalistami główny wniosek jest taki, że zaawansowane zdolności „widzenia” i „poruszania się” nie są już zarezerwowane dla drogich, wysoko wydajnych robotów. Łącząc maleńkie modele uczenia maszynowego, sprytną geometrię i staranną kontrolę silników na niskokosztowym mikrokontrolerze, praca ta pokazuje drogę do kompaktowych, samodzielnych ramion robotycznych, które mogą realistycznie przyjąć małe firmy, szkoły i hobbystyczni entuzjaści. W miarę jak przyszłe wersje rozszerzą obsługę większej liczby typów obiektów i bardziej zróżnicowanych środowisk, podobne systemy wbudowane mogą cicho zautomatyzować niezliczone proste zadania pick-and-place, przybliżając inteligentną robotykę większej liczbie ludzi i miejsc.

Cytowanie: Almaliki, H.H., Mazinan, A.H. & Modaresi, S.M. Design and implementation of a 6-DoF robot arm control with object detection based on machine learning using mini microcontroller. Sci Rep 16, 6842 (2026). https://doi.org/10.1038/s41598-026-35508-3

Słowa kluczowe: robotyka wbudowana, tiny machine learning, sterowanie ramieniem robota, wykrywanie obiektów, automatyzacja przemysłowa