Clear Sky Science · pl

Rola diagnostyczności w ocenie kompetencji robotów

Dlaczego potknięcia robotów mają znaczenie dla nas wszystkich

Roboty i systemy sztucznej inteligencji szybko przenoszą się z laboratoriów do fabryk, szpitali i naszych ulic. W miarę jak zaczynamy na nich polegać, kluczowe staje się jedno pytanie: jak ludzie decydują, czy robot jest naprawdę kompetentny? W artykule tym badane jest, jak oceniamy robota, który zwykle działa dobrze, ale od czasu do czasu popełnia zaskakujący błąd — albo osiąga niespodziewany sukces. Wyniki pomagają wyjaśnić, dlaczego nasze „intuicyjne” odczucia wobec maszyn mogą różnić się od tego, co mówimy na głos, i dlaczego pojedynczy błąd może zostać zlekceważony albo trwale zmienić nasze zaufanie.

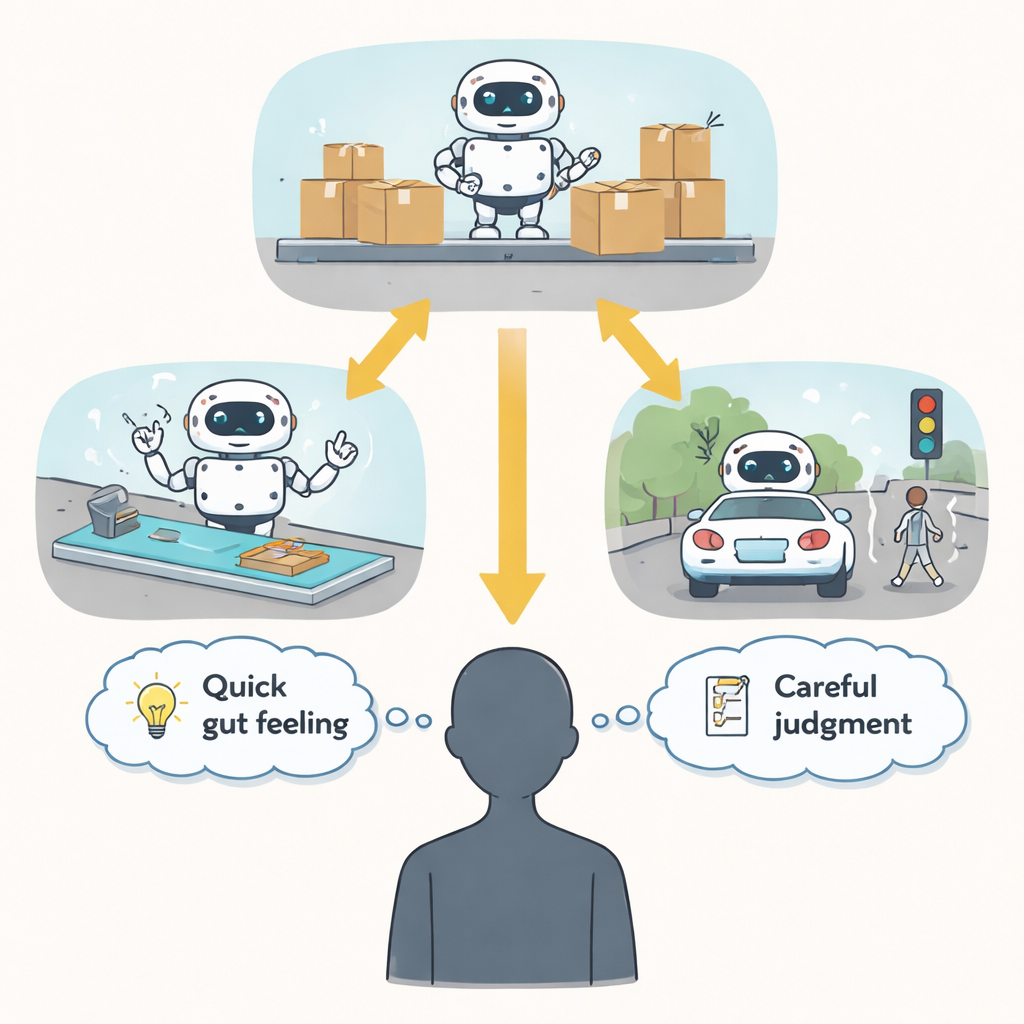

Dwa sposoby, w jakie umysł ocenia maszyny

Psycholodzy rozróżniają dwa rodzaje wrażeń. Wrażenia eksplicytne to oceny, które możemy bezpośrednio zgłosić po zapytaniu, na przykład ocenianie robota na skali kompetencji od 1 do 7. Wrażenia implicytne są bardziej automatyczne i przejawiają się w szybkich reakcjach, które ludzie wykonują bez świadomego skupiania się na ocenie. Wcześniejsze badania sugerowały, że wrażenia eksplicytne zmieniają się szybko w odpowiedzi na nowe zachowanie, podczas gdy wrażenia implicytne wolniej ulegają zmianom. Niniejsze badanie pyta, czy ta różnica rzeczywiście wynika z odmiennych systemów umysłowych — czy raczej zależy od tego, jak informatywne, czyli diagnostyczne, wydaje się nowe zachowanie w kontekście rzeczywistych umiejętności robota.

Od hal produkcyjnych po sale operacyjne i autostrady

W dziewięciu eksperymentach online z udziałem ponad 3 700 uczestników badacze pokazywali różne roboty pracujące w realistycznych sytuacjach: robot przemysłowy poruszający się po zatłoczonym magazynie, robot chirurgiczny śledzący precyzyjne trajektorie oraz samochód autonomiczny reagujący na przeszkody na drodze. Czasami robot był konsekwentnie sprawny, innym razem konsekwentnie niezdarny. W innych przypadkach był przeważnie kompetentny, ale popełnił pojedynczy wyraźny błąd, albo przeważnie niekompetentny, lecz miał jedno wyróżniające się powodzenie. Po obejrzeniu krótkich sekwencji tych działań mierzone były wrażenia uczestników na dwa sposoby: bezpośrednimi pytaniami samoopisowymi oraz zadaniami pośrednimi wychwytującymi szybkie, automatyczne reakcje.

Kiedy jedno nietypowe zachowanie nabiera znaczenia

W tych realistycznych scenariuszach eksplicytne oceny robotów odzwierciedlały zarówno ogólny wzorzec zachowań, jak i rzadki „odstający” przypadek. Pojedynczy błąd wśród licznych sukcesów mógł zauważalnie obniżyć oceny eksplicytne, a pojedynczy sukces wśród wielu porażek mógł je podnieść. Wrażenia implicytne jednak opowiadały inną historię. Silnie reagowały na typowe zachowanie robota — czy był zazwyczaj kompetentny, czy nie — lecz w dużej mierze ignorowały pojedynczy odstający przypadek. Ta dysocjacja utrzymywała się nawet gdy badacze starannie przeprojektowali miary tak, by zadania „eksplicytne” i „implicytne” wyglądały i sprawiały wrażenie możliwie podobnych, różniąc się głównie tym, czy uczestnikom wyraźnie kazano oceniać robota.

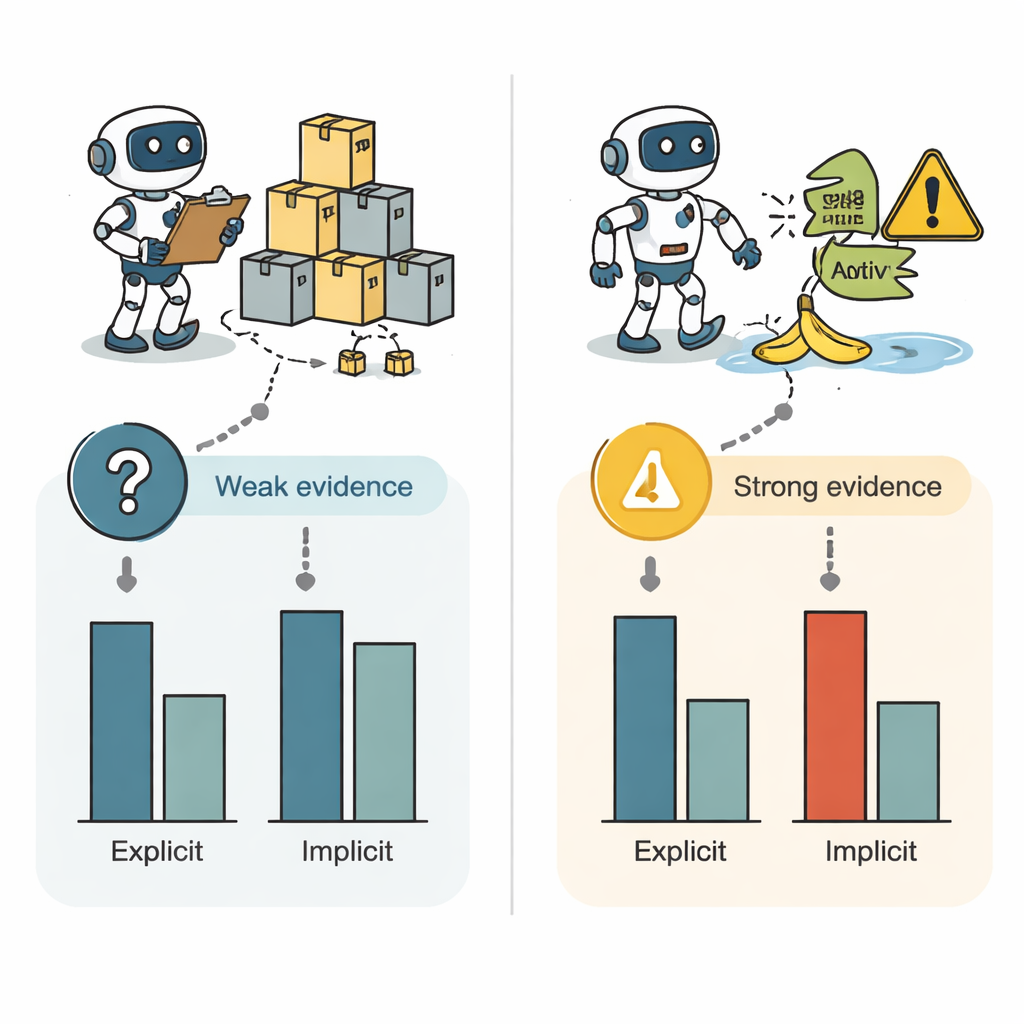

Co sprawia, że błąd robota naprawdę dużo mówi

Zespół przetestował następnie kluczowy pomysł: że siła oddziaływania odstającego zdarzenia zależy od tego, jak diagnostyczne się ono wydaje — czy ludzie sądzą, że naprawdę ujawnia coś trwałego o robocie. W nowych badaniach uczestnicy najpierw widzieli robota wykonującego kilka bezbłędnych prób, a później widzieli jeden lub więcej niepowodzeń. Gdy późniejsze niepowodzenia były przedstawione jako istotne, niedawne testy, albo gdy kilka porażek zgromadziło się, by zrównoważyć wcześniejsze sukcesy, zarówno wrażenia eksplicytne, jak i implicytne uległy zmianie. Co istotne, w tych warunkach o wysokiej diagnostyczności nawet pojedynczy błąd wystarczał, by przesunąć automatyczne, implicytne wrażenia. Gdy ten sam rodzaj potknięcia opisano jako przestarzały, nieistotny lub jednorazowy falstart, wrażenia implicytne ledwo się poruszały, choć oceny eksplicytne wciąż się zmieniały.

Dlaczego ma to znaczenie dla codziennego zaufania do AI

Razem wyniki sugerują, że nasze szybkie, automatyczne wrażenia o kompetencjach robota nie są niewrażliwe na nowe informacje, lecz wymagają silniejszych lub wyraźniej znaczących dowodów, zanim ulegną zmianie. Nasze werbalne oceny natomiast są wysoce podatne nawet na słabe lub niejednoznaczne zdarzenia, częściowo dlatego, że czujemy presję, by wykorzystać dostępną informację, gdy ktoś prosi o ocenę. Dla projektantów, inżynierów i decydentów oznacza to, że zarządzanie zaufaniem do robotów to nie tylko redukcja błędów, lecz także sposób, w jaki te błędy są przedstawiane i interpretowane. Pojedyncza, wyraźnie wymowna porażka — na przykład samochód, który nie zatrzymuje się, gdy oczywiście powinien — może przekształcić zarówno nasze intuicyjne odczucia, jak i wypowiedziane opinie, z bezpośrednimi konsekwencjami dla gotowości do przyjęcia i polegania na inteligentnych maszynach.

Cytowanie: Surdel, N., Ferguson, M.J. The role of diagnosticity in judging robot competence. Sci Rep 16, 7578 (2026). https://doi.org/10.1038/s41598-026-35375-y

Słowa kluczowe: kompetencje robota, interakcja człowiek-robot, uprzedzenia niejawne, zaufanie do AI, informacja diagnostyczna