Clear Sky Science · pl

Wielomodalne podejście do rozpoznawania fałszywych wiadomości i wpływowych węzłów rozpowszechniających je z użyciem głębokiego uczenia i analizy sieci

Dlaczego to ma znaczenie w życiu codziennym

Każdego dnia miliony osób przewijają treści w mediach społecznościowych, natrafiając na wpisy dotyczące zdrowia, polityki, finansów i wielu innych tematów. Wśród przydatnych informacji pojawiają się też plotki i fałszywe wiadomości, które mogą wzbudzać strach, wprowadzać w błąd, a nawet powodować realne szkody. W tym badaniu przedstawiono skuteczny sposób na osiągnięcie dwóch celów jednocześnie: po pierwsze — automatyczne wykrywanie fałszywych lub wprowadzających w błąd postów, a po drugie — mapowanie, kto w społeczności online jest najbardziej odpowiedzialny za ich rozprzestrzenianie. Praca skupia się na wiadomościach z Twittera dotyczących Covid‑19, lecz zaproponowane rozwiązania mogą pomóc platformom, dziennikarzom i odbiorcom szybciej i precyzyjniej reagować na szkodliwą dezinformację w różnych obszarach życia.

Jak plotki rozchodzą się w tłumie online

Sieci społecznościowe, takie jak Twitter, Facebook czy komunikatory, można traktować jak ogromne sieci osób (węzły) połączonych interakcjami (krawędzie). Gdy użytkownik publikuje wiadomość, a inni odpowiadają lub ją udostępniają, informacja może szybko przemieścić się przez sieć. Plotki — niezweryfikowane lub fałszywe twierdzenia — zachowują się podobnie do chorób zakaźnych: przenoszą się z osoby na osobę, szybko rosną i są trudne do powstrzymania. Wcześniejsze badania często traktowały dwa zagadnienia oddzielnie: jak rozpoznać, czy dany wpis to plotka, oraz jak znaleźć kluczowych „rozsiewaczy”, którzy powodują, że plotka dociera do wielu osób. Autorzy argumentują, że jednoczesne zajęcie się obiema kwestiami, przy jednoczesnym uwzględnieniu struktury sieci i dynamiki aktywności w czasie, daje znacznie pełniejszy obraz tego, jak fałszywe historie się rozprzestrzeniają.

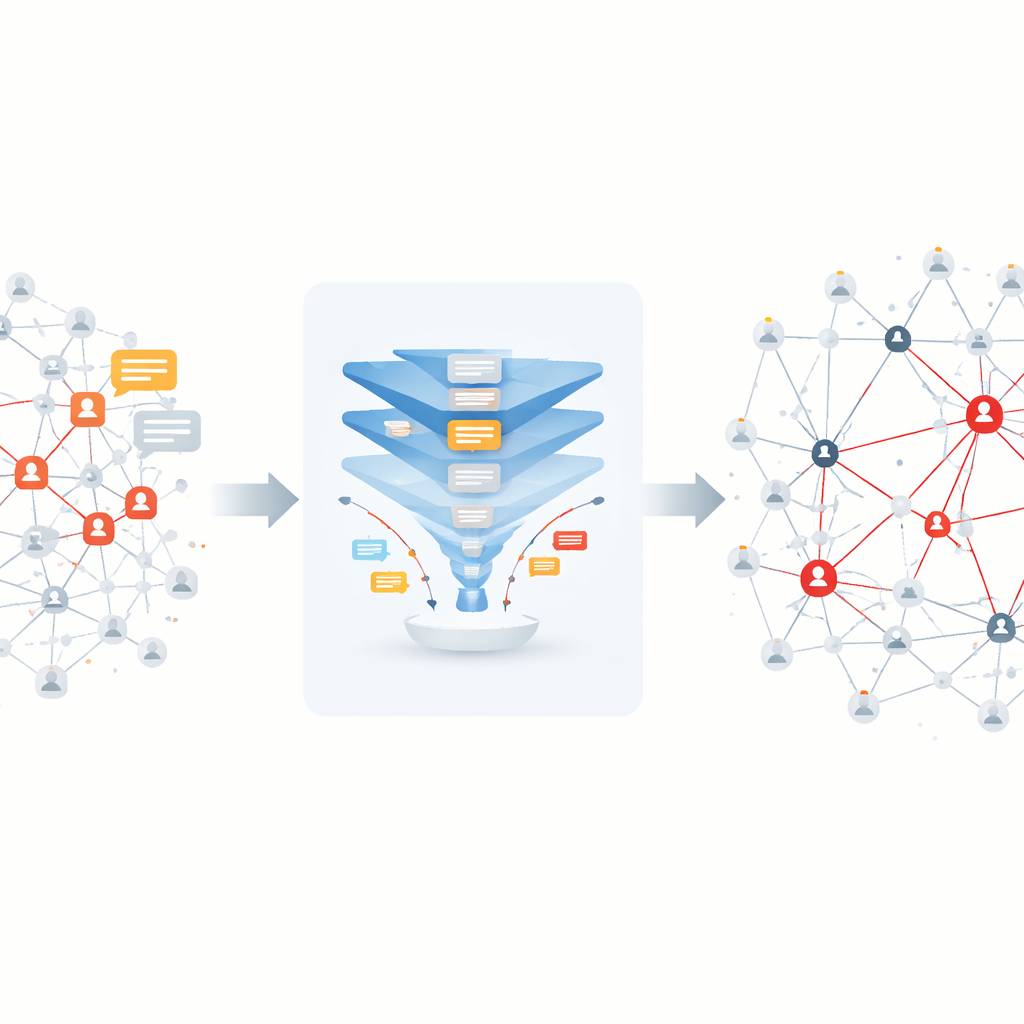

Nauczanie komputera czytania i oznaczania wątpliwych wpisów

Pierwsza część metody koncentruje się na treści każdego tweeta. Naukowcy traktują każdy tweet jak krótki dokument i oczyszczają go, usuwając zbędne znaki, zastępując odnośniki internetowe i adresy e‑mail prostymi znacznikami oraz eliminując powszechne słowa wypełniające, które wnoszą niewiele znaczenia. Następnie każde słowo zamieniane jest na wektor liczbowy przy użyciu popularnej techniki GloVe, która uchwytuje, jak słowa występują obok siebie w dużych zbiorach tekstów. Poprzez uśrednianie tych wektorów uzyskuje się skondensowane numeryczne streszczenie znaczenia każdego tweeta. Takie streszczenia trafiają do jednowymiarowej splotowej sieci neuronowej — typu modelu głębokiego uczenia zdolnego wykrywać subtelne wzorce — która decyduje, czy tweet jest autentyczną wiadomością, czy plotką.

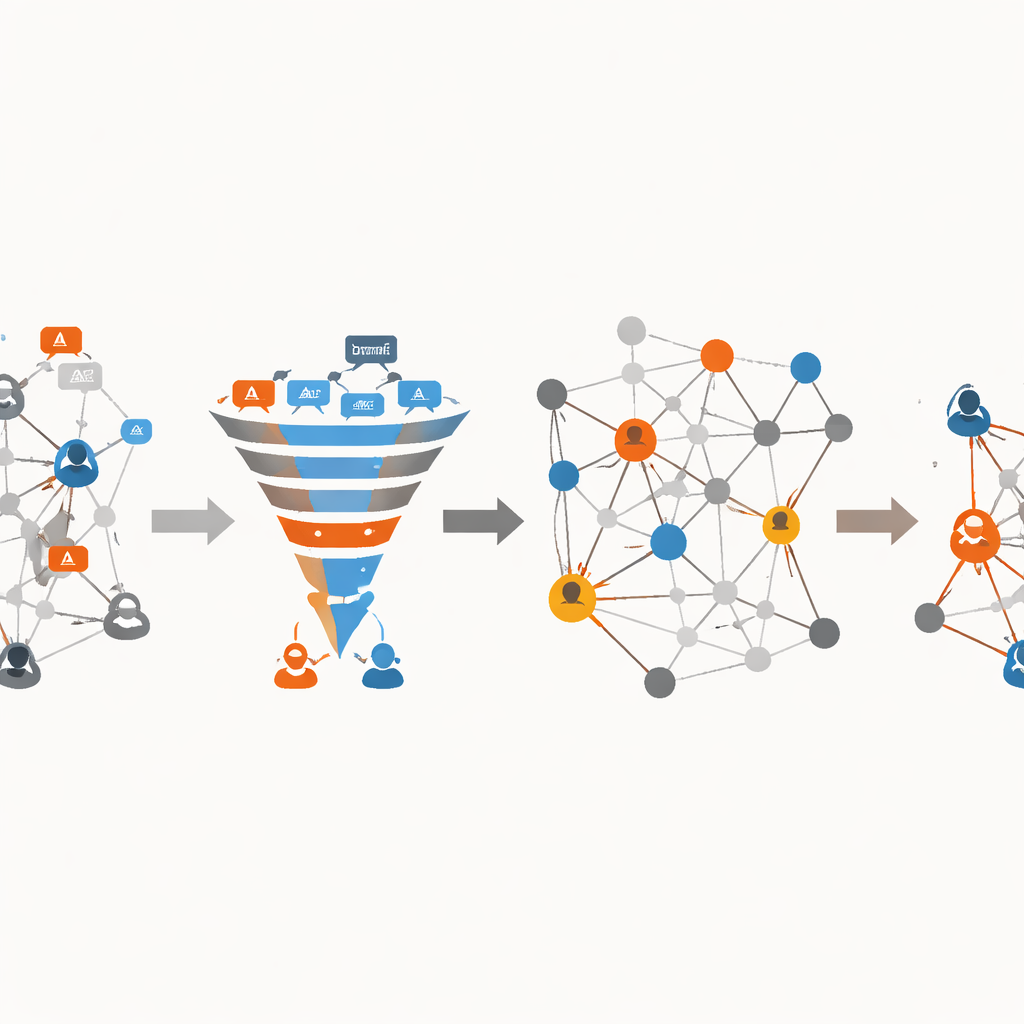

Wykrywanie kluczowych rozsiewaczy w sieci

Gdy system odróżni tweety‑plotki od prawdziwych, druga część podejścia skupia się na strukturze samej sieci społecznościowej. Każdy użytkownik jest punktem w skierowanym, ważonym grafie, a każda odpowiedź czy retweet staje się krawędzią, której siła odzwierciedla częstotliwość reakcji jednego użytkownika na treści innego. Korzystając z tych informacji, autorzy najpierw grupują użytkowników w społeczności — zbiory, które częściej wchodzą w interakcje wewnątrz grupy niż z zewnętrznymi użytkownikami — budując specjalne drzewo reprezentujące sieć, a następnie scalając mocno powiązane podgrupy na podstawie ich dopasowania. W obrębie tych społeczności obliczają, jak często dany użytkownik pojawia się na najważniejszych ścieżkach łączących innych — miarę znaną jako centralność pośrednictwa (betweenness). Użytkownicy występujący wielokrotnie na ścieżkach o wysokiej wartości traktowani są jako wpływowi rozsiewacze. Następnie wagi połączeń aktualizowane są tak, aby odzwierciedlały zarówno częstotliwość interakcji, jak i centralność połączonych użytkowników, co ujawnia najbardziej prawdopodobne trasy, którymi plotki przemieszczają się przez sieć w czasie.

Co ujawniło studium przypadku Covid‑19

Aby przetestować swoje podejście, badacze zastosowali je do ogromnego zbioru danych z Twittera dotyczącego Covid‑19: prawie 100 milionów tweetów obejmujących ponad 150 000 użytkowników, z których wyodrębnili ponad 14 000 unikalnych wiadomości oznaczonych jako autentyczne lub jako plotki. Na tych danych ich model głębokiego uczenia poprawnie sklasyfikował około 99 procent tweetów, przewyższając kilka istniejących metod, w tym inne zaawansowane detektory fałszywych wiadomości. W drugiej fazie porównali swoją listę użytkowników wpływowych z dobrze znanym matematycznym modelem rozprzestrzeniania informacji, znajdując najwyższą zgodność wśród testowanych metod. Pokaźne było też to, że przy analizie dłuższych okresów czasowych — 120, 240, a potem 360 dni — zdolność modelu do identyfikacji kluczowych rozsiewaczy i głównych tras plotek poprawiała się, przy jednoczesnym skróceniu czasu przetwarzania w porównaniu z konkurencyjnymi technikami opartymi na sieciach.

Co to oznacza w walce z dezinformacją

Mówiąc wprost, badanie pokazuje, że możliwe jest zbudowanie systemu, który nie tylko bardzo dokładnie wykrywa prawdopodobne fałszywe wiadomości, lecz także śledzi, jak one podróżują i kto jest najbardziej odpowiedzialny za ich rozpowszechnianie. Zamiast traktować wszystkich użytkowników i połączenia jednakowo, metoda wyodrębnia mniejszy zbiór społeczności i jednostek, których zachowanie ma największe znaczenie dla kontroli szkodliwych treści. Choć praca oparta była na zanonimizowanych danych z Twittera dotyczących Covid‑19 i nie musi się bezpośrednio uogólniać na każdą platformę czy temat, wskazuje drogę do bardziej ukierunkowanych, opartych na danych reakcji na plotki online — na przykład kierowania sprawdzania faktów, ostrzeżeń czy interwencji platformowych tam, gdzie mogą przynieść największy efekt, przy jednoczesnym poszanowaniu prywatności jednostek i zasad etycznego użycia.

Cytowanie: Zhang, W., Qian, M. & Zhang, Q. A multi-modal approach for recognizing fake news and influential nodes in spreading them using deep learning and network analysis. Sci Rep 16, 9775 (2026). https://doi.org/10.1038/s41598-026-35342-7

Słowa kluczowe: fałszywe wiadomości, sieci społecznościowe, rozprzestrzenianie plotek, głębokie uczenie, użytkownicy wpływowi