Clear Sky Science · pl

Ulepszony YOLOv11n do wykrywania małych obiektów na zdjęciach z UAV: wyższa dokładność przy mniejszej liczbie parametrów

Dlaczego wykrywanie maleńkich obiektów z powietrza ma znaczenie

Małe latające roboty szybko stają się częścią codzienności — od monitoringu ruchu i działań ratowniczych po dostawy paczek. Jest jednak uporczywy problem: kiedy dron patrzy z kilkuset metrów wysokości, ludzie, samochody i łodzie kurczą się do zaledwie kilku pikseli. Standardowe systemy komputerowego widzenia często pomijają te kropki lub mylą je z tłem. W artykule przedstawiono sprytniejszą, lżejszą wersję popularnego detektora, YOLOv11n, specjalnie dostrojoną do wykrywania drobnych obiektów na zdjęciach z dronów, przy zachowaniu wydajności na oszczędnych pokładowych komputerach.

Dostrzeganie więcej w małych, rozmytych detalach

Obrazy z dronów to surowe środowisko dla algorytmów. Większość celów jest mniejsza niż 32×32 piksele, a wiele poniżej 16 pikseli. Ruch, wibracje, zmienne oświetlenie, mgła i zatłoczone miejskie tło dodatkowo utrudniają rozróżnienie tych maleńkich obiektów. Jednocześnie drony często opierają się na skromnych procesorach i ograniczonej energii, więc ciężkie modele są niepraktyczne. Autorzy zaczynają od YOLOv11n, kompaktowego detektora czasu rzeczywistego, i przeprojektowują jego wewnętrzne komponenty, aby wydobyć więcej użytecznej informacji z małych, niskokontrastowych fragmentów obrazu bez nadmiernego rozrostu modelu. Cel jest prosty, lecz wymagający: znacząco wyższa dokładność w wykrywaniu małych obiektów przy równej lub mniejszej liczbie uczonych parametrów oraz akceptowalnej szybkości na sprzęcie edge.

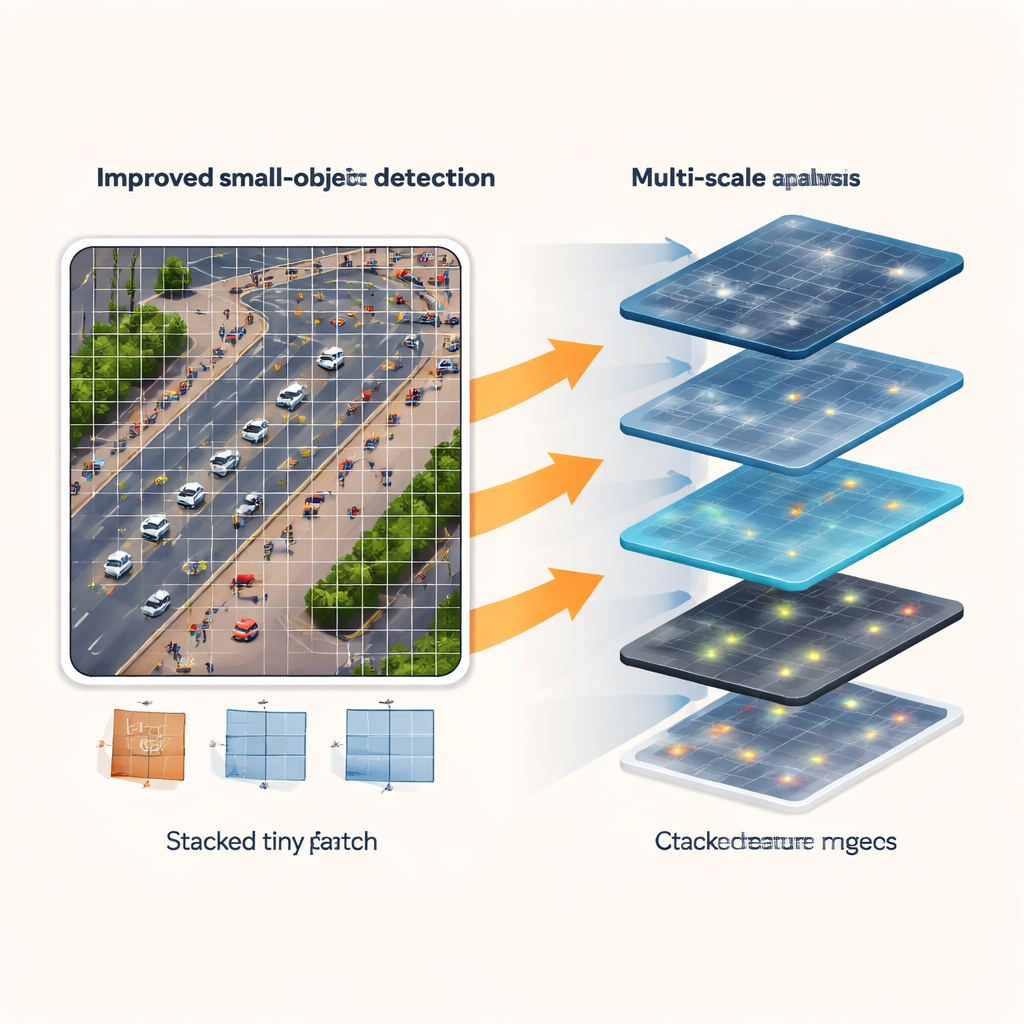

Nauka sceny na wielu skalach

Pierwsza poprawka koncentruje się na tym, jak sieć „widzi” scenę. Zamiast patrzeć przez jedno okno o stałym rozmiarze, nowy moduł Multiscale Edge-Feature Adaptive Selection (MSEAF) obserwuje obraz jednocześnie na kilku skalach. Grubsze widoki uchwytują szerszy układ dróg, budynków i tłumów, podczas gdy drobniejsze śledzą pojedyncze samochody czy ludzi. Etap wzmacniania krawędzi podkreśla granice i kształty, które łatwo widzą ludzie, ale często zanikają w małych fragmentach obrazu. Inteligentny mechanizm fuzji następnie wzmacnia najbardziej informacyjne regiony, tłumiąc szumy tła. Ta wieloskalowa, świadoma krawędzi reprezentacja daje pozostałym częściom sieci bogatszy punkt wyjścia do wykrywania trudno dostrzegalnych obiektów.

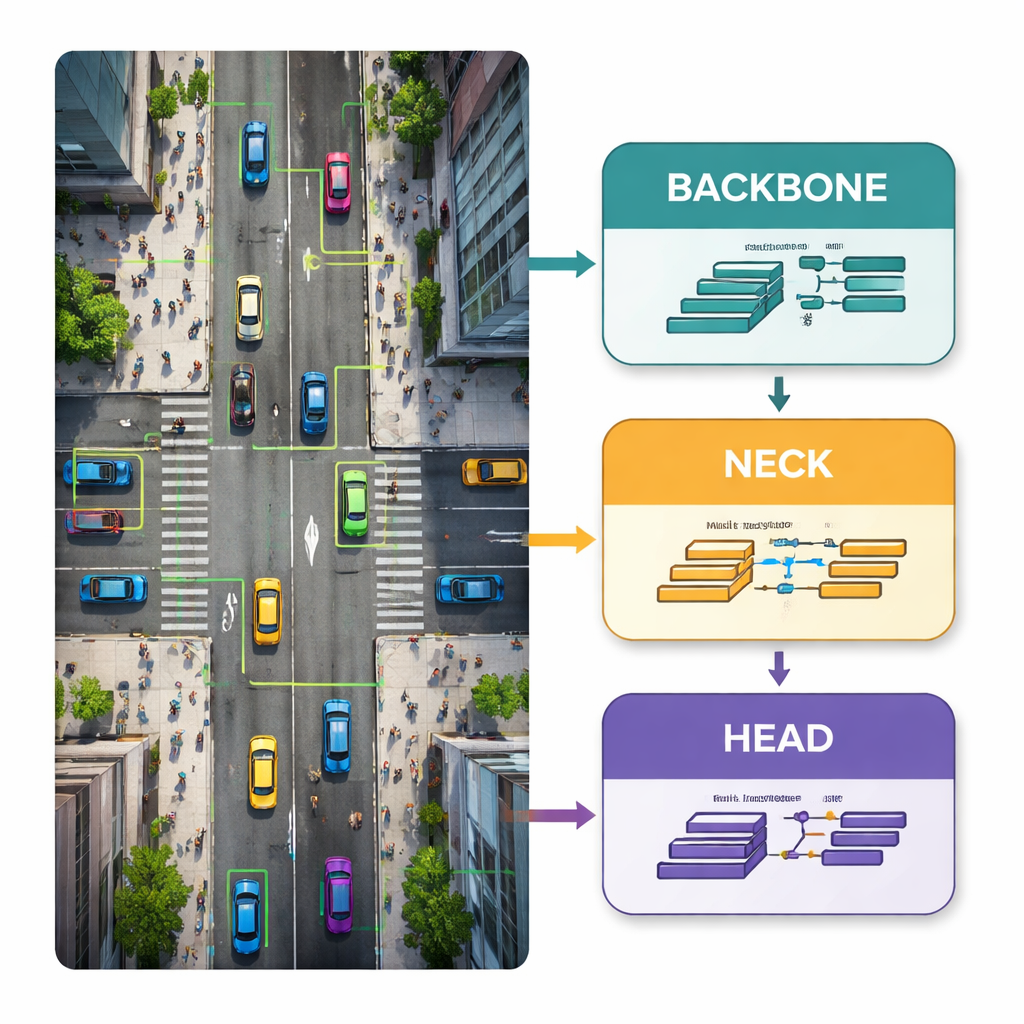

Zachowanie małych obiektów w całym potoku

Tradycyjne sieci YOLO wielokrotnie zmniejszają mapy cech, gdy informacja przepływa od wejścia do wyjścia. Dla dużych obiektów to działa, ale dla maleńkich może być to fatalne: po kilku etapach downsamplingu pieszy może zajmować tylko jeden lub dwa piksele w wewnętrznej mapie albo zniknąć zupełnie. Aby temu zapobiec, autorzy przekształcają środkową część „neck” sieci i dodają nową głowicę detekcyjną P2, która pracuje na wyższej rozdzielczości cech. Niestandardowe moduły ScalCat i Scal3DC ostrożnie łączą informacje z różnych warstw, tak aby drobne szczegóły z płytkich warstw i bogatszy kontekst z głębszych warstw wzajemnie się wzmacniały. Efekt to detektor, który śledzi małe samochody i ludzi przez wiele skal, zamiast poświęcać je dla szybkości.

Bardziej precyzyjne decyzje przy mniejszej liczbie parametrów

Ostatnim krokiem jest usprawnienie etapu predykcji, znanego jako głowica detekcyjna. W oryginalnym projekcie głębsze warstwy z wieloma kanałami były poświęcone głównie dużym obiektom, które w scenach z dronów występują stosunkowo rzadko. Nowa głowica Shared Re-parameterized Detection (SRepD) wyrównuje liczbę kanałów między skalami i wykorzystuje sprytne rozwiązanie szkoleniowe: podczas uczenia kilka wyspecjalizowanych gałęzi konwolucyjnych bada różne sposoby uwypuklania cech; w czasie wnioskowania te gałęzie są matematycznie scalane w jedną, prostą konwolucję. Ta współdzielona, reparametryzowana konstrukcja poprawia jakość fuzji cech, jednocześnie zmniejszając liczbę parametrów i utrzymując obliczenia w granicach możliwości urządzeń edge.

Co mówią liczby w testach w rzeczywistych warunkach

Ulepszony model przetestowano na trzech wymagających, publicznych zbiorach danych: VisDrone2019 (mieszane sceny miejskie), TinyPerson (skrajnie mali ludzie nad lądem i morzem) oraz HazyDet (pojazdy w gęstej mgle z perspektywy drona). Na VisDrone2019 nowy projekt zwiększa kluczowy wskaźnik dokładności (mAP50) i precyzję o 4,6 punktu procentowego w porównaniu z oryginalnym YOLOv11n, jednocześnie redukując liczbę parametrów o około 8,5 procent. W TinyPerson poprawki są jeszcze większe — około 5,9 punktu procentowego w mAP50 i 5,6 w precyzji — przy podobnym zmniejszeniu parametrów, a kompaktowy model przewyższa nawet dużo większy YOLOv11s, który ma czterokrotnie więcej parametrów. W warunkach zamglenia zmodernizowany detektor również przewyższa bazę pod względem dokładności i odporności, zachowując jednocześnie prędkość działania w czasie rzeczywistym na niskomocowej płycie edge Huawei Atlas 200 DK.

Dlaczego to ma znaczenie dla codziennego użycia dronów

Dla osób nietechnicznych główny wniosek jest taki, że badania te pokazują, iż drony mogą stać się jednocześnie bystrzejsze i bardziej oszczędne zasobowo. Przemyślawszy gdzie i jak sieć szuka detali, zachowując informacje o wysokiej rozdzielczości dla maleńkich celów i upraszczając mechanikę predykcji, autorzy przełamali zwykły kompromis między dokładnością a rozmiarem. Powstały system lepiej wykrywa małe, odległe osoby i pojazdy w zatłoczonych, zamglonych czy złożonych scenach, nie wymagając przy tym ciężkiego sprzętu. Taki postęp przybliża niezawodny, działający w czasie rzeczywistym nadzór lotniczy dla bezpieczeństwa ruchu, poszukiwań i ratownictwa oraz obserwacji środowiska do codziennego wdrożenia.

Cytowanie: Zhu, H., Xie, X. Enhanced YOLOv11n for small object detection in UAV imagery: higher accuracy with fewer parameters. Sci Rep 16, 5536 (2026). https://doi.org/10.1038/s41598-026-35301-2

Słowa kluczowe: wykrywanie obiektów dronem, rozpoznawanie małych obiektów, sieć neuronowa YOLO, analiza obrazów lotniczych, edge AI dla UAV