Clear Sky Science · pl

Automatyczna segmentacja i klasyfikacja oparta na uczeniu głębokim do wykrywania raka szyjki macicy z wykorzystaniem ulepszonego U-Net i metod zespołowych

Dlaczego testy Pap nadal potrzebują cyfrowej pomocy

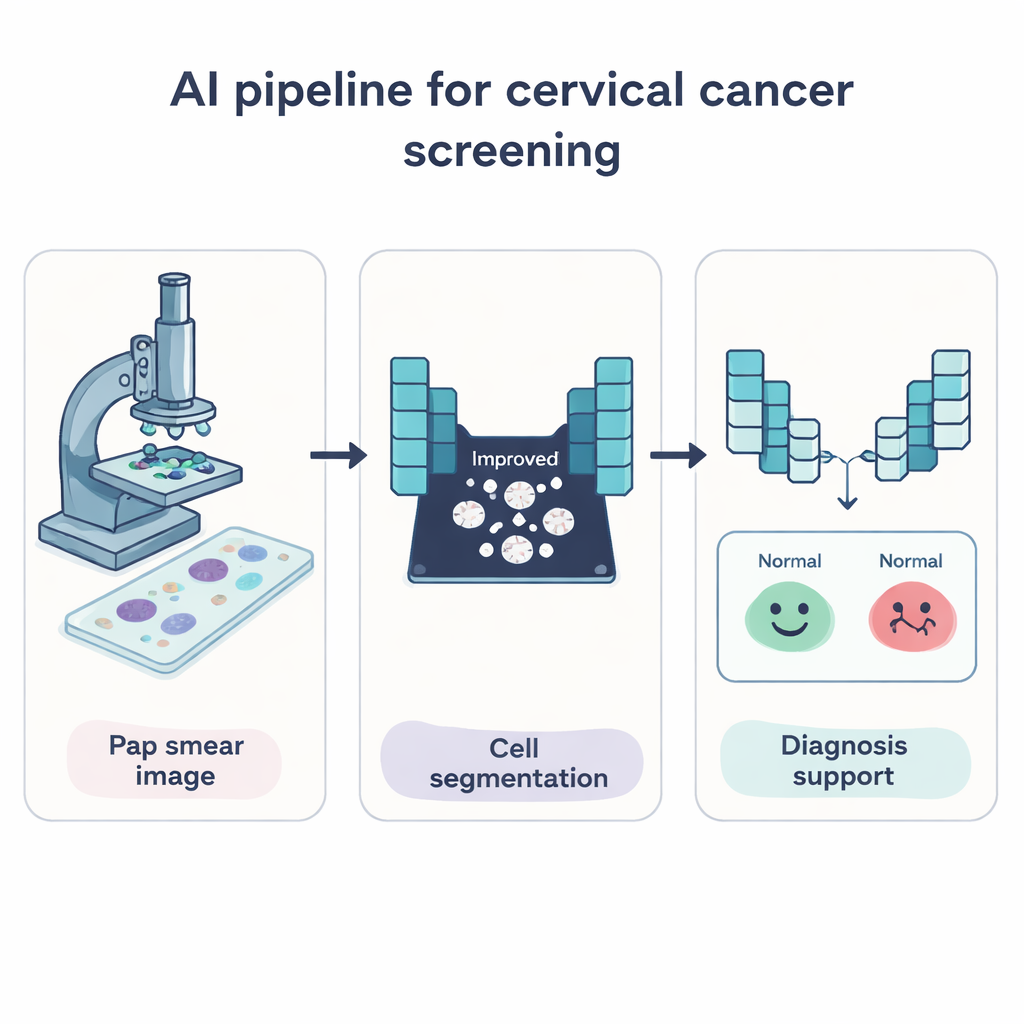

Rak szyjki macicy jest jednym z nielicznych nowotworów, któremu można w dużym stopniu zapobiec, gdy zostanie wczesnie wykryty, a mimo to wiele kobiet umiera, ponieważ niebezpieczne zmiany komórkowe są przeoczone lub wykryte zbyt późno. Znany test Pap ratuje już życie, jednak ręczna ocena tysięcy obrazów komórek jest powolna, męcząca, a nawet eksperci mogą się różnić w ocenie. Artykuł bada, jak nowoczesna sztuczna inteligencja może pełnić rolę niestrudzonego asystenta, automatycznie odnajdując i klasyfikując komórki szyjki macicy na obrazach z wymazów Pap, aby pomóc lekarzom szybciej i bardziej niezawodnie wykrywać wczesne oznaki choroby.

Nauka widzenia komórek problemowych

Naukowcy postawili sobie za cel zbudowanie systemu komputerowego wykonującego dwie kluczowe zadania: po pierwsze, wyodrębnić każdą komórkę szyjki macicy z tła obrazu Pap, a po drugie, ocenić, czy komórka wygląda normalnie, czy wykazuje cechy powiązane z rakiem. W tym celu wykorzystali uczenie głębokie — formę AI, która uczy się wzorców bezpośrednio z dużej liczby przykładowych obrazów zamiast z reguł pisanych ręcznie. System skupia się na całej komórce — zarówno na ciemnym wnętrzu (jądrze), jak i otaczającej materii (cytoplazmie) — ponieważ zmiany w rozmiarze, kształcie i strukturze całej komórki mogą wskazywać na chorobę.

Sprytniejszy sposób na obrysowanie komórek

Rdzeniem systemu jest ulepszona wersja popularnego modelu stosowanego w obrazowaniu medycznym o nazwie U-Net, znanego z precyzyjnego wyznaczania obrysów obiektów na obrazach. Autorzy zmodyfikowali U-Net tak, aby mógł jednocześnie analizować szczegóły obrazu na kilku skalach i pozostać stabilnym nawet przy trenowaniu na małych partiach danych — co jest częstym ograniczeniem w medycynie. Zmodernizowana sieć uczy się nakładać prostą maskę na każdy obraz: białe tam, gdzie znajduje się komórka, czarne dla tła. Izolując obszary komórek, kolejne etapy przetwarzania mogą skupić się na tym, co najważniejsze, zamiast rozpraszać się plamami, zanieczyszczeniami czy pustą przestrzenią.

Tworzenie większej liczby przykładów treningowych z niczego

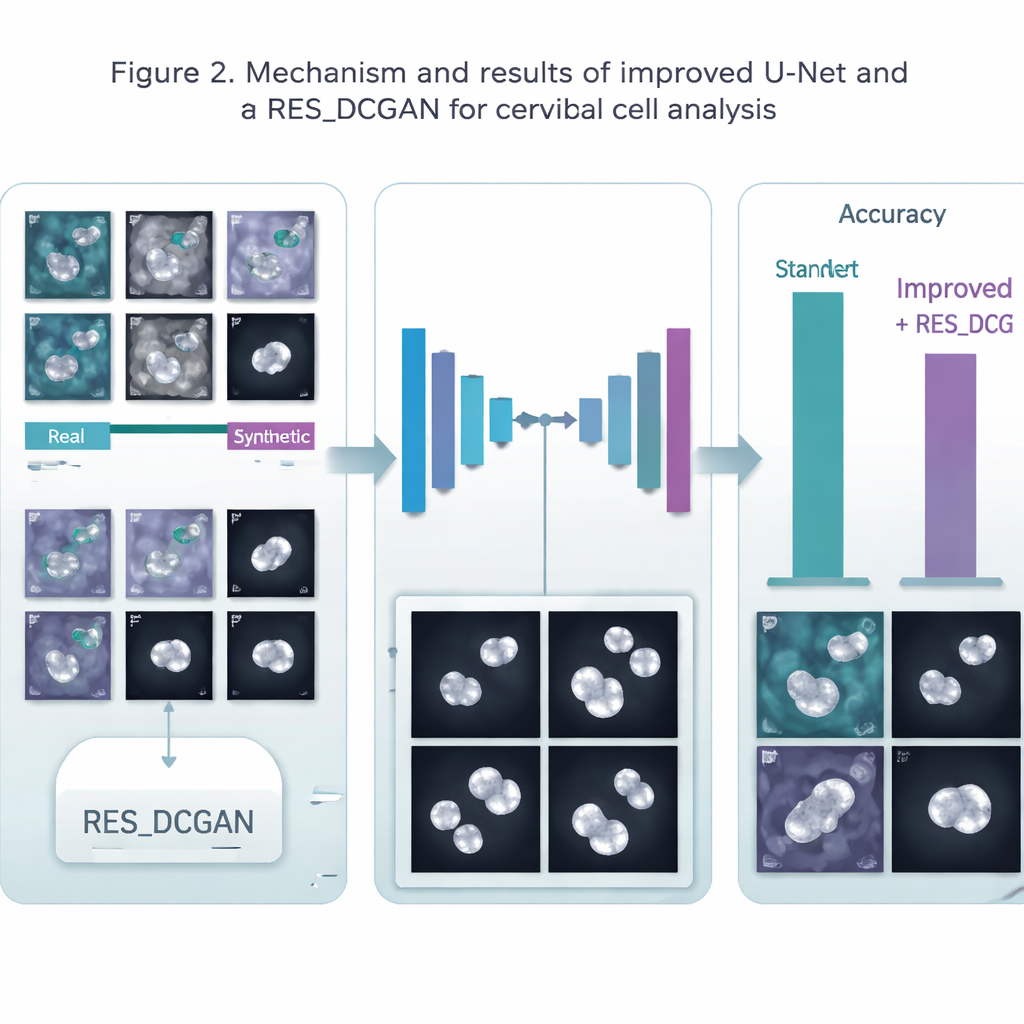

Głównym wyzwaniem w medycynie jest brak wysokiej jakości, oznakowanych obrazów, które są kosztowne w pozyskaniu. Aby temu sprostać, zespół zastosował model generatywny o nazwie RES_DCGAN, który uczy się tworzyć realistyczne syntetyczne obrazy wymazów Pap na podstawie rzeczywistych danych. Te dodatkowe „wyprodukowane, lecz przekonujące” obrazy są mieszane w procesie treningowym — zarówno przed etapem wyznaczania obrysów, jak i później, w kroku klasyfikacji. Dzięki zobaczeniu wielu więcej wariantów komórek — w tym rzadkich i subtelnych wzorców — system AI staje się bardziej odporny i mniej podatny na przeuczenie do niewielkiej grupy pacjentów czy specyficznych warunków obrazowania.

Z obrysów do wczesnych ostrzeżeń

Gdy komórki zostaną zsegmentowane, druga grupa modeli uczenia głębokiego przejmuje zadanie klasyfikacji każdej komórki jako normalnej lub należącej do różnych kategorii nieprawidłowości. Autorzy wykorzystali silny model rozpoznawania obrazu o nazwie ResNet50V2 i połączyli go z kilkoma innymi dobrze znanymi sieciami w „zespoł” — gdzie wiele modeli wspólnie głosuje nad ostateczną decyzją. Przetestowali sześć różnych procedur przetwarzania na trzech zbiorach danych z Polski (Pomorze), Danii (Herlev) i Grecji (SIPaKMeD), obejmujących zarówno proste przypadki normalne kontra nieprawidłowe, jak i bardziej szczegółowe problemy wieloklasowe. We wszystkich testach wstępna segmentacja komórek konsekwentnie poprawiała dokładność klasyfikacji, a dodanie obrazów syntetycznych zazwyczaj jeszcze nieznacznie polepszało wyniki, zwłaszcza przy wyznaczaniu obrysów komórek.

Jak dobrze poradził sobie cyfrowy asystent?

System osiągnął bardzo wysokie wyniki. Dla obrysów komórek dokładność sięgała około 99,5% w jednym zbiorze danych i około 98% w innym, wyraźnie przewyższając standardowy U-Net. W zadaniu określania typu komórki zespół modeli poprawnie oznaczył około 95–96% komórek w bardziej złożonych zadaniach oraz do 99% w prostszych decyzjach tak/nie dotyczących ryzyka nowotworowego. Wyniki te są porównywalne lub lepsze od wielu wcześniejszych badań, a także pokazują, że jednolity pipeline może działać w różnych laboratoriach i na różnych źródłach danych. Zyski były skromniejsze w przypadku jednego szczególnie zróżnicowanego zbioru danych, co podkreśla, że różnorodność rzeczywistych warunków nadal stanowi wyzwanie.

Co to oznacza dla pacjentek i lekarzy

W praktycznym ujęciu praca ta pokazuje, że asystent AI może nauczyć się precyzyjnie obrysowywać komórki szyjki macicy i segregować je na grupy ryzyka z imponującą konsekwencją. Nie zastępuje to patologa, ale może przesiewowo analizować preparaty, wyróżniać podejrzane komórki i zmniejszać ryzyko przeoczenia wczesnych oznak w zajętych klinikach lub w regionach z niewielką liczbą specjalistów. Przy dalszych badaniach na większych, bardziej złożonych próbkach i z maskami zatwierdzonymi przez ekspertów systemy tego typu mogłyby pomóc w udostępnieniu rzetelnych badań przesiewowych w kierunku raka szyjki macicy większej liczbie kobiet na całym świecie, wykrywając niebezpieczne zmiany wcześniej i zwiększając szanse na skuteczne leczenie.

Cytowanie: Wubineh, B.Z., Rusiecki, A. & Halawa, K. Deep learning-based automatic segmentation and classification for cervical cancer detection using an improved U-Net and ensemble methods. Sci Rep 16, 5184 (2026). https://doi.org/10.1038/s41598-026-35299-7

Słowa kluczowe: badanie przesiewowe raka szyjki macicy, obrazy z wymazów cytologicznych (Pap), uczenie głębokie, segmentacja obrazów medycznych, diagnostyka wspomagana komputerowo