Clear Sky Science · pl

Modele MobileNetV2 wzbogacone o mechanizmy uwagi do niezawodnego wykrywania i klasyfikacji pożarów lasów

Dlaczego szybsze alarmy pożarowe mają znaczenie

Na całym świecie pożary lasów stają się silniejsze, rozleglejsze i droższe w zwalczaniu. Minuty mogą przesądzić o tym, czy mamy do czynienia z niewielkim, możliwym do opanowania pożarem, czy z katastrofą obejmującą region, która niszczy ekosystemy, wypełnia miasta dymem i generuje straty liczone w miliardach dolarów. W tym badaniu analizuje się, jak zwarte modele sztucznej inteligencji (AI) mogą wykrywać pierwsze sygnały pożaru lasu na zwykłych zdjęciach i wideo, wystarczająco szybko, by działać na dronach, kamerach bezpieczeństwa i niskoenergetycznych czujnikach rozmieszczonych w terenach o podwyższonym ryzyku.

Obserwacja lasu za pomocą inteligentnych kamer

Tradycyjne wieże obserwacyjne i ludzie przeglądający strumienie wideo mają problem, by pokryć rozległe obszary leśne, szczególnie w nocy lub przy zadymieniu i mgle. Autorzy rozwiązują ten problem, sprowadzając wykrywanie pożarów do prostego pytania tak/nie: czy na tym obrazie jest ogień czy nie? Zebrali zrównoważony zbiór 5 121 zdjęć przedstawiających sceny z ogniem i bez ognia, pochodzących z lasów, miast i obiektów przemysłowych, wykonanych w dzień, w nocy oraz w warunkach zadymienia czy mgły. Dzięki starannemu zrównoważeniu zbioru danych i ręcznej weryfikacji etykiet chcą nauczyć systemy AI, jak wyglądają prawdziwe płomienie w naturalnych warunkach, a nie tylko w idealnych przykładach laboratoryjnych.

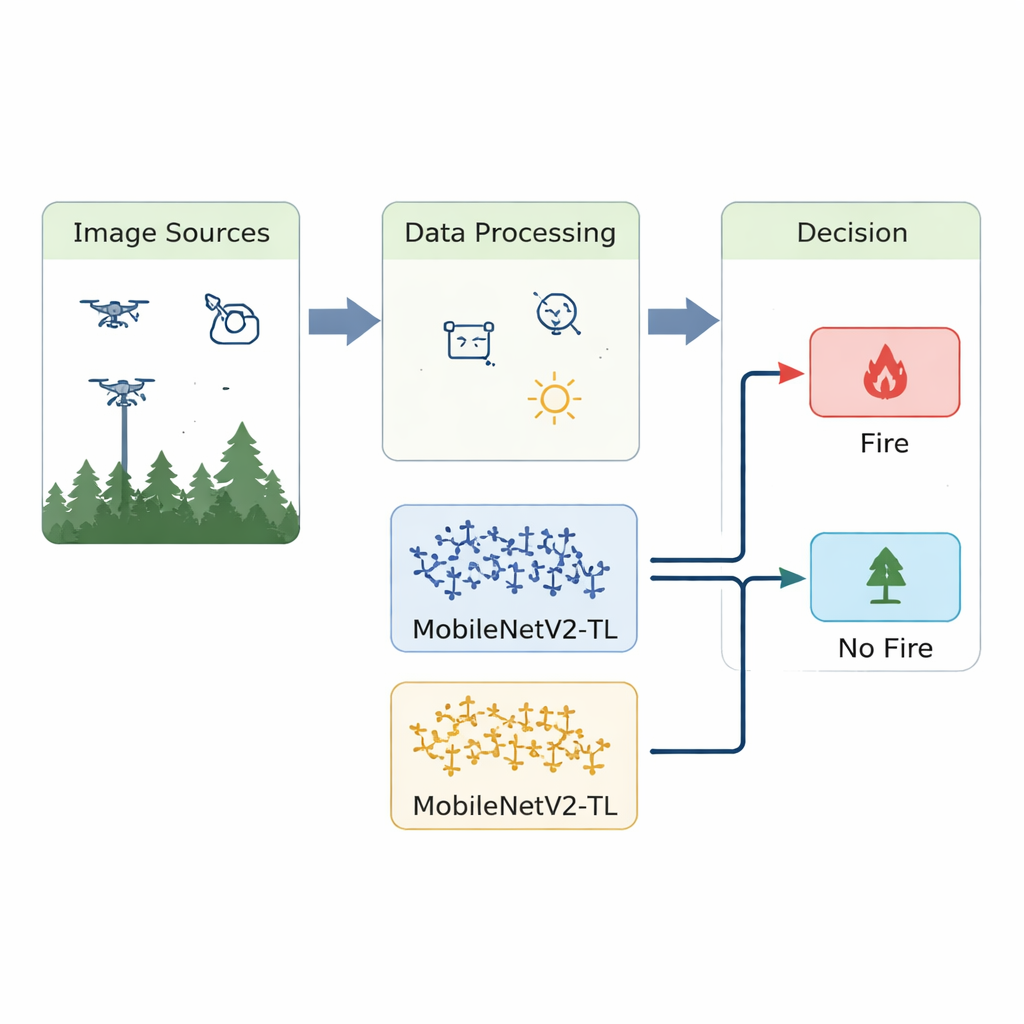

Szczupła AI zaprojektowana do pracy w terenie

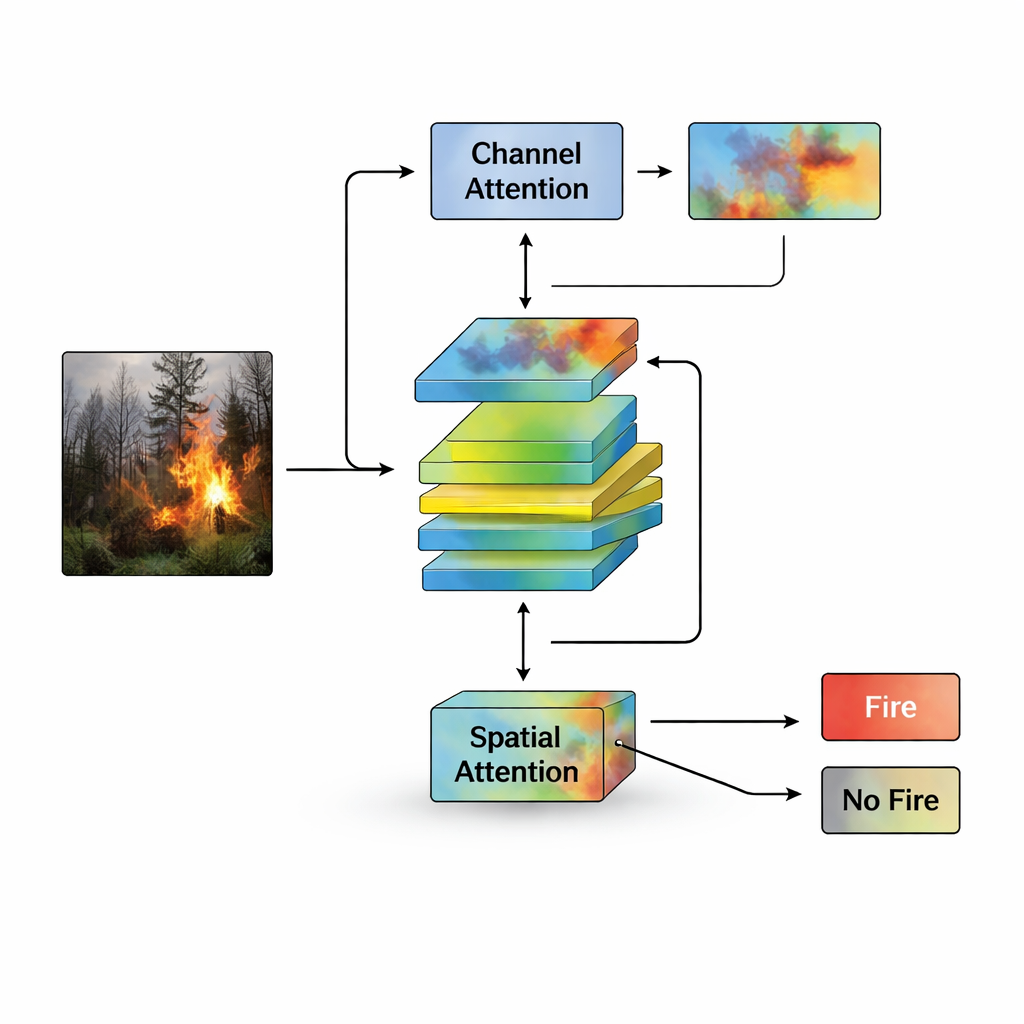

Wiele potężnych systemów rozpoznawania obrazu jest zbyt ciężkich, by działać na małych komputerach w dronach czy w tanich kamerach monitoringu. Aby temu zapobiec, badanie opiera się na MobileNetV2, rodzinie sieci neuronowych zaprojektowanych pod kątem szybkości i oszczędności pamięci. Pierwszy model, nazwany Att-MobileNetV2, dodaje mechanizm „uwagi”, który pomaga sieci koncentrować się na charakterystycznych kolorach, teksturach i krawędziach płomieni, ignorując jednocześnie zakłócenia takie jak oświetlone chmury czy jasne światła budynków. Drugi model, MobileNetV2-TL, wykorzystuje transfer learning: ponownie używa zdolności wizualnych wyuczonych na milionach ogólnych zdjęć i trenuje jedynie niewielką, specyficzną głowicę do rozróżniania ognia od braku ognia, utrzymując niski czas przetwarzania i zużycie energii.

Trenowanie na trudne warunki rzeczywiste

Aby odwzorować chaotyczne warunki rzeczywistego monitoringu pożarowego, badacze zrobili więcej niż tylko zebrali zróżnicowane obrazy. Zastosowali również kontrolowane modyfikacje każdego zdjęcia treningowego — takie jak niewielkie obroty, odbicia lustrzane czy zmiany jasności i kontrastu — by zasymulować różne kąty kamery i oświetlenie. Oba modele zostały następnie wytrenowane i ocenione według tych samych zasad, przy użyciu standardowych miar, takich jak dokładność, precyzja i czułość, oraz przez sprawdzenie, jak często przegapiają pożary lub generują fałszywe alarmy. Att-MobileNetV2 osiąga trafność rzędu 99,6%, podczas gdy MobileNetV2-TL około 98,4%. Co kluczowe, wyniki te uzyskano przy zaledwie kilku milionach parametrów i ułamku miliarda operacji na obraz, co pozwala na podejmowanie decyzji w zaledwie 10–12 milisekund na pojedynczym procesorze graficznym.

Przewyższanie większych systemów przy mniejszych zasobach

Dwa zwarte modele porównano zarówno z klasycznymi metodami uczenia maszynowego, jak i z bardziej złożonymi sieciami głębokimi. W identycznych warunkach treningu i testów Att-MobileNetV2 zapewnia najlepszą ogólną równowagę pomiędzy prawidłowym wykryciem pożaru a prawidłowym rozpoznaniem braku zagrożenia, natomiast MobileNetV2-TL osiąga szczególnie wysoką czułość, co oznacza, że rzadko pomija rzeczywiste pożary — to ważna cecha systemów wczesnego ostrzegania. Ensemble łączący oba modele wypada jeszcze nieco lepiej, co sugeruje, że ich sposoby „widzenia” sceny się uzupełniają. Testy na niezależnym, publicznym zbiorze danych pokazują, że modele utrzymują wysoką skuteczność na nowych obrazach, co wskazuje na ich zdolność do uogólniania poza konkretnymi zdjęciami użytymi w treningu.

Co to oznacza dla przyszłego bezpieczeństwa pożarowego

Mówiąc prosto, ta praca pokazuje, że małe, wydajne modele AI mogą wcześnie i niezawodnie wykrywać pożary lasów, nawet gdy działają na skromnym sprzęcie zamontowanym na dronach, wieżach czy przydrożnych kamerach. Poprzez użycie mechanizmu uwagi do koncentrowania się na właściwych fragmentach obrazu oraz transfer learningu do ponownego wykorzystania uprzedniej wiedzy wizualnej, proponowane systemy osiągają dokładność porównywalną lub przewyższającą znacznie cięższe modele. Choć wyzwania pozostają w najgęstszej mgle, podejście to wskazuje drogę do sieci inteligentnych, przystępnych cenowo czujników, które mogłyby szybciej podnosić alarmy, pomagając strażakom reagować sprawniej i potencjalnie zapobiegając przemianie małych iskierek w katastrofalne pożary.

Cytowanie: Ul Haq, I., Husnain, G., Iqbal, A. et al. Attention-enhanced MobileNetV2 models for robust forest fire detection and classification. Sci Rep 16, 4805 (2026). https://doi.org/10.1038/s41598-026-35207-z

Słowa kluczowe: wykrywanie pożarów lasów, monitorowanie pożarów, uczenie głębokie, edge AI, widzenie komputerowe