Clear Sky Science · pl

Efektywne wykrywanie generowanych przez AI streszczeń naukowych za pomocą lekkiego transformera

Dlaczego ważne jest wykrywanie tekstów napisanych przez AI

W miarę jak sztuczna inteligencja staje się sprawna w pisaniu, potrafi teraz tworzyć streszczenia naukowe, które są niemal nie do odróżnienia od tych napisanych przez ludzi. To rodzi trudne pytania: jak czasopisma, uczelnie i czytelnicy mogą mieć pewność, że abstrakt rzeczywiście odzwierciedla pracę naukowca, a nie wymysł maszyny? Niniejszy artykuł zajmuje się tym problemem, tworząc szybkie, zwarte narzędzie, które potrafi z bardzo dużą pewnością wskazać streszczenia napisane przez AI, oferując praktyczną ochronę integralności akademickiej.

Budowa zestawu testowego z rzeczywistych i syntetycznych streszczeń

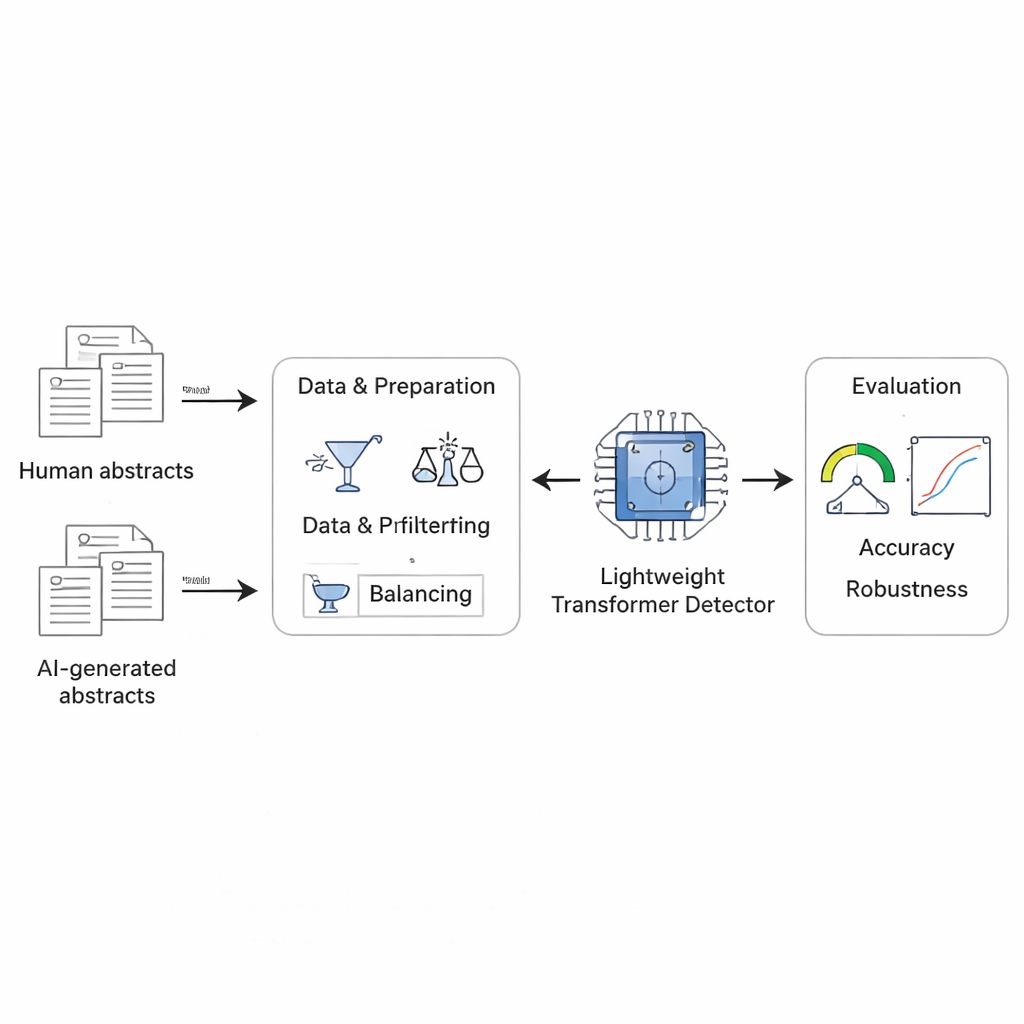

Aby mierzyć i ulepszać wykrywanie tekstów AI, autorzy potrzebowali najpierw godnych zaufania danych. Zebrali 5 000 streszczeń naukowych z serwera preprintów arXiv, obejmujących pięć obszarów: widzenie komputerowe, przetwarzanie sygnałów, biologię ilościową, fizykę oraz pozostałe tematy z informatyki. Dla każdego streszczenia napisanego przez człowieka wykorzystali duży model językowy do wygenerowania wersji AI na podstawie tytułu artykułu, starannie sprawdzając występowanie niemalidentycznych tekstów i usuwając oczywiste wskazówki, takie jak adresy internetowe czy fragmenty kodu. Zadbałi także o to, by teksty AI i ludzkie miały podobną długość, dzięki czemu detektor nie mógł polegać wyłącznie na prostych statystykach, takich jak liczba słów.

Kompaktowy model dostrojony do realiów

Zamiast używać ogromnego i kosztownego modelu AI, badacze wybrali mniejszy system znany jako DistilBERT, uproszczoną wersję popularnego modelu językowego. Dostosowali go, aby dla każdego streszczenia zdecydował, czy zostało napisane przez człowieka, czy wygenerowane przez AI. Model czyta do 256 tokenów — czyli mniej więcej kilka akapitów — i zwraca wynik między zerem a jedynką, interpretowany jako prawdopodobieństwo, że tekst jest maszynowy. Trening i ocena odbyły się według ścisłego protokołu: dane podzielono na zbiory treningowy, walidacyjny i testowy bez nakładania się, a zespół raportował nie tylko dokładność, lecz także zachowanie modelu przy utrzymaniu bardzo niskiego współczynnika fałszywych alarmów, co ma znaczenie przy oskarżaniu rzeczywistych autorów o użycie AI.

Jak dobrze działa detektor

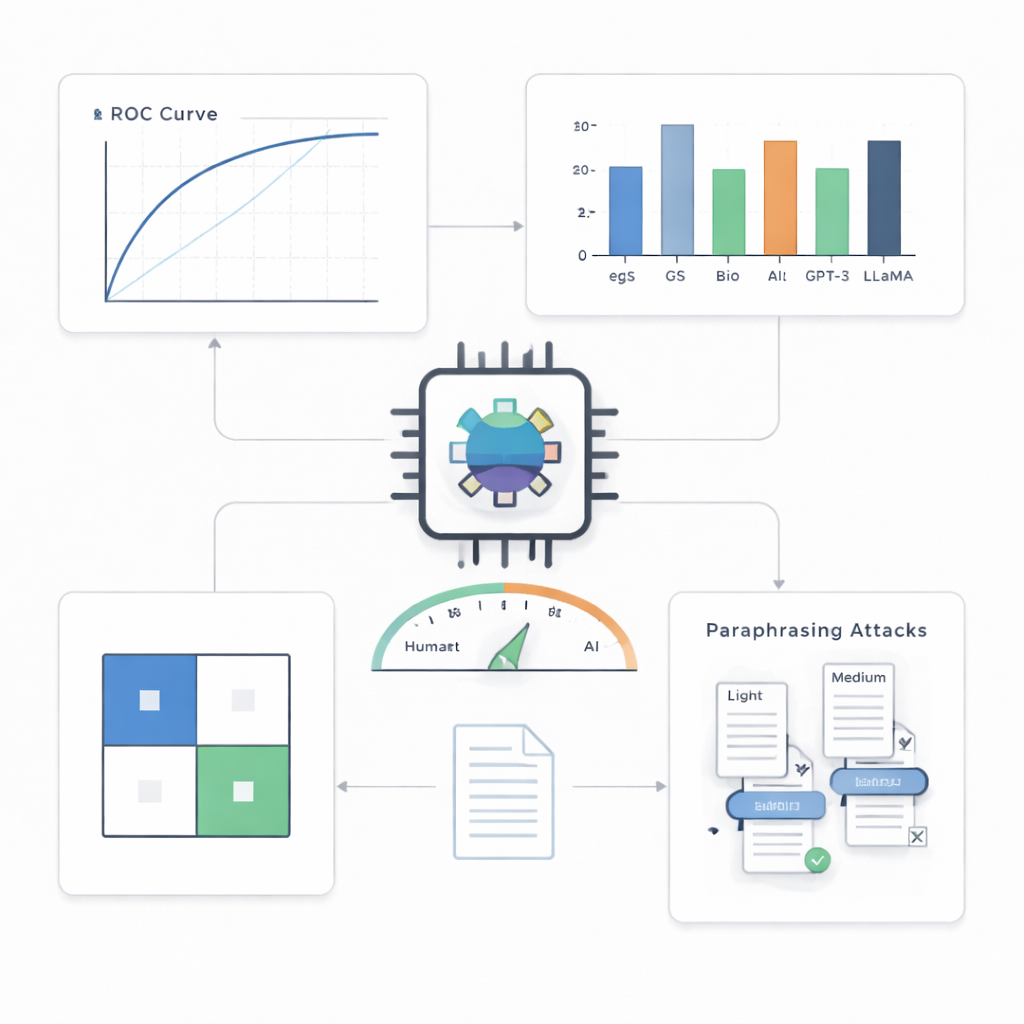

Na streszczeniach z widzenia komputerowego, głównego zestawu testowego, detektor okazał się zadziwiająco skuteczny. Poprawnie oznaczył 499 z 500 tekstów wygenerowanych przez AI oraz 495 z 500 tekstów ludzkich, osiągając około 99,4% dokładności i niemal idealny wynik na standardowej krzywej wydajności. Gdy autorzy wymusili, żeby system popełniał co najwyżej jedno fałszywe oskarżenie na sto przypadków, nadal wykrywał około 90% tekstów AI; przy nieco wyższej tolerancji pięciu fałszywych alarmów na sto wykrywał około 97%. W porównaniu z różnymi alternatywami — w tym prostszymi narzędziami statystycznymi i innymi modelami transformerowymi — kompaktowy detektor konsekwentnie wychodził na prowadzenie, zwłaszcza w bardziej wymagających scenariuszach.

Ponad jedną dziedziną, jednym modelem i prostymi sztuczkami

Kluczowe pytanie brzmi, czy taki detektor poradzi sobie ze stylami pisania i systemami AI, których wcześniej nie widział. Autorzy przetestowali go na streszczeniach z innych dziedzin nauki oraz na tekstach wygenerowanych przez kilka różnych zaawansowanych modeli językowych. W różnych domenach wydajność pozostała silna, z jedynie umiarkowanymi spadkami, co sugeruje, że system wychwytuje ogólne wzorce pisania AI, a nie tylko specyfikę jednej dziedziny. W starciu z niewidzianymi modelami AI radził sobie również dobrze, choć mniej perfekcyjnie niż w swoim macierzystym środowisku. Najtrudniejsze okazały się ataki parafrazujące: gdy inny model AI przepisywał wygenerowane teksty tak, by brzmiały inaczej przy zachowaniu sensu, wykrywanie stało się zauważalnie trudniejsze. Przy średnio silnym przepisywaniu odsetek tekstów AI, które przechodziły niezauważone, wzrósł niemal do 30%, co pokazuje, że nawet zaawansowane detektory można zmylić celowym zaciemnianiem.

Co to oznacza dla nauki i jej zabezpieczeń

Badanie pokazuje, że na razie streszczenia naukowe napisane przez AI wciąż pozostawiają subtelne ślady, które dobrze zaprojektowany model potrafi wychwycić, nawet gdy model jest na tyle mały, by działać na skromnym sprzęcie. To sprawia, że możliwe jest dla wydawców, konferencji i uczelni skanowanie dużych ilości zgłoszeń bez ogromnych kosztów obliczeniowych. Jednocześnie podatność na parafrazowanie podkreśla, że takie narzędzia nie są lekarstwem na wszystkie problemy. Autorzy argumentują, że wykrywanie tekstów AI powinno być łączone z innymi zabezpieczeniami — takimi jak ocena redakcyjna, kontrole plagiatu i wymogi przejrzystości — aby chronić wiarygodność komunikacji naukowej w miarę dalszego rozwoju systemów AI.

Cytowanie: Zhang, C., Zhou, W. Efficient detection of AI-generated scientific abstracts with a lightweight transformer. Sci Rep 16, 4975 (2026). https://doi.org/10.1038/s41598-026-35203-3

Słowa kluczowe: wykrywanie tekstów AI, streszczenia naukowe, integralność akademicka, duże modele językowe, tekst generowany maszynowo