Clear Sky Science · pl

Śledzenie ewoluujących społeczności w kaskadach fałszywych informacji za pomocą grafów czasowych

Dlaczego plotki internetowe rozprzestrzeniają się w zwartym gronie

Gdy fałszywe historie rozchodzą się po mediach społecznościowych, rzadko robią to samotnie. Zamiast tego są napędzane, udostępniane i powtarzane przez klastry użytkowników, którzy działają wspólnie. W badaniu zadano proste, lecz ważne pytanie: czy można śledzić, jak te grupy online się formują i zmieniają w czasie, oraz wykorzystać tę wiedzę do spowolnienia rozprzestrzeniania się fałszywych informacji — nawet bez analizowania treści postów?

Śledzenie ścieżek wprowadzających w błąd historii

Naukowcy skupiają się na „kaskadach informacyjnych” na platformach takich jak Twitter — łańcuchach retweetów i odpowiedzi, które rozwijają się po pojawieniu się danej historii. Zamiast traktować użytkowników jako izolowane jednostki, analizują, jak ludzie skupiają się w społecznościach w miarę rozprzestrzeniania pogłoski. Te społeczności mogą być złożone z aktywnych promotorów fałszywej historii, sceptycznych komentatorów lub zwykłych obserwatorów, którzy zostają wciągnięci. Problem w tym, że tłumy online nieustannie się zmieniają: ludzie dołączają i odchodzą, rozmowy dzielą się i łączą, a struktura sieci zmienia się z godziny na godzinę.

Krok po kroku: ramy do śledzenia społeczności

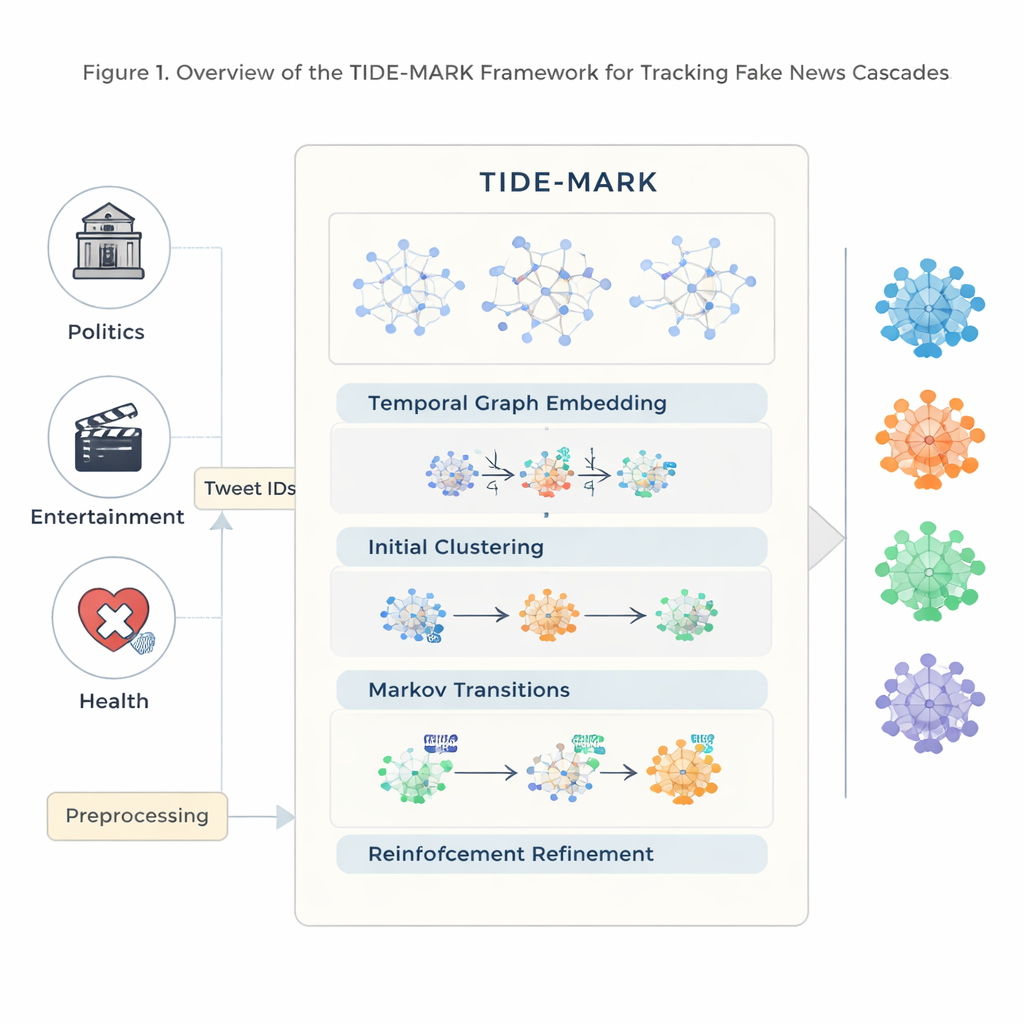

Aby temu sprostać, autorzy wprowadzają TIDE-MARK, wieloetapowe podejście zaprojektowane do śledzenia ewoluujących społeczności użytkowników w czasie. Najpierw odtwarzają każdą kaskadę z surowych identyfikatorów tweetów, przekształcając ją w serię godzinnych migawków, w których węzłami są użytkownicy, a połączenia reprezentują retweety lub odpowiedzi. Wzbogacają każdego użytkownika prostymi informacjami profilowymi oraz numerycznym podsumowaniem udostępnianych przez niego tweetów. Następnie sieć neuronowa uwzględniająca czas uczy się, jak zmieniają się połączenia i zachowania każdego użytkownika między migawkami, tworząc kompaktowy „odcisk palca” dla każdego użytkownika w każdej godzinie.

Z rozmytych tłumów do stabilnych grup

Wykorzystując te odciski, TIDE-MARK grupuje podobnych użytkowników w wstępne społeczności. Potem modeluje, jak społeczności zmieniają się między kolejnymi migawkami, oszacowując prawdopodobieństwo, że członkowie jednej grupy pozostaną razem, podzielą się lub dołączą do innej grupy. Na koniec moduł uczenia ze wzmocnieniem oczyszcza nieostre granice między grupami. Wielokrotnie testuje niewielkie zmiany — przesuwanie pojedynczych użytkowników z jednej społeczności do innej — i zachowuje te zmiany, które zwiększają spójność wewnętrzną grup, jednocześnie zachowując zgodność z poprzednimi krokami czasowymi. Efektem jest wyraźniejszy, bardziej stabilny obraz tego, kto z kim koordynuje działania w miarę rozwijania się kaskady.

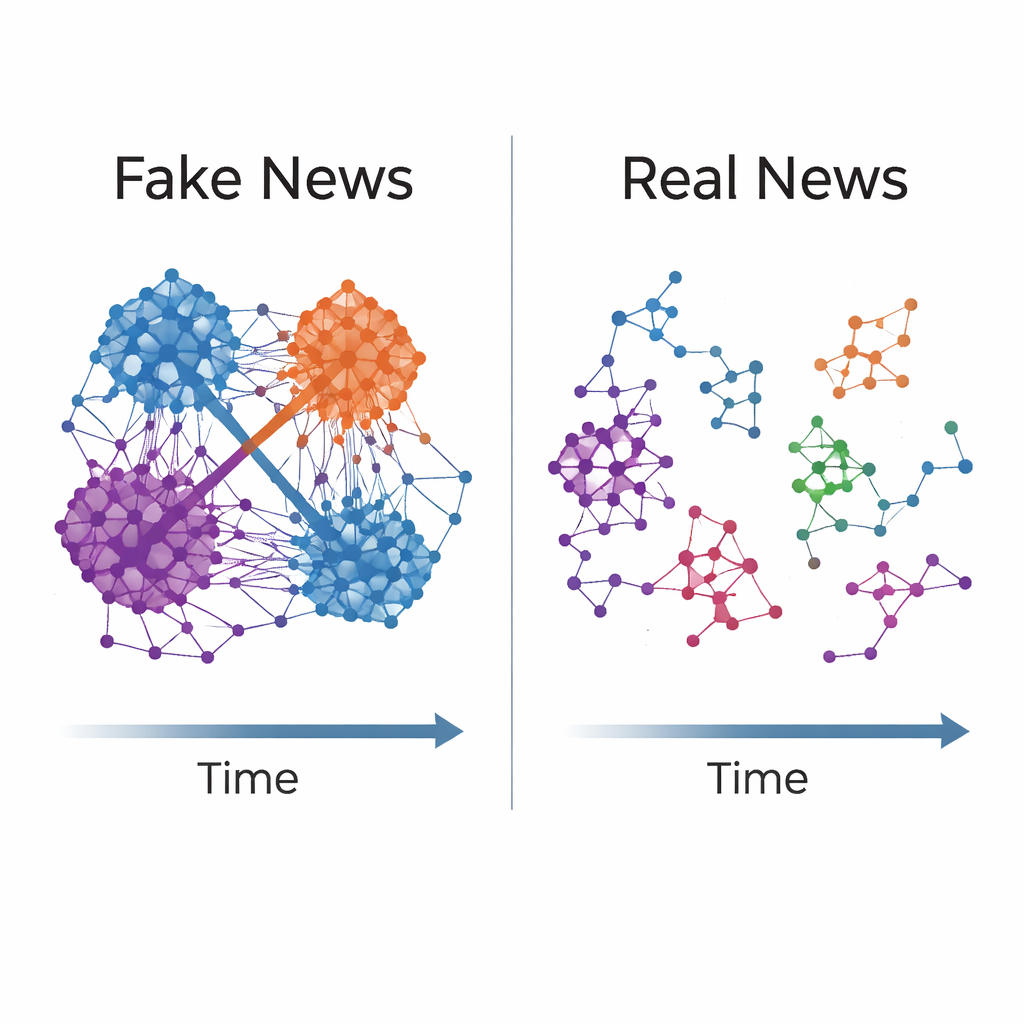

Jak wyglądają społeczności fałszywych i prawdziwych wiadomości

Zespół zastosował TIDE-MARK do trzech dużych zbiorów danych dotyczących fałszywych wiadomości obejmujących politykę, plotki o celebrytach i informacje zdrowotne związane z COVID-19. We wszystkich przypadkach zaobserwowano ten sam wzorzec: fałszywe historie mają tendencję do przepływania przez bardziej zwarte, trwalsze społeczności niż historie prawdziwe. Te grupy rozprzestrzeniające fałszywe wiadomości są bardziej gęsto połączone wewnątrz, mają ostrzejsze granice względem reszty sieci i utrzymują mniej więcej ten sam skład członkowski w czasie. Prawdziwe wiadomości natomiast rozchodzą się przez luźniejsze, bardziej rozproszone grupy, które rekonfigurują się w miarę przesuwania się dyskusji. Co istotne, cechy strukturalne wyodrębniane przez TIDE-MARK — jak spójność i stabilność społeczności — są na tyle silne, że proste klasyfikatory mogą odróżnić kaskady fałszywe od prawdziwych, nawet bez analizy tekstu.

Testowanie sposobów zakłócania szkodliwych kaskad

Ponieważ TIDE-MARK dostarcza widoku na poziomie społeczności, można go też użyć do symulowania interwencji. Badacze sprawdzili, co się dzieje, jeśli wcześnie w kaskadzie fałszywych wiadomości usunąć z najbardziej trwałej społeczności tylko kilku silnie połączanych użytkowników — idealizowany odpowiednik zawieszenia kont lub ograniczenia ich zasięgu. W symulacjach takie ukierunkowane usunięcie znacząco osłabia strukturę kaskady i zmniejsza jej największy spójny komponent, co sugeruje, że strategie świadome struktury, neutralne względem treści, mogą istotnie spowolnić rozprzestrzenianie się dezinformacji.

Co to oznacza w walce z dezinformacją

Mówiąc prosto, praca ta pokazuje, że fałszywe wiadomości często podróżują przez trwałe „kluby fanów” skoordynowanych użytkowników, podczas gdy prawdziwe wiadomości przemieszczają się przez bardziej płynne tłumy. TIDE-MARK oferuje sposób na zobaczenie i śledzenie tych grup w czasie rzeczywistym, bez czytania czy oceniania samej treści. To czyni go obiecującym narzędziem dla platform, badaczy i decydentów, którzy chcą identyfikować ryzykowne wzorce koordynacji i projektować ostrożne, ukierunkowane interwencje — potencjalnie rozbrajając szkodliwe kaskady, zanim w pełni się rozwiną.

Cytowanie: Ma, Y., Qu, D. & Wang, Y. Tracking evolving communities in fake news cascades using temporal graphs. Sci Rep 16, 4952 (2026). https://doi.org/10.1038/s41598-026-35175-4

Słowa kluczowe: fałszywe wiadomości, sieci społecznościowe, wykrywanie społeczności, rozprzestrzenianie dezinformacji, moderacja mediów społecznościowych