Clear Sky Science · pl

Ocena ChatGPT-4o i Gemini w zarządzaniu dną moczanową: analiza porównawcza oparta na wytycznych EULAR

Dlaczego inteligentne chatboty i bolące stawy mają znaczenie

Dna moczanowa, bolesna postać zapalenia stawów często atakująca duży palec u nogi, staje się coraz częstsza na całym świecie. Lekarze dysponują już jasnymi, opartymi na dowodach wytycznymi dotyczącymi rozpoznawania i leczenia tej choroby, jednak wielu pacjentów wciąż nie otrzymuje optymalnej opieki. Równocześnie potężne chatboty oparte na sztucznej inteligencji, takie jak ChatGPT-4o i Gemini, zaczynają pojawiać się w praktyce klinicznej, co rodzi proste, lecz istotne pytanie: czy te narzędzia potrafią naprawdę udzielać bezpiecznych, zgodnych z wytycznymi porad dotyczących dny, czy też mogą wprowadzać w błąd lekarzy i pacjentów?

Sprawdzanie, jak dobrze chatboty przestrzegają podręcznika

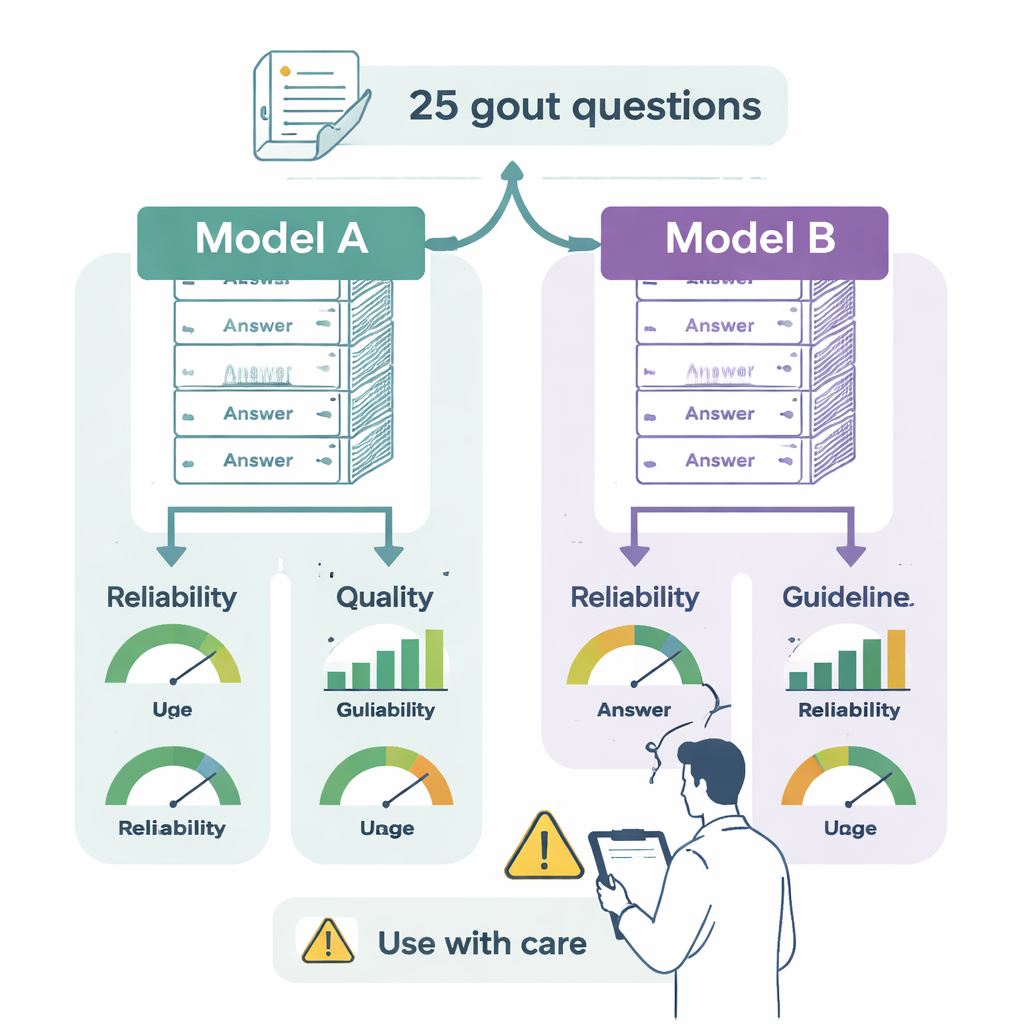

Badacze postanowili porównać dwa wiodące modele językowe — ChatGPT-4o i Gemini 2.0 Flash — z oficjalnymi europejskimi wytycznymi EULAR dotyczącymi dny moczanowej. Dwóch specjalistów przekształciło 25 kluczowych zaleceń z wytycznych w pytania w stylu lekarza dotyczące sytuacji z praktyki: jak rozpoznać dnę, kiedy rozpocząć leczenie obniżające poziom kwasu moczowego, jak postępować w napadach, jakie cele przyjmować w badaniach krwi oraz jak dostosowywać styl życia lub inne leki. Oba chatboty otrzymały te same pytania w oddzielnych, „czystych” sesjach, tak aby wcześniejsze odpowiedzi nie wpływały na kolejne.

Jak oceniano odpowiedzi

Każdą odpowiedź oceniali dwaj doświadczeni klinicyści zajmujący się dną, którzy nie wiedzieli, który model ją wygenerował. Oceniali trzy aspekty. Po pierwsze, wiarygodność: czy odpowiedź wydaje się wyważona, obiektywna i godna zaufania, czy pomija istotne informacje lub wyolbrzymia korzyści? Po drugie, jakość: czy odpowiedź jest jasna, dobrze zorganizowana i użyteczna dla specjalisty podejmującego decyzje? Po trzecie, zgodność z wytycznymi: czy odpowiada temu, co naprawdę zaleca EULAR, częściowo się z nim zgadza z pewnymi lukami, czy bezpośrednio mu zaprzecza? Zespół sprawdził także, jak trudne do czytania były odpowiedzi, stosując standardowe testy czytelności, które szacują wymagany poziom wykształcenia do zrozumienia tekstu.

ChatGPT kontra Gemini: kto wypadł lepiej?

Oba chatboty generowały na ogół sensowne, przejrzyste odpowiedzi i często przypominały o konieczności konsultacji z profesjonalistą. Jednak pojawiły się istotne różnice. ChatGPT-4o w pełni odpowiadał wytycznym dotyczącym dny w 76% przypadków i udzielił głównie poprawnych, lecz niekompletnych odpowiedzi w kolejnych 20%, przy zaledwie jednej odpowiedzi zawierającej wyraźny błąd medyczny. Gemini było w pełni zgodne jedynie w 48% odpowiedzi, a w 32% odpowiadało częściowo poprawnie, lecz niekompletnie. Co niepokojące, 12% jego odpowiedzi mieszało poprawne idee z błędnymi informacjami, a 8% jawnie zaprzeczało wytycznym — na przykład sugerując szerokie stosowanie silnej klasy leków przeciwzapalnych (inhibitory IL‑1), które EULAR zarezerwowało dla wybranych, trudnych do leczenia pacjentów, lub zalecając rutynowe rozpoczynanie terapii obniżającej kwas moczowy podczas ostrego napadu, w obszarze, gdzie eksperci zalecają większą ostrożność.

Czytelne, ale nie łatwe do przeczytania

Pod względem stylu oba systemy były zaskakująco podobne. W kilku skalach czytelności teksty obu wymagały co najmniej poziomu wykształcenia uniwersyteckiego, by móc je swobodnie śledzić. Może to być akceptowalne dla lekarzy specjalistów, ale zbyt skomplikowane dla większości pacjentów. Żaden z modeli nie podawał odniesień ani linków do źródeł, chyba że poproszono o to wyraźnie, co utrudnia weryfikację pochodzenia informacji. Zgodność ocen między recenzentami oceniono jako dobrą do doskonałej, co sugeruje, że punktacja była spójna, a różnice między chatbotami rzeczywiste, a nie jedynie subiektywne.

Co to oznacza dla osób żyjących z dną

Podsumowując, badanie sugeruje, że zaawansowane chatboty mogą być przydatnym wsparciem dla lekarzy zajmujących się dną, ale nie są jeszcze gotowe do samodzielnego stosowania. ChatGPT-4o był bardziej wiarygodny, bardziej kompletny i wierniej odzwierciedlał wytyczne ekspertów niż Gemini, jednak nawet jego rzadkie błędy mogą mieć znaczenie, gdy w grę wchodzą leki i bezpieczeństwo pacjenta. Oba narzędzia operowały poziomem języka zbyt zaawansowanym dla większości pacjentów i brakowało im wbudowanej przejrzystości co do źródeł. Na razie autorzy argumentują, że SI powinna być postrzegana jako obiecujące narzędzie wspomagające, które może pomagać klinicystom i edukatorom — ale tylko wtedy, gdy jej porady są weryfikowane w oparciu o aktualne wytyczne i ocenę ekspertów, zwłaszcza w schorzeniach takich jak dna, gdzie drobne różnice w dawkowaniu i decyzjach dotyczących czasu mogą znacząco wpłynąć na ból, długoterminowe uszkodzenia i jakość życia.

Cytowanie: Meral, H.B., Kolak, E. Evaluation of ChatGPT-4o and Gemini for gout management: a comparative analysis based on EULAR guidelines. Sci Rep 16, 4831 (2026). https://doi.org/10.1038/s41598-026-35166-5

Słowa kluczowe: dna moczanowa, wytyczne kliniczne, sztuczna inteligencja, duże modele językowe, reumatologia