Clear Sky Science · pl

Zautomatyzowane uzupełnianie obrazów w restauracji zabytków historycznych z wykorzystaniem hybrydy transferu wiedzy i głębokich modeli generatywnych

Dlaczego naprawianie starożytnej sztuki przy pomocy AI ma znaczenie

Muzea i archeolodzy na całym świecie ścigają się z czasem. Starożytne murale, freski i malowane ściany kruszeją, blakną i pękają po wiekach narażenia na wilgoć, zanieczyszczenia i niedbałe obchodzenie się. Ręczna konserwacja jest powolna, kosztowna i czasem nieodwracalna. W badaniu przedstawiono nowy system sztucznej inteligencji, który może cyfrowo naprawiać uszkodzone obrazy dawnych dzieł sztuki, dając kuratorom i badaczom bezpieczny sposób wizualizacji, jak mogły wyglądać utracone sceny, i umożliwiając ich zachowanie dla przyszłych pokoleń.

Pęknięte ściany, brakująca farba i cyfrowa siatka bezpieczeństwa

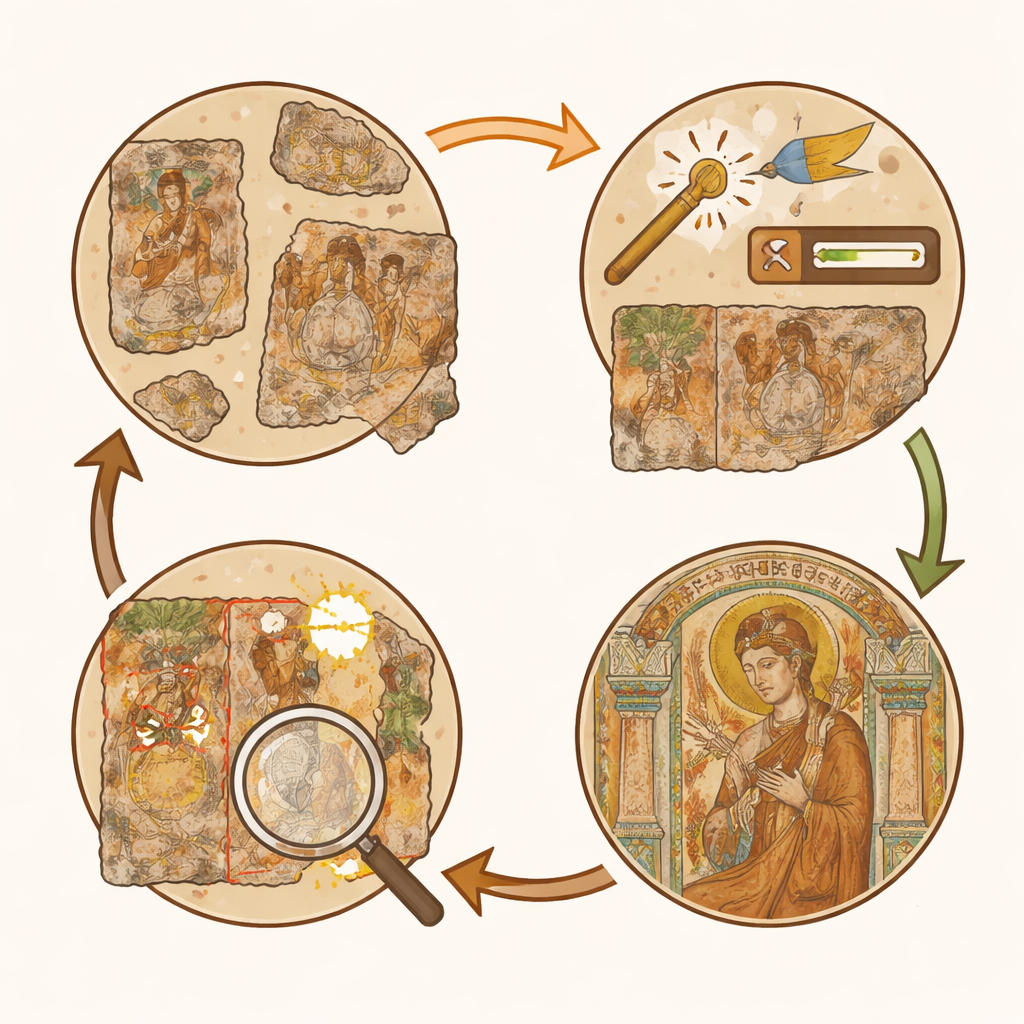

Tradycyjna restauracja często oznacza, że konserwator fizycznie retuszuje dzieło, dodając nową farbę tam, gdzie stara zniknęła. Nawet wykonywane ostrożnie, takie zmiany trudno cofnąć i mogą wprowadzać współczesne uprzedzenia. Cyfrowa restauracja podchodzi inaczej: wysokiej rozdzielczości zdjęcia uszkodzonych murali przetwarzają algorytmy komputerowe, które proponują, jak można wypełnić brakujące obszary. Ponieważ wszystko odbywa się w oprogramowaniu, proponowane rekonstrukcje można porównywać, poprawiać lub całkowicie odrzucać bez dotykania oryginału. Autorzy skupiają się na muralach z Dunhuang w Chinach — słynnym kompleksie świątyń jaskiniowych, których polichromie ucierpiały wskutek pęknięć, złuszczania, pleśni i dużych ubytków. Ich celem jest zbudowanie systemu, który potrafi automatycznie naprawiać takie obrazy, zachowując styl, kolory i drobne detale jak najbardziej nienaruszone.

Od zaszumionych zdjęć do czystych punktów wyjścia

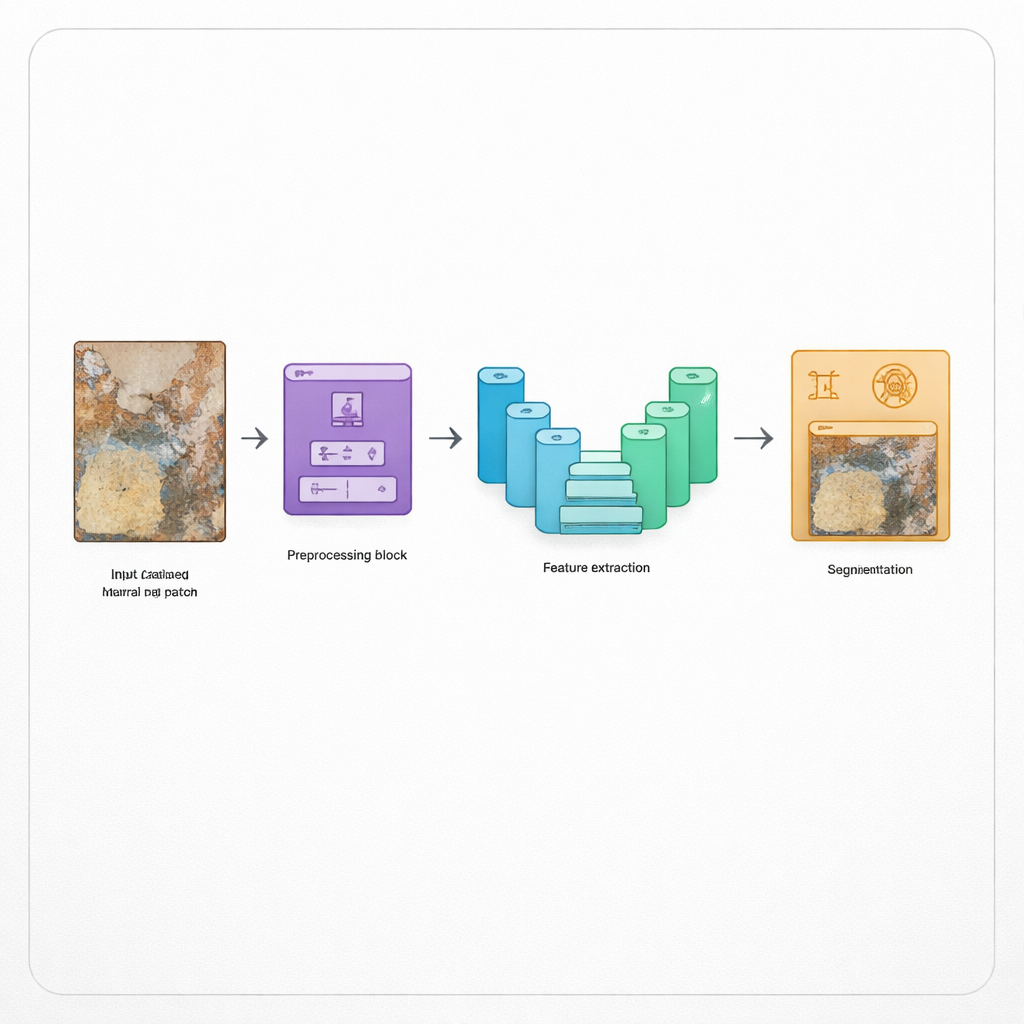

Pierwszym krokiem w systemie jest oczyszczenie zdjęć wejściowych, aby dalsze przetwarzanie nie było zmylane przez szumy aparatu czy słabe oświetlenie. Metoda wykorzystuje adaptacyjny filtr medianowy — technikę wygładzającą plamki i losowe jasne lub ciemne piksele przy jednoczesnym zachowaniu ostrych krawędzi, takich jak kontury sceny muralu. Następnie poprawia kontrast tak, by słabe linie i wyblakłe kolory stały się łatwiejsze do rozróżnienia. Te korekty działają jak delikatne przetarcie zakurzonej soczewki: nie tworzą nowej treści, lecz uwidaczniają istniejące detale. Poprzez ostrożne dostrojenie tego etapu autorzy unikają nadmiernego wygładzania, które mogłoby zetrzeć subtelne pociągnięcia pędzla cenione przez badaczy.

Nauka systemu rozumienia uszkodzeń

Gdy obraz zostanie oczyszczony, model musi ustalić, które części muralu są nienaruszone, a które uszkodzone. W tym celu autorzy stosują kompaktową, lecz wydajną sieć neuronową o nazwie SqueezeNet, dostosowaną mechanizmem uwagi, by skupiała się na informatywnych obszarach. Sieć uczy się „czytać” wizualny język murali — faktury tynku, wzory pigmentów oraz kształty pęknięć czy gołej ściany. Jej wyjście zasila inną sieć zwaną U-Net, zaprojektowaną do precyzyjnych zadań w stylu „wycinania”. U-Net etykietuje każdy piksel jako zdrową warstwę farby, brakującą łatę lub inne formy degradacji. Dzięki skip connections oraz dodanym blokom uwagi i reszt oraz zachowaniu zarówno szerokiego układu (gdzie leży postać czy bordiura), jak i drobnych cech (jak cienkie linie i ornamenty), dokładnie mapuje, gdzie potrzebne jest inpainting.

Pozwolić AI-piaskarowi wypełnić luki

Z oznaczonymi obszarami uszkodzeń ostatni etap polega na wyobrażeniu sobie, jak te fragmenty mogły pierwotnie wyglądać. Tutaj autorzy łączą dwie nowatorskie koncepcje: generatywne sieci przeciwstawne (GAN), które świetnie radzą sobie z tworzeniem realistycznych obrazów, oraz sieci transformerowe, doskonałe w uchwyceniu zależności na dużą skalę. Ich hybrydowy „transformerowy GAN” patrzy na otaczającą nienaruszoną farbę i na mural jako całość, aby wywnioskować prawdopodobne tekstury, kształty i kolory dla brakujących stref. Nie ogranicza się do kopiowania pikseli z sąsiedztwa; syntezując nową treść, płynnie łączy ją ze sceną i respektuje globalną kompozycję, np. symetrię wzorów czy ciągłość szat i linii architektonicznych.

Jak dobrze działa cyfrowy konserwator

Aby przetestować swój system, badacze użyli specjalistycznego zbioru danych obrazów murali z Dunhuang, który zawiera sztucznie uszkodzone wersje oraz oryginalne, nieuszkodzone wzorce. Dzięki temu mogą zmierzyć, jak blisko cyfrowo odrestaurowany wynik jest do referencji bez uszkodzeń. Informują, że ich metoda, nazwana HDLIP-SHAR, przewyższa kilka silnych istniejących technik w wielu miarach jakości, w tym ogólnej ostrości (PSNR), podobieństwa strukturalnego (SSIM) oraz nowoczesnej miary percepcyjnej (LPIPS), lepiej odzwierciedlającej ludzką ocenę wizualną. Model działa też efektywnie, wymagając mniej zasobów obliczeniowych i krótszego czasu niż wiele konkurencyjnych podejść, co ma znaczenie, gdy muzea chcą przetwarzać duże kolekcje.

Co to znaczy dla ratowania historii

Dla osób niebędących specjalistami kluczowe jest to, że system AI działa jak ostrożny, odwracalny asystent, a nie zbyt pewny siebie malarz. Może sugerować, jak można uzupełnić brakujące twarze, wzory czy sceny w starożytnych muralach, oferując badaczom silne narzędzie wizualizacyjne bez narażania oryginałów. Autorzy wskazują też ograniczenia: metoda nadal zależy od posiadania względnie czytelnych materiałów referencyjnych, ma trudności przy skrajnie poważnych uszkodzeniach i nie integruje jeszcze wiedzy historycznej ani analiz materiałowych w swoich przypuszczeniach. Mimo to hybrydowe podejścia takie jak HDLIP-SHAR stanowią ważny krok w kierunku wykorzystania AI nie tylko do upiększania obrazów, lecz także do chronienia niezastąpionego dziedzictwa kulturowego w sposób przejrzysty, testowalny i nieinwazyjny.

Cytowanie: Swathi, B., Rao, D.B.J. Automated image inpainting for historical artifact restoration using hybridisation of transfer learning with deep generative models. Sci Rep 16, 4810 (2026). https://doi.org/10.1038/s41598-026-35056-w

Słowa kluczowe: cyfrowa restauracja murali, uzupełnianie obrazów, głębokie uczenie, dziedzictwo kulturowe, modele GAN i transformery