Clear Sky Science · pl

Hybrydowy inteligentny model oceny edukacji tłumaczeniowej z ulepszonym BERT i SVM

Dlaczego inteligentniejsze ocenianie tłumaczeń ma znaczenie

Co roku nauczyciele języków spędzają niezliczone godziny na ocenianiu tłumaczeń uczniów. Decydowanie, czy zdanie jest „dostateczne”, jest powolne, subiektywne i może znacznie różnić się między osobami oceniającymi. Artykuł bada, czy sztuczna inteligencja może odciążyć nauczycieli — oferując szybkie, spójne oceny i wskazówki, co poszło nie tak — bez zastępowania pedagoga. Przedstawia nowy model komputerowy, nazwany BERT-SVM EduScore, zaprojektowany specjalnie do oceniania jakości tłumaczeń z języka angielskiego w warunkach edukacyjnych.

Od prostego dopasowania słów do głębszego rozumienia

Przez dekady komputery oceniały tłumaczenia głównie przez liczenie, ile słów lub krótkich fraz pokrywa się z odpowiedzią wzorcową. Znane narzędzia, takie jak BLEU czy METEOR, robią to bardzo szybko, ale mają trudności z elastycznością języka naturalnego: dwa zdania mogą przekazywać to samo znaczenie przy zupełnie innym doborze słów. W klasie, gdzie uczniowie eksperymentują z synonimami i różnymi strukturami zdań, takie stare metryki mogą niesłusznie karać poprawne parafrazy i dostarczać niewiele wskazówek o konkretnych błędach. Dlatego badacze zwrócili się ku nowszym metodom, które porównują znaczenia zamiast powierzchownych słów, wykorzystując potężne modele językowe trenowane na ogromnych zbiorach tekstu.

Hybrydowy model zaprojektowany do pracy w klasie

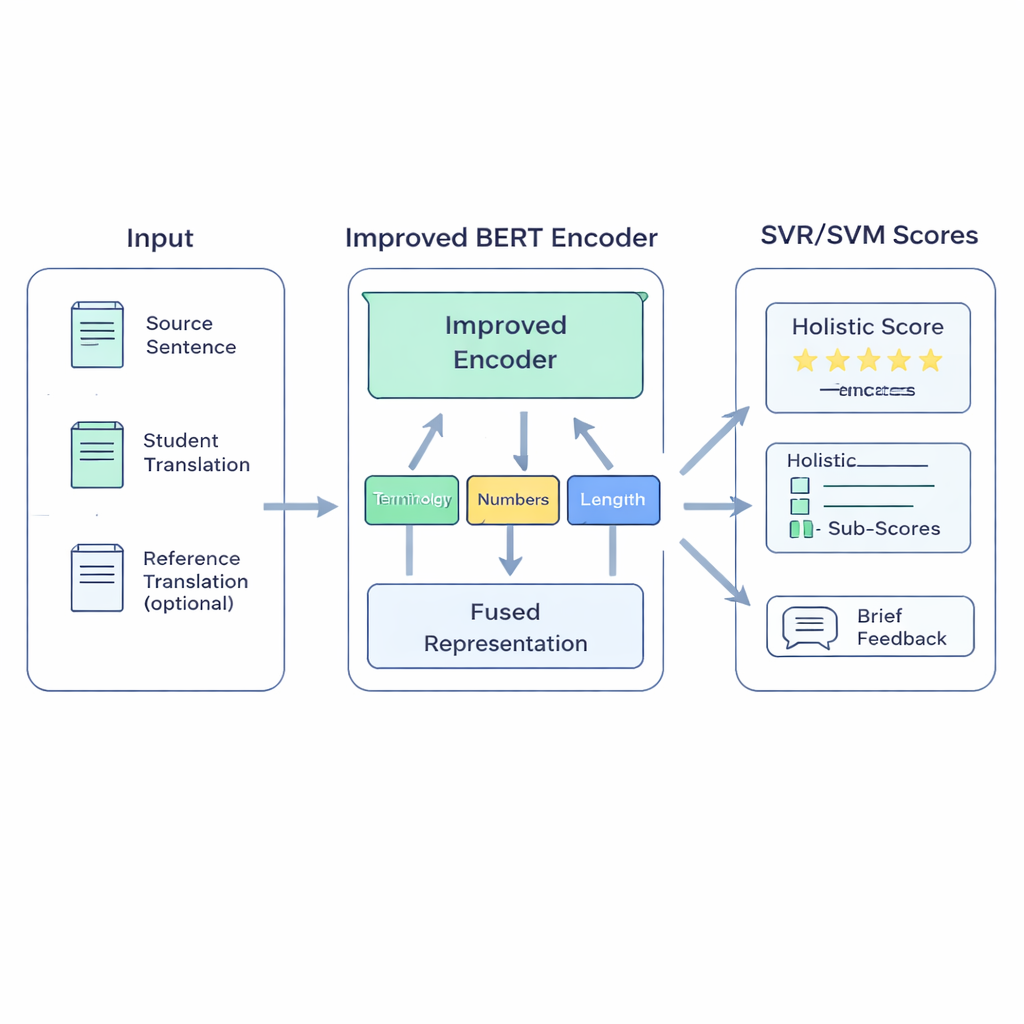

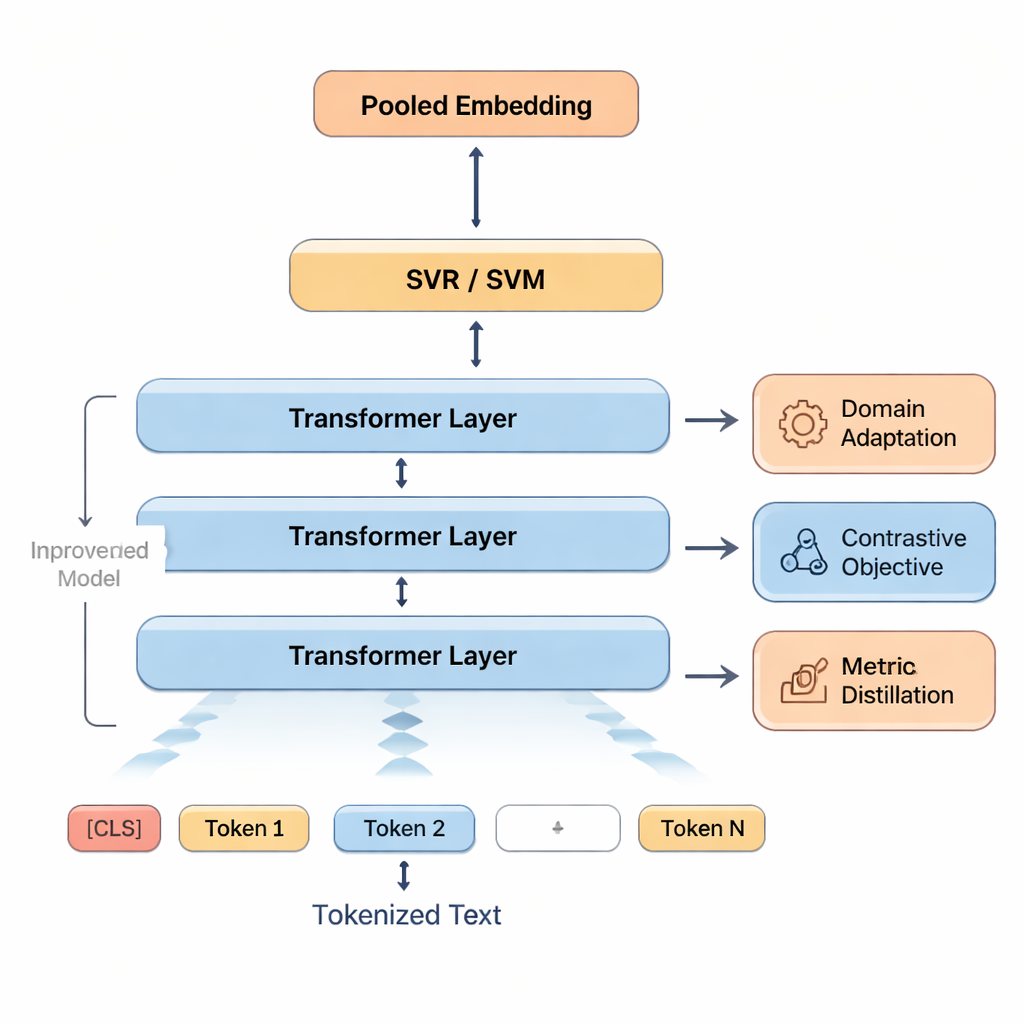

Proponowany system BERT-SVM EduScore łączy dwie koncepcje: głębokie rozumienie języka oraz klasyczne, odporne metody statystyczne. Najpierw wykorzystuje ulepszoną wersję modelu BERT do analizy trzech elementów tekstu: zdania oryginalnego, tłumaczenia ucznia oraz, gdy jest dostępne, tłumaczenia wzorcowego. BERT zamienia je na bogate numeryczne podsumowanie, które odzwierciedla nie tylko obecność słów, ale też zgodność znaczeń. Do tego system dodaje niewielki zestaw ręcznie opracowanych kontroli istotnych dla nauczycieli — na przykład, czy terminy techniczne są tłumaczone konsekwentnie, czy liczby i jednostki zostały zachowane, czy interpunkcja jest sensowna oraz czy długość tłumaczenia odpowiada oryginałowi.

Jak system uczy się oceniać jak nauczyciel

Te sygnały są następnie przekazywane do Maszyn Wektorów Nośnych (Support Vector Machines), rodziny algorytmów znanych z dobrej pracy przy ograniczonej liczbie danych. Jedna część przewiduje ocenę ogólną; inne części mogą generować oddzielne oceny obszarów takich jak dokładność czy płynność, albo sortować tłumaczenia do pasm jakości. Aby model lepiej dopasował się do języka charakterystycznego dla zajęć szkolnych, autorzy najpierw ponownie trenują BERT na tekstach podobnych do prac uczniowskich — podejście zwane adaptacją do domeny. Dodatkowo wyostrzają zdolność BERT-a do rozróżniania, ćwicząc go w rozpoznawaniu dobrych i lekko zmodyfikowanych złych wersji zdań. Wreszcie, gdy dostępne są wysokiej jakości automatyczne metryki, takie jak COMET czy BLEURT, system uczy się naśladować niektóre z ich ocen, zapożyczając ich zalety przy jednoczesnym dostrojeniu do ocen ludzkich.

Testy systemu

Badacze oceniają BERT-SVM EduScore na dużym publicznym zbiorze danych zawierającym tłumaczenia maszynowe angielsko‑chińskie ocenione przez ludzi. Choć nie są to prace uczniowskie, oceny na poziomie zdań przypominają ocenianie w klasie i stanowią realistyczny test wytrzymałościowy. Nowy system porównano z tradycyjnymi miarami opartymi na słowach, nowszymi miarami opartymi na znaczeniu oraz kilkoma silnymi modelami neuronowymi. System nie tylko lepiej koresponduje z ocenami ludzkimi — wykazując wyższą zgodność i mniejsze średnie błędy — lecz także działa wystarczająco szybko, by przetwarzać około 44 zdania na sekundę na standardowym sprzęcie graficznym. Dokładne eksperymenty pokazują, że największy wzrost daje dostosowanie BERT-a do odpowiedniego rodzaju tekstu, podczas gdy dodatkowe triki uczenia dają stabilne, drobne poprawy bez zauważalnego spowolnienia działania systemu.

Co to może znaczyć dla nauczycieli i uczniów

Mówiąc prosto, badanie wykazuje, że starannie zaprojektowana hybryda uczenia głębokiego i klasycznych metod może oceniać tłumaczenia bardziej niezawodnie niż istniejące narzędzia automatyczne, pozostając jednocześnie wystarczająco szybka do użycia w czasie rzeczywistym w klasie. BERT-SVM EduScore nie jest jeszcze gotowym zamiennikiem nauczyciela: był testowany tylko na tłumaczeniach maszynowych, nie na prawdziwych pracach uczniów, i nie przeszedł prób klasowych ani kontroli pod kątem sprawiedliwości. Jednak wyniki sugerują, że taki system wkrótce może pomagać nauczycielom, oferując stabilne oceny i wskazując prawdopodobne problemy — takie jak błędnie przetłumaczone terminy lub brakujące liczby — dzięki czemu ludzka informacja zwrotna może skupić się na głębszych, bardziej twórczych aspektach tłumaczenia.

Cytowanie: Lin, C. A hybrid intelligent assessment model for English translation education with improved BERT and SVM. Sci Rep 16, 5466 (2026). https://doi.org/10.1038/s41598-026-35042-2

Słowa kluczowe: ocena tłumaczeń, edukacja językowa, BERT, maszyny wektorów nośnych, estymacja jakości