Clear Sky Science · pl

Badanie nad projektowaniem i multimodalną ewaluacją intuicyjnych interfejsów dla złożonych systemów informacyjnych we współpracy załogowych i bezzałogowych

Dlaczego mądrzejsze ekrany mają znaczenie podczas misji pod presją

Współczesne misje wojskowe coraz częściej opierają się na zespołach załogowych statków powietrznych współdziałających ze stadem dronów. Dowódcy muszą w ciągu sekund przesiać zatłoczone ekrany radarów i panele statusu — pomyłka może oznaczać przeoczone zagrożenie albo ostrzał sojuszniczy. Badanie stawia proste pytanie o dalekosiężnych skutkach: jeśli przeprojektujemy te złożone ekrany tak, by były bardziej „oczywiste” na pierwszy rzut oka — używając obrazów, koloru i ruchu zamiast gęstego tekstu — czy ludzie będą myśleć szybciej, zachowywać spokój i nadal podejmować właściwe decyzje?

Przekształcanie intuicji w projekt ekranu

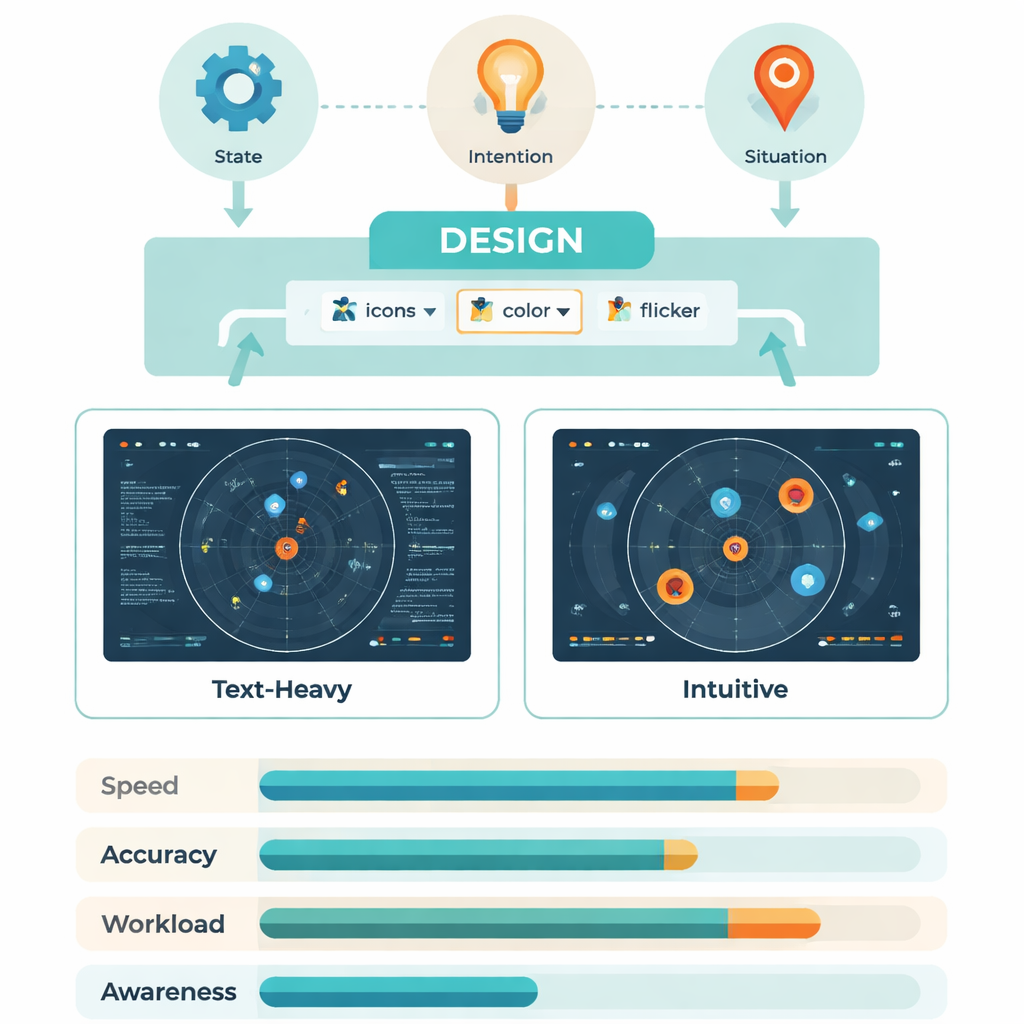

Badacze opierają się na koncepcji „intuicyjnej interakcji”: sposobie, w jaki automatycznie rozumiemy czerwone światło jako niebezpieczeństwo albo zerwane ogniwo jako utraconą łączność. Psychologia i badania z zakresu czynników ludzkich sugerują, że takie wbudowane wzorce — odruchy cielesne, codzienne symbole i znane ikony — można wykorzystać, aby użytkownicy nie musieli świadomie odszyfrowywać każdej informacji. W tym projekcie te idee zastosowano do ekranów zarządzania walką, które pokazują trzy główne rodzaje informacji: jakie cele i uzbrojenie są obecne (stan), co drony zamierzają zrobić (intencja) oraz jak rozwija się całe starcie (sytuacja). Mapując każdy z tych elementów na proste kształty, kolory i ruch, zespół dążył do stworzenia wyświetlaczy, które „tłumaczą się same” w chwili pojawienia się.

Od szkiców ekspertów do działających paneli taktycznych

Projektowanie takiego interfejsu nie było zgadywanką. Zespół najpierw przeprowadził wywiady z doświadczonymi operatorami i projektantami systemów, pytając na przykład: „Jaki symbol pozwala rozpoznać zakłócający dron bez zastanawiania się?” Z tych sesji wydestylowano słowa-klucze, takie jak oko, fala, łańcuch i strefa, a następnie przekształcono je w zgrubne zestawy ikon. Druga grupa ekspertów testowała te prototypy, myśląc na głos. Każdy symbol, który nie był rozumiany poprawnie przez wszystkich, był poprawiany, aż każdy element mógł być odczytany natychmiast. Finalny interfejs używał sylwetek samolotów zamiast etykiet tekstowych, jasności do pokazania poziomu zagrożenia, migotających podświetleń do oznaczania, gdzie dron poruszy się następnie, celowników lub falistych linii do sygnalizowania ataków lub zakłóceń oraz małych lokalnych znaczników pod każdym celem, by pokazać, czy wszedł on w krytyczny zasięg.

Stawianie intuicyjnych ekranów na próbę

Aby sprawdzić, czy te pomysły działają w praktyce, 30 przeszkolonych osób z Sił Powietrznych usiadło przy symulowanej konsoli dowodzenia i wykonywało zadania na polu bitwy. Czasami używali tradycyjnego ekranu obfitującego w tekst; innym razem korzystali z nowej, intuicyjnej wersji, przy czym układ i kolory były starannie dopasowane, tak by różnica dotyczyła jedynie sposobu kodowania informacji. Podczas wyszukiwania konkretnych dronów, pocisków, poziomów zagrożenia, awarii łączy czy celów w zasięgu system rejestrował, jak szybko i jak dokładnie reagowali, gdzie kierował się ich wzrok oraz jak reagował mózg za pomocą sygnałów EEG powiązanych z obciążeniem poznawczym. Po zakończeniu uczestnicy oceniali, jak wymagające były zadania na dobrze znanej skali obciążenia NASA‑TLX.

Szybsze oczy, lżejsze mózgi

Intuicyjne ekrany konsekwentnie pomagały przy niskim i umiarkowanym obciążeniu informacyjnym. Operatorzy odpowiadali szybciej — często o kilkaset milisekund na zapytanie — i potrzebowali mniej fiksacji wzroku oraz skoków, by znaleźć właściwy element. Dynamiczne wskazówki, takie jak delikatne migotanie, były szczególnie skuteczne w uwydatnianiu przyszłej pozycji drona, podczas gdy powszechnie rozumiane symbole (na przykład celowniki do ataku) przewyższały bardziej zagadkowe kody zawodowe przy opisywaniu nadchodzących działań. Pomiary aktywności mózgu potwierdziły te wyniki: kluczowy sygnał zwany P300, który rośnie wraz z wysiłkiem i opóźnieniem w przetwarzaniu, był mniejszy i pojawiał się wcześniej przy użyciu intuicyjnych wyświetlaczy, co wskazuje, że mózg działał efektywniej. Przy gęstych zadaniach o dużym obciążeniu przewaga malała, sugerując, że żaden interfejs nie zniweluje całkowicie ekstremalnej złożoności.

Co to oznacza dla osób w pętli decyzyjnej

W teście następczym na zoptymalizowanej wersji intuicyjnego interfejsu nowa grupa operatorów wykazała lepszą świadomość sytuacyjną, wyższą skuteczność i niższe zgłaszane obciążenie psychiczne w porównaniu z tradycyjnym układem. Mówiąc wprost: przekształcając liczby i żargon w czytelne obrazy, kody kolorystyczne i ruch zgodny z codziennym doświadczeniem, system pozwolił ludziom szybciej dostrzegać zagrożenia i możliwości przy mniejszym zmęczeniu umysłowym. Choć prace przeprowadzono w laboratorium na wąskiej grupie użytkowników, dają one konkretny przepis na projektowanie przyszłych sal dowodzenia — wojskowych lub cywilnych — gdzie operatorzy muszą dotrzymać kroku inteligentnym maszynom, nie będąc przytłoczonymi.

Cytowanie: Qu, J., Chen, S., Dang, S. et al. A study on design and multimodal evaluation of intuitive interfaces for complex information systems in manned/unmanned cooperation. Sci Rep 16, 4746 (2026). https://doi.org/10.1038/s41598-026-35017-3

Słowa kluczowe: intuicyjne interfejsy, współpraca człowiek–maszyna, świadomość sytuacyjna, śledzenie wzroku i EEG, współpraca załogowe–bezzałogowe