Clear Sky Science · pl

Multi-TPC: Zbiór multimodalny do rozmów trzyosobowych z danymi o mowie, ruchu i spojrzeniu

Dlaczego to, jak się ruszamy i patrzymy podczas rozmowy, ma znaczenie

Gdy ludzie rozmawiają twarzą w twarz, wymieniają nie tylko słowa. Pochylamy się do przodu, kiwamy głowami, zerkamy na siebie i robimy pauzy w odpowiednich miejscach. Te subtelne ruchy zyskują jeszcze większe znaczenie, gdy rozmawiają trzy osoby, bo uwaga i kolejność mówienia nieustannie się zmieniają. Do tej pory naukowcy i inżynierowie mieli jednak bardzo mało wysokiej jakości danych pokazujących, jak mowa, ruch ciała i spojrzenie współdziałają w rozmowach małych grup. Ten artykuł przedstawia nowy zbiór danych, stworzony, by wypełnić tę lukę i pomóc w budowaniu bardziej naturalnych asystentów wirtualnych, robotów społecznych i narzędzi do badania codziennych interakcji międzyludzkich.

Nowe spojrzenie na rozmowy trzyosobowe

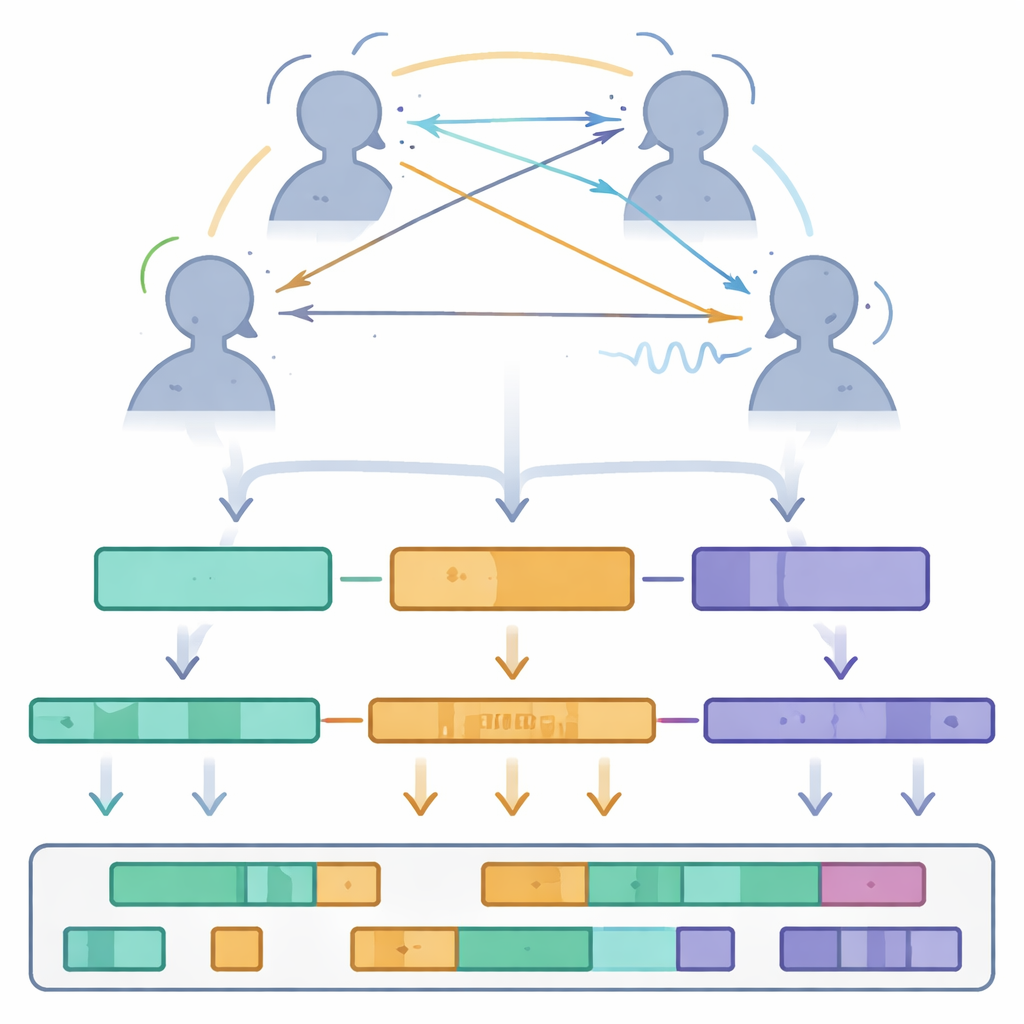

Autorzy prezentują Multi-TPC, publicznie dostępny zbiór rozmów trzyosobowych nagranych w laboratorium z użyciem systemu do przechwytywania ruchu, śledzenia wzroku i indywidualnych mikrofonów. W przeciwieństwie do wielu wcześniejszych zasobów skupiających się na jednym mówcy lub na rozmowach dwuosobowych, Multi-TPC rejestruje spontaniczne dyskusje trzech nieznajomych, którzy stoją w trójkącie i rozmawiają na dowolny temat. Zawiera ponad 5,3 godziny nagrań od 21 młodych dorosłych uczestników, rozdzielonych na 24 sesje. W każdej chwili tych rozmów zbiór danych dostarcza szczegółowych informacji o tym, jak każda osoba mówi, porusza się i gdzie kieruje wzrok.

Jak zarejestrowano rozmowy

Aby zbudować ten zbiór, zespół zastosował hybrydowy układ nagraniowy. Każdy uczestnik miał na sobie kombinezon do przechwytywania ruchu pokryty odblaskowymi markerami, dzięki czemu ośmioczęściowa tablica kamer mogła śledzić ich postawę, ruchy głowy i gesty w trzech wymiarach. Lekki system śledzenia wzroku w formie okularów, przypominający zwykłe okulary, mierzył, gdzie każda osoba patrzy w polu widzenia. Bezprzewodowe mikrofony przypięte blisko szyi nagrywały głos każdego mówcy na oddzielnej ścieżce dźwiękowej. Przed nagraniem uczestnicy byli skalibrowani w systemie i poproszeni o pozostanie na stałych miejscach tworzących trójkąt równoboczny o bokach około jednego metra. Klaśnięcie na klapierce, widoczne dla kamer, urządzeń śledzących wzrok i mikrofonów, dostarczało precyzyjnej wskazówki do wyrównania wszystkich urządzeń w czasie, zapewniając, że ruch, spojrzenie i mowa można dopasować klatka po klatce.

Oczyszczanie, organizacja i wzbogacanie danych

Zbieranie surowych sygnałów było tylko pierwszym krokiem. Badacze starannie przetworzyli dane ruchu, oznaczając wszystkie markery i wypełniając drobne przerwy za pomocą interpolacji matematycznej przy jednoczesnym sprawdzaniu pozycji pobliskich markerów. Nagrania audio poddano oczyszczaniu metodami redukcji szumów, a następnie przekazano do oprogramowania rozpoznającego mowę, które wygenerowało transkrypcje słowo po słowie, później ręcznie korygowane. Punkty spojrzenia mierzone w pikselach kamery przekształcono w kąty 3D pokazujące, gdzie każda osoba patrzy w przestrzeni. Wszystkie sygnały zostały przeskalowane do 60 klatek na sekundę i zsynchronizowane, a następnie zapisane w prostych, otwartych formatach. Finalny zbiór danych jest zorganizowany według modalności — ruch, spojrzenie, audio, słowa i cechy prozodyczne, takie jak głośność i ton — z jasnymi zasadami nazewnictwa plików, aby badacze mogli łatwo śledzić dowolny moment czasu we wszystkich trzech uczestnikach.

Co zbiór danych ujawnia o rozmowach grupowych

Korzystając z Multi-TPC, autorzy przeprowadzili wstępną analizę statystyczną przebiegu rozmów trzyosobowych. Zmierzyli kolejność mówienia i milczenia, stwierdzając, że typowy czas wypowiedzi trwa około 2,7 sekundy, rozdzielony pauzami nieco ponad sekundę. Zbadali też kiwanie i potrząsanie głową jako formy informacji zwrotnej od słuchaczy, wykrywając średnio około ćwierci kiwnięcia lub potrząśnięcia na sekundę — dowód, że słuchacze nieustannie sygnalizują uwagę i nastawienie bez słów. Analiza spojrzeń wykazała, że ludzie rzadko długo koncentrują wzrok bezpośrednio na czyjejś twarzy. Częściej patrzą nieco bokiem, a wzorce spojrzeń zmieniają się w zależności od tego, kto mówi, czy trwa pauza, lub czy mówi więcej niż jedna osoba jednocześnie. Podczas nakładającej się mowy spojrzenia uczestników stają się bardziej równomiernie rozproszone lub odchodzą od obu rozmówców, co sugeruje niepewność co do tego, kto ma w danym momencie kontrolę nad rozmową.

Dlaczego ten zasób ma znaczenie dla przyszłych technologii

Poprzez spakowanie tych wszystkich warstw informacji w dobrze udokumentowany, udostępnialny zbiór danych, Multi-TPC oferuje nową podstawę do badania, jak małe grupy zarządzają przekazywaniem głosu, uwagą i informacją zwrotną poprzez słowa i ruch. Dla czytelników powszechnych wniosek jest taki, że taniec rozmowy — kto mówi kiedy, na kogo patrzy i jak subtelne kiwnięcia kształtują przepływ — jest teraz uchwycony w drobnych szczegółach. Dla naukowców i deweloperów otwiera to drzwi do tworzenia postaci wirtualnych i robotów społecznych, które reagują bardziej jak prawdziwi ludzie w ustawieniach grupowych, oraz do głębszych badań nad tym, jak koordynujemy się nawzajem głosem, ciałem i spojrzeniem.

Cytowanie: Lee, MC., Deng, Z. Multi-TPC: A Multimodal Dataset for Three-Party Conversations with Speech, Motion, and Gaze. Sci Data 13, 429 (2026). https://doi.org/10.1038/s41597-026-06819-x

Słowa kluczowe: konwersacja multimodalna, gesty i spojrzenie, zbiór danych o interakcjach społecznych, przekazywanie głosu, wirtualni agenci