Clear Sky Science · pl

Dataset wideo o superrozdzielczości dla chińskiej opery tradycyjnej oparty na fuzji degradacji „Real-world+”

Przywracanie dawnych filmów operowych do życia

Wiele nagrań chińskiej opery tradycyjnej zachowało się jedynie w kruchej, niskiej jakości formie wideo. Czas, kurz i wielokrotne kopiowanie rozmazały twarze, stłumiły kolory kostiumów i zasypały sceny szumem wizualnym. W artykule przedstawiono nowy sposób cyfrowego „oczyszczania” i wyostrzania takich nagrań — nie przez ręczną naprawę każdego filmu, lecz przez zbudowanie specjalistycznego zbioru treningowego dla sztucznej inteligencji. Celem jest nauczenie komputerów, jak przekształcać rozmyte, postarzałe materiały w czystsze, bardziej żywe obrazy, zachowując ważną część kulturowej pamięci świata.

Dlaczego stare filmy operowe wyglądają tak źle

Chińska opera tradycyjna, w tym znane style takie jak opera pekińska i kunqu, została uznana przez UNESCO za część wspólnego dziedzictwa ludzkości. Mimo to wiele zachowanych nagrań tych przedstawień przeszło długą i trudną drogę. Najpierw sprzęt filmowy wprowadza rozmycie i szumy kamery. Potem przechowywanie na taśmie, filmie czy dyskach dodaje rysy, deformacje i utraty danych. Na końcu wielokrotne kopiowanie, kompresja dla internetu i niestabilna transmisja sieciowa powodują blokuące artefakty, migotanie i utratę klatek. Efekt to nie tylko proste rozmycie, lecz splątana mieszanka wielu rodzajów uszkodzeń, co znacznie utrudnia metodom restauracyjnym odgadnięcie, jak wyglądał oryginalny obraz sceny.

Tworzenie par rozmytych i czystych klatek

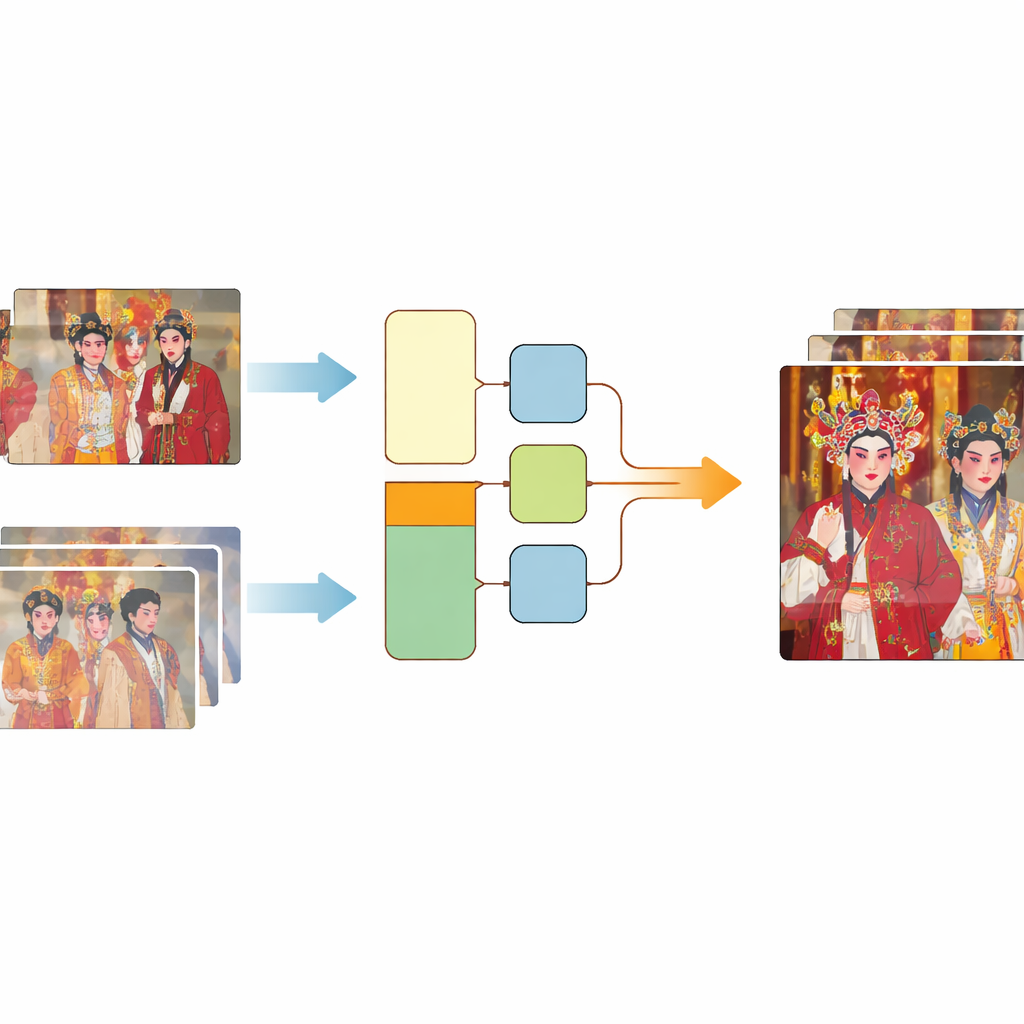

Współczesne metody „superrozdzielczości” wideo uczą komputery przewidywać ostry, szczegółowy obraz na podstawie niskiej jakości klatki. Aby opanować tę umiejętność, potrzebują wielu przykładów, w których rozmyta klatka jest dokładnie dopasowana do tej samej sceny w wysokiej jakości. Istniejące zbiory treningowe zwykle opierają się albo na uproszczonych, sztucznych uszkodzeniach, albo na materiałach rzeczywistych, które nie są precyzyjnie wyrównane między wersjami niskiej i wysokiej jakości. Autorzy stworzyli nowe źródło o nazwie CTOVSR, zaczynając od czterech tradycyjnych filmów operowych, profesjonalnie zrekonstruowanych z oryginalnych taśm do bardzo wysokiej rozdzielczości. Następnie znaleźli pasujące, standardowo-definicyjne wersje tych samych przedstawień udostępnione online. Te kopie niższej jakości przeszły przez pełny realny proces starzenia, stając się idealnymi obrazami „przed”.

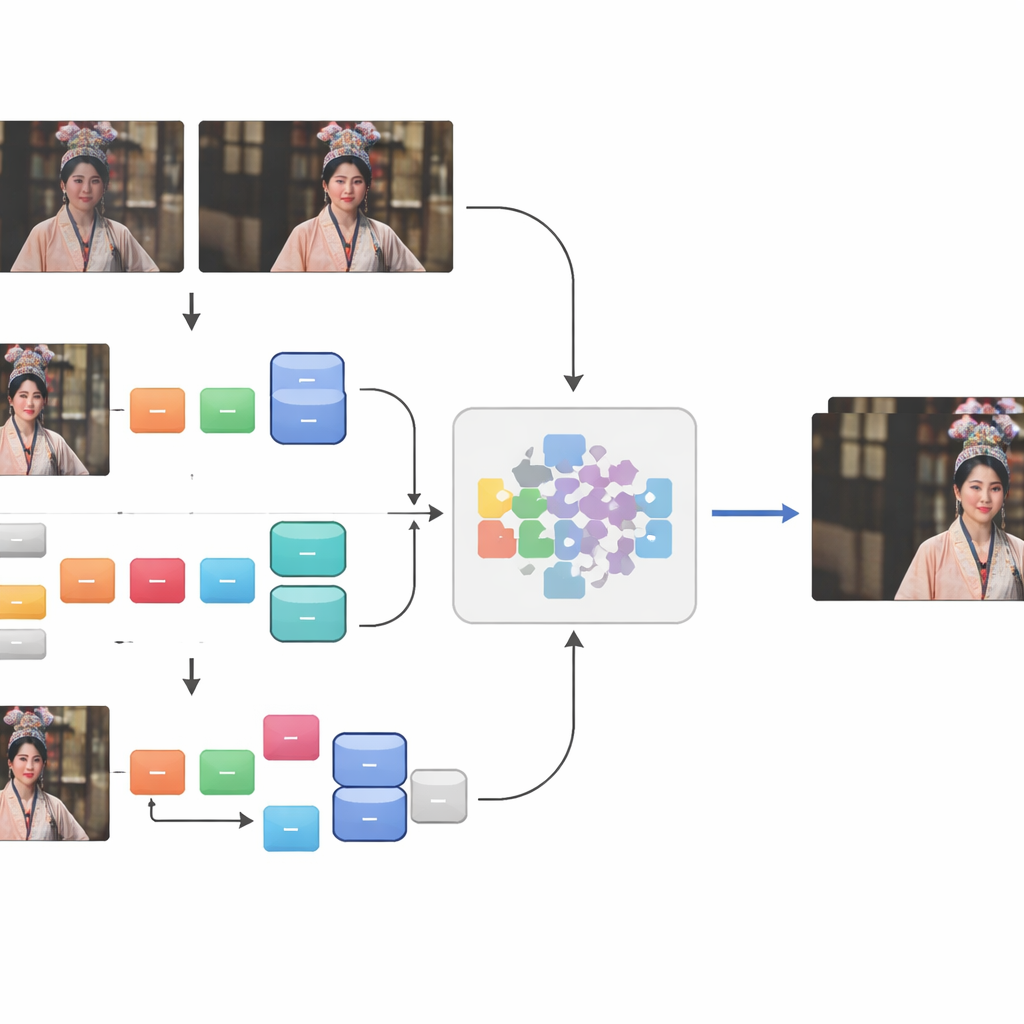

Staranna wyrównywanie każdej klatki

Dopasowanie zrekonstruowanych i sfatygowanych wideo wcale nie było proste. Różnice w liczbie klatek na sekundę, brakujące ujęcia, dodane znaki wodne, czarne paski i zmieniające się proporcje obrazu oznaczały, że proste automatyczne metody nie dawały rezultatów. Zespół wyodrębnił użyteczne segmenty, a następnie przeprowadził dokładne, trzyetapowe wyrównywanie. Najpierw użyto niestandardowego narzędzia eye_comparer do ręcznego naprawienia problemów z czasowaniem, takich jak utrata klatek, klatki poza kolejnością i „duchowe” klatki przy przejściach scen. Potem rozwiązano przestrzenne niedopasowania przez nakładanie klatek w oprogramowaniu do edycji obrazu, precyzyjne wyrównanie treści i przycięcie pasków, logo i napisów, przy jednoczesnym zachowaniu jak największej części sceny. Na koniec przeprowadzono automatyczną kontrolę za pomocą miary podobieństwa, zachowując tylko pary klatek niemal identyczne w strukturze. Ten proces dał 250 wysokiej jakości par sekwencji z rzeczywistego świata, obejmujących setki tysięcy klatek.

Mieszanie realnych uszkodzeń z symulowanym zużyciem

Chociaż te starannie wyrównane pary uchwyciły prawdziwe, realne oznaki degradacji, wciąż było ich za mało, by pokryć pełną różnorodność sposobów, w jakie wideo może się rozkładać. Aby rozszerzyć materiał treningowy, autorzy dodali drugi składnik: syntetyczne uszkodzenia nałożone na dodatkowe 41 materiałów w wysokiej rozdzielczości. Zasymulowali uszkodzenia przestrzenne — takie jak rozmycie i szum — przez dwuetapowy łańcuch kroków degradacyjnych, oraz uszkodzenia czasowe przez kompresję w powszechnie używanym starszym standardzie, odzwierciedlającym sposób kodowania wielu klipów udostępnianych historycznie online. Łącząc tę syntetyczną część z parami „Real-world+”, zgromadzili zbiór CTOVSR, zawierający 900 ściśle wyrównanych par wideo niskiej i wysokiej jakości, każda trwająca 100 klatek i ukazująca szeroki przekrój oper, scen i warunków oświetleniowych.

Udowodnienie wartości nowego zbioru

Aby sprawdzić, czy CTOVSR rzeczywiście pomaga komputerom w restauracji starych nagrań, autorzy wytrenowali kilka nowoczesnych modeli superrozdzielczości wyłącznie na tym zbiorze. Porównali wyniki z prostymi metodami skalowania i stwierdzili, że wyszkolone modele generowały znacznie czyściejsze obrazy, z ostrzejszymi detalami kostiumów, czytelniejszym makijażem twarzy i mniejszą liczbą widocznych artefaktów. Badanie ablacynjne pokazało, że połączenie realnych i syntetycznych uszkodzeń było wyraźnie lepsze niż użycie któregokolwiek z nich osobno. Badacze przetestowali też swoje modele na zupełnie nowych materiałach: postarzałych klipach operowych znalezionych online, a nawet nagraniach przedstawień z innych kultur, takich jak opera włoska czy indyjski taniec klasyczny. Ludzie oceniający wyniki przyznawali znacznie wyższe noty ulepszonym klatkom niż oryginałom czy prostym wersjom powiększonym, co sugeruje, że modele wytrenowane na CTOVSR potrafią uogólniać poza konkretne materiały w zbiorze.

Ochrona dziedzictwa przez mądrzejsze dane

Mówiąc prościej, praca ta nie wprowadza kolejnego algorytmu restauracyjnego; zamiast tego oferuje starannie przygotowany „materiał ćwiczebny”, którego te algorytmy potrzebują, aby się uczyć. Poprzez drobiazgowe parowanie uszkodzonych i wysokiej jakości wersji nagrań tradycyjnej opery, a następnie wzbogacenie ich realistycznie symulowanym zużyciem, zbiór CTOVSR daje sztucznej inteligencji znacznie lepsze wyczucie tego, jak stare wideo się degraduje i jak powinno wyglądać po przywróceniu. Podejście to stanowi praktyczną drogę nie tylko do przywrócenia wizualnego blasku chińskiej operze tradycyjnej, lecz także do ochrony wielu innych form bezcennych historycznych nagrań przed zanikiem w cyfrowej otchłani.

Cytowanie: Xi, W., Qin, B., Zhang, Y. et al. A Chinese Traditional Opera Video Super-Resolution Dataset Based on the “Real-world+” Degradation Fusion. Sci Data 13, 387 (2026). https://doi.org/10.1038/s41597-026-06776-5

Słowa kluczowe: superrozdzielczość wideo, digitalne zachowanie dziedzictwa, chińska opera tradycyjna, restauracja obrazu, zestawy danych uszkodzonych wideo