Clear Sky Science · pl

BaleUAVision: Zbiór danych UAV z uchwyconymi belami siana

Dlaczego liczenie beli siana z nieba ma znaczenie

Bele siana mogą wydawać się prostymi zwojami wysuszonej trawy, ale dokładna wiedza, ile ich znajduje się na polu i gdzie leżą, ma realną wartość dla rolników. Precyzyjne zliczenia informują, ile paszy jest dostępne dla zwierząt, ile ciężarówek będzie potrzebnych i jak długo ekipy zbierające będą musiały pracować. Ten artykuł przedstawia BaleUAVision — nowy otwarty zbiór danych stworzony z obrazów z dronów, który ułatwia automatyczne wykrywanie i zliczanie beli siana z powietrza, pomagając przesunąć rolnictwo w kierunku bardziej inteligentnego i wydajnego zarządzania.

Gospodarstwa widziane z góry

BaleUAVision opiera się na 2 599 wyraźnych kolorowych fotografiach wykonanych przez drony nad 16 polami siana na północy Grecji. Pola obejmują około 232 akrów i rozciągają się na dwóch obszarach o odmiennym krajobrazie: rozległe równiny wokół Xanthi oraz bardziej urozmaicony teren w okolicach Dramy. Loty przeprowadzono latem 2023 roku przy czystym niebie i łagodnym wietrze, na wysokościach od 50 do 100 metrów i umiarkowanych prędkościach. Efektem jest realistyczne ujęcie pól po żniwach, z belami rozrzuconymi w wzory odzwierciedlające lokalne praktyki rolnicze i ukształtowanie terenu, a nie laboratoryjne ustawienia.

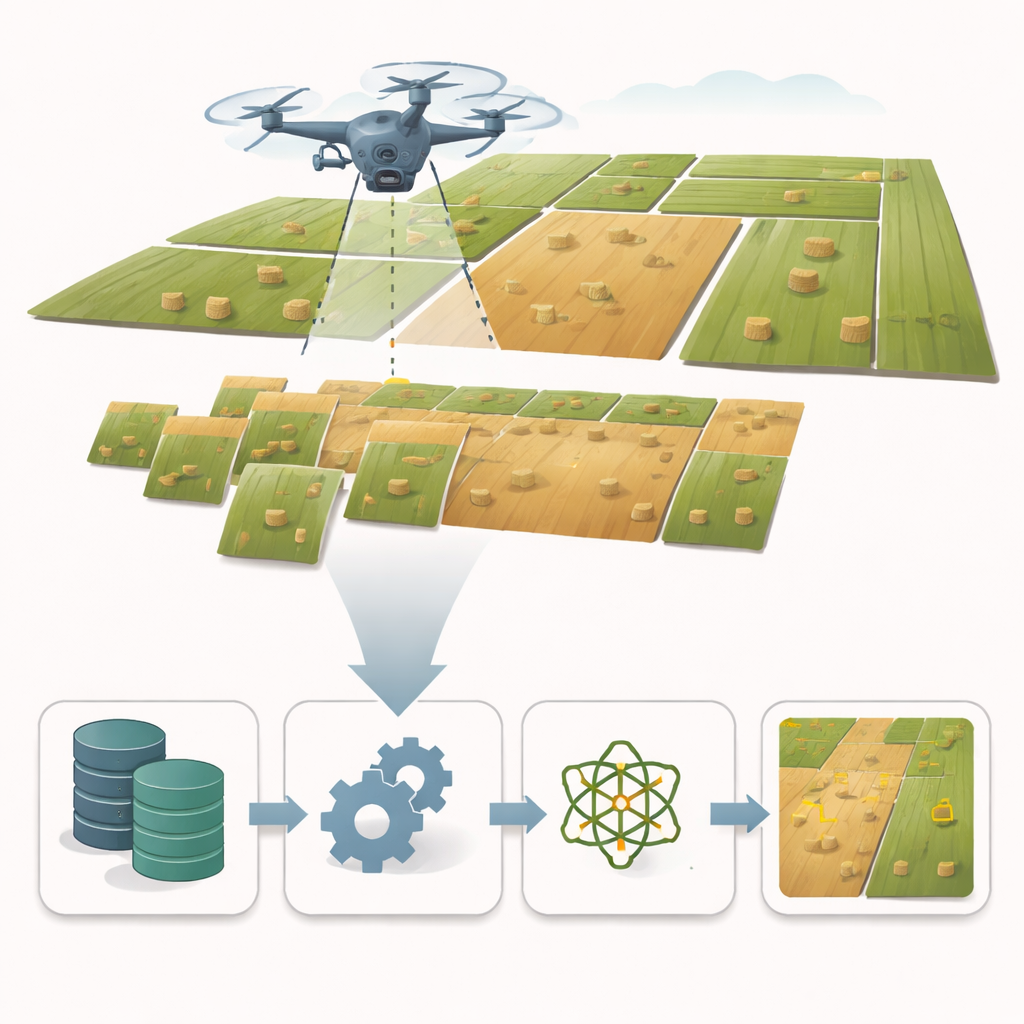

Przekształcanie zdjęć w użyteczne dane

Zebranie obrazów to tylko pierwszy krok. Zespół starannie przetworzył wszystkie zdjęcia, odrzucając te z rozmyciami lub innymi problemami, a następnie złączył je w szczegółowe mapy z lotu ptaka, zwane ortomosaicami, dla każdego pola. Te mozaiki posłużyły do ręcznego zliczenia każdej beli jako wiarygodnego odniesienia. Jednocześnie każdą pojedynczą belę odrysowano ręcznie na oryginalnych zdjęciach jako precyzyjny kontur, a nie jedynie przybliżone pole prostokątne. Ta żmudna praca stworzyła wysokiej jakości dane „ground truth” w kilku powszechnych formatach plików, tak aby różne narzędzia sztucznej inteligencji mogły być trenowane i testowane bez dodatkowej konwersji.

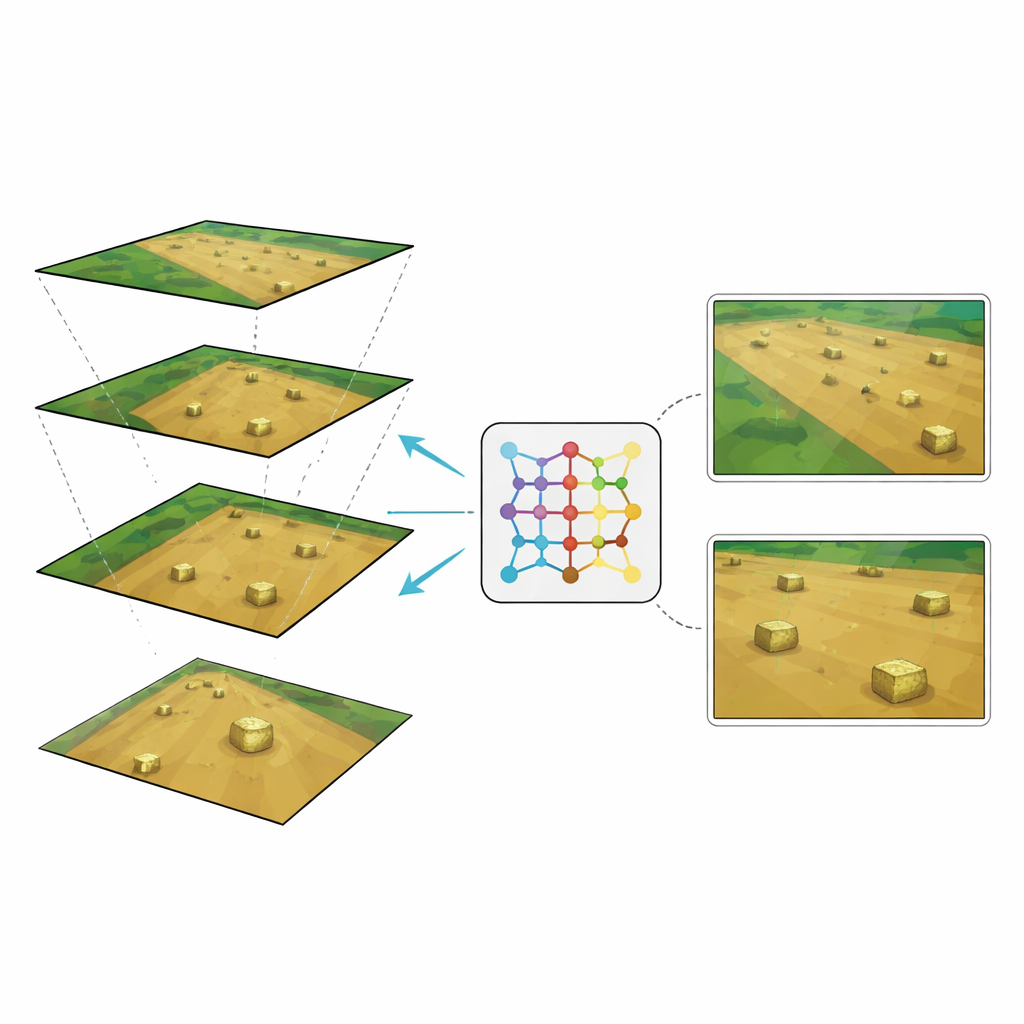

Różnorodność lotów, siła modeli

Sposób, w jaki dron jest pilotowany — jak wysoko, jak szybko i jak duże nakładanie się zdjęć — determinuje, co widzi. BaleUAVision celowo różnicuje parametry lotu, aby systemy detekcji trenowane na tym zbiorze nie zawodziły przy zmianie warunków. Niższe loty rejestrują więcej detali, ale obejmują mniej powierzchni w kadrze; wyższe loty widzą większy obszar, ale bele wydają się mniejsze. Dzięki uwzględnieniu obrazów z różnych wysokości i przy różnych warunkach oświetleniowych w dwóch regionach, zbiór danych odzwierciedla zarówno zróżnicowanie geograficzne, jak i zmiany skali kamery, z którymi spotykają się operacje w terenie. Testy pokazują, że ta różnorodność pomaga modelom sztucznej inteligencji rozpoznawać bele nawet wtedy, gdy są fotografowane w nowych miejscach lub z nowych wysokości.

Wystawianie zbioru na próbę

Aby sprawdzić, czy BaleUAVision jest rzeczywiście użyteczny, autorzy wytrenowali popularny system detekcji znany jako YOLOv11 do znajdowania beli siana na zdjęciach. Następnie poddali model dwóm testom: prosząc go o wykrywanie beli na polach z innego regionu, niż te, które widział podczas treningu, oraz zmieniając wysokość lotu między fazą trenowania a testowaniem. Po treningu na tym zbiorze system wykrywał niemal wszystkie bele na nowych polach przy bardzo niewielu fałszywych alarmach. Radził sobie także dobrze z większymi wysokościami, gdy podczas treningu widział niższe loty. Jednak model trenowany wyłącznie na zdjęciach z dużej wysokości miał problemy z ujęciami z bliska, dopóki badacze nie dodali nawet niewielkiej liczby przykładów z niższych wysokości, co pokazuje, jak skromny, ale dobrze dobrany dodatkowy zestaw danych może znacznie poprawić niezawodność.

Powyżej ogólnych modeli AI — ku narzędziom gotowym do pracy w polu

Zespół porównał też swój wyspecjalizowany model trenowany na belach z dużymi ogólnymi systemami wizji, zaprojektowanymi do „segmentowania wszystkiego” na obrazie. Choć te modele bazowe są potężne w wielu zastosowaniach, wypadały zauważalnie gorzej przy ciasno rozmieszczonych, małych belach na złożonym tle pola. Dostosowany model trenowany na BaleUAVision był nie tylko dokładniejszy, ale też bardziej praktyczny do uruchamiania na rzeczywistych dronach i komputerach polowych. Podkreśla to, jak starannie przygotowane, specyficzne dla pola dane mogą przekuć ogólne osiągnięcia AI w narzędzia, które naprawdę działają na poziomie gospodarstwa.

Od lepszych zliczeń do mądrzejszego rolnictwa

Mówiąc prosto, BaleUAVision dostarcza badaczom i firmom bogaty, swobodnie dostępny zestaw zdjęć z dronów i konturów beli, aby budować i testować roboty oraz oprogramowanie do liczenia beli. Dzięki niemu można tworzyć narzędzia, które szybko i niezawodnie poinformują rolników, ile mają beli, gdzie one leżą i jak najlepiej je zebrać — oszczędzając paliwo, czas i pracę. Te same dane mogą też wspierać badania nad stanem pól, planowanie logistyki, a nawet przyszłe roboty rolnicze. Udostępniając ten zbiór publicznie, autorzy tworzą podstawę do przekształcenia prostych beli siana w bramę do bardziej precyzyjnego, opartego na danych rolnictwa.

Cytowanie: Karatzinis, G.D., Gkelios, S. & Kapoutsis, A.C. BaleUAVision: Hay Bales UAV Captured Dataset. Sci Data 13, 313 (2026). https://doi.org/10.1038/s41597-026-06622-8

Słowa kluczowe: rolnictwo precyzyjne, obrazy z dronów, detekcja beli siana, widzenie komputerowe, zbiór danych z teledetekcji