Clear Sky Science · pl

Duża, koherentna czujka obrazowania 4D

Postrzeganie świata w czterech wymiarach

Samochody autonomiczne, drony dostawcze i zestawy rozszerzonej rzeczywistości opierają się na maszynach, które potrafią w czasie rzeczywistym rozumieć trójwymiarowe otoczenie. Obecnie tego typu widzenie jest często masywne, kosztowne lub energochłonne. Artykuł opisuje istotny krok w kierunku „kamery 4D” — czujnika o rozmiarach chipu, który nie tylko mapuje kształt sceny w 3D, lecz także mierzy, jak obiekty się poruszają, co może umożliwić kompaktowe widzenie maszynowe od robotów po smartfony.

Od płaskich zdjęć do żywych map

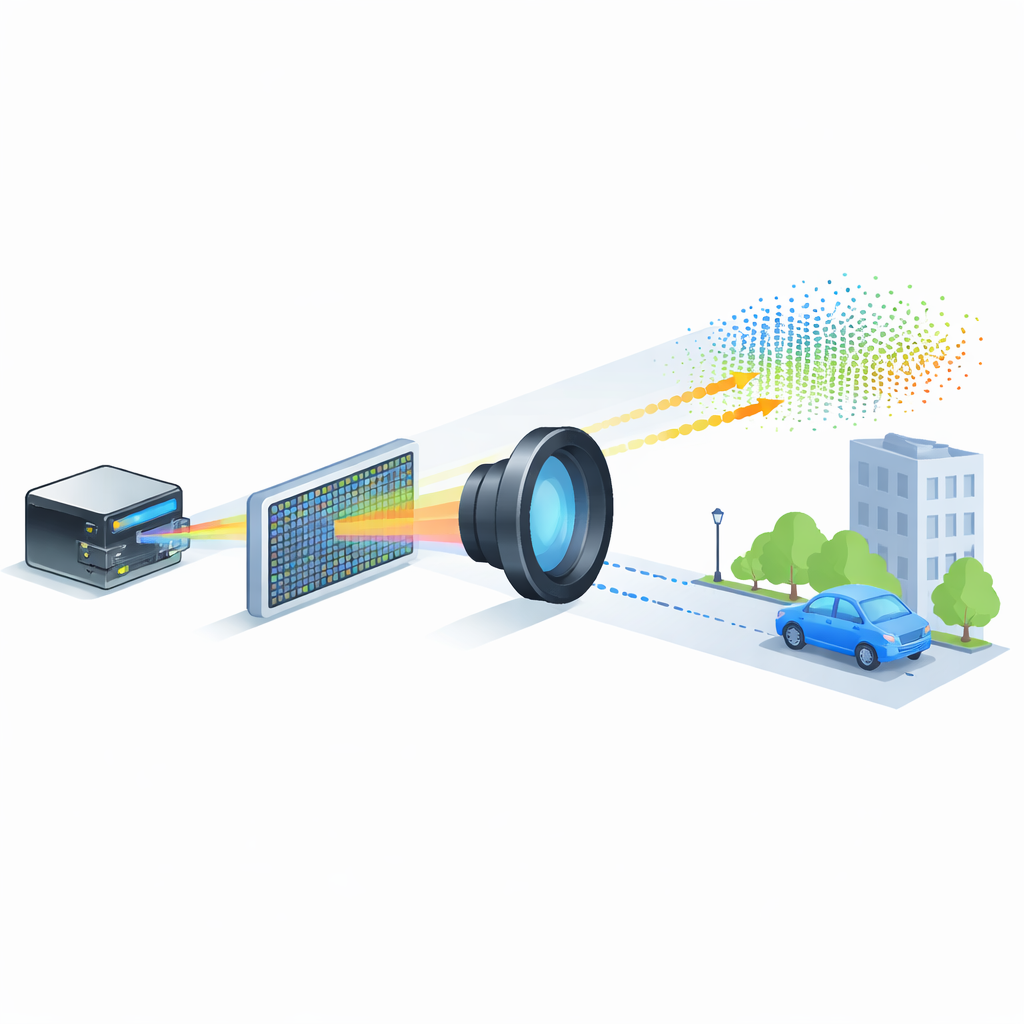

Tradycyjne aparaty rejestrują natężenie światła na płaskiej powierzchni, tworząc piękne obrazy 2D, ale bez bezpośredniej informacji o odległości. Z kolei systemy detekcji i dalmierzenia światłem (LiDAR) wysyłają impulsy laserowe i mierzą czas ich powrotu, budując trójwymiarową mapę otoczenia. Istniejące podejścia potrafią widzieć daleko i z dużą szczegółowością, jednak zazwyczaj wymagają ruchomych elementów, dużych optyk lub dużej energii na mierzony punkt. Utrudnia to stworzenie czegoś tak małego, taniego i wytrzymałego jak aparat w smartfonie, a jednocześnie zdolnego do bezpiecznego skanowania ulic, obiektów przemysłowych czy zatłoczonych pomieszczeń z wysoką rozdzielczością.

Chip mierzący odległość i ruch

Naukowcy przedstawiają nowy rodzaj matrycy detekcyjnej LiDAR — w istocie wersję LiDAR układu obrazującego spotykanego w cyfrowych aparatach. Ich urządzenie zawiera 352 na 176 pikseli, czyli ponad 60 000 miejsc pomiarowych, wszystkie zintegrowane na jednym chipie fotoniki krzemowej wraz z elektroniką sterującą. Zamiast krótkich impulsów laserowych system wykorzystuje ciągłą falę z modulacją częstotliwości (FMCW), w której kolor lasera jest kontrolowanie „przemykany”. Gdy światło odbija się od obiektów i wraca do chipu, jest koherentnie łączone z wiązką referencyjną. Maleńkie różnice częstotliwości ujawniają zarówno odległość każdego punktu, jak i prędkość jego ruchu w kierunku lub od czujnika, dodając prędkość jako czwarty mierzony wymiar.

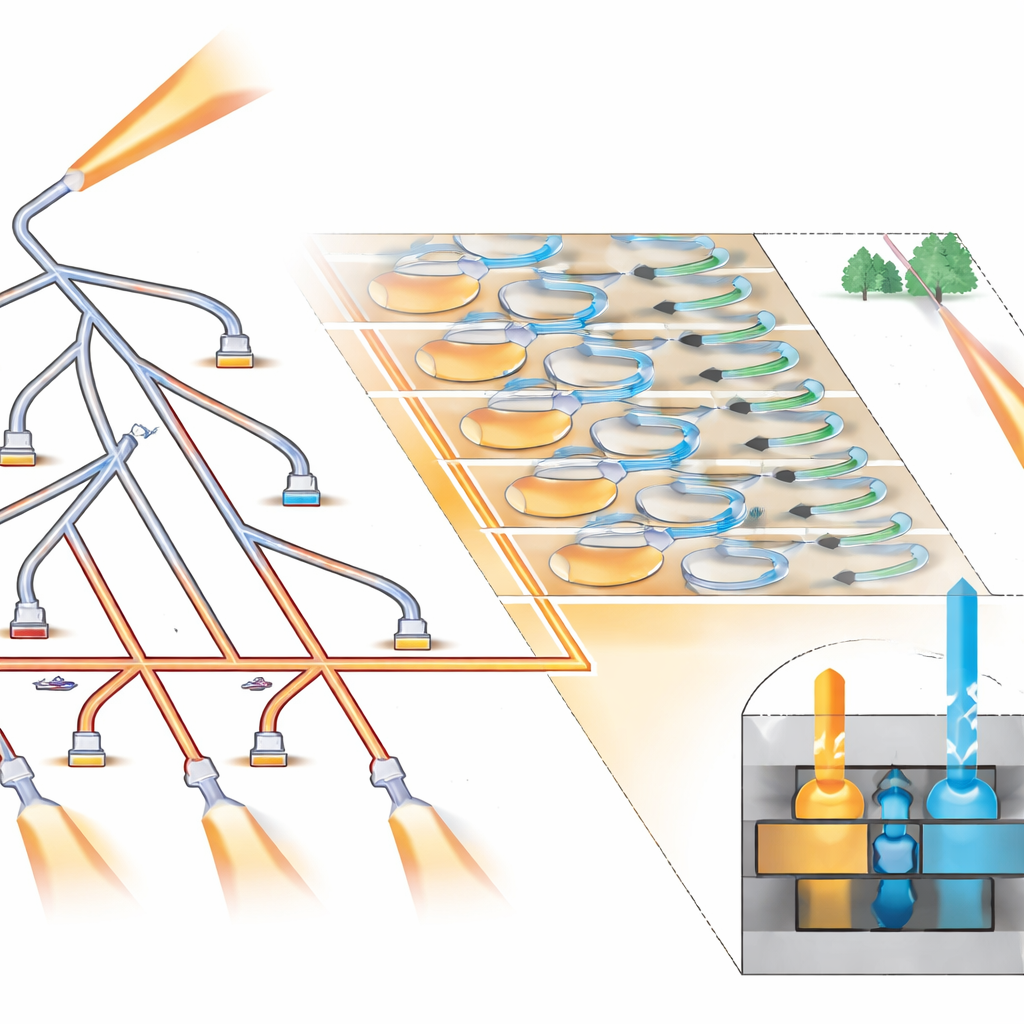

Jak działa drobna siatka świetlna

Aby objąć wiele pikseli bez marnowania energii, chip prowadzi „chirp” laserowy przez drzewo miniaturowych przełączników optycznych, kierując go kolejno do grup po osiem sąsiednich pikseli. W każdej grupie światło jest równomiernie dzielone, więc wszystkie osiem elementów działa jednocześnie jako nadajniki i odbiorniki. Każdy piksel używa pary grating couplerów do wysyłania i zbierania światła, pary zrównoważonych fotodetektorów oraz wzmacniacza na pikselu do wydobycia sygnału beat kodującego odległość i prędkość. Specjalnie zaprojektowane mikrosoczewki naniesione bezpośrednio na chip pomagają kierować więcej światła do środka i na zewnątrz, poprawiając efektywność. Ponieważ ta sama apertura wysyła i odbiera światło (układ monostatyczny), system unika zakłóceń między pikselami i wymaga tylko jednej zewnętrznej soczewki obrazującej, podobnie jak zwykły aparat.

Testy kamery 4D

Wykorzystując dostępne soczewki w bliskiej podczerwieni, zespół zbudował moduł przypominający aparat wokół chipu i zarejestrował szczegółowe chmury punktów 3D scen wewnętrznych i zewnętrznych. Przy jednej soczewce sensor osiągnął pole widzenia około 33 na 19 stopni i rozdzielczość kątową sięgającą 0,06 stopnia — wystarczającą do rozróżnienia mebli w biurze i detali architektonicznych na budynkach oddalonych o dziesiątki metrów. System mierzył obiekty w odległości od 4 do 65 metrów, wykorzystując na punkt jedynie dziesiątki nanojuli energii optycznej i średnią moc na cel około 178 microwatów na piksel, mieszcząc się w surowych limitach bezpieczeństwa wzroku. Rejestrował także ruch: w jednym eksperymencie zmierzył zmieniającą się prędkość radialną wirującej tarczy z precyzją rzędu milimetrów na sekundę.

Wydajność, ograniczenia i dalszy rozwój

Dokładne pomiary pokazują, że wydajność sensora jest bliska fundamentalnym granicom fizycznym narzuconym przez kwantową naturę światła, ale jeszcze ich nie osiąga. Obecnie głównym ograniczeniem jest szum elektryczny wzmacniaczy w każdym pikselu, co nieco obniża stosunek sygnału do szumu w porównaniu z idealnym detektorem ograniczonym jedynie przez fotony. Autorzy przedstawiają proste modyfikacje konstrukcyjne — przede wszystkim zwiększenie poziomu wewnętrznego światła referencyjnego i udoskonalenie układu optycznego, potencjalnie z użyciem stopów krzemu i azotku krzemu — które mogłyby przesunąć system do faktycznego reżimu ograniczonego przez szum strzałów i zwiększyć użyteczny zasięg powyżej 200 metrów. Przeniesienie części przełączników poza macierz pikseli również usunęłoby małe przerwy w pokryciu dalekiego pola, dając czystsze chmury punktów.

W stronę codziennego widzenia 4D

Ta praca demonstruje kompaktowy, w pełni zintegrowany czujnik obrazowania 4D, który dorównuje liczbie pikseli i zakresom wymaganym przez wiele zastosowań praktycznych, przy jednoczesnym utrzymaniu kontroli nad zużyciem energii i rozmiarem. Łącząc emitery światła, odbiorniki, sterowanie wiązką i elektronikę sterującą na jednym chipie krzemowym, urządzenie odgrywa podobną rolę dla pomiarów 3D i ruchu, jaką sensor CMOS odegrał w fotografii cyfrowej. Przy dalszych ulepszeniach takie czujniki mogłyby stać się na tyle tanie i wytrzymałe, by wbudować je w samochody, roboty, telefony i zestawy, zapewniając maszynom precyzyjne, działające w czasie rzeczywistym rozumienie świata 3D i jego zmian z momentu na moment.

Cytowanie: Settembrini, F.F., Gungor, A.C., Forrer, A. et al. A large-scale coherent 4D imaging sensor. Nature 651, 364–370 (2026). https://doi.org/10.1038/s41586-026-10183-6

Słowa kluczowe: LiDAR, obrazowanie 4D, fotonyka krzemowa, systemy autonomiczne, pomiar głębokości