Clear Sky Science · pl

Uzgodniona reprezentacja kierunków ruchu wizualnego i dotykowego w hMT+/V5 oraz obszarach czołowo-ciemieniowych

Dlaczego to ma znaczenie w codziennym życiu

Odbijanie komara z ramienia wydaje się bezwysiłkowe, ale mózg w rzeczywistości rozwiązuje skomplikowany problem: musi połączyć to, co widzisz, z tym, co czujesz, żeby ustalić, w którą stronę coś porusza się po skórze i jak zareagować. Badanie to pyta, gdzie w ludzkim mózgu wzrok i dotyk zostają zharmonizowane oraz jak mózg zamienia bardzo różne sygnały — światło padające na oko i nacisk na skórę — w jedną, wspólną percepcję ruchu w otaczającym nas świecie.

Dwa sposoby poznawania, gdzie coś się porusza

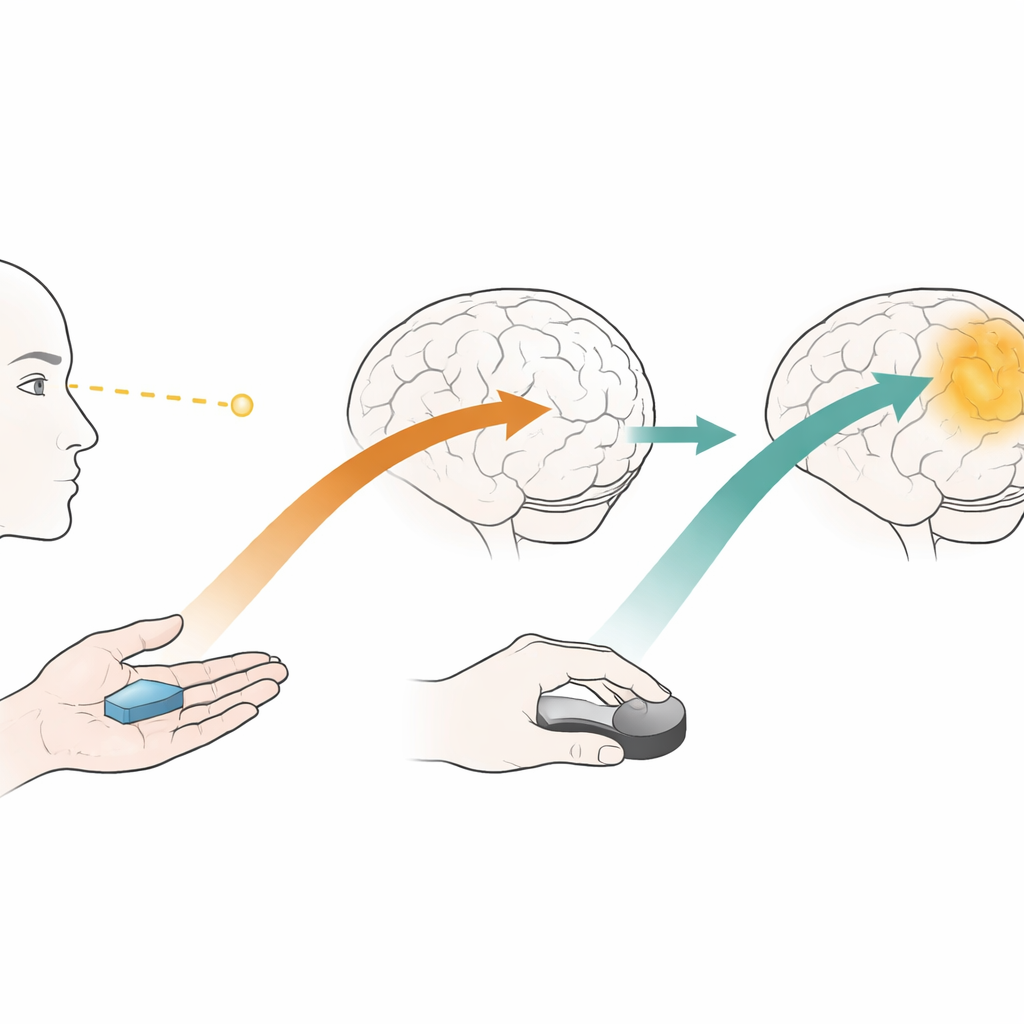

Wzrok i dotyk zaczynają od posługiwania się różnymi „językami przestrzennymi”. Ruch wzrokowy najpierw jest mapowany względem oczu: która część siatkówki jest pobudzona. Ruch dotykowy jest mapowany względem skóry: która część dłoni jest muśnięta. Nasze działania są jednak prowadzone przez to, gdzie rzeczy znajdują się w świecie zewnętrznym, a nie tylko na oczach czy skórze. Mózg musi więc przetłumaczyć te mapy związane z ciałem na wspólną, światową ramę odniesienia, tak aby poruszający się obiekt widziany blisko dłoni i odpowiadające mu odczucie na skórze były traktowane jako to samo zdarzenie.

Pomysłowy test z poruszającymi się kropkami i muśnięciami

Naukowcy użyli funkcjonalnego rezonansu magnetycznego, by monitorować aktywność mózgu, gdy uczestnicy oglądali poruszające się wzory kropek i czuli muśnięcie pędzlem po prawej dłoni. Zmieniali ustawienie dłoni — czasem dłonią do góry, czasem obróconą — tak by ten sam fizyczny ruch po skórze wskazywał w różnych kierunkach w przestrzeni zewnętrznej. Porównując wzory aktywności mózgu w wielu drobnych punktach pomiarowych, badali, czy dany region potrafi rozróżniać kierunki ruchu oraz czy jego „kod” kierunku pozostaje spójny, gdy ruch jest zdefiniowany na skórze versus w przestrzeni zewnętrznej.

Ośrodek ruchu wzrokowego, który także „czuje” ruch

Jednym z głównych celów badania był hMT+/V5, fragment kory wzrokowej od dawna kojarzony z przetwarzaniem ruchu. Zespół najpierw potwierdził, że obszar ten aktywuje się nie tylko podczas poruszających się kropek, ale także gdy dłonię muśnięto pędzlem, i że potrafi rozróżniać kierunki ruchu w obu modalnościach. Dotyczyło to również podregionów znanych jako MT i MST. W przeciwieństwie do tego, pierwotne obszary dotyku po lewej stronie mózgu silnie reagowały na ruch dotykowy, ale nie na ruch wzrokowy, co zgadza się z ich klasyczną rolą jako szczegółowej mapy powierzchni ciała.

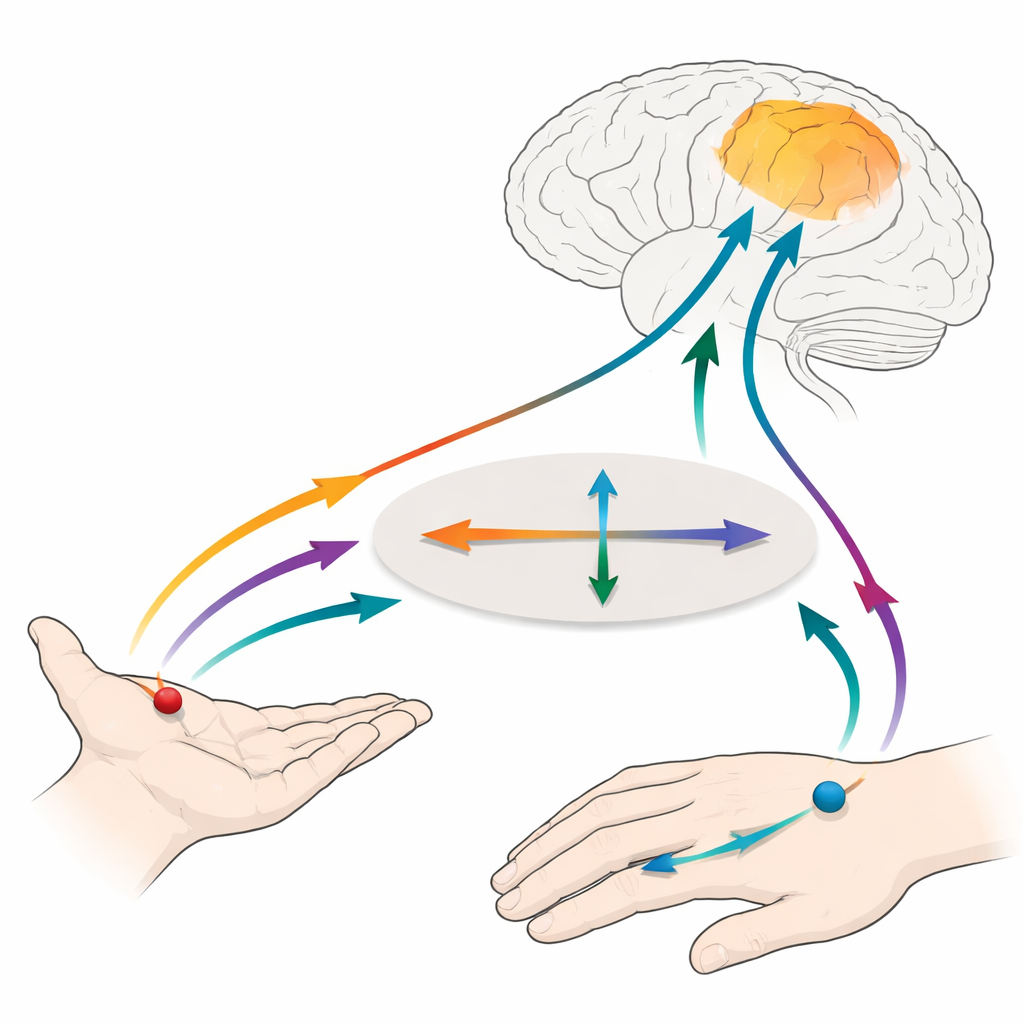

Od ruchu z perspektywy skóry do ruchu w świecie

Kluczowe pytanie dotyczyło tego, jak te obszary radzą sobie z różnymi „ramami odniesienia”. W pierwotnej korze dotyku ruch wzdłuż osi od małego palca do kciuka oraz ruch wzdłuż osi od palca do nadgarstka były najsilniej rozdzielone, gdy definiowano je czysto względem skóry, co wskazuje na dominujący kod związany z ciałem. W prawej hMT+/V5 natomiast kierunki dotykowe były lepiej rozróżnialne, gdy określano je względem świata zewnętrznego — poziomo versus pionowo w przestrzeni — niezależnie od pozycji dłoni. Co istotne, tylko w prawej hMT+/V5 komputer nauczony na wzorach ruchu wzrokowego potrafił poprawnie odgadnąć kierunki ruchu dotykowego, a takie „dekodowanie międzymodalne” działało tylko wtedy, gdy dotyk opisywano w współrzędnych zewnętrznych. Analizy całego mózgu wykazały, że sprzężenie ruchu wzrokowego i dotykowego w ten sposób angażowało także sieć prawostronnych obszarów ciemieniowych i czołowych związanych z uwagą przestrzenną i planowaniem ruchu.

Wspólna mapa, która nadal pamięta modalność

Chociaż prawa hMT+/V5 niosła wystarczająco wiele wspólnej informacji, aby zgrać kierunki ruchu wzroku i dotyku, nie wymazywała całkowicie różnicy między modalnościami: wzory dla ruchu wzrokowego i dotykowego nadal dało się odróżnić. Autorzy sugerują, że ten region, wraz z partnerami czołowo-ciemieniowymi, działa jako wielozmysłowe centrum ruchu. Konwertuje wejścia oparte na skórze i wejścia oparte na oku na częściowo wspólną, zewnętrzną mapę kierunków ruchu, zachowując jednocześnie informację o tym, który zmysł dostarczył dane. Taka elastyczna reprezentacja może pomagać mózgowi śledzić poruszające się zdarzenia w miarę przesuwania oczu i kończyn, pozwalając nam płynnie koordynować percepcję i działanie w złożonym, dynamicznym świecie.

Cytowanie: Shahzad, I., Battal, C., Cerpelloni, F. et al. Aligned representation of visual and tactile motion directions in hMT+/V5 and fronto-parietal regions. Nat Commun 17, 2625 (2026). https://doi.org/10.1038/s41467-026-70537-6

Słowa kluczowe: ruch wielozmysłowy, hMT+/V5, integracja wzrok-dotyk, ramy odniesienia przestrzennego, obrazowanie mózgu