Clear Sky Science · pl

Zmniejszanie luki opóźnień za pomocą ramy oceny ciągłego strumienia w percepcji zdarzeniowej

Dlaczego szybsze widzenie robotów ma znaczenie

Wyobraź sobie samochód autonomiczny zauważający nagłą przeszkodę albo robota próbującego odebrać pędzącą piłeczkę ping-pongową. W takich ułamkach sekund równie ważne jest szybkie widzenie, co widzenie dokładne. Artykuł opisuje nowy sposób oceny, jak szybko i niezawodnie nowoczesne „kamery zdarzeniowe” śledzą poruszające się obiekty, i pokazuje, że standardowe testy laboratoryjne mogą znacząco przeceniać wydajność tych systemów w rzeczywistych warunkach.

Od migawki do strumienia

Większość współczesnych systemów widzenia traktuje świat jak pokaz slajdów. Zwykłe kamery rejestrują obrazy w stałych odstępach, a algorytmy przetwarzają klatkę po klatce. Nawet gdy inżynierowie sięgają po neuromorficzne, czyli zdarzeniowe kamery, które wykrywają zmiany jasności z rozdzielczością mikrosekundową, często konwertują bogaty, ciągły strumień z powrotem na grube klatki. Takie myślenie w kategoriach klatek ukrywa istotny problem: opóźnienie. Za każdym razem, gdy system czeka na kolejną klatkę i ją przetwarza, ucieka kilka cennych milisekund. W zadaniach o dużej prędkości, jak jazda autonomiczna czy interakcja człowiek–robot, to opóźnienie oznacza, że system reaguje na niedawną przeszłość zamiast na teraźniejszość.

Nowy sposób oceniania widzenia w czasie rzeczywistym

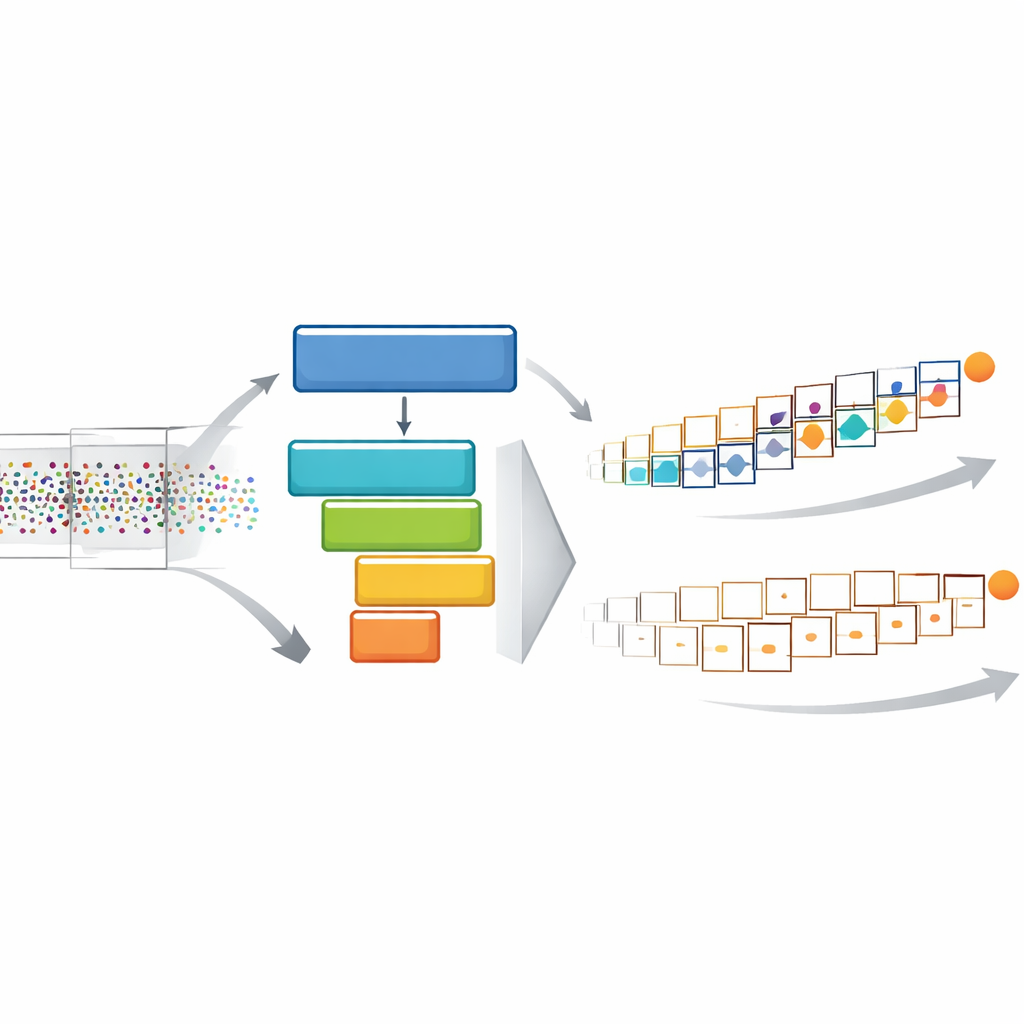

Aby zlikwidować lukę między wynikami z laboratorium a potrzebami świata rzeczywistego, autorzy wprowadzają ramę nazwaną STream-based lAtency-awaRe Evaluation, w skrócie STARE. Zamiast zmuszać dane zdarzeniowe do stałych klatek, STARE zasila model najświeższymi zdarzeniami zaraz po tym, jak zakończył on ostatnią prognozę. To „ciągłe próbkowanie” utrzymuje model w pracy i zwiększa częstotliwość jego wyjścia do granic sprzętu. Równocześnie STARE ocenia dokładność w nowy sposób: każda pozycja prawdziwa (ground-truth) poruszającego się obiektu jest powiązana z najbardziej aktualną dostępną w tym momencie prognozą. Jeśli model jest wolny, ta sama przestarzała prognoza jest używana dla wielu punktów czasowych, a jej pozorna dokładność spada. W ten sposób koszt opóźnienia jest wprost wbudowany w końcową ocenę.

Budowa szybkiego stanowiska testowego

Pomiary tak drobnych zależności czasowych wymagają równie drobiazgowych danych, których brakuje w istniejących zbiorach danych kamer zdarzeniowych. Zwykle rejestrują one pozycję obiektu tylko kilkadziesiąt razy na sekundę. W związku z tym autorzy stworzyli ESOT500, nowy zbiór danych, w którym obiekty są anotowane 500 razy na sekundę, zarówno na kamerach o niskiej, jak i wysokiej rozdzielczości oraz w różnorodnych scenach, takich jak kręcące się wentylatory, latające ptaki i poruszające się pojazdy. Przy takiej gęstości ścieżki referencyjne odwzorowują szybki, złożony ruch na tyle wiernie, by uniknąć „aliasingu czasowego”, gdy rzadkie próbkowanie sprawia, że wijąca się, przyspieszająca trajektoria wygląda zwodniczo prosto. ESOT500 działa więc jako test wytrzymałościowy dla każdej metody, która deklaruje radzenie sobie z szybkim, nieprzewidywalnym ruchem.

Co naprawdę się dzieje, gdy opóźnienie ma znaczenie

Wyposażeni w STARE i ESOT500, autorzy ponownie ocenili szereg najnowocześniejszych śledzących obiekty. W tradycyjnych testach opartych na klatkach cięższe, bardziej złożone modele często wypadają najlepiej. Pod STARE jednak wiele z tych precyzyjnych, lecz wolnych systemów traci ponad połowę swojej efektywnej dokładności, gdy uwzględni się opóźnienie. Lżejsze, szybsze modele natychmiast awansują na czoło, ponieważ dostarczają częstsze, aktualne prognozy. Zespół potwierdził to w eksperymencie z robotem grającym w ping-ponga: robot używał kamery zdarzeniowej i śledzącego, by odgryźć nadlatujące piłki. Umiarkowanie szybsze przetwarzanie niemal podwoiło współczynnik trafień, podczas gdy wolniejszy, offline-owo silny model wypadł słabo. Innymi słowy, w czasie rzeczywistym prędkość i świeżość informacji mogą przeważać nad samą precyzją.

Inteligentniejsze wykorzystanie ciągłych strumieni

Ponad oceną, autorzy badają, jak projektować lepsze systemy dla widzenia ciągłego. Jedna strategia, „Śledzenie asynchroniczne” (Asynchronous Tracking), łączy wolny, lecz dokładny model bazowy z mniejszym, zwinny towarzyszem, który aktualizuje pozycję obiektu między pełnymi wykonaniami modelu bazowego. To dwuetapowe rozwiązanie ponownie wykorzystuje wspólne cechy i korzysta z nieustającego przepływu zdarzeń, zwiększając częstotliwość wyjść o niemal 80% i poprawiając dokładność uwzględniającą opóźnienia o około 60%. Druga strategia, „Próbkowanie zależne od kontekstu” (Context-Aware Sampling), obserwuje, ile zdarzeń występuje wokół śledzonego obiektu. Gdy scena jest spokojna i niewiele się zmienia, tracker tymczasowo ponownie wykorzystuje ostatnią dobrą estymację zamiast przeliczać ją od nowa, ograniczając zmarnowany wysiłek. Następnie ponownie się aktywuje, gdy ruch się nasila, co szczególnie pomaga w warunkach niskiej aktywności lub przy rzadkich zdarzeniach.

Zamykanie luki między laboratorium a życiem

Dla osób nietechnicznych główne przesłanie jest proste: w dynamicznych sytuacjach to, jak szybko system widzenia potrafi zaktualizować swoje rozumienie świata, ma równie duże znaczenie jak dokładność każdej pojedynczej prognozy. Traktując wyjście kamery jako prawdziwy strumień i wbudowując opóźnienie bezpośrednio w ocenę, STARE ujawnia słabości, których konwencjonalne testy nie dostrzegają, i podkreśla rozwiązania, które rzeczywiście działają pod presją. W połączeniu ze zbiorem danych ESOT500 i proponowanymi strategiami śledzenia praca ta wskazuje kierunek dla przyszłych robotów, pojazdów i maszyn interaktywnych, które nie tylko dobrze widzą, ale widzą na czas.

Cytowanie: Chu, J., Zhang, R., Yang, C. et al. Bridging the latency gap with a continuous stream evaluation framework in event-driven perception. Nat Commun 17, 2441 (2026). https://doi.org/10.1038/s41467-026-70240-6

Słowa kluczowe: kamery zdarzeniowe, śledzenie w czasie rzeczywistym, widzenie robotyczne, ocena uwzględniająca opóźnienia, percepcja neuromorficzna